Clear Sky Science · de

Bewertung von Deep-Learning-Modellen zur Sepsisvorhersage auf Intensivstationen bei Verteilungsverschiebung: eine multizentrische retrospektive Kohortenstudie

Warum Frühwarnungen bei Infektionen wichtig sind

Sepsis ist eine schnell verlaufende, lebensbedrohliche Reaktion auf eine Infektion und eine der führenden Todesursachen auf Intensivstationen. Krankenhäuser setzen zunehmend auf Künstliche Intelligenz, um subtile Warnsignale in Monitoren und Laborwerten bereits Stunden bevor Sepsis für Ärztinnen und Ärzte offensichtlich wird, zu erkennen. Es gibt jedoch einen Haken: Ein Algorithmus, der in einem Krankenhaus gut funktioniert, liefert in einem anderen oft schlechtere Ergebnisse, weil Patientengruppen, Geräte und Dokumentationsgewohnheiten von Ort zu Ort variieren. Diese Studie stellt eine praktische Frage für die klinische Praxis: Angesichts solcher Unterschiede — wie kann man ein Sepsisvorhersagemodell am sinnvollsten wiederverwenden oder anpassen, wenn man es in einer neuen Intensivstation einführt?

Wie sich Krankenhausdaten still verändern können

Die Forschenden begannen damit zu zeigen, wie unterschiedlich Intensivstationdaten zwischen Krankenhäusern aussehen können. Sie verglichen drei große Intensivdatenbanken aus den USA und der Schweiz, die alle sorgfältig harmonisiert wurden, um dieselben Vitalzeichen und Laborwerte über die Zeit zu verfolgen. Selbst nach dieser Harmonisierung wiesen viele der 48 gemessenen Signale—wie Blutdruck, Sauerstoffsättigung und bestimmte Blutparameter—deutlich unterschiedliche Muster zwischen den Standorten auf. Statistische Tests zeigten, dass in jedem Krankenhauspaar Dutzende von Variablen verschiedenen Verteilungen folgten und einige Merkmale in jedem Datensatz ein einmaliges Verhalten zeigten. Grob gesagt ähnelten sich die beiden amerikanischen Datensätze mehr untereinander als jeweils dem Schweizer Datensatz, was unterstreicht, dass nationale Praxisgewohnheiten und Messmethoden dem Datenset einen Fingerabdruck aufprägen, den Algorithmen interpretieren müssen.

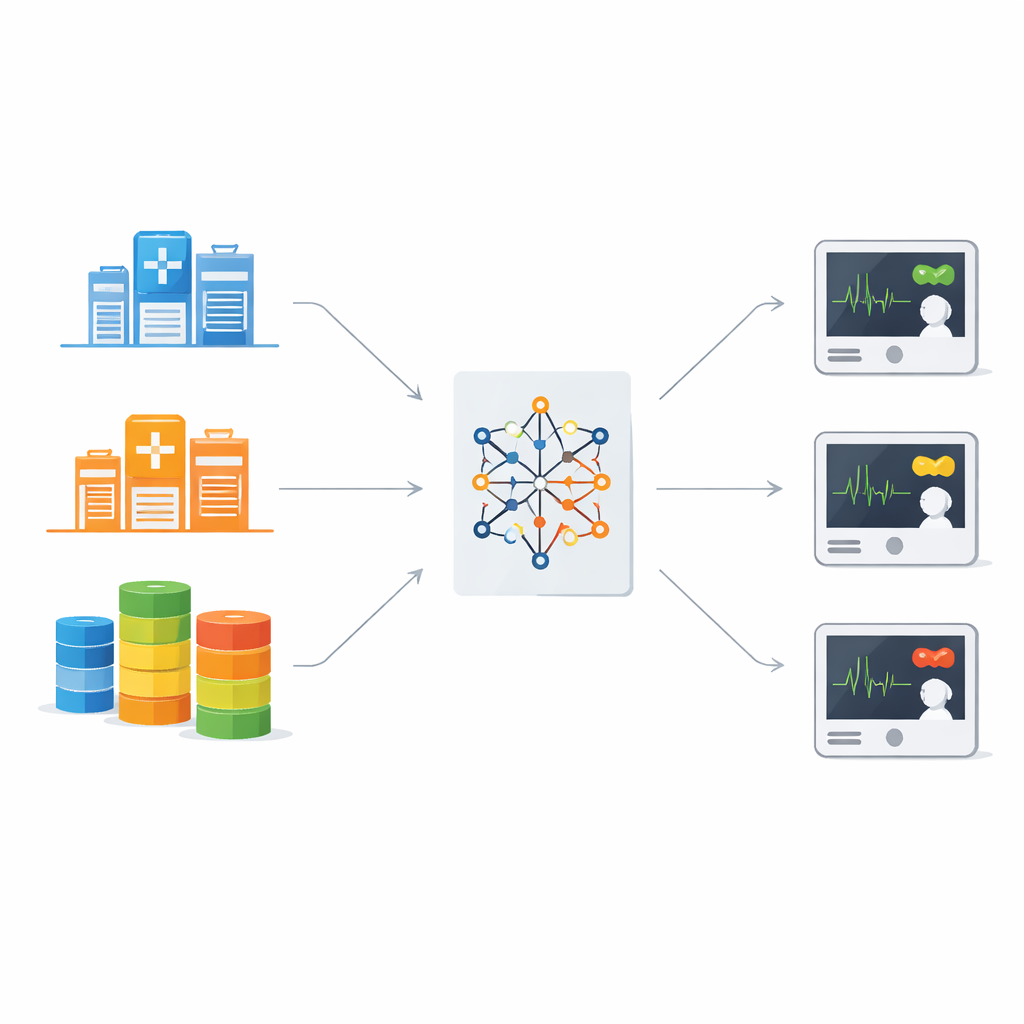

KI-Test über mehrere Intensivstationen hinweg

Mit diesen Unterschieden als Grundlage trainierte das Team drei Typen von Deep-Learning-Modellen, um Sepsis etwa sechs Stunden vor der formellen Diagnose vorherzusagen. Anschließend prüften sie, was passiert, wenn ein in einer Intensivstation trainiertes Modell direkt in einer anderen eingesetzt wird. Insgesamt ließen sich Modelle recht gut übertragen, insbesondere wenn die Ziel-Intensivstation nur sehr wenige eigene Daten hatte. Wenn zum Beispiel nur ein kleiner Bruchteil lokaler Aufzeichnungen verfügbar war, übertraf die Verwendung eines extern vortrainierten Modells das komplette Neutraining eines Modells vor Ort. Konvolutionale neuronale Netze erwiesen sich als am stabilsten über die Standorte hinweg. Mit zunehmender Menge an lokalen Daten stieg die Leistungsfähigkeit stetig und glättete sich schließlich; einige Krankenhäuser (insbesondere das große amerikanische multizentrische Datenset) ließen sich leichter modellieren als andere.

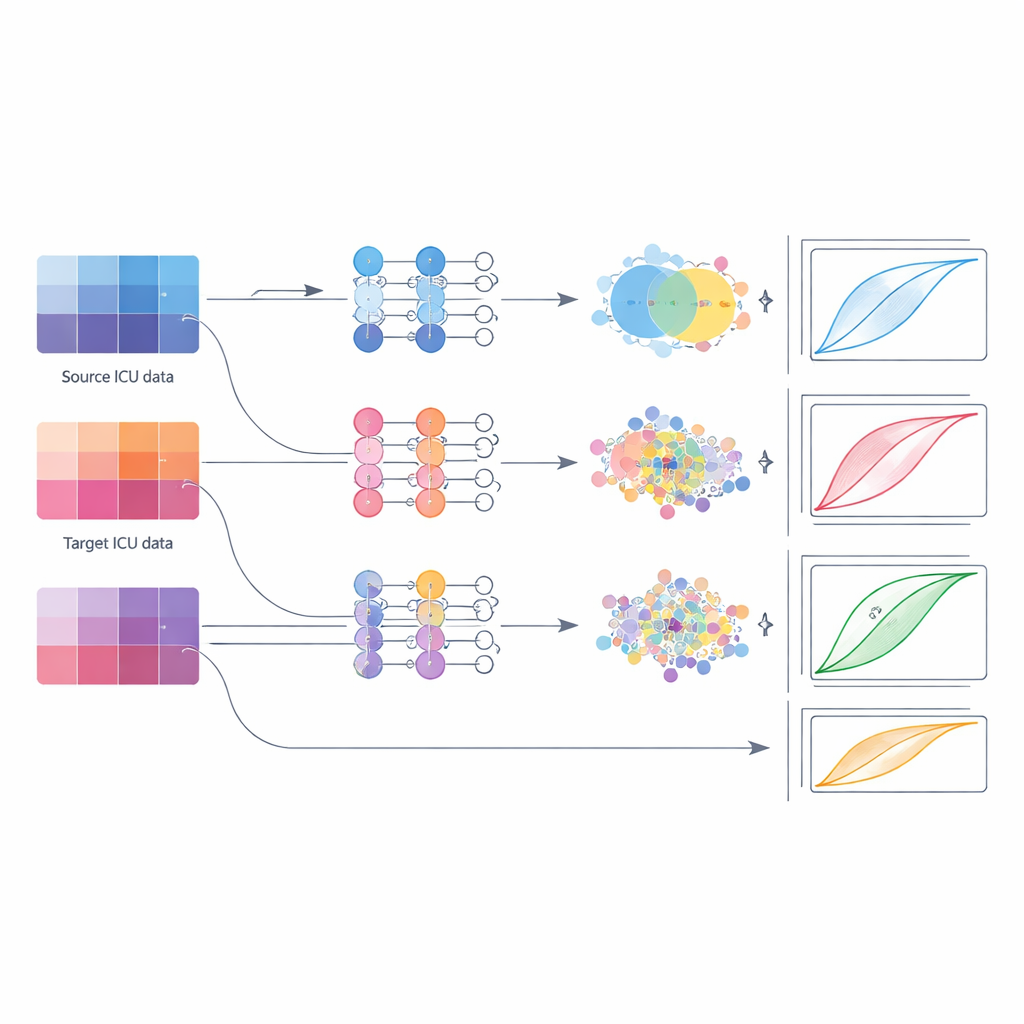

Verschiedene Wege, ein Modell zu übertragen

Als Nächstes verglichen die Autorinnen und Autoren praktische Strategien für die Bereitstellung dieser Modelle, wenn ein Krankenhaus schrittweise eigene Daten ansammelt. Sie untersuchten fünf Optionen: das ursprüngliche Modell unverändert wiederverwenden; nur die letzten Schichten feinabstimmen; alle Schichten mit lokalen Daten vollständig neu trainieren; ein komplett neues Modell nur mit lokalen Daten trainieren; sowie zwei Formen der Domänenanpassung, die explizit darauf abzielen, die internen Merkmale von Quell- und Zielkrankenhaus anzugleichen. Sie gruppierten Zielkrankenhäuser in kleine, mittlere und große Datenregime und wiederholten den Vergleich über mehrere Quell–Ziel-Paare und Modelltypen. Dieser systematische Ansatz spiegelte reale Rollouts wider, von einer kleinen ländlichen Intensivstation mit wenigen Fällen bis hin zu einem nationalen Netzwerk mit Zehntausenden von Aufenthalten.

Was bei verschiedenen Datenmengen am besten funktioniert

Die Ergebnisse stellen die verbreitete Praxis des einfachen Fine-Tunings in Frage. Unter den untersuchten Bedingungen lag Fine-Tuning meist hinter anderen Methoden zurück. Hatte die Ziel-ICU nur wenige Fälle, war die beste Option, mit dem externen Modell zu starten und anschließend alle seine Schichten mit den lokalen Daten neu zu trainieren; die Kombination von Quell- und Zieldaten zu einem einzigen Trainingspool (Fusion) war knapp dahinter. Bei mittelgroßen Datensätzen erzielten Domänenanpassungsmethoden—also Techniken, die das Modell so beeinflussen, dass sich die Merkmalspattern beider Krankenhäuser stärker überlappen—die zuverlässigsten Verbesserungen, indem sie Diskriminationsmaße erhöhten und die Variabilität niedrig hielten. Sobald die Ziel-ICU eine große Datenmenge angesammelt hatte, erzielten Modelle, die vollständig oder überwiegend auf diesen lokalen Daten trainiert wurden, manchmal mit zusätzlicher Fusion, gleichwertige oder bessere Leistungen als alle transferbasierten Ansätze.

Welche Bedeutung das für die Patientenversorgung hat

Für Nicht-Spezialistinnen und -Spezialisten ist die Kernbotschaft, dass es keinen universellen Weg gibt, KI zur Sepsisvorhersage über Krankenhäuser hinweg einzusetzen. Weil jede Intensivstation ihren eigenen "Daten-Akzent" hat, kann das einfache Importieren eines Modells und das kleine Anpassen der letzten Schicht—eine häufig genutzte Abkürzung—Leistungsreserven ungenutzt lassen oder sogar Klinikerinnen und Kliniker in die Irre führen. Stattdessen legt die Studie ein pragmatisches Vorgehen nahe: In sehr datenarmen Umgebungen mit einem externen Modell beginnen und es gründlich neu trainieren; mit zunehmender Zahl lokaler Fälle auf domänenbewusstes Training umstellen, das Unterschiede zwischen Krankenhäusern berücksichtigt; und bei großen lokalen Datensätzen Modelle bevorzugen, die überwiegend auf dieser lokalen Erfahrung basieren. Nach diesen Prinzipien können Krankenhäuser Sepsisvorhersage-Tools schneller in Betrieb nehmen und gleichzeitig dafür sorgen, dass ihre Alarme vertrauenswürdiger und besser auf ihre eigenen Patientinnen und Patienten zugeschnitten sind.

Zitation: Tranchellini, F., Farag, Y., Jutzeler, C. et al. Evaluating deep learning sepsis prediction models in ICUs under distribution shift: a multi-centre retrospective cohort study. npj Digit. Med. 9, 306 (2026). https://doi.org/10.1038/s41746-026-02364-4

Schlüsselwörter: Sepsisvorhersage, Intensivpflege, Deep Learning, Domänenanpassung, Verteilungsverschiebung