Clear Sky Science · de

Ein neuartiges quanten-kovnvolutionäres neuronales Netzwerk für quantenverstärkte Klassifizierung pixeliger Farb-Bilder

Mehr sehen in unscharfen Bildern

Das moderne Leben basiert auf Bildern – von medizinischen Scans und Satellitenaufnahmen bis zu Emojis und Videospiel-Sprites. Mit dem Anwachsen dieser Bildsammlungen stehen die analysierenden Computer jedoch vor einem Dilemma: Große, anspruchsvolle Modelle benötigen riesige Datensätze und viel Energie, während viele reale Aufgaben nur mit wenigen, sehr kleinen, niedrigauflösenden Bildern arbeiten müssen. Diese Arbeit untersucht, ob die ungewöhnlichen Prinzipien der Quantenphysik Computern helfen können, in solchen kleinen, verrauschten Bildern Muster zuverlässiger zu erkennen als heutige Standardwerkzeuge.

Warum winzige Bilder eine große Herausforderung sind

Klassische konvolutionale neuronale Netzwerke (CNNs) haben die Bilderkennung revolutioniert, indem sie Bilder mit kleinen Filtern absuchen und Schichten von Mustern lernen. Sie glänzen bei großen, detailreichen Bildern und massiven Datensätzen, wie sie etwa für das automatische Taggen von Internetfotos eingesetzt werden. In vielen praktischen Situationen – eingebettete Sensoren, kostengünstige Kameras, Fernerkundung oder ikongroße Displays – stehen jedoch nur kleine 4×4‑ oder 8×8‑Pixel‑Bilder zur Verfügung, oft in geringer Anzahl. In diesem Niedrigdaten‑Regime neigen Standard‑CNNs zum Overfitting: Sie merken sich die Trainingsbeispiele statt allgemeine Regeln zu lernen, was zu hoher Genauigkeit auf bekannten Bildern, aber schlechter Leistung auf neuen Bildern führt.

Quantenphysik in die Bildverarbeitung bringen

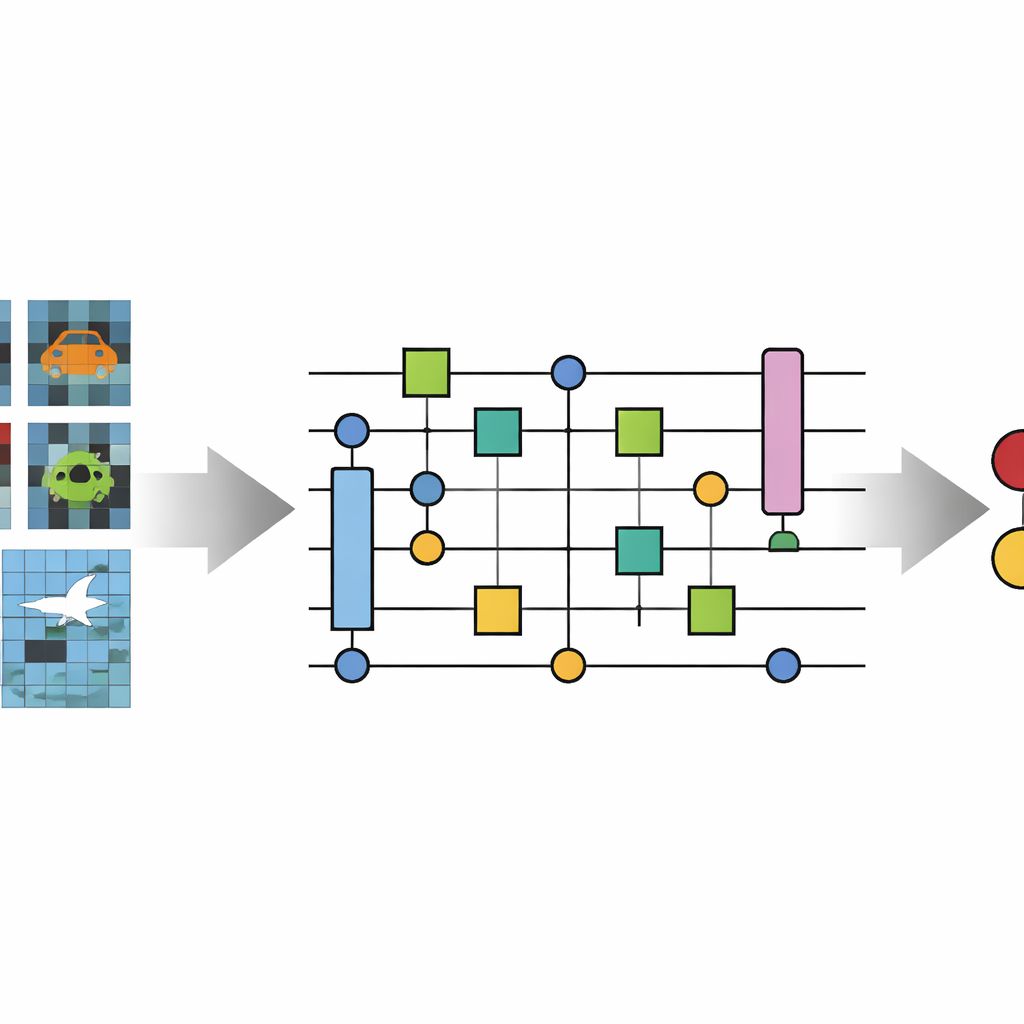

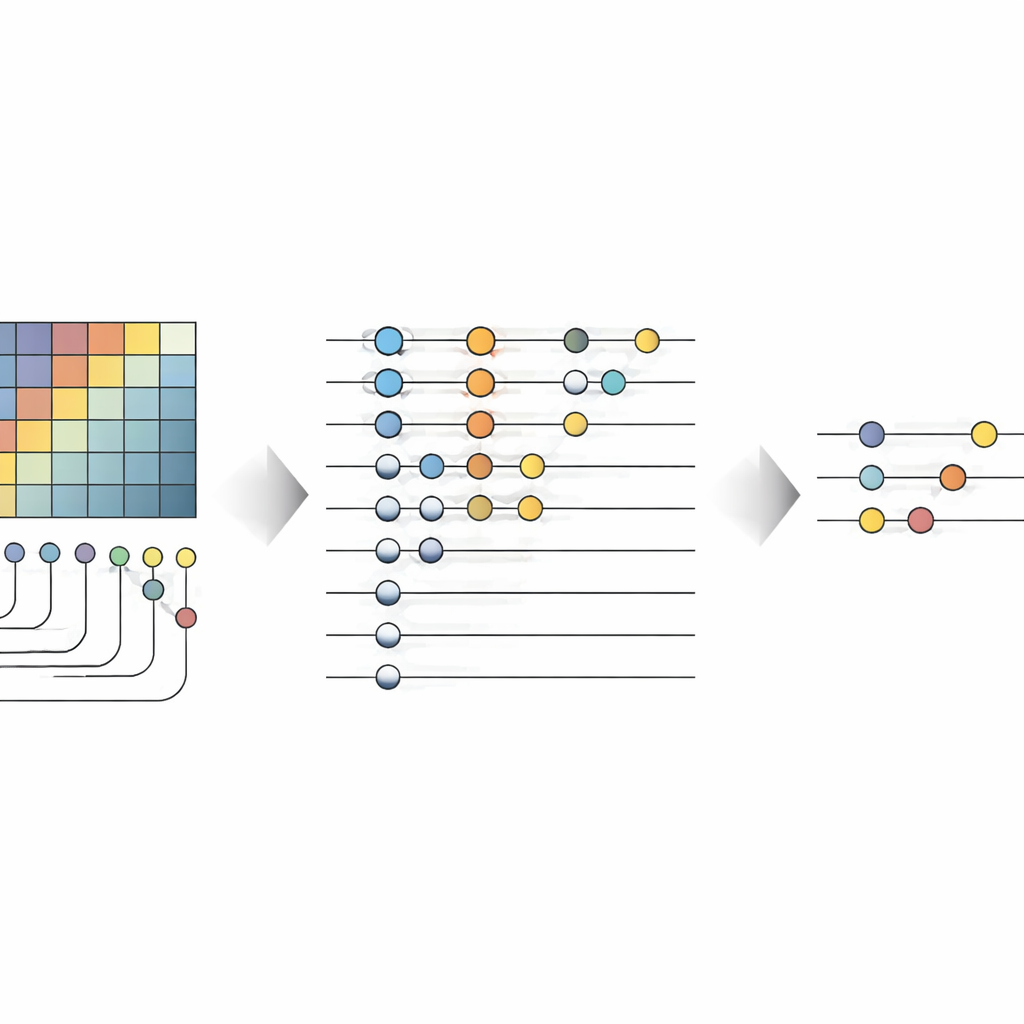

Die Autoren stellen das Novel Quantum Convolutional Neural Network (No‑QCNN) vor, ein hybrides Modell, das sowohl einen konventionellen Computer als auch ein simuliertes Quantengerät nutzt. Die Kernidee ist, jedes winzige Farbbild als Sammlung von Quantentbits (Qubits) darzustellen. Anstatt rohe Pixelwerte direkt in ein Netzwerk einzuspeisen, verwandelt die Methode zunächst die Rot‑Grün‑Blau‑Intensitäten eines Pixels und seine Position in einen kompakten dreidimensionalen Datenblock. Dieser Block wird dann durch sorgfältig gewählte Rotationen und Verschränkungsoperationen zwischen Qubit‑Paaren in einen Quantenzustand kodiert. Weil Qubits in Superpositionen existieren und miteinander verschränkt werden können, kann ein einzelner Quantenzustand prinzipiell viele Kombinationen von Pixelfarben und Positionen zugleich repräsentieren und so subtile Korrelationen erfassen, ohne sehr tiefe Netzwerke zu benötigen.

Wie das Quanten‑Netzwerk Bilder verarbeitet

Sobald das Bild in Qubits gespeichert ist, verarbeitet No‑QCNN es durch eine Folge von Schritten, die klassischen CNNs ähneln, aber vollständig in einem Quantenschaltkreis ablaufen. Qubit‑Paare durchlaufen kleine, wiederholte Transformationsblöcke, die wie quantenmechanische Äquivalente von Faltungsfiltern wirken und Informationen aus benachbarten "Positionen" im Bild mischen. Nach jedem dieser quantenmäßigen "Faltungs"‑Schritte reduziert eine Quanten‑Pooling‑Operation die effektive Zahl der Qubits, indem Informationen von zwei Qubits auf eines zusammengefaltet werden. Schicht für Schicht verengt sich der Schaltkreis auf nur noch wenige Qubits, deren Messergebnisse dann in einem klassischen Nachbearbeitungsschritt als vorhergesagte Klasse interpretiert werden – etwa ob eine Linie horizontal oder vertikal ist und welche Farbe sie hat. Die Stärken dieser Quantenoperationen werden automatisch von einem klassischen Optimierer angepasst, der das gesamte System als trainierbares Modell behandelt.

Vergleich: Quanten- vs. klassische Ansätze

Um die Leistungsfähigkeit von No‑QCNN zu prüfen, erzeugten die Forscher einfache, aber aufschlussreiche Bilddatensätze. In der Basisaufgabe enthielt jedes 4×4‑Bild entweder eine horizontale oder eine vertikale helle Linie vor einem verrauschten Hintergrund – eine binäre Klassifikationsaufgabe. In der anspruchsvolleren Variante zeigten 8×8‑Bilder eine Linie, die horizontal oder vertikal sein und rot, grün oder blau gefärbt sein konnte, was sechs mögliche Kombinationen ergab. Zur Fairness lief das Quantenmodell auf einem rauschfreien Simulator, und seine Leistung wurde mit einem kompakten klassischen CNN vergleichbarer Komplexität verglichen. Bei der binären Aufgabe erreichte das klassische CNN perfekte Validierungsgenauigkeit, während No‑QCNN etwa 90 % erreichte – ein Hinweis darauf, dass für einfache Probleme mit klarer Struktur der konventionelle Ansatz weiterhin vorn liegt. Bei der komplexeren Sechs‑Klassen‑Aufgabe mit nur 50 Bildern kehrte sich das Bild jedoch um: No‑QCNN erzielte etwa 82 % Validierungsgenauigkeit, während das klassische CNN auf 40 % abstürzte – ein deutliches Zeichen starken Overfittings.

Wobei Quanten‑Vision am meisten hilft

Die Experimente zeigten sowohl Potenzial als auch Grenzen. Wenn die Autoren die Datensatzgröße und Trainingszeit erhöhten, verschlechterte sich No‑QCNNs Leistung allmählich. Die feste Anzahl an Qubits und die geringe Schaltkreistiefe machten es dem Modell schwer, mehr Daten aufzunehmen, und mehrfaches Abtasten der Quantenzustände führte Rauschen in den Trainingsprozess ein. Dennoch verallgemeinerte das Quantenmodell in kleinen, korrelationsreichen Datensätzen – insbesondere in der sechs‑Klassen‑Aufgabe mit sehr wenigen Bildern pro Klasse – besser als das klassische CNN. Einfach gesagt: Der Quantenschaltkreis widerstand der Versuchung, die Trainingsbilder auswendig zu lernen, und lernte stattdessen eine Regel, die sich zuverlässiger auf neue Beispiele übertragen ließ.

Was das für die Zukunft bedeutet

Für Nicht‑Spezialisten lautet die zentrale Erkenntnis: Quanten‑Versionen neuronaler Netze sind keine universellen, magischen Beschleuniger für alle Bildprobleme, und sie sind noch nicht reif, um heutige Deep‑Learning‑Systeme zu ersetzen. Stattdessen identifiziert diese Studie eine realistische Nische, in der Quantenhardware vermutlich zuerst relevant werden könnte: winzige, datenarme Bildaufgaben, bei denen Muster subtil sind und klassische Modelle leicht überanpassen. No‑QCNN zeigt, dass selbst auf heutigen frühen, verrauschten Quantenplattformen (hier simuliert) sorgfältig entworfene Quantenschaltkreise mit klassischen CNNs konkurrieren können – und manchmal bei der Generalisierung besser abschneiden – allerdings bei deutlich längeren Trainingszeiten. Wenn Quantenprozessoren leistungsfähiger und fehlerärmer werden, könnten Architekturen wie No‑QCNN sich zu praktischen Werkzeugen für spezialisierte visuelle Aufgaben in Medizin, Fernerkundung und darüber hinaus entwickeln.

Zitation: Daka, C., Bhattacharyya, S. A novel quantum convolutional neural network framework for quantum-enhanced classification of pixelated colour images. Sci Rep 16, 10828 (2026). https://doi.org/10.1038/s41598-026-45140-w

Schlüsselwörter: Quanten-Maschinenlernen, Bildklassifikation, quantenbasierte neuronale Netzwerke, niedrigauflösende Bilder, hybride Quanten‑Klassische Modelle