Clear Sky Science · de

Elitäre Tischtennisspieler mit einem autonomen Roboter ausspielen

Roboter betreten die Sportbühne

Stellen Sie sich vor, Sie stehen einem Roboter gegenüber an einem Tischtennistisch und stellen fest, dass er nicht nur mit Ihnen rallyt – er kann erfahrene Konkurrenten schlagen. Dieser Artikel stellt Ace vor, einen autonomen Tischtennisroboter, der auf dem Niveau elitärer menschlicher Athleten spielt. Über das coole Sportgadget hinaus ist Ace ein Vorgeschmack auf eine Zukunft, in der Maschinen blitzschnelle, physische Interaktionen mit Menschen in Alltagssituationen bewältigen — von Fabriken bis zu Hausassistenten.

Warum Tischtennis eine harte Probe ist

Tischtennis ist weit anspruchsvoller, als es im Fernsehen aussieht. Im hochklassigen Spiel kann der Ball schneller als 20 Meter pro Sekunde fliegen, und Spieler haben manchmal weniger als eine halbe Sekunde zwischen den Schlägen, um zu sehen, zu entscheiden und sich zu bewegen. Neben der Geschwindigkeit krümmt der Drall — seine schnelle Rotation — die Flugbahn und verändert, wie der Ball vom Tisch und vom Schläger abprallt. Drehungen können über 1.000 Radianten pro Sekunde erreichen, wodurch Schläge ausweichen oder unvorhersehbar vom Tisch aufspringen. Frühere Tischtennisroboter umgingen einen Großteil dieser Komplexität, indem sie Bälle aus einfachen Maschinen abschossen, kleinere Spielflächen nutzten oder den Drall weitgehend ignorierten. Ace stellt sich hingegen der vollen Herausforderung echter Matches mit Standardausrüstung und offiziellen Regeln.

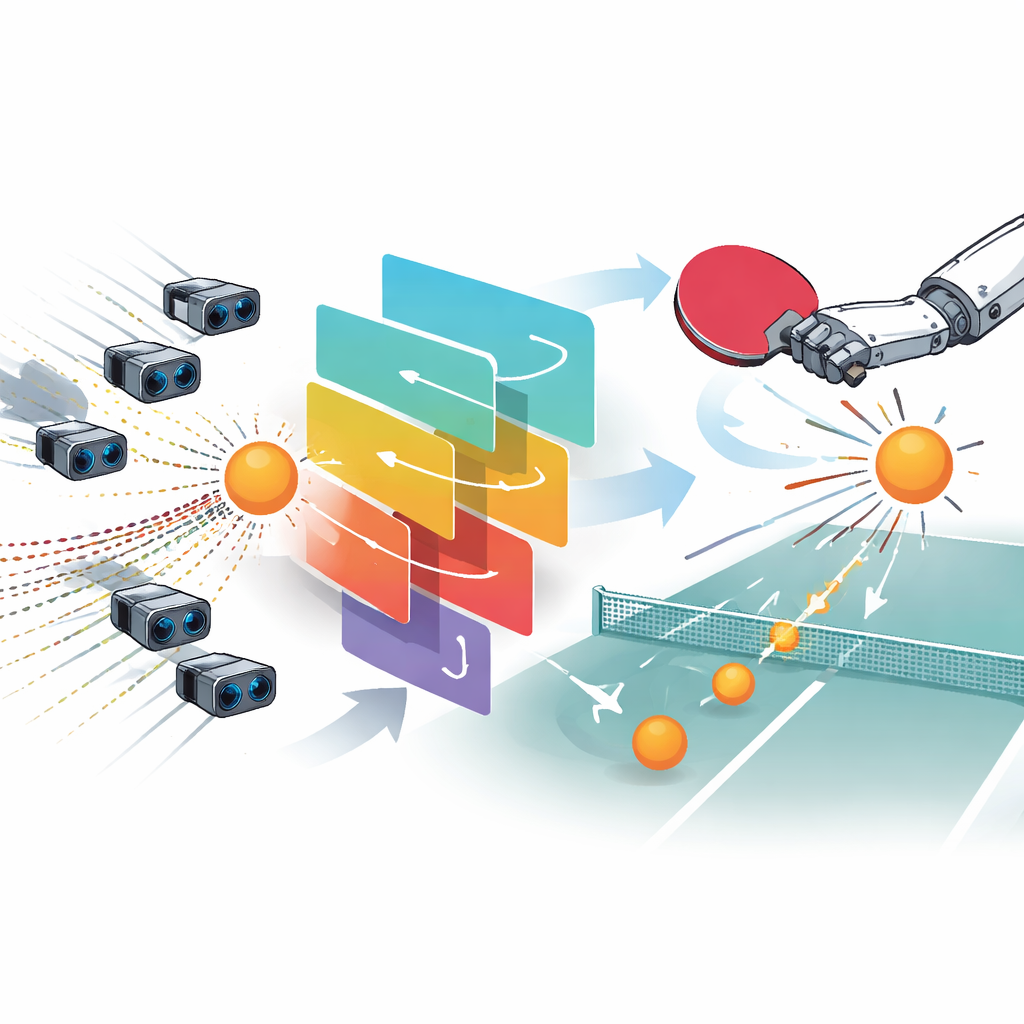

Eine schnell fliegende Kugel in Echtzeit sehen

Um mit dieser Geschwindigkeit fertigzuwerden, benötigt Ace außergewöhnliche Sicht. Das System verwendet neun konventionelle Kameras rund um ein olympisches Spielfeld, um den Ball dreidimensional zu verfolgen. Diese Kameras messen die Position des Balls etwa 200 Mal pro Sekunde mit Millimeterpräzision und nur wenigen Tausendstelsekunden Verzögerung. Allein die Position reicht jedoch nicht. Drall ist im ernsthaften Spiel entscheidend, daher setzt Ace zusätzlich drei spezialisierte „Blicksteuerungs“-Einheiten ein, die jeweils einen hochschnellen ereignisbasierten Sensor, lenkende Spiegel und ein Teleobjektiv kombinieren. Anstatt vollständige Bilder aufzuzeichnen, protokollieren diese Sensoren nur Helligkeitsänderungen an einzelnen Pixeln und erzeugen Ströme winziger „Ereignisse“, die Bewegung mit extrem geringer Unschärfe erfassen. Indem diese Ereignisse einem neuronalen Netzwerk und einem zweiten, präziseren Algorithmus zugeführt werden, schätzt Ace, wie schnell und in welche Richtung der Ball rotiert — bis zu mehreren hundert Mal pro Sekunde. Das System mischt diese Messungen, wählt jederzeit die beste Schätzung und übergibt sie an die Steuerungssoftware, die entscheidet, wie sich der Roboter bewegen soll.

Wie der Roboter seine Schläge auswählt und ausführt

Aces „Gehirn“ besteht aus einer Reihe von Steuerungsrichtlinien, die mit Deep Reinforcement Learning gelernt wurden — einer Methode, bei der Software durch virtuelle Versuchs- und Irrtumsprozesse besser wird. In der Simulation übt der Roboter wiederholt, einzelne Ballwechsel zurückzuspielen, geleitet von einem Belohnungssignal, das erfolgreiche Returns mit bestimmten Eigenschaften wie starker Vorwärtsrotation oder präzisen Landepunkten bevorzugt. Ein raffinierter Kniff im Trainingsverfahren erlaubt dem Lernalgorithmus, im Hintergrund perfekte simulierte Informationen zu nutzen, während die Richtlinien selbst nur verrauschte, realistische Sensordaten sehen, wodurch der Transfer in die reale Welt erleichtert wird. Während einer Rallye erhält Ace alle 32 Millisekunden eine aktualisierte Historie von Ball- und Roboterzuständen, wählt eine von mehreren gelernten „Fertigkeiten“ und erzeugt eine abstrakte Aktion. Diese Aktion wird dann von einer Optimierungsroutine in eine detaillierte, geschmeidige Gelenktrajektorie umgewandelt, die Geschwindigkeitsbegrenzungen einhält und Kollisionen mit dem Tisch oder dem Roboter vermeidet. Parallel dazu bereitet ein weiterer Planer ständig eine sichere „Reset“-Bewegung vor, sodass der Arm sich schnell erholen und für den nächsten Schlag bereit sein kann.

Maßgeschneiderter Körper für athletisches Spiel

Um menschliche Beweglichkeit zu erreichen, entwarf das Team einen speziellen Roboterarm mit acht Gelenken — zwei linearen und sechs rotierenden — die gerade genug Freiheitsgrade bieten, um den Schläger wie ein geübter Athlet zu positionieren, zu neigen und zu schwingen. Der Arm besteht aus leichten, kräftigen Metallstrukturen, die von Computeralgorithmen optimiert und additiv gefertigt wurden, sodass schnelle Bewegungen ohne Verlust an Steifigkeit möglich sind. Am Ende des Arms befindet sich ein regelkonformer Schläger und ein kleiner Becher, der den Ball für Einarm-Aufschläge hält, entsprechend den in den Regeln erlaubten Anpassungen. Alle Antriebe sind synchronisiert und reagieren jede Millisekunde, und das Sichtsystem teilt denselben Takt, sodass Wahrnehmung und Bewegung eng koordiniert sind. Auf der untersten Ebene verhält sich der Roboter einfach und vorhersehbar, mit Verzögerungen von nur wenigen Millisekunden selbst bei Höchstgeschwindigkeit — entscheidend, um Bälle zu treffen, die in Bruchteilen einer Sekunde ankommen.

Wie Ace gegen menschliche Experten abgeschnitten hat

Die Forschenden testeten Ace im April 2025 gegen fünf Elite-Spieler — erfahrene Konkurrenten mit über einem Jahrzehnt intensiven Trainings — und zwei Profis aus Japans oberster Liga. Die Matches folgten internationalen Regeln, mit Standardtischen, Netzen und Bällen und wurden von lizenzierten Schiedsrichtern bewertet. Ace spielte Best-of-Three gegen die Elitegruppe und Best-of-Five gegen die Profis. Es gewann drei der fünf Matches gegen die Elite-Spieler und holte einen Satz gegen einen der Profis. Während der Spiele aufgezeichnete Daten zeigen, dass Ace zuverlässig Returns bis etwa 14 Meter pro Sekunde zurückbringt und eine breite Palette von Drällen mit Rücklaufquoten über 75 Prozent bis zu beträchtlichen Drallwerten handhabt. Im Vergleich zu den Menschen verlässt sich Ace nicht auf besonders schnelle Schläge, um Punkte zu gewinnen. Stattdessen ähneln seine „gewonnenen“ Schläge in Geschwindigkeit und Drall seinen normalen Returns, was darauf hindeutet, dass Konsistenz — den Ball immer wieder aufs Feld zurückzubringen — seine Hauptstärke ist. Der Roboter neigt außerdem dazu, den Ball früher nach dem Aufkommen zu treffen, und seine sorgfältig gestalteten Aufschläge erzeugen gegen Elite-Spieler mehr direkte Punkte oder „Asse“ als die Menschen im Return erzielen.

Was das über den Ping-Pong-Tisch hinaus bedeutet

Ace zeigt, dass ein physischer Roboter, nicht nur ein Computerprogramm, jetzt menschliche Experten in einer schnellen, interaktiven Sportart herausfordern kann, ohne die Regeln zu vereinfachen. Für Nichtfachleute ist die zentrale Erkenntnis nicht nur, dass eine Maschine beeindruckendes Tischtennis spielt; es ist, dass die Kombination aus schneller Wahrnehmung, gelerntem Entscheidungsverhalten und agilem Hardwaredesign reale Aufgaben am Rande menschlicher Reaktionsfähigkeit bewältigen kann. Dieselben Techniken könnten schließlich helfen, Roboter sicher neben Menschen auf Fabrikböden arbeiten zu lassen, assistive Geräte mit den Bewegungen von Nutzern zu koordinieren oder neue Trainingswerkzeuge zu entwickeln, die Athleten auf zuvor unmögliche Weise fordern. Obwohl das Modellieren menschlicher Strategie und langfristiger Taktiken weiterhin eine Herausforderung bleibt, markiert Ace einen wichtigen Schritt hin zu physischen KI-Systemen, die unsere Räume teilen und in Echtzeit auf uns reagieren können.

Zitation: Dürr, P., El Gheche, M., Maeda, G.J. et al. Outplaying elite table tennis players with an autonomous robot. Nature 652, 886–891 (2026). https://doi.org/10.1038/s41586-026-10338-5

Schlüsselwörter: Roboter Tischtennis, physische KI, Bestärkendes Lernen, ereignisbasierte Sicht, Mensch–Roboter-Interaktion