Clear Sky Science · sv

Lättvikts igenkänning av beteenden i flera skala för burhållna värphöns med hjälp av en förbättrad YOLOv8-ram

Varför övervakning av höns kan skydda vår mat

Ägg är en stapelvara på frukostbord världen över, men hönsen som värper dem lever ofta i trånga burar där tidiga tecken på sjukdom eller stress lätt kan förbises. Denna studie visar hur ett kompakt artificiellt intelligenssystem kan övervaka burhållna värphöns via kameror, automatiskt känna igen centrala beteenden som är kopplade till hälsa och välfärd, och göra det tillräckligt snabbt för att köras på enkel gårdsutrustning. Arbetet pekar mot gårdar där tysta digitala väktare signalerar problem i realtid, vilket hjälper fåglarna att hålla sig friskare och gör äggproduktionen mer pålitlig.

Hur kameror blir tysta hjälpredor i ladan

Forskarlaget byggde först en praktisk övervakningsplattform som kunde klara damm, ljud och långvarig drift i ett kommersiellt hönshus. De monterade kameror på varje våning av staplade burar i en stor gård i Nanjing, Kina, och kopplade dem till små, lågströms Jetson Nano-datorer och batteripaket. Kamerorna filmade hönsen från tidig morgon till kväll under flera veckor och fångade hur de rörde sig, åt och interagerade. För att försäkra sig om att bilderna var användbara filtrerade teamet bort rutor med kraftiga skuggor, oskärpa eller blockerad sikt och behöll endast klara ögonblicksbilder av typiskt stalliv.

Att förvandla råvideo till märkta hönsbeteenden

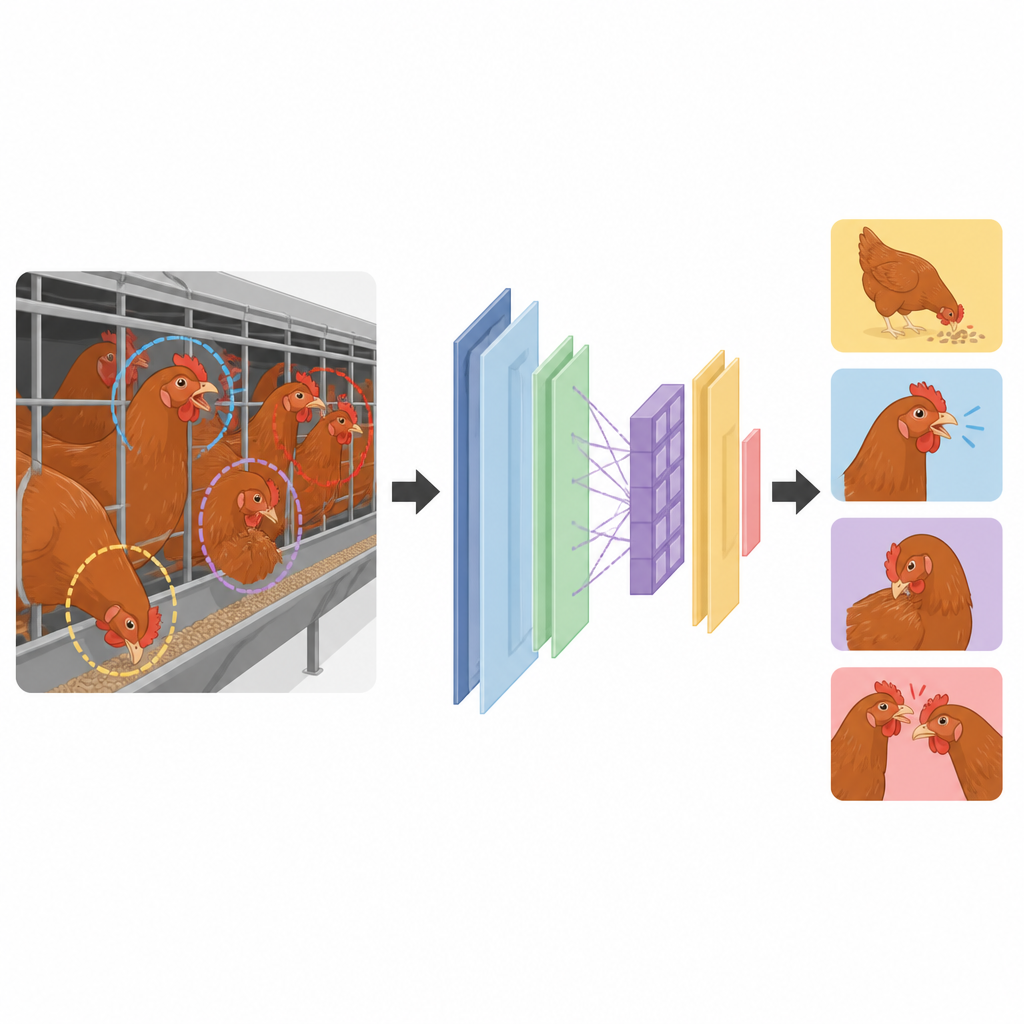

Ur de tusentals videorutor som samlades in märkte forskarna noggrant 2 035 bilder med hjälp av öppen källkodsprogramvara. De fokuserade på fyra huvudrelaterade beteenden: normalt ätande, andning med öppen näbb, att picka sig själv och att picka en annan höna. De tre sista räknas som varningssignaler och har i tidigare arbete kopplats till möjliga andningsproblem, smärta eller social stress. I varje bild ritade experterna rutor runt hönsens huvuden och tilldelade en av de fyra kategorierna. Datasetet delades sedan in i tränings-, validerings- och testuppsättningar så att datormodellen kunde lära sig från en del av datan och utvärderas rättvist på bilder den aldrig sett tidigare.

En smalare, skarpare digital observatör

I systemets centrum finns en förbättrad version av en populär objektigenkänningsmodell känd som YOLOv8. Teamet omdesignade dess interna struktur så att den effektivt kunde upptäcka små, tätplacerade höns-huvuden utan att kräva en tung dator. De bytte till lättare byggstenar som minskar upprepade beräkningar, lade till en uppmärksamhetsmekanism som hjälper modellen fokusera på viktiga regioner som näbbar, och använde ett smart uppsamplingsteg för att skärpa konturerna hos små mål. De introducerade också ett nytt träningsupplägg som ger extra vikt åt svårklassificerade exempel, såsom delvis dolda fåglar, vilket gör inlärningen mer stabil och mindre snedvriden mot lätta fall.

Hur väl systemet förstår höns

När det testades på Lukou-gårdsdatasetet kände den uppgraderade modellen igen målade beteenden med hög noggrannhet samtidigt som den förblev tillräckligt liten för realtidsanvändning. Den förbättrade den övergripande detektionsprestandan jämfört med standardversionen av YOLOv8, samtidigt som modellens storlek minskade med nästan en fjärdedel och beräkningsbehoven sjönk. Systemet var särskilt starkt på att upptäcka ätande, självpickning och ömsesidig pickning, ofta överstigande 93 procent på vanliga noggrannhetsskalor. Andning med öppen näbb, en kort och subtil handling som kan likna pickning, förblev mer utmanande och visade lägre precision även om modellen fortfarande fångade många verkliga fall. Författarna noterar att överlappande fåglar, burstänger och varierande ljusförhållanden gör detta beteende svårare att särskilja i enskilda stillbilder.

Vad detta betyder för framtidens smarta gårdar

För en lekmannaläsare är huvudbudskapet att gårdar kan börja använda relativt enkla kameror och kompakta AI-modeller för att ständigt övervaka hönsens välfärd, automatiskt räkna hur ofta fåglar äter, pickar sig själva eller pickar varandra. Systemet är inte perfekt och har testats endast på en gård med en ras, men det visar redan att automatisk beteendeövervakning kan fungera under verkliga stallförhållanden och på måttlig hårdvara. Med mer varierad data och modeller som analyserar korta videoklipp istället för enskilda rutor kan sådana verktyg bli tidiga varningssystem som larmar lantbrukare om hälsoproblem innan de sprider sig, vilket stödjer både djurvälfärd och en stabil äggförsörjning.

Citering: Tang, Y., Wei, J., Xie, B. et al. Lightweight multiscale behavior recognition for caged laying hens using an enhanced YOLOv8 framework. Sci Rep 16, 14936 (2026). https://doi.org/10.1038/s41598-026-43523-7

Nyckelord: värphöns, djurens beteende, datorseende, smartjordbruk, fågelvälfärd