Clear Sky Science · pl

Lekka wieloskalowa rozpoznawanie zachowań brojlerów nioszek w klatkach z wykorzystaniem ulepszonego systemu YOLOv8

Dlaczego obserwacja niosek może chronić nasze jedzenie

Jajka są podstawą porannych posiłków na całym świecie, jednak nioski znoszące je często żyją w zatłoczonych klatkach, gdzie wczesne oznaki choroby lub stresu łatwo przeoczyć. Niniejsze badanie pokazuje, jak kompaktowy system sztucznej inteligencji może obserwować nioski w klatkach za pomocą kamer, automatycznie rozpoznawać kluczowe zachowania powiązane ze zdrowiem i dobrostanem oraz działać na tyle szybko, by działać na prostym sprzęcie gospodarczym. Praca wskazuje na farmy, gdzie ciche cyfrowe strażniki sygnalizują problemy w czasie rzeczywistym, pomagając utrzymać ptaki w lepszym zdrowiu i stabilniejszą produkcję jaj.

Jak kamery stają się cichymi pomocnikami w kurniku

Naukowcy najpierw zbudowali praktyczną platformę monitorującą, która mogła przetrwać pył, hałas i długie dni w komercyjnym kurniku. Zainstalowali kamery na każdym poziomie piętrowych klatek na dużej farmie w Nankinie w Chinach, podłączając je do niewielkich, energooszczędnych komputerów Jetson Nano i pakietów baterii. Kamery rejestrowały nioski od wczesnego rana do wieczora przez kilka tygodni, dokumentując ich ruchy, sposób jedzenia i interakcje. Aby upewnić się, że obrazy będą użyteczne, zespół odfiltrował klatki z silnymi cieniami, rozmyciami lub zasłoniętym widokiem, zachowując tylko wyraźne migawki typowego życia w kurniku.

Jak surowe wideo przekształca się w oznakowane zachowania niosek

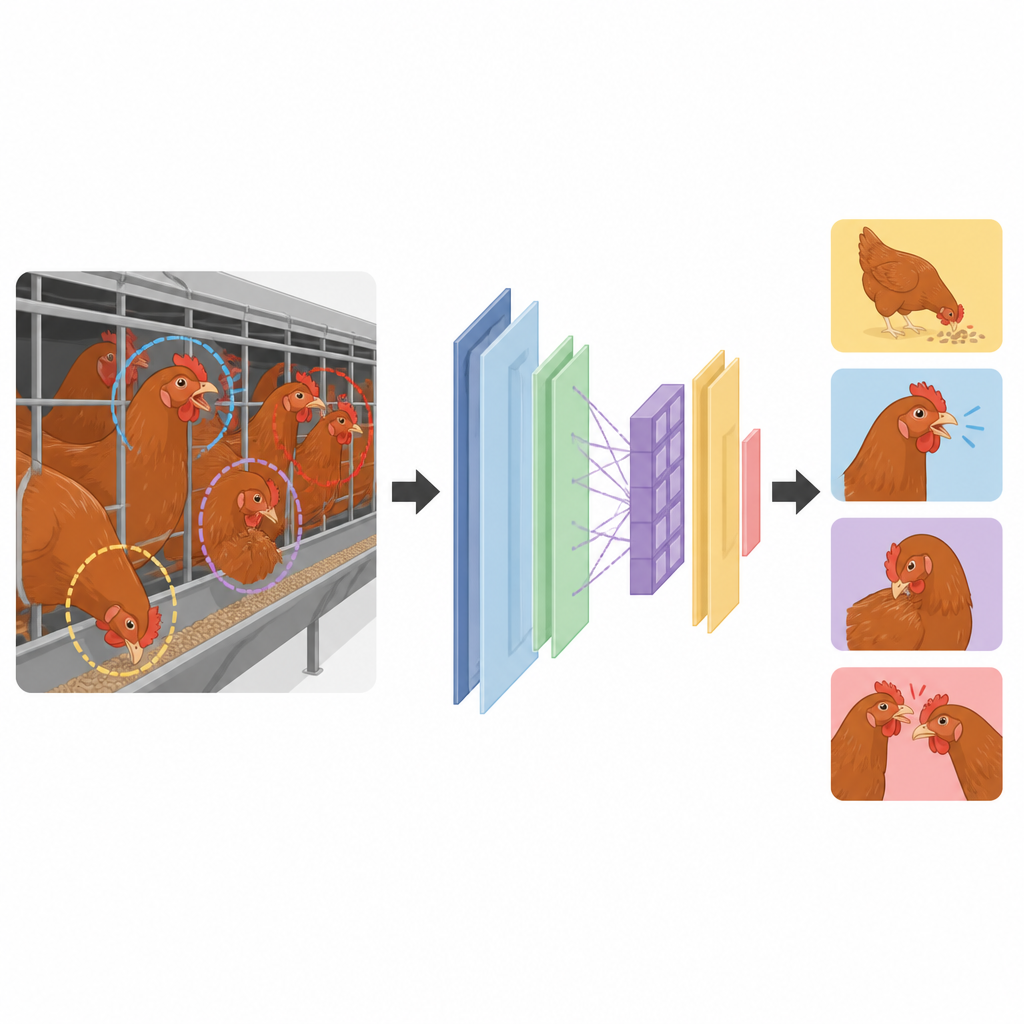

Z tysięcy zebranych klatek wideo naukowcy starannie otagowali 2 035 obrazów, korzystając z oprogramowania open source. Skupili się na czterech zachowaniach związanych z głową: normalnym jedzeniu, oddychaniu z otwartym dziobem, dziobaniu siebie oraz dziobaniu innej nioski. Te ostatnie trzy są uważane za sygnały ostrzegawcze, powiązane w wcześniejszych pracach z możliwymi problemami z oddychaniem, bólem lub stresem społecznym. W każdym obrazie eksperci narysowali pola wokół głów niosek i przypisali jedną z czterech kategorii. Zbiór danych następnie podzielono na zestawy treningowe, walidacyjne i testowe, aby model mógł uczyć się na jednej części danych i być oceniony uczciwie na obrazach, których wcześniej nie widział.

Szczuplejszy, ostrzejszy obserwator cyfrowy

W sercu systemu znajduje się zmodyfikowana wersja popularnego modelu wykrywania obiektów znanego jako YOLOv8. Zespół przeprojektował jego wewnętrzną strukturę, aby mógł efektywnie wykrywać małe, ściskane głowy niosek bez potrzeby użycia masywnego komputera. Zastosowano lżejsze bloki konstrukcyjne, które zmniejszają powtarzające się obliczenia, dodano mechanizm uwagi pomagający modelowi skupić się na istotnych obszarach, takich jak dzioby, oraz użyto inteligentnego etapu upsamplingu do wyostrzenia konturów niewielkich celów. Wprowadzono także nową procedurę treningową, która nadaje większą wagę trudnym do sklasyfikowania przykładom, takim jak częściowo zasłonięte ptaki, co stabilizuje naukę i zmniejsza uprzedzenie wobec łatwych przypadków.

Na ile dobrze system rozumie nioski

Testowany na zestawie danych z farmy Lukou ulepszony model rozpoznawał docelowe zachowania z wysoką dokładnością, pozostając jednocześnie na tyle małym, by działać w czasie rzeczywistym. Poprawił ogólną wydajność wykrywania w porównaniu ze standardową wersją YOLOv8, jednocześnie zmniejszając rozmiar modelu prawie o jedną czwartą i obniżając wymagania obliczeniowe. System był szczególnie skuteczny w wykrywaniu jedzenia, dziobania własnego i wzajemnego, często przekraczając 93 procent w powszechnie stosowanych miarach dokładności. Oddychanie z otwartym dziobem — krótki i subtelny ruch, który może przypominać dziobanie — pozostało bardziej wymagające, wykazując niższą precyzję, choć model wciąż wykrywał wiele prawdziwych przypadków. Autorzy zauważają, że nachodzące na siebie ptaki, pręty klatek i zmienne oświetlenie utrudniają rozróżnienie tego zachowania na pojedynczych zdjęciach.

Co to oznacza dla przyszłych inteligentnych farm

Dla czytelnika niebędącego specjalistą kluczowym przesłaniem jest to, że farmy mogą zacząć używać stosunkowo prostych kamer i kompaktowych modeli AI, aby stale monitorować dobrostan niosek, automatycznie licząc, jak często ptaki jedzą, dziobią siebie lub dziobią inne osobniki. Chociaż system nie jest idealny i był przetestowany tylko na jednej farmie z jedną rasą, pokazuje już, że automatyczne monitorowanie zachowań może działać w rzeczywistych warunkach kurnika i na skromnym sprzęcie. Przy szerszych danych i modelach analizujących krótkie klipy wideo zamiast pojedynczych klatek, takie narzędzia mogą stać się systemami wczesnego ostrzegania, które alarmują hodowców o problemach zdrowotnych zanim się rozprzestrzenią, wspierając zarówno dobrostan zwierząt, jak i stabilne dostawy jaj.

Cytowanie: Tang, Y., Wei, J., Xie, B. et al. Lightweight multiscale behavior recognition for caged laying hens using an enhanced YOLOv8 framework. Sci Rep 16, 14936 (2026). https://doi.org/10.1038/s41598-026-43523-7

Słowa kluczowe: nioski, zachowanie zwierząt, widzenie komputerowe, inteligentne rolnictwo, dobrostan drobiu