Clear Sky Science · de

Leichtgewichtige Multiskalen-Verhaltenserkennung bei eingestellten Legehennen mithilfe eines verbesserten YOLOv8‑Frameworks

Warum das Beobachten von Hennen unsere Nahrung schützen kann

Eier sind weltweit ein Grundnahrungsmittel, doch die Hennen, die sie legen, leben häufig in beengten Käfigen, in denen frühe Anzeichen von Krankheit oder Stress leicht übersehen werden. Diese Studie zeigt, wie ein kompaktes System der künstlichen Intelligenz Hennen in Käfigen per Kamera überwachen, automatisch Schlüsselverhaltensweisen erkennen kann, die mit Gesundheit und Wohlergehen verbunden sind, und das schnell genug, um auf einfacher Farm‑Hardware zu laufen. Die Arbeit weist in Richtung Betriebe, in denen stille digitale Wächter Probleme in Echtzeit melden und so helfen, Vögel gesünder zu halten und die Eierproduktion zuverlässiger zu machen.

Wie Kameras zu stillen Helfern im Stall werden

Die Forschenden bauten zunächst eine praktische Überwachungsplattform, die Staub, Lärm und die langen Arbeitstage eines kommerziellen Hühnerstalls aushält. Sie installierten Kameras auf jeder Ebene der gestapelten Käfige auf einem großen Betrieb in Nanjing, China, und verbanden sie mit kleinen, energieeffizienten Jetson Nano‑Computern und Batteriepaketen. Die Kameras zeichneten Hennen von frühmorgens bis abends über mehrere Wochen auf und dokumentierten, wie sie sich bewegten, fraßen und interagierten. Um sicherzustellen, dass die Bilder brauchbar waren, filterte das Team Frames mit starken Schatten, Unschärfe oder verdeckten Ansichten heraus und behielt nur klare Aufnahmen des typischen Stallalltags.

Rohvideo in gelabelte Hennenverhalten verwandeln

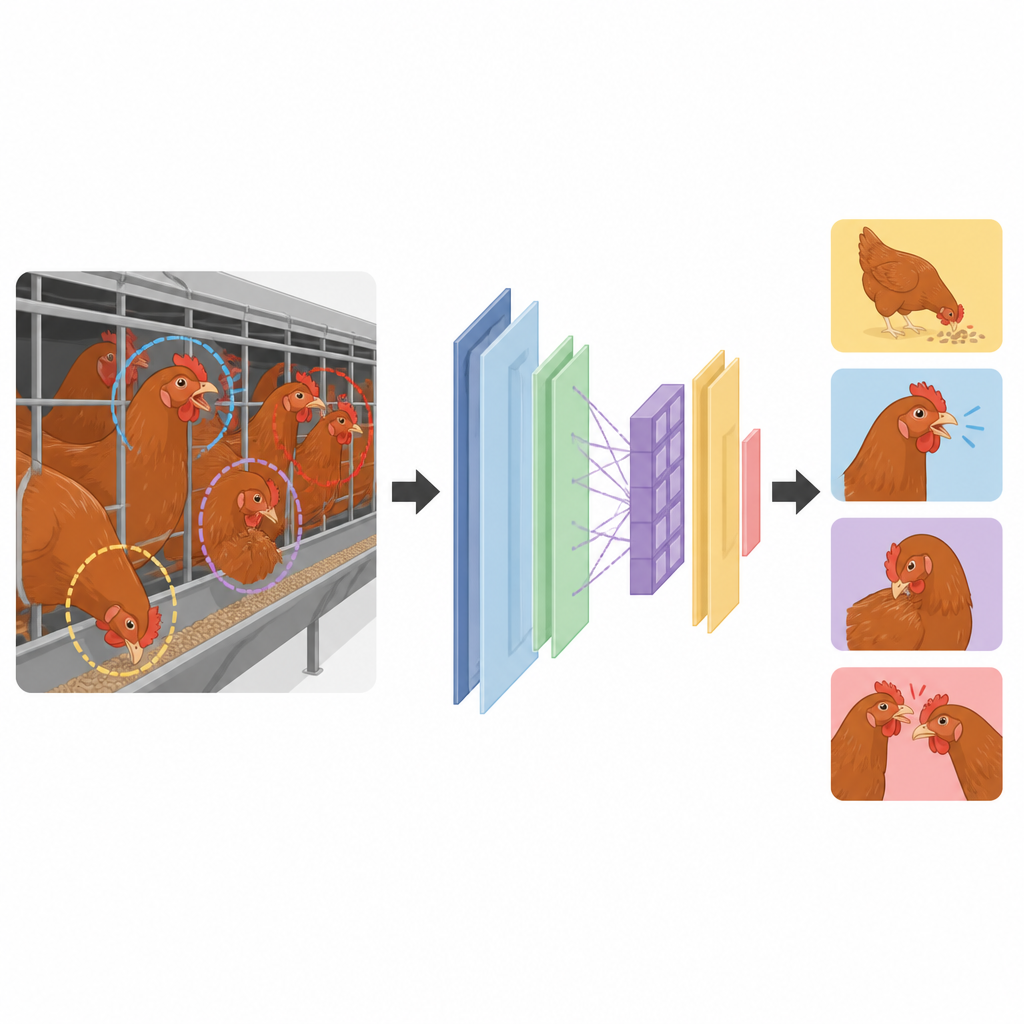

Aus den Tausenden gesammelter Videoframes kennzeichneten die Wissenschaftler sorgfältig 2.035 Bilder mit Open‑Source‑Software. Sie konzentrierten sich auf vier kopfbezogene Verhaltensweisen: normales Fressen, Atmen mit offenem Schnabel, Selbstpicken und das Picken eines anderen Huhns. Letztere drei gelten als Warnsignale und wurden in früheren Arbeiten mit möglichen Atemproblemen, Schmerzen oder sozialem Stress in Verbindung gebracht. In jedem Bild markierten Expertinnen und Experten Kästchen um die Hennenköpfe und ordneten eine der vier Kategorien zu. Der Datensatz wurde dann in Trainings‑, Validierungs‑ und Testmengen aufgeteilt, damit das Computermodell aus einem Teil der Daten lernen und fair anhand bisher ungesehener Bilder bewertet werden konnte.

Ein schlankerer, schärferer digitaler Beobachter

Im Zentrum des Systems steht eine verbesserte Version eines verbreiteten Objekterkennungsmodells, bekannt als YOLOv8. Das Team überarbeitete dessen interne Struktur, damit es kleine, gedrängte Hennenköpfe effizient erkennen kann, ohne einen leistungsstarken Rechner zu benötigen. Sie ersetzten Komponenten durch leichtere Bausteine, die wiederholte Berechnungen reduzieren, fügten einen Aufmerksamkeitsmechanismus hinzu, der dem Modell hilft, sich auf relevante Bereiche wie Schnäbel zu konzentrieren, und verwendeten einen intelligenten Upsampling‑Schritt, um die Konturen winziger Zielobjekte zu schärfen. Außerdem führten sie eine neue Trainingsstrategie ein, die schwer zu klassifizierenden Beispielen, etwa teilweise verdeckten Vögeln, mehr Gewicht gibt, wodurch das Lernen stabiler wird und nicht nur leichte Fälle bevorzugt.

Wie gut das System Hennen versteht

Getestet am Lukou‑Farm‑Datensatz erkannte das verbesserte Modell die Zielverhaltensweisen mit hoher Genauigkeit, blieb dabei aber klein genug für den Echtzeiteinsatz. Es steigerte die Gesamterkennungsleistung im Vergleich zur Standard‑YOLOv8‑Variante, reduzierte gleichzeitig die Modellgröße um fast ein Viertel und verringerte den Rechenbedarf. Besonders stark war das System bei der Erkennung von Fressen, Selbstpicken und gegenseitigem Picken und erreichte bei gängigen Genauigkeitsmetriken oft über 93 Prozent. Das Atmen mit offenem Schnabel, eine kurze und subtile Handlung, die Picken ähneln kann, blieb schwieriger und zeigte geringere Präzision, obwohl das Modell dennoch viele echte Fälle fand. Die Autorinnen und Autoren weisen darauf hin, dass sich überlappende Vögel, Gitterstäbe und wechselnde Lichtverhältnisse in Einzelbildern die Unterscheidung dieser Verhaltensweise erschweren.

Was das für zukünftige Smart‑Farms bedeutet

Für eine allgemeine Leserschaft ist die Kernbotschaft, dass Betriebe bereits relativ einfache Kameras und kompakte KI‑Modelle einsetzen können, um das Wohlbefinden von Hennen konstant zu überwachen und automatisch zu zählen, wie oft Vögel fressen, sich selbst picken oder einander picken. Zwar ist das System nicht perfekt und wurde bisher nur auf einem Hof mit einer Rasse getestet, zeigt jedoch, dass automatische Verhaltensüberwachung unter realen Stallbedingungen und auf bescheidener Hardware funktionieren kann. Mit vielfältigeren Daten und Modellen, die kurze Videoclips statt einzelner Frames auswerten, könnten solche Werkzeuge zu Frühwarnsystemen werden, die Landwirtinnen und Landwirte auf Gesundheitsprobleme aufmerksam machen, bevor sie sich ausbreiten, und so sowohl das Tierwohl als auch eine stabile Eierproduktion unterstützen.

Zitation: Tang, Y., Wei, J., Xie, B. et al. Lightweight multiscale behavior recognition for caged laying hens using an enhanced YOLOv8 framework. Sci Rep 16, 14936 (2026). https://doi.org/10.1038/s41598-026-43523-7

Schlüsselwörter: Legehennen, Tierverhalten, Computer Vision, Smart Farming, Geflügelwohlfahrt