Clear Sky Science · pt

Reconhecimento multiescalar de comportamento leve para galinhas poedeiras em gaiolas usando um framework YOLOv8 aprimorado

Por que observar galinhas pode proteger nosso alimento

Os ovos são um alimento básico nas mesas do café da manhã ao redor do mundo, mas as galinhas que os produzem frequentemente vivem em gaiolas lotadas, onde sinais iniciais de doença ou estresse são fáceis de passar despercebidos. Este estudo mostra como um sistema compacto de inteligência artificial pode monitorar galinhas poedeiras em gaiolas por meio de câmeras, reconhecer automaticamente comportamentos-chave ligados à saúde e bem-estar, e fazê-lo rápido o suficiente para rodar em hardware simples de fazenda. O trabalho aponta para fazendas onde sentinelas digitais discretas sinalizam problemas em tempo real, ajudando a manter as aves mais saudáveis e a produção de ovos mais confiável.

Como câmeras viram ajudantes discretos no galpão

Os pesquisadores primeiro montaram uma plataforma de monitoramento prática que pudesse resistir à poeira, barulho e longas jornadas de um aviário comercial. Instalaram câmeras em cada nível de gaiolas empilhadas em uma grande fazenda em Nanjing, China, conectando-as a pequenos computadores Jetson Nano de baixo consumo e a baterias. As câmeras gravaram as galinhas desde o início da manhã até o fim do dia por várias semanas, capturando como se moviam, se alimentavam e interagiam. Para garantir que as imagens fossem úteis, a equipe filtrou quadros com sombras fortes, borrões ou vistas obstruídas, mantendo apenas instantâneos claros da vida típica no galpão.

Transformando vídeo bruto em comportamentos de galinhas rotulados

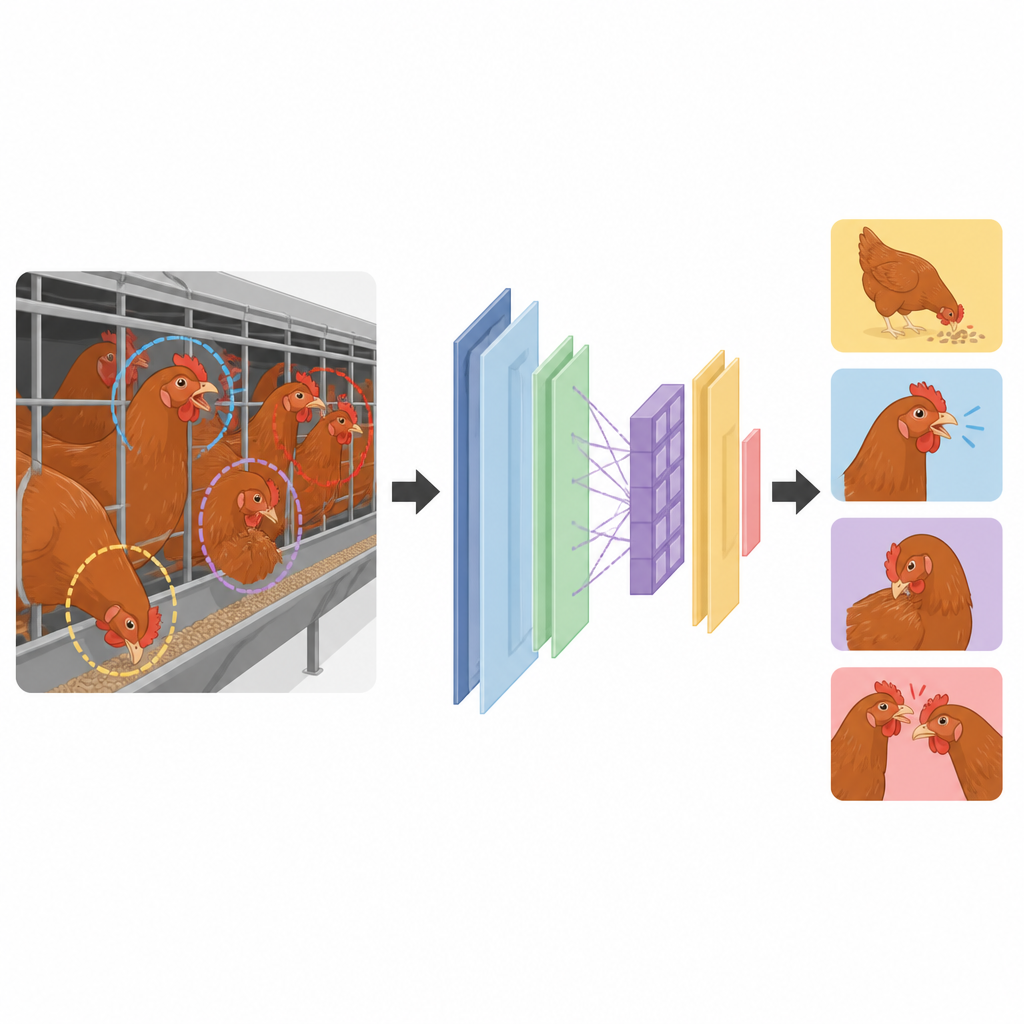

A partir dos milhares de quadros de vídeo coletados, os cientistas rotularam cuidadosamente 2.035 imagens usando software de código aberto. Eles focaram em quatro comportamentos relacionados à cabeça: comer normal, respirar com o bico aberto, bicar a si mesmo e bicar outra galinha. Estes três últimos são considerados sinais de alerta, ligados em trabalhos anteriores a possíveis problemas respiratórios, dor ou estresse social. Em cada imagem, especialistas desenharam caixas ao redor das cabeças das galinhas e atribuíram uma das quatro categorias. O conjunto de dados foi então dividido em treinamento, validação e teste para que o modelo de computador pudesse aprender com uma parte dos dados e ser avaliado de forma justa em imagens que nunca tinha visto.

Um observador digital mais enxuto e preciso

No coração do sistema está uma versão aprimorada de um modelo popular de detecção de objetos conhecido como YOLOv8. A equipe redesenhou sua estrutura interna para que pudesse identificar cabeças de galinha pequenas e em aglomeração de forma eficiente sem exigir um computador volumoso. Substituíram blocos internos por versões mais leves que reduzem cálculos repetidos, adicionaram um mecanismo de atenção que ajuda o modelo a focar em regiões importantes como o bico, e usaram uma etapa de upsampling inteligente para afiar os contornos de alvos minúsculos. Também introduziram uma nova receita de treinamento que dá peso extra a exemplos difíceis de classificar, como aves parcialmente ocultas, tornando o aprendizado mais estável e menos tendencioso a casos fáceis.

Quão bem o sistema entende as galinhas

Quando testado no conjunto de dados da fazenda de Lukou, o modelo aprimorado reconheceu os comportamentos alvo com alta precisão mantendo-se pequeno o bastante para uso em tempo real. Ele melhorou o desempenho geral de detecção em comparação com a versão padrão do YOLOv8, reduzindo ao mesmo tempo o tamanho do modelo em quase um quarto e diminuindo os requisitos de computação. O sistema foi especialmente forte na detecção de alimentação, bicada em si mesmo e bicada mútua, frequentemente excedendo 93% em métricas comuns de acurácia. Respirar com o bico aberto, uma ação breve e sutil que pode assemelhar-se a uma bicada, continuou mais desafiadora, apresentando menor precisão embora o modelo ainda tenha encontrado muitas instâncias verdadeiras. Os autores observam que aves sobrepostas, barras das gaiolas e variação de iluminação dificultam distinguir esse comportamento em imagens estáticas.

O que isso significa para futuras fazendas inteligentes

Para um leitor leigo, a mensagem principal é que fazendas podem começar a usar câmeras relativamente simples e modelos de IA compactos para manter vigilância constante sobre o bem-estar das galinhas, contabilizando automaticamente com que frequência as aves se alimentam, bicam a si mesmas ou bicam umas às outras. Embora o sistema não seja perfeito e tenha sido testado em apenas uma fazenda com uma raça, já demonstra que o monitoramento automático de comportamentos pode funcionar em condições reais de galpão e em hardware modesto. Com dados mais diversos e modelos que analisam pequenos trechos de vídeo em vez de quadros isolados, tais ferramentas poderiam virar sistemas de alerta precoce que avisam os produtores sobre problemas de saúde antes que se espalhem, apoiando tanto o bem-estar animal quanto um fornecimento estável de ovos.

Citação: Tang, Y., Wei, J., Xie, B. et al. Lightweight multiscale behavior recognition for caged laying hens using an enhanced YOLOv8 framework. Sci Rep 16, 14936 (2026). https://doi.org/10.1038/s41598-026-43523-7

Palavras-chave: galinhas poedeiras, comportamento animal, visão computacional, agricultura inteligente, bem-estar avícola