Clear Sky Science · sv

En multimodal näthinnebildsdatabas för upptäckt av diabetisk retinopati med foundation-modeller

Varför tidig upptäckt av ögonskador är viktig

För personer med diabetes kan skador på den ljuskänsliga vävnaden i ögats bakre del fortskrida tyst under flera år innan synen märkbart försämras. När symtom väl uppträder kan viss skada vara permanent. Läkare vet att regelbundna ögonundersökningar kan upptäcka problem i ett tidigt skede, men att manuellt granska tusentals bilder är långsamt och kostsamt. Denna studie presenterar en stor, noggrant annoterad samling näthinnebilder avsedd att hjälpa artificiell intelligens (AI) att lära sig att upptäcka diabetiska ögonsjukdomar mer träffsäkert och mer pålitligt, vilket kan ge tidigare varningar till betydligt fler patienter.

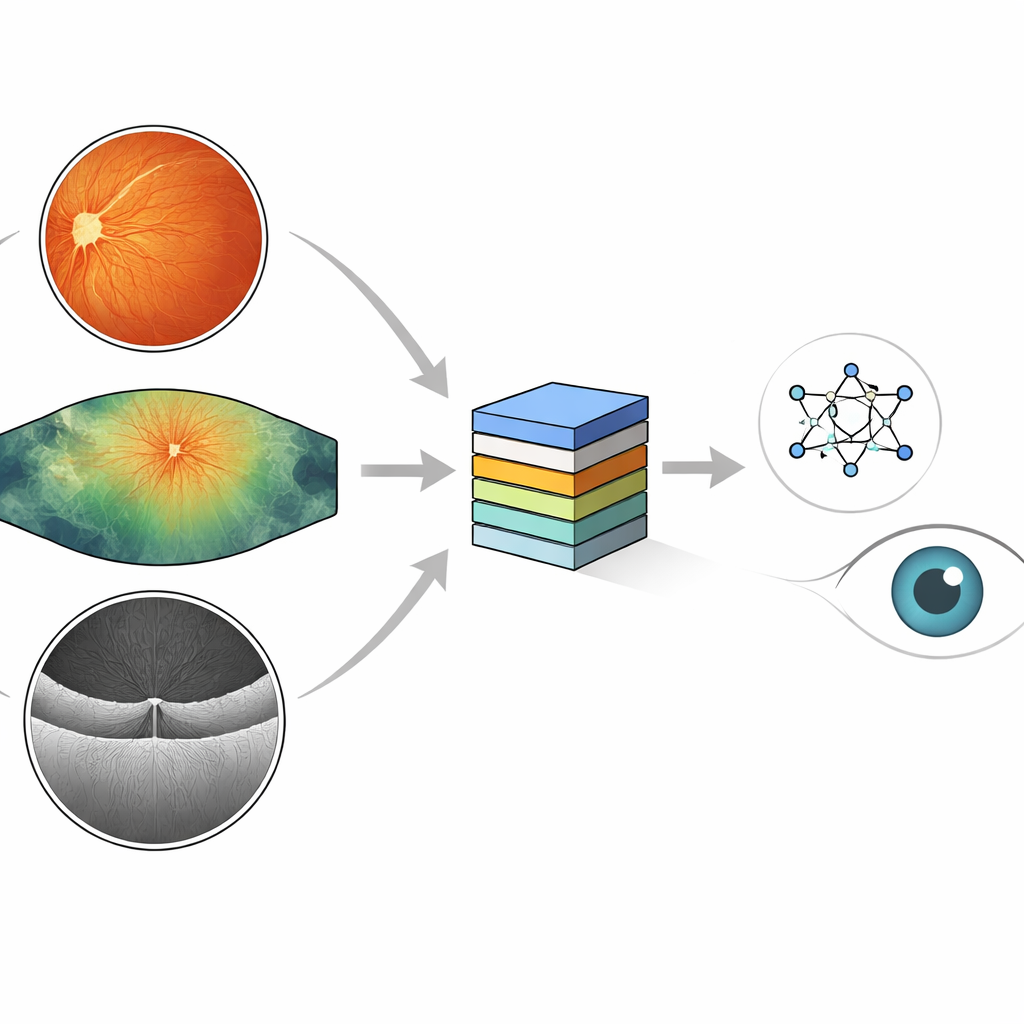

Olika kameravyer av samma ögonproblem

Ögonläkare använder flera typer av kameror för att leta efter diabetesrelaterade skador. Standardfärgfotografier av ögats bakre del visar en rund, rödaktig vy där små blödningar, fettutfällningar och nybildade sköra kärl kan synas. Ultra‑widefield-bilder fångar ett mycket större område, inklusive näthinnans ytterkanter där tidig skada kan gömma sig. Ett tredje verktyg, optisk koherenstomografi (OCT), skär genom näthinnan i tvärsnitt och avslöjar svullnad och vätskefickor kopplade till synhotande makulaödem. Varje metod visar olika delar av samma sjukdomsprocess, och tillsammans ger de en mer fullständig bild av ögonhälsan.

Vad som är nytt med denna bildsamling

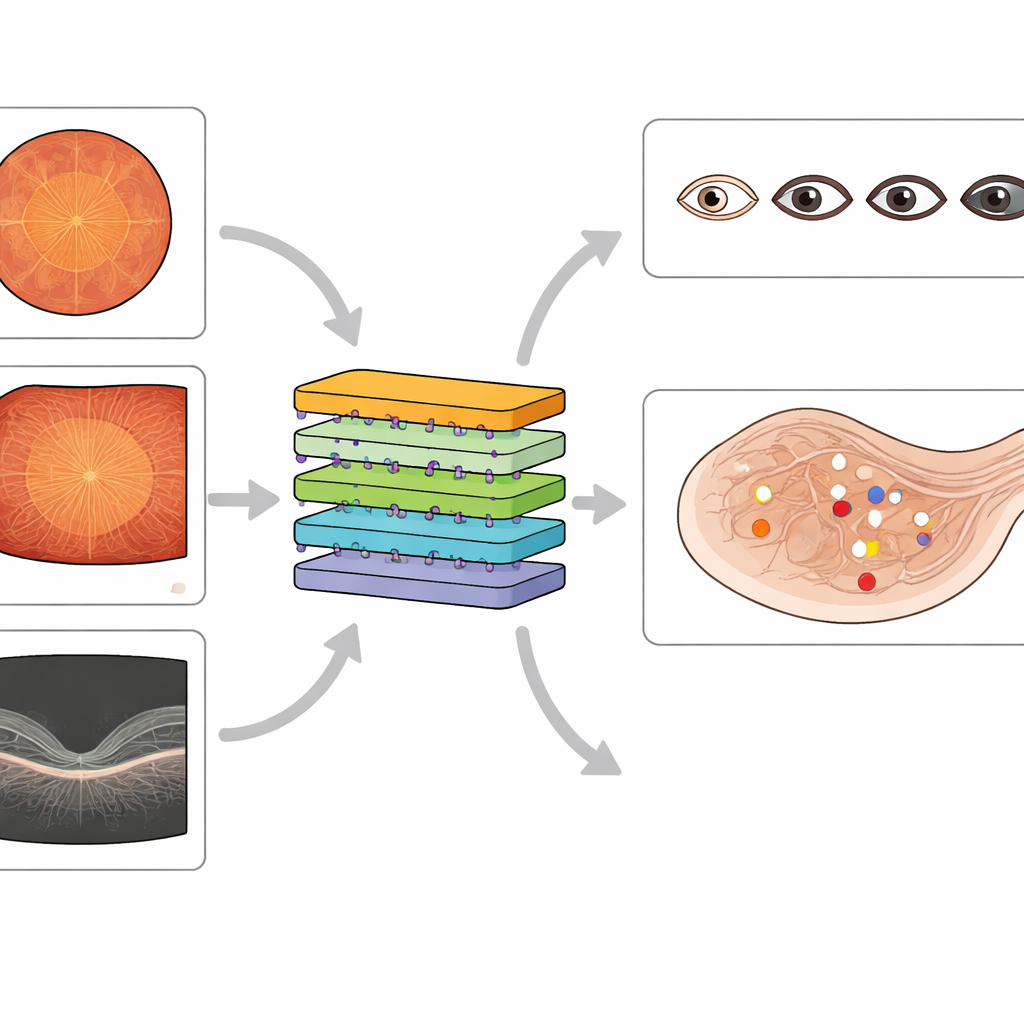

Befintliga offentliga dataset har drivit fram många AI-system för screening av diabetiska ögon, men de flesta fokuserar på endast en avbildningsmetod och erbjuder bara grova etiketter, såsom ett enda övergripande sjukdomsgrad. Vissa innehåller brusiga etiketter eller saknar viktiga lesionskategorier, och många täcker inte väl widefield-bilder eller ger detaljerad information om makulär svullnad. Det nya MMRDR-datasetet syftar till att fylla dessa luckor. Det samlar 24 460 bilder över tre modaliteter — standardfärgfoton, ultra‑widefield-bilder och OCT-skanningar — och kopplar rika expertannoteringar till dem. För färg- och widefield‑bilder graderade läkare den övergripande sjukdomen på en femstegs-skala och registrerade sju specifika lesionstyper, såsom små utbuktningar i blodkärl, blödningar och näthinnehöft. För OCT-skanningar beskrev de om makulaödem saknas, finns utanför centrum, eller direkt påverkar syncentrum.

Hur bilderna kuraterades och etiketterades

Författarna hämtade standardfärgfotografier från ett befintligt offentligt tävlingsdataset och erhöll widefield- och OCT‑bilder från ett stort ögonsjukhus i Kina, med fokus på personer med diabetes. De tog bort bilder av låg kvalitet med oskärpa, dålig belysning eller saknade centrala regioner för att säkerställa att återstående skanningar var kliniskt användbara. Fyra erfarna ögonläkare och en senior retina-specialist utvecklade tydliga graderingsregler baserade på internationella riktlinjer. Specialisten skapade först en referensuppsättning bilder, sedan övade de övriga graderarna på denna uppsättning tills deras bedömningar låg nära expertens. Därefter etiketterade de självständigt tusentals bilder och skickade osäkra fall tillbaka till specialisten. Den slutliga samlingen balanserar noggrann märkning med stark överensstämmelse mellan läkare, vilket gör den till en pålitlig undervisningsuppsättning för AI.

Test av dagens AI på morgondagens ögondata

Teamet använde därefter datasetet för att utvärdera flera typer av avancerade AI‑modeller. De testade stora visuella språkmodeller som ursprungligen tränats på allmänna bilder och text, standardbildklassificerare tränade på vardagsfotografier, och nyare "foundation"-modeller som redan finslipats på ögonbilder. Över lag hade modellerna störst svårigheter med ultra‑widefield‑bilder, där den mycket större vyn och mer komplexa mönster sänkte noggrannheten jämfört med standardfärgfotografier. Modeller speciellt designade för ögonbilder visade bättre överföringsförmåga från standard- till widefield‑vyer än generella multimodala system gjorde, vilket antyder att kunskap om nätthinnans struktur verkligen spelar roll. När forskarna finjusterade en stor multimodal modell på MMRDR förbättrades dess prestanda markant, vilket visar att detta dataset kan lära även mycket flexibla AI‑system att hantera ögonsjukdomar mer kompetent.

Vad detta betyder för framtidens ögonvård

Enkelt uttryckt levererar detta arbete ett högkvalitativt undervisningsbibliotek för datorer som lär sig känna igen diabetiska ögonskador. Genom att kombinera tre kompletterande avbildningsmetoder och detaljerade expertetiketter gör MMRDR‑datasetet det möjligt för forskare att bygga och rättvist jämföra AI‑verktyg som graderar sjukdomens svårighetsgrad, lokaliserar enskilda lesioner och övervakar makulär svullnad. Även om dessa bilder i sig inte kommer att bota blindhet, utgör de en avgörande grund för mer tillförlitliga automatiserade screeningsystem som kan upptäcka synhotande förändringar tidigare och göra expert‑nivå ögonvård tillgänglig för betydligt fler personer med diabetes.

Citering: Tang, Z., Wang, L., Guo, Z. et al. A multimodal retinal image dataset for diabetic retinopathy detection using foundation models. Sci Data 13, 639 (2026). https://doi.org/10.1038/s41597-026-07005-9

Nyckelord: diabetisk retinopati, näthinneavbildning, medicinsk AI, foundation-modeller, okulär OCT