Clear Sky Science · de

Ein multimodaler Netzhaut‑Bilddatensatz zur Erkennung diabetischer Retinopathie mit Foundation‑Modellen

Warum es wichtig ist, Augenschäden früh zu erkennen

Bei Menschen mit Diabetes kann das lichtempfindliche Gewebe im hinteren Teil des Auges über Jahre stillschweigend geschädigt werden, bevor das Sehen spürbar trübt. Wenn Symptome auftreten, sind manche Schäden bereits dauerhaft. Ärztinnen und Ärzte wissen, dass regelmäßige Augenuntersuchungen Probleme früh aufspüren können, doch Tausende von Bildern von Hand zu lesen ist langsam und teuer. Diese Studie stellt eine große, sorgfältig annotierte Sammlung von Netzhautbildern vor, die KI‑Systemen helfen soll, diabetic‑bedingte Augenerkrankungen genauer und verlässlicher zu erkennen und so deutlich mehr Patientinnen und Patienten früher zu warnen.

Verschiedene Kameraperspektiven des gleichen Augenproblems

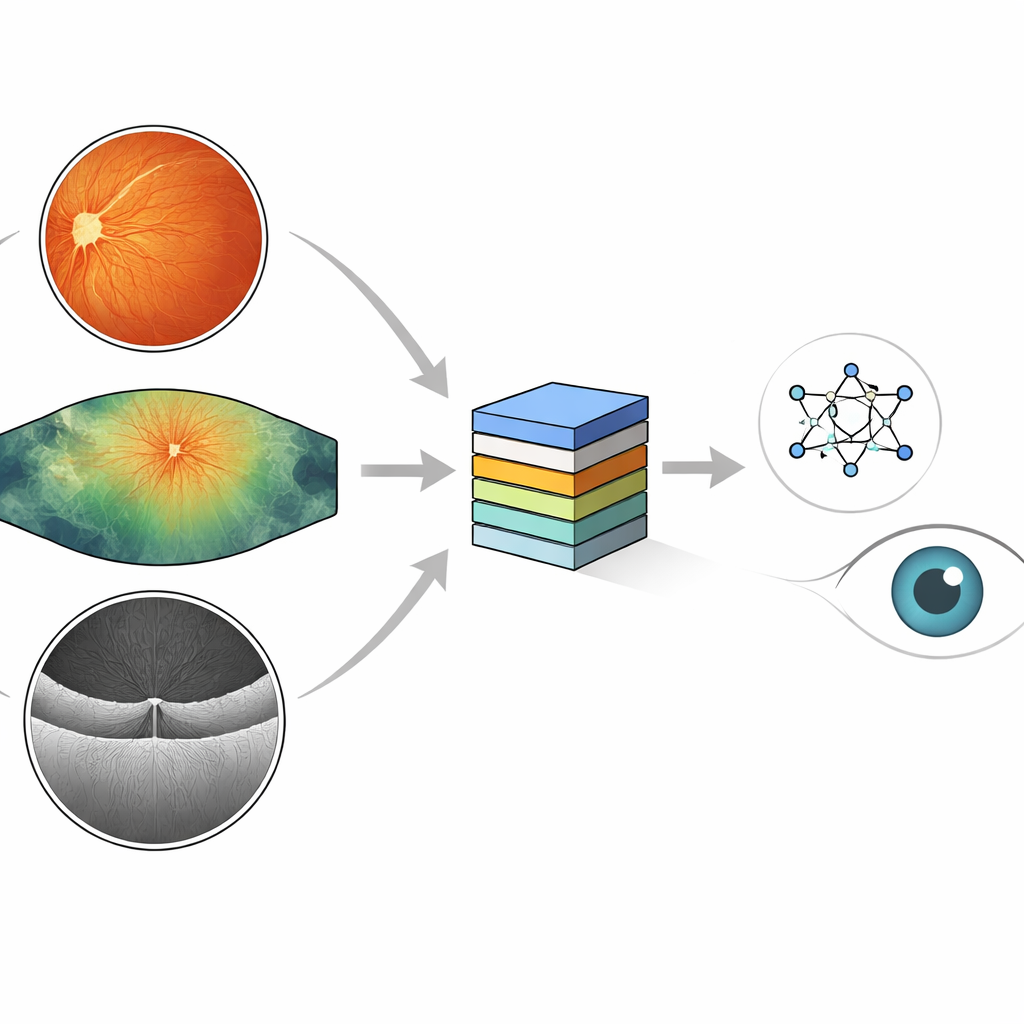

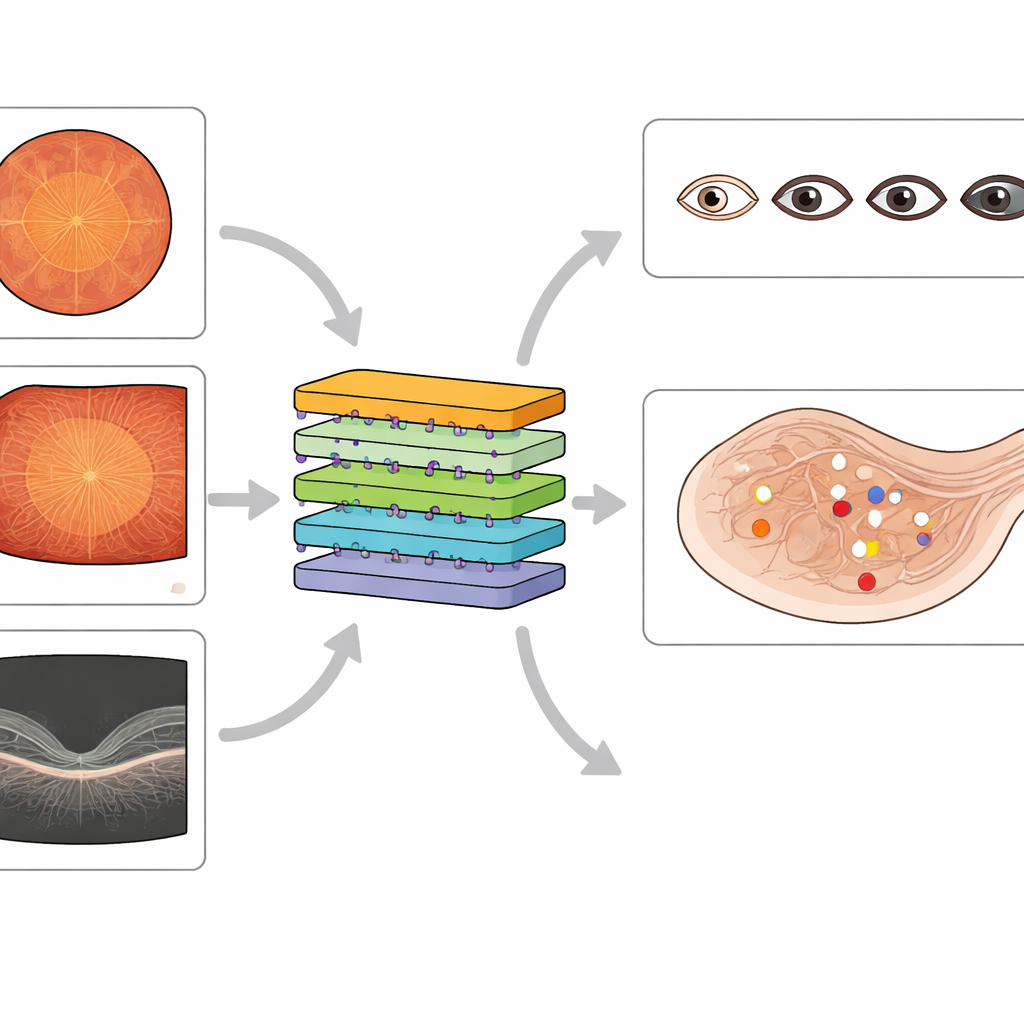

Augenärztinnen und -ärzte nutzen mehrere Kameratypen, um diabetesbedingte Schäden zu suchen. Standardfarbfotografien des Augenhintergrunds zeigen eine runde, rötliche Ansicht, in der winzige Blutpunkte, fettige Ablagerungen und neue fragile Gefäße sichtbar werden können. Ultra‑Widefield‑Aufnahmen erfassen ein viel größeres Gebiet, einschließlich der äußeren Netzhautbereiche, wo frühe Schäden verborgen sein können. Ein drittes Instrument, die optische Kohärenztomographie (OCT), schneidet die Netzhaut in Querschnitten auf und zeigt Schwellungen und Flüssigkeitsansammlungen, die mit sehbedrohlichem Makulaödem verbunden sind. Jede Methode liefert unterschiedliche Teile desselben Krankheitsprozesses, und zusammen ergeben sie ein vollständigeres Bild der Augengesundheit.

Was an dieser Bildersammlung neu ist

Bestehende öffentliche Datensätze haben viele KI‑Systeme für das Screening auf diabetische Augenerkrankungen ermöglicht, konzentrieren sich aber meist nur auf eine Bildgebungsmodalität und liefern lediglich grobe Labels, etwa eine einzige Gesamtgradierung der Krankheit. Manche Datensätze enthalten verrauschte Labels oder fehlen wichtige Läsionstypen, und viele decken Ultra‑Widefield‑Bilder oder detaillierte Informationen zum makulären Schwellungsgeschehen nur unzureichend ab. Der neue MMRDR‑Datensatz will diese Lücken schließen. Er versammelt 24.460 Bilder in drei Modalitäten — Standardfarbfotos, Ultra‑Widefield‑Bilder und OCT‑Scans — und versieht sie mit umfangreichen Expertenannotationen. Für Farb‑ und Widefield‑Bilder benoteten Ärztinnen und Ärzte die Gesamtkrankheit auf einer fünfstufigen Skala und dokumentierten sieben spezifische Läsionstypen, etwa feine Ausbeulungen in Blutgefäßen, Blutungen und Netzhautablösungen. Bei OCT‑Scans beschrieben sie, ob ein Makulaödem fehlt, außerhalb des Zentrums vorkommt oder das Zentrum des Sehens direkt beeinflusst.

Wie die Bilder kuratiert und etikettiert wurden

Die Autorinnen und Autoren entnahmen Standardfarbfotografien aus einem bestehenden öffentlichen Wettkampfdatensatz und erhielten Widefield‑ und OCT‑Bilder aus einem großen chinesischen Augenkrankenhaus, mit Schwerpunkt auf Menschen mit Diabetes. Sie entfernten Bilder von geringer Qualität mit Unschärfe, schlechter Beleuchtung oder fehlenden zentralen Bereichen, um sicherzustellen, dass die verbleibenden Aufnahmen klinisch nützlich sind. Vier erfahrene Augenärztinnen/-ärzte und ein leitender Netzhautspezialist entwickelten klare Bewertungsregeln auf Basis internationaler Leitlinien. Der Spezialist erstellte zunächst einen Referenzsatz von Bildern; die anderen Gutachter übten mit diesem Satz, bis ihre Entscheidungen eng mit denen des Experten übereinstimmten. Danach etikettierten sie unabhängig mehrere tausend Bilder und schickten unsichere Fälle zurück an den Spezialisten. Die endgültige Sammlung vereint gründliche Labelvergabe mit hoher Übereinstimmung zwischen den Ärzten und ist damit ein vertrauenswürdiger Lehrdatensatz für KI.

Die heutige KI an künftigen Augendaten getestet

Das Team nutzte den Datensatz anschließend, um verschiedene Arten fortgeschrittener KI‑Modelle zu bewerten. Getestet wurden große Vision‑Language‑Modelle, die ursprünglich auf allgemeinen Bildern und Texten trainiert wurden, Standard‑Bildklassifikatoren, die auf Alltagsfotografien trainiert sind, und neuere „Foundation“‑Modelle, die bereits auf Augenbildern feinjustiert wurden. Generell hatten die Modelle bei Ultra‑Widefield‑Bildern die größten Schwierigkeiten: Die deutlich größere Sicht und die komplexeren Muster verringerten die Genauigkeit im Vergleich zu Standardfarbfotos. Für Augenbilder entwickelte Modelle zeigten eine bessere Übertragbarkeit von Standard‑ zu Widefield‑Ansichten als allgemeine multimodale Systeme, was darauf hindeutet, dass Wissen über die Netzhautstruktur wirklich wichtig ist. Als die Forschenden ein großes multimodales Modell mit MMRDR feinjustierten, verbesserte sich seine Leistung deutlich — ein Hinweis darauf, dass dieser Datensatz selbst sehr flexible KI‑Systeme darin schulen kann, mit Augenerkrankungen kompetenter umzugehen.

Was das für die zukünftige Augenversorgung bedeutet

Kurz gesagt liefert diese Arbeit eine hochwertige Lehrbibliothek für Computer, die lernen, diabetische Augenschäden zu erkennen. Durch die Kombination dreier sich ergänzender Bildgebungs‑methoden und detaillierter Expertenlabels ermöglicht der MMRDR‑Datensatz Forschenden, KI‑Werkzeuge zu entwickeln und fair zu vergleichen, die Krankheitsschwere einstufen, einzelne Läsionen lokalisieren und makuläre Schwellungen verfolgen. Auch wenn diese Bilder allein Blindheit nicht heilen, bilden sie eine zentrale Grundlage für zuverlässigere automatisierte Screening‑Systeme, die sehbedrohende Veränderungen früher erkennen und fachärztliche Augenversorgung für deutlich mehr Menschen mit Diabetes zugänglich machen könnten.

Zitation: Tang, Z., Wang, L., Guo, Z. et al. A multimodal retinal image dataset for diabetic retinopathy detection using foundation models. Sci Data 13, 639 (2026). https://doi.org/10.1038/s41597-026-07005-9

Schlüsselwörter: diabetische Retinopathie, Netzhaut‑Bildgebung, medizinische KI, Foundation‑Modelle, okuläre OCT