Clear Sky Science · sv

ULTRA-MoCap: Ett multimodalt IMU- och sEMG-dataset för analys av ledkinematik i överkroppens extremitet

Varför det är viktigt att spåra vardagliga armrörelser

Varje gång du sträcker dig efter en hylla, svänger armarna när du går eller lyfter en väska, utför axel, armbåge och handled en noggrant samordnad rörelse. Att förstå denna rörelse i detalj kan förändra fysioterapi, idrottsträning och hur vi styr assistiva robotar eller exoskelett. Ändå kommer de flesta befintliga data om armrörelser antingen från otympliga kamerasystem i specialiserade laboratorier eller från bärbara enheter som bara fångar en del av vad kroppen gör. Denna artikel introducerar ULTRA-MoCap, ett nytt öppet dataset som förenar dessa delar genom att kombinera motion-capture-kameror, små rörelsesensorer och muskelaktivitetsinspelningar för att ge en rikare bild av hur överextremiteten rör sig.

Att förena flera sensorsfärer

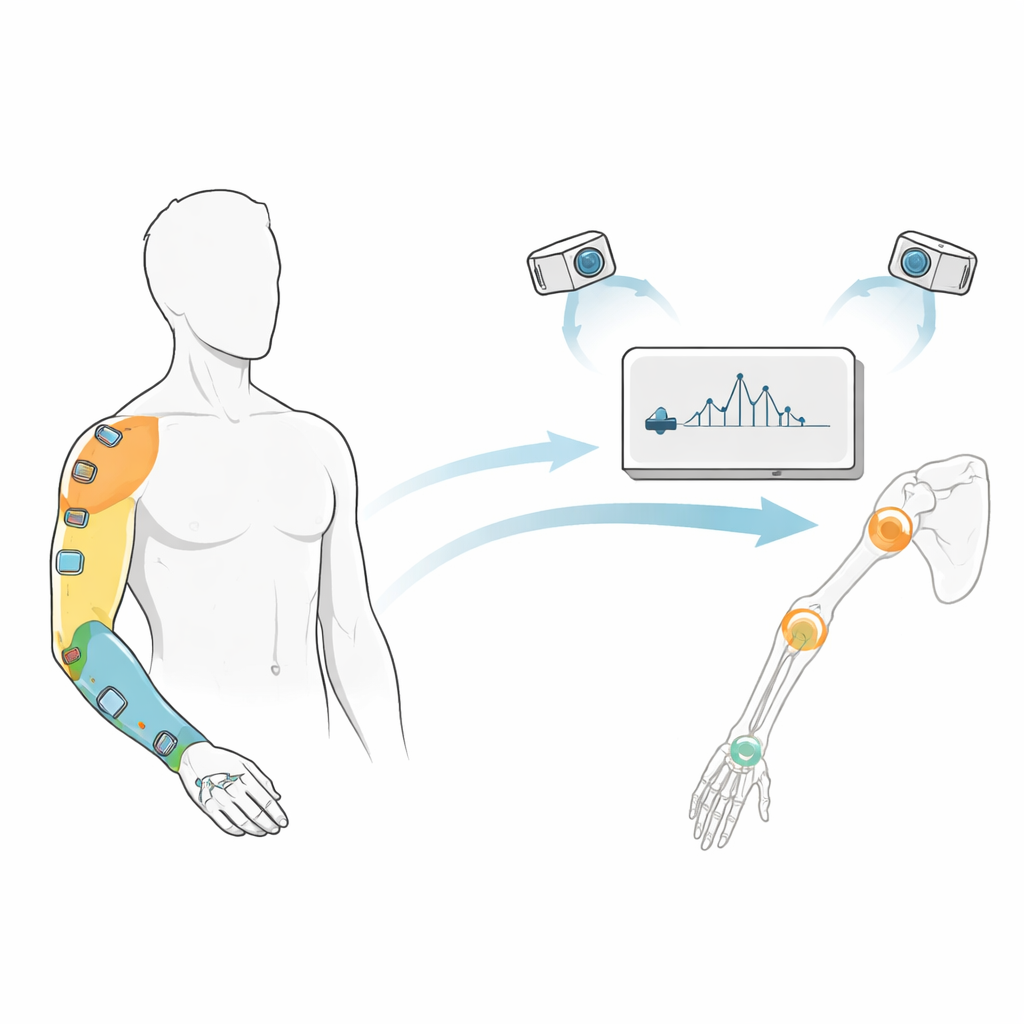

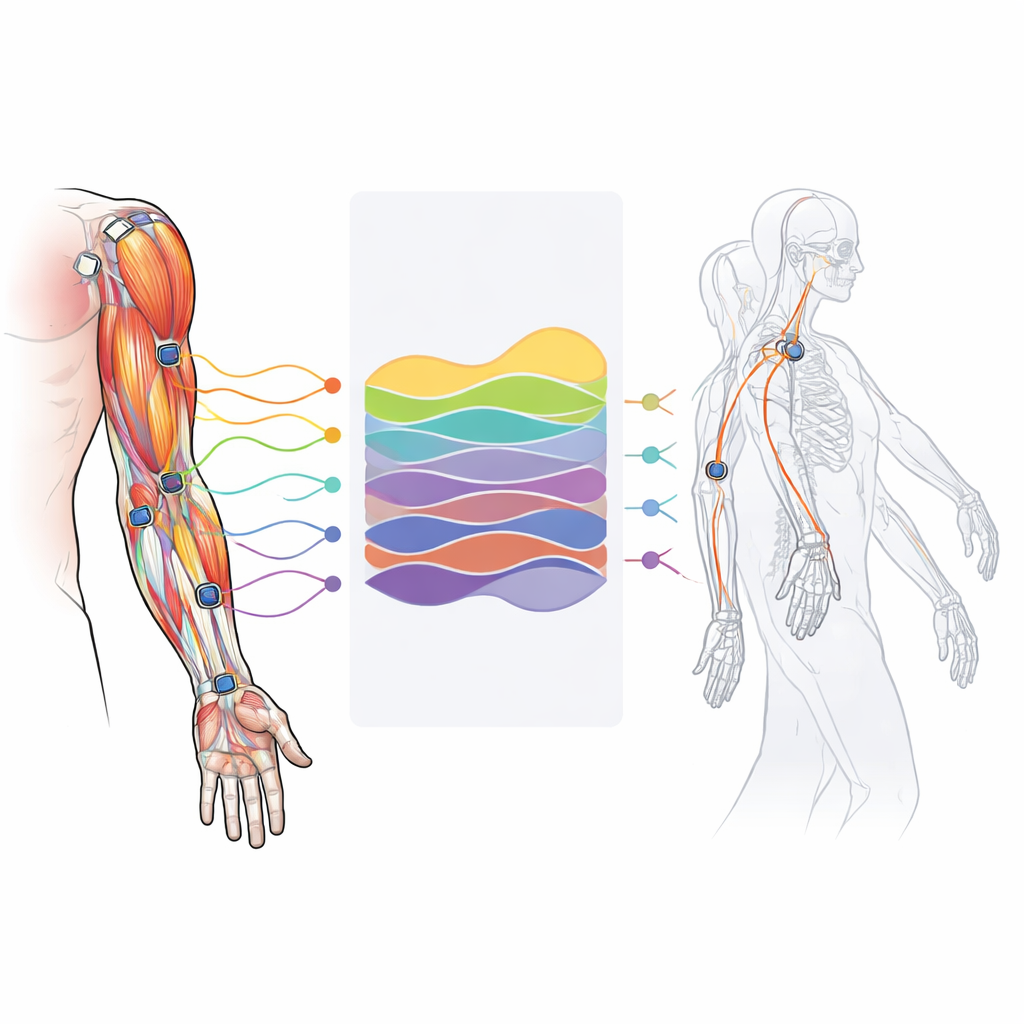

De flesta studier av armrörelser förlitar sig på endast ett fönster in i kroppen: antingen hur leder rör sig, hur muskler aktiveras eller hur lemmens rörelse accelererar i rummet. ULTRA-MoCap utmärker sig genom att spela in alla tre samtidigt. Det synkroniserar ett högkvalitativt kamera-baserat motion-capture-system med sex små inertiala mätenheter (IMU:er) som spårar rörelse på hand, handled, underarm och överarm, plus ytelektromyografi (sEMG)-sensorer som mäter elektrisk aktivitet i nyckelmuskler som biceps, triceps och deltoideus. Denna kombination gör det möjligt för forskare att se hur muskelaktivitet, lemmens rörelse och ledvinklar stämmer överens i tiden och ger ett detaljerat, dynamiskt porträtt av rörelser i överkroppen.

Hur data samlades in från verkliga personer

Datasetet bygger på experiment med tretton friska vuxna, var och en noggrant screenad för att undvika befintliga arm- eller axelskador. Deltagarna bar sextio reflexmarkörer för motion capture och sex trådlösa sensorenheter på höger arm. De utförde fem vanliga övre extremitetsövningar: att svänga båda armarna, nå över kroppen, upprepat böja och sträcka armbågarna, rotera axlarna och höja armarna över huvudet till olika höjder. Varje försök varade i trettio sekunder i självvald hastighet, från långsamt till mycket snabbt, med vilopauser för att undvika utmattning som kunde förvränga muskelsignalerna. Resultatet är en stor variation av rörelser som ändå följer tydliga, repeterbara mönster, mycket likt naturliga dagliga aktiviteter.

Från råa markörer till virtuella leder

För att omvandla moln av kameramarkörer till meningsfulla ledvinklar använde författarna en detaljerad datormodell av överkroppen som representerar ben och leder ungefär som ett virtuellt skelett. De skalade först denna modell för att passa varje persons kroppsmått med en kalibreringspose och körde sedan en invers kinematikprocess som hittar de ledpositioner och vinklar som bäst stämmer överens med de observerade markörbanorna vid varje ögonblick. Noggranna kvalitetskontroller säkerställde att de virtuella markörerna höll sig inom några centimeter från de verkliga och att de beräknade rörelserna i axel, armbåge och handled såg anatomiskt rimliga ut över tusentals bildrutor. Det slutliga datasetet innehåller både dessa bearbetade ledvinklar och de ursprungliga sensor- och markörinspelningarna, allt organiserat med konsekventa filnamn och format så att andra enkelt kan återanvända dem.

Test av datakvalitet med maskininlärning

För att visa att signalerna inte bara är rena utan också informativa tränade författarna en djupinlärningsmodell för att känna igen vilken av de fem övningarna som utfördes, baserat enbart på korta tvåsekundersbitar av sensordata. Med enbart IMU-rörelsedata identifierade modellen övningen korrekt mer än 94 procent av gångerna, och prestationen steg något när IMU- och muskelsignaler kombinerades. Muskeldata ensamma visade sig vara svårare att generalisera över olika personer, vilket speglar naturlig variation i hur individer rekryterar sina muskler, men fungerade mycket väl när modellen personaliserades för en enskild person. Dessa resultat tyder på att ULTRA-MoCap lämpar sig både för allmänna algoritmer som måste fungera på nya användare och för personaliserade system som anpassar sig till en individ.

Vad denna resurs betyder för framtiden

I vardagliga termer är ULTRA-MoCap som att ha en rikt instrumenterad "black box recorder" för armen som fångar hur ben, muskler och bärbara sensorer beter sig tillsammans under realistiska rörelser. Eftersom datasetet och stödjande kod är offentligt tillgängliga kan forskare använda det för att utforma smartare rehabiliteringsövningar, förbättra styrningen av robotiska exoskelett, förfina interaktioner i virtuell verklighet eller undersöka hur man kan åstadkomma mer med färre eller enklare sensorer. Studien slutsats är att denna flerskiktade vy av överextremitetsrörelser fyller en viktig lucka i befintliga resurser och bör påskynda framsteg mot bärbar teknik som förstår och hjälper våra armrörelser på ett naturligt och intuitivt sätt.

Citering: Fritsche, O., Camacho, S., Hossain, M.S.B. et al. ULTRA-MoCap: A Multimodal IMU and sEMG Dataset for Upper Body Joint Kinematics Analysis. Sci Data 13, 622 (2026). https://doi.org/10.1038/s41597-026-06687-5

Nyckelord: rörelser i övre extremiteten, bärbara sensorer, elektromyografi, motion capture-dataset, rehabiliteringsteknik