Clear Sky Science · es

ULTRA-MoCap: Un conjunto de datos multimodal de IMU y sEMG para el análisis de la cinematica de las articulaciones del tren superior

Por qué importa rastrear los movimientos cotidianos del brazo

Cada vez que alcanzas una estantería, balanceas los brazos al caminar o levantas una bolsa, el hombro, el codo y la muñeca ejecutan una coreografía coordinada con precisión. Entender ese movimiento en detalle podría transformar la rehabilitación física, el entrenamiento deportivo y el control de robots asistenciales o exoesqueletos. Sin embargo, la mayor parte de los datos existentes sobre el movimiento del brazo proviene de montajes voluminosos de cámaras en laboratorios especializados o de dispositivos vestibles que capturan solo una parte de lo que hace el cuerpo. Este artículo presenta ULTRA-MoCap, un nuevo conjunto de datos abierto que reúne estas piezas: combina sistemas de captura de movimiento por cámaras, pequeños sensores de movimiento y registros de actividad muscular para ofrecer una imagen más completa de cómo se mueve el miembro superior.

Uniendo múltiples mundos de sensado

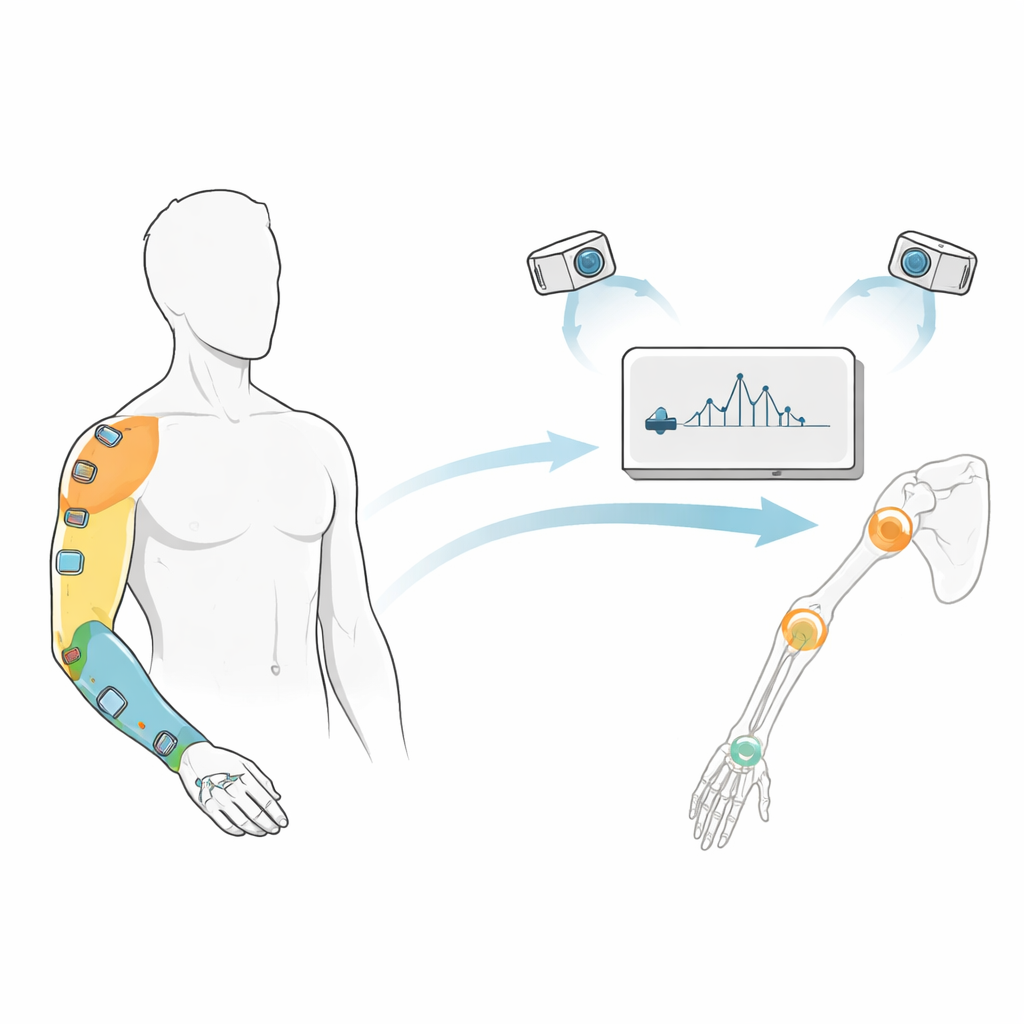

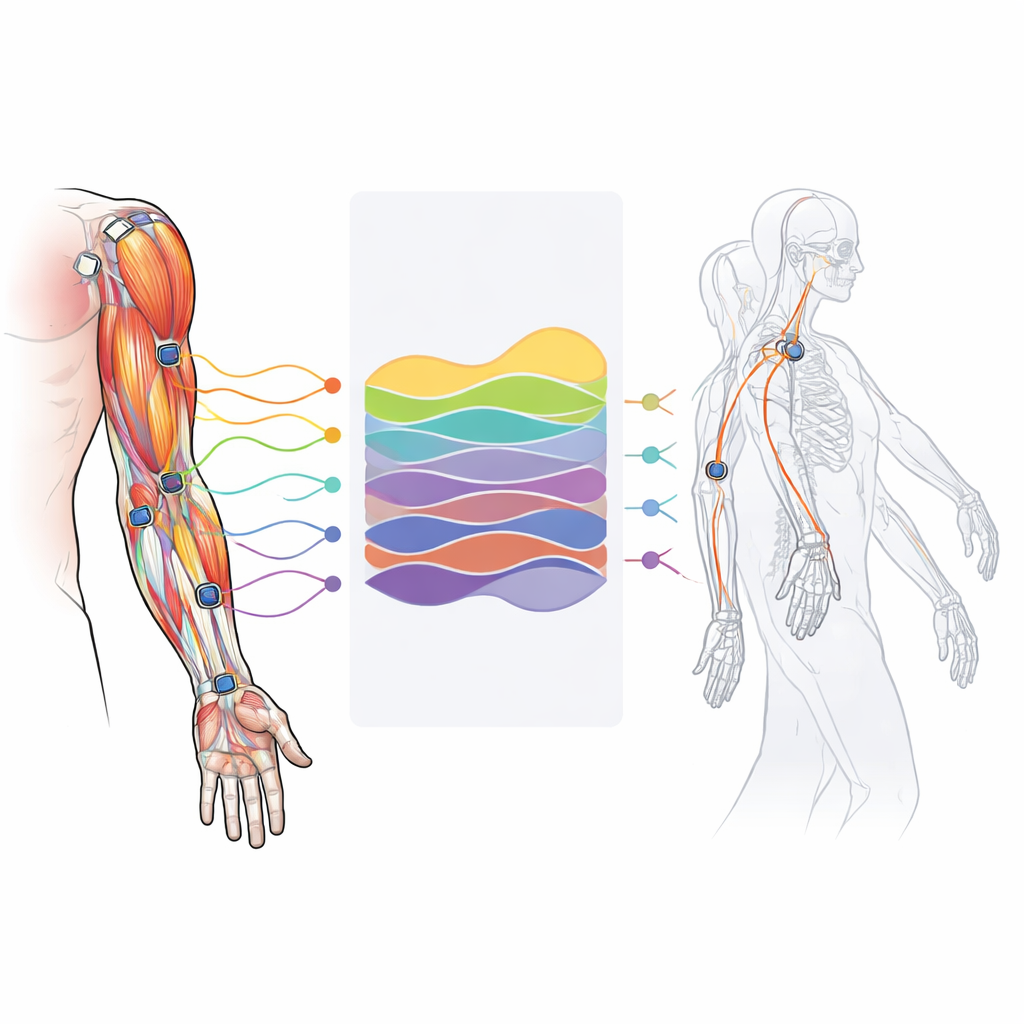

La mayoría de los estudios sobre el movimiento del brazo se basan en una sola ventana al cuerpo: bien en cómo se mueven las articulaciones, bien en cómo se activan los músculos, o bien en cómo se acelera el miembro en el espacio. ULTRA-MoCap destaca por registrar las tres cosas a la vez. Sincroniza un sistema de captura de movimiento por cámara de alta gama con seis pequeñas unidades de medida inercial (IMU) que siguen el movimiento en la mano, la muñeca, el antebrazo y el brazo superior, además de sensores de electromiografía de superficie (sEMG) que miden la actividad eléctrica en músculos clave como el bíceps, el tríceps y el deltoides. Esta combinación permite a los investigadores ver cómo la actividad muscular, el movimiento del miembro y los ángulos articulares coinciden en el tiempo, ofreciendo un retrato dinámico y detallado del movimiento del torso superior.

Cómo se recogieron los datos de personas reales

El conjunto de datos se construyó a partir de experimentos con trece adultos sanos, seleccionados cuidadosamente para evitar lesiones previas en el brazo o el hombro. Los participantes llevaron sesenta marcadores reflectantes para la captura de movimiento y seis unidades de sensores inalámbricos en su brazo derecho. Realizaron cinco ejercicios comunes de miembro superior: balanceo de ambos brazos, alcance cruzando el cuerpo, flexión y extensión repetida de los codos, rotaciones de hombro y elevaciones del brazo por encima de la cabeza a diferentes alturas. Cada ensayo duró treinta segundos a velocidades autoelegidas que iban de lento a muy rápido, con pausas de descanso para evitar la fatiga que pudiera distorsionar las señales musculares. El resultado es una amplia variedad de movimientos que siguen patrones claros y repetibles, similares a las actividades cotidianas naturales.

De marcadores crudos a articulaciones virtuales

Para transformar las nubes de marcadores de cámara en ángulos articulares significativos, los autores emplearon un modelo informático detallado del tronco superior que representa huesos y articulaciones como un esqueleto virtual. Primero "escalaron" este modelo para ajustarlo a las dimensiones corporales de cada persona usando una pose de calibración, y luego aplicaron un proceso de cinemática inversa que encuentra las posiciones y ángulos articulares más consistentes con las trayectorias observadas de los marcadores en cada instante. Controles de calidad minuciosos garantizaron que los marcadores virtuales permanecieran a pocos centímetros de los reales y que los movimientos calculados de hombro, codo y muñeca tuvieran sentido anatómico a lo largo de miles de fotogramas. El conjunto de datos final incluye tanto estos ángulos articulares procesados como las grabaciones originales de sensores y marcadores, todo organizado con nombres de archivo y formatos coherentes para que otros puedan reutilizarlo con facilidad.

Evaluación de la calidad de los datos con aprendizaje automático

Para demostrar que las señales no solo están limpias sino que también son informativas, los autores entrenaron un modelo de aprendizaje profundo para reconocer cuál de los cinco ejercicios se estaba realizando, basándose únicamente en cortes cortos de dos segundos de datos de los sensores. Usando solo los datos de movimiento de las IMU, el modelo identificó correctamente el ejercicio en más del 94 por ciento de los casos, y el rendimiento subió ligeramente cuando se combinaron las señales de IMU y musculares. Los datos musculares por sí solos resultaron más difíciles de generalizar entre distintas personas, lo que refleja la variación natural en cómo los individuos reclutan sus músculos, pero funcionaron extremadamente bien cuando el modelo se personalizó para un solo sujeto. Estos resultados sugieren que ULTRA-MoCap es adecuado tanto para algoritmos de propósito general que deben funcionar con usuarios nuevos como para sistemas personalizados que se adaptan a un individuo.

Qué supone este recurso para el futuro

En términos cotidianos, ULTRA-MoCap es como tener una "caja negra" ricamente instrumentada para el brazo, que captura cómo se comportan huesos, músculos y sensores vestibles juntos durante movimientos realistas. Dado que el conjunto de datos y el código de soporte están disponibles públicamente, los investigadores pueden usarlos para diseñar ejercicios de rehabilitación más inteligentes, mejorar el control de exoesqueletos robóticos, refinar las interacciones de realidad virtual o explorar cómo lograr más con sensores menos numerosos o más simples. El estudio concluye que esta visión multinivel del movimiento del miembro superior llena una laguna clave en los recursos existentes y debería acelerar el progreso hacia tecnologías vestibles que comprendan y asistan nuestros movimientos de brazo de forma natural e intuitiva.

Cita: Fritsche, O., Camacho, S., Hossain, M.S.B. et al. ULTRA-MoCap: A Multimodal IMU and sEMG Dataset for Upper Body Joint Kinematics Analysis. Sci Data 13, 622 (2026). https://doi.org/10.1038/s41597-026-06687-5

Palabras clave: movimiento del miembro superior, sensores vestibles, electromiografía, conjunto de datos de captura de movimiento, tecnología de rehabilitación