Clear Sky Science · sv

Multimodal jonstyrd transistor baserad på 2D superjonledare för in-memory-beräkning i djupinlärning

Smartare kretsar inspirerade av hjärnan

Modern artificiell intelligens gör underverk men förbrukar mycket energi, främst eftersom dagens kretsar ständigt flyttar data fram och tillbaka mellan minne och processor. Denna artikel beskriver en ny typ av tiny elektronisk komponent som beter sig mer som en hjärncellskoppling, en synaps. Genom att utföra både beräkning och signalformning på samma ställe kan dessa enheter göra framtida AI-hårdvara snabbare och mycket mer energieffektiv, vilket potentiellt gynnar allt från smartphones till sensorer vid kanten i bilar och medicinska bärbara enheter.

Varför dagens AI-hårdvara slösar energi

De flesta AI-algoritmer bygger på två grundläggande steg: multiplicera och addera tal för att kombinera signaler, och sedan låta resultatet passera genom ett böjt “aktiverings”-steg som avgör vilka mönster som är viktiga. Konventionella kretsar utför dessa steg i separata block. Data måste omvandlas mellan digitala och analoga former och flyttas upprepade gånger över chipet, vilket kostar tid och energi. Ingenjörer vill ha en enskild fysisk komponent som både kan lagra styrkan i en koppling och samtidigt applicera aktiveringslik icke-linearitet, men typiska elektroniska komponenter klarar oftast bara en av dessa uppgifter väl. När de pressas att göra båda blir de ofta instabila eller oprecisa.

En ny slags transistorkomponent

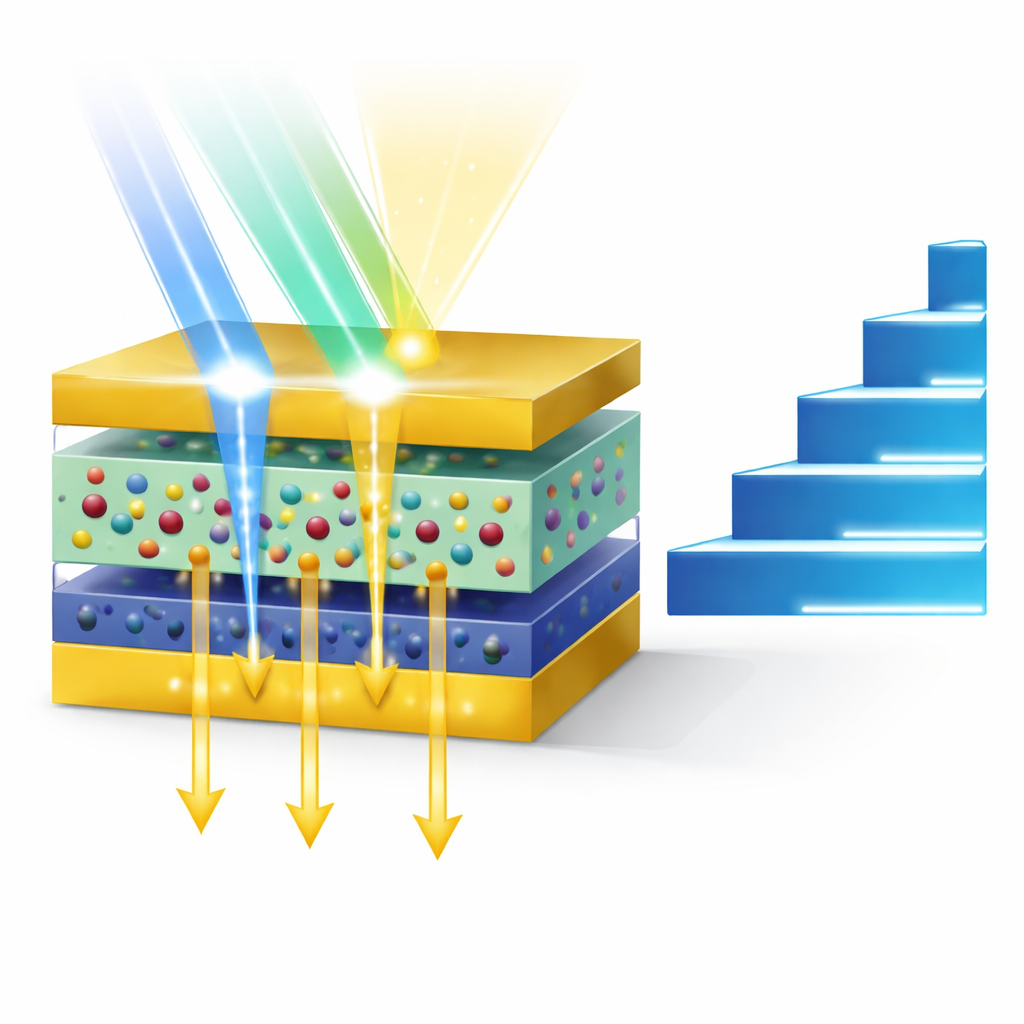

Författarna introducerar en transistor byggd av ultratunna skiktade kristaller som löser denna gåta på ett överraskande sätt. Enheten använder ett tvådimensionellt material kallat CdPS3-Li som ett speciellt jonledande lager, staplat med ett annat tvådimensionellt halvledarmaterial, MoS2, som leder elektrisk ström. CdPS3-Li-lagret innehåller litiumjoner som lätt kan förflytta sig i vissa riktningar men inte i andra, och det har också tomma platser (vakans) som kan fånga laddning. När en elektrisk puls appliceras driver litiumjonerna mot gränsytan mot MoS2-lagret och stannar där, vilket starkt förändrar hur väl enheten leder. När ljus istället belyser enheten dras laddningar som skapas i MoS2-lagret in i dessa vakansplatser, vilket ger upphov till rika tidsberoende responser.

Att förvandla ljus och elektricitet till hjärnliknande signaler

Tack vare denna konstruktion kan samma transistor naturligt stödja två mycket olika men kompletterande beteenden. Under elektriska pulser erbjuder den många stabila resistansnivåer som förändras jämnt och förutsägbart och fungerar som justerbara vikter i ett neuralt nätverk. Dessa nivåer är icke-volatila, vilket betyder att de kvarstår även efter att pulsen upphört, och enheten kan pålitligt stega igenom flera dussin distinkta tillstånd utan att slitas ut. Under ljuspulser stiger däremot strömmen och avklingar på ett böjt sätt som kan passa väl med matematiska funktioner som ofta används som aktiveringskurvor i djupinlärning. Genom att justera styrka, varaktighet och antal ljuspulser kan forskarna forma hur snabbt responsen avklingar och därigenom i praktiken “programmera” olika aktiveringsprofiler i hårdvaran.

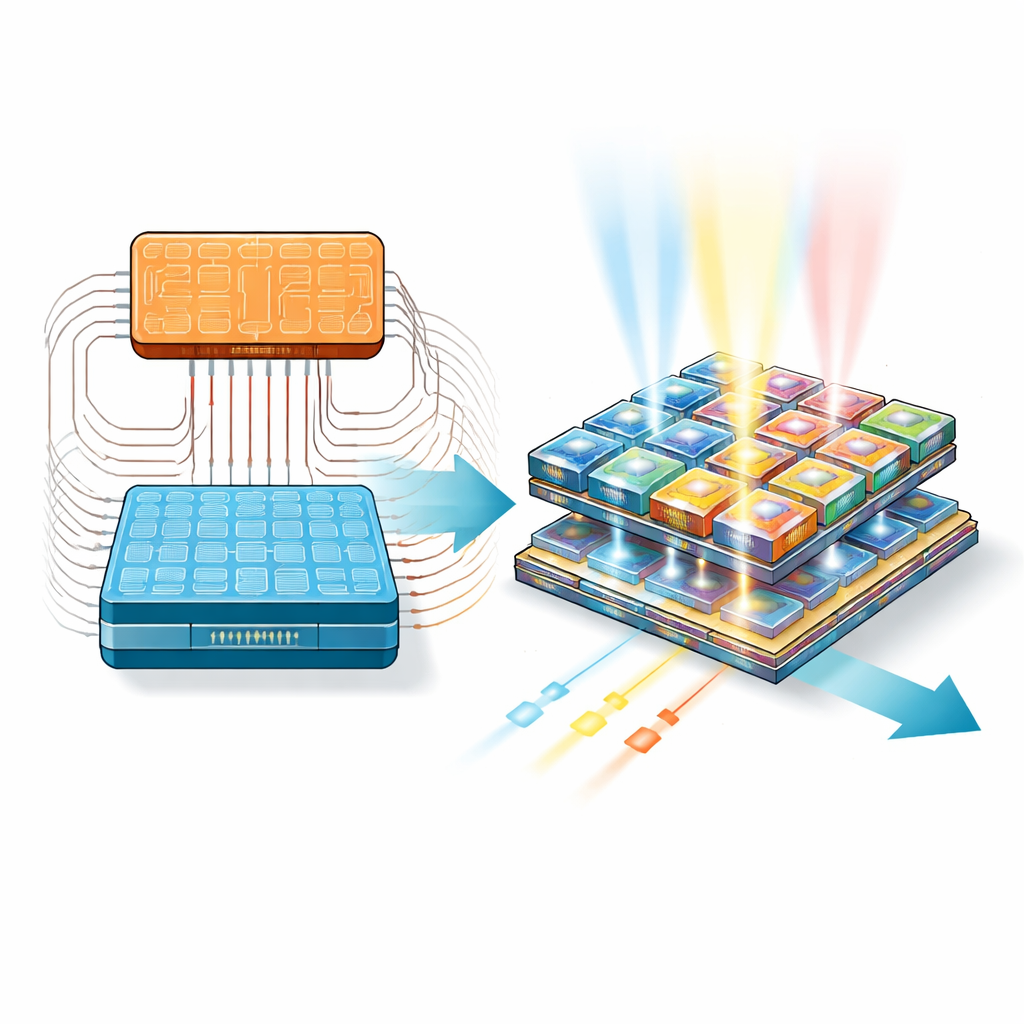

Från enskilda enheter till fungerande AI-arrayer

För att visa att detta är mer än en laboratoriekuriosa byggde teamet arrayer av dessa transistorer och kopplade dem för att köra delar av ett verkligt neuralt nätverk. En array utför multiplicera-och-ackumulera-steget: den lagrade resistansen i varje enhet representerar en vikt, och genom att applicera spänningar över ett rutnät summerar strömmarna naturligt enligt kretsfysikens regler. En andra, mindre array exponeras för noggrant tidsbestämda ljuspulser så att dess avklingande strömmar implementerar aktiveringssteget. Genom att samordna dessa två moduler med konventionell styrelektronik tränade forskarna ett nätverk för att känna igen handskrivna siffror och nådde en noggrannhet över 97 procent—jämförbar med rent digitala system, men uppnådd med komponenter som inneboende kombinerar minne och beräkning.

Vad detta betyder för vardagsteknik

För en icke-specialist är huvudbudskapet att dessa nya jonbaserade, ljuskänsliga transistorer beter sig mycket mer som biologiska synapser än traditionella kiselbrytare. De kan komma ihåg kopplingsstyrkor, reagera olika på elektriska respektive optiska signaler och göra detta med extremt låg energiförbrukning per operation. Även om de inte är redo att ersätta kretsarna i din telefon imorgon pekar de mot en framtid där AI-hårdvara är tätare, mer energieffektiv och mer hjärnlik. Sådana framsteg skulle så småningom kunna möjliggöra kraftfulla inlärningssystem som får plats i små batteridrivna enheter och föra smartare sensning och beslutsfattande närmare där data genereras.

Citering: Tong, B., Du, T., Du, J. et al. Multimodal ion-gated transistor based on 2D superionic conductor for in-memory computing in deep learning. Nat Commun 17, 4127 (2026). https://doi.org/10.1038/s41467-026-70587-w

Nyckelord: neuromorf databehandling, in-memory-beräkning, jonstyrd transistor, 2D-material, hårdvara för djupinlärning