Clear Sky Science · it

Transistor ionico multimodale basato su conduttore superionico 2D per il calcolo in memoria nel deep learning

Chip più intelligenti ispirati al cervello

L’intelligenza artificiale moderna compie imprese notevoli ma consuma molta energia, in gran parte perché i chip attuali trasferiscono continuamente dati avanti e indietro tra memoria e processori. Questo articolo descrive un nuovo tipo di dispositivo elettronico miniaturizzato che si comporta in modo più simile a una connessione tra cellule cerebrali, o sinapsi. Gestendo sia il calcolo sia la modulazione del segnale nello stesso punto, questi dispositivi potrebbero rendere l’hardware AI futuro più veloce e molto più efficiente dal punto di vista energetico, con benefici potenziali che vanno dagli smartphone ai sensori edge nelle auto e ai dispositivi medicali indossabili.

Perché l’hardware AI attuale spreca risorse

La maggior parte degli algoritmi di IA si basa su due passaggi fondamentali: moltiplicare e sommare numeri per combinare segnali, e poi passare il risultato attraverso uno stadio curvo di “attivazione” che decide quali pattern sono rilevanti. I chip convenzionali eseguono questi passaggi in blocchi separati. I dati devono essere convertiti tra forma digitale e analogica e spostati ripetutamente sul chip, con costi in termini di tempo e energia. Gli ingegneri vorrebbero un singolo dispositivo fisico in grado sia di memorizzare la forza di una connessione sia di applicare la non linearità di tipo attivazione, ma i componenti elettronici tipici svolgono bene solo uno di questi compiti. Se vengono forzati a svolgerli entrambi, tendono a diventare instabili o imprecisi.

Un nuovo mattoncino transistor

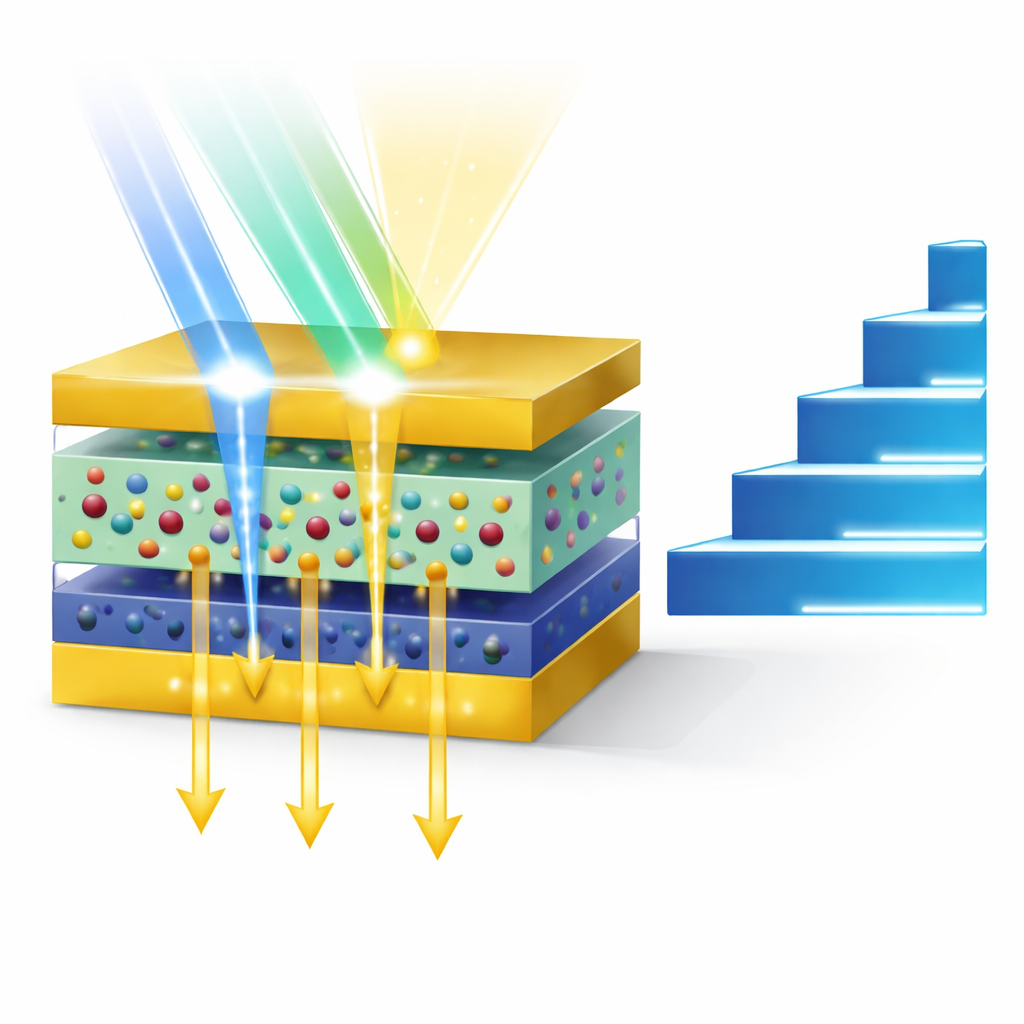

Gli autori presentano un transistor realizzato con cristalli stratificati ultra-sottili che risolve questo enigma in modo sorprendente. Il dispositivo utilizza un materiale bidimensionale chiamato CdPS3-Li come strato conduttore di ioni, accoppiato con un altro semiconduttore 2D, MoS2, che trasporta la corrente elettrica. Lo strato CdPS3-Li contiene ioni di litio che possono muoversi facilmente in alcune direzioni ma non in altre, e ospita inoltre siti vuoti (vacanze) in grado di intrappolare cariche. Quando viene applicato un impulso elettrico, gli ioni di litio migrano verso il confine con lo strato di MoS2 e vi rimangono, modificando fortemente la conducibilità del dispositivo. Quando invece il dispositivo è illuminato, le cariche generate nel MoS2 vengono richiamate in quelle vacanze, producendo risposte temporali ricche e dipendenti dal tempo.

Trasformare luce ed elettricità in segnali di tipo cerebrale

Grazie a questo progetto, lo stesso transistor può supportare in modo naturale due comportamenti molto diversi ma complementari. Sotto impulsi elettrici offre molti livelli di resistenza stabili che cambiano in modo graduale e prevedibile, funzionando come pesi regolabili in una rete neurale. Questi livelli sono non volatili, cioè permangono anche dopo la fine dell’impulso, e il dispositivo può passare in modo affidabile attraverso dozzine di stati distinti senza degradarsi. Sotto impulsi luminosi, invece, la corrente aumenta e poi decade con una curva che può essere adattata con funzioni matematiche comunemente usate come curve di attivazione nel deep learning. Modulando l’intensità, la durata e il numero di impulsi luminosi, i ricercatori possono plasmare la velocità di decadimento della risposta, “programmando” in pratica diversi profili di attivazione direttamente nell’hardware.

Da dispositivi singoli ad array operativi per IA

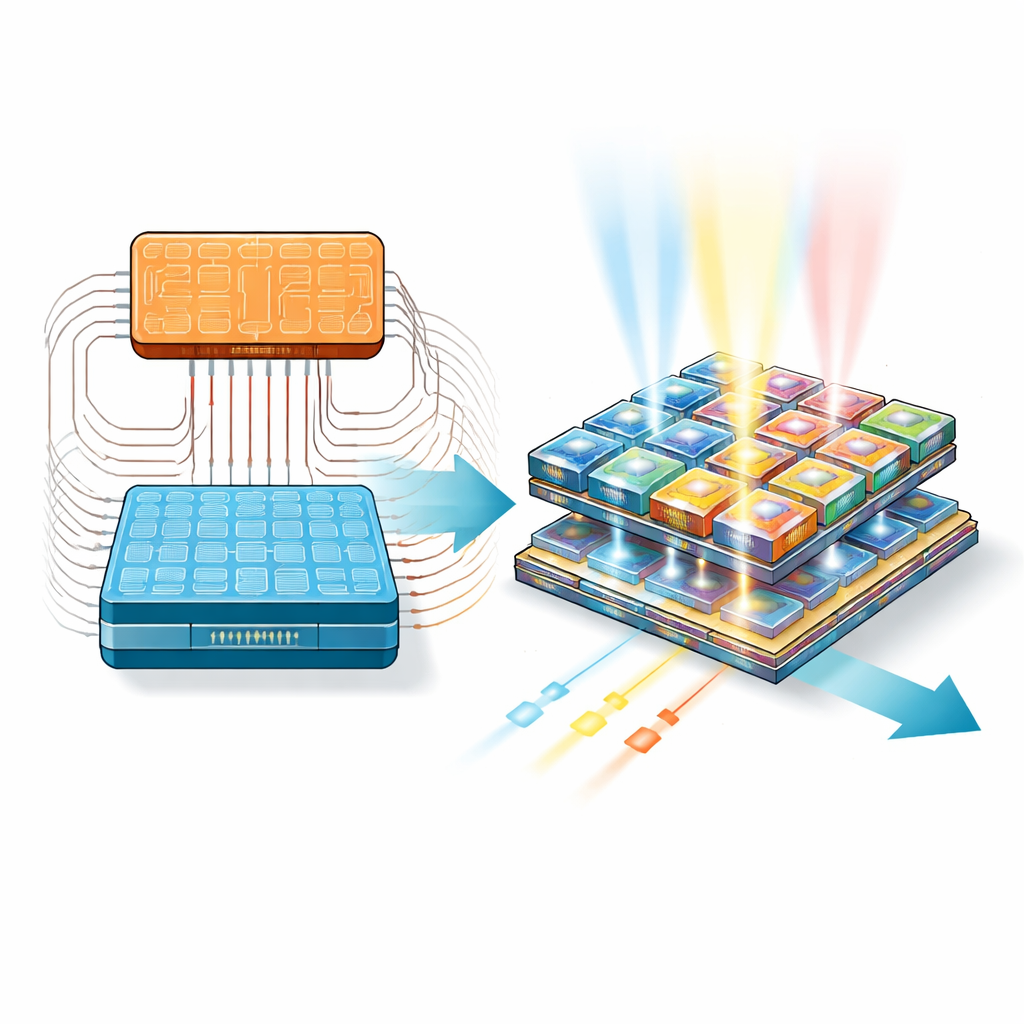

Per dimostrare che non si tratta di una semplice curiosità da laboratorio, il team ha costruito array di questi transistor e li ha collegati per eseguire parti di una rete neurale reale. Un array esegue il passo di moltiplicazione e accumulo: la resistenza memorizzata di ciascun dispositivo rappresenta un peso, e applicando tensioni su una griglia le correnti si sommano naturalmente secondo le leggi della fisica dei circuiti. Un secondo array, più piccolo, è esposto a impulsi luminosi sincronizzati in modo che le sue correnti decadenti implementino lo stadio di attivazione. Coordinando questi due moduli con elettronica di controllo convenzionale, i ricercatori hanno addestrato una rete a riconoscere cifre scritte a mano, raggiungendo un’accuratezza superiore al 97%—paragonabile ai sistemi puramente digitali, ma ottenuta con componenti che integrano intrinsecamente memoria e elaborazione.

Cosa significa per la tecnologia di tutti i giorni

Per un non specialista, il messaggio chiave è che questi nuovi transistor ionici e sensibili alla luce si comportano molto più come sinapsi biologiche rispetto agli interruttori in silicio tradizionali. Possono ricordare la forza delle connessioni, rispondere in modo differente a stimoli elettrici rispetto a quelli ottici e lo fanno con un consumo energetico per operazione estremamente basso. Pur non essendo pronti a sostituire i chip nel tuo smartphone domani, indicano una strada verso un futuro in cui l’hardware per l’IA è più denso, efficiente e più simile al cervello. Tali progressi potrebbero infine rendere possibili potenti sistemi di apprendimento che si adattano a piccoli dispositivi alimentati a batteria, portando capacità di sensing e decisione più intelligenti vicino al luogo in cui i dati vengono generati.

Citazione: Tong, B., Du, T., Du, J. et al. Multimodal ion-gated transistor based on 2D superionic conductor for in-memory computing in deep learning. Nat Commun 17, 4127 (2026). https://doi.org/10.1038/s41467-026-70587-w

Parole chiave: calcolo neuromorfico, calcolo in memoria, transistor ionico, materiali 2D, hardware per deep learning