Clear Sky Science · de

Multimodaler ionengesteuerter Transistor auf Basis eines 2D-Superionenleiters für In-Memory-Computing im Deep Learning

Intelligentere Chips, inspiriert vom Gehirn

Die moderne künstliche Intelligenz leistet Beeindruckendes, verbraucht aber viel Energie, weil heutige Chips ständig Daten zwischen Speicher und Prozessoren hin- und herschieben. Dieser Beitrag beschreibt eine neue Art winziger elektronischer Bauelemente, die sich etwas mehr wie eine Verbindung zwischen Nervenzellen, eine Synapse, verhalten. Indem sie Berechnung und Signalformung am selben Ort durchführen, könnten solche Bauteile zukünftige KI-Hardware schneller und deutlich energieeffizienter machen — mit möglichen Vorteilen für alles von Smartphones bis hin zu Sensorsystemen in Fahrzeugen und medizinischen Wearables.

Warum heutige KI-Hardware Energie verschwendet

Die meisten KI-Algorithmen beruhen auf zwei Kernschritten: dem Multiplizieren und Addieren von Zahlen, um Signale zu kombinieren, und anschließend dem Durchlaufen einer gekrümmten „Aktivierungs“-Funktion, die entscheidet, welche Muster relevant sind. Konventionelle Chips führen diese Schritte in getrennten Einheiten aus. Daten müssen zwischen digitalen und analogen Formen konvertiert und wiederholt über den Chip verschoben werden, was Zeit und Energie kostet. Ingenieure wünschen sich ein einzelnes physikalisches Bauteil, das sowohl die Stärke einer Verbindung speichern als auch die aktivierungsähnliche Nichtlinearität anwenden kann, doch typische elektronische Komponenten beherrschen meist nur eine dieser Aufgaben zuverlässig. Wenn sie versuchen, beides zu leisten, werden sie oft instabil oder ungenau.

Ein neuer Transistor-Baustein

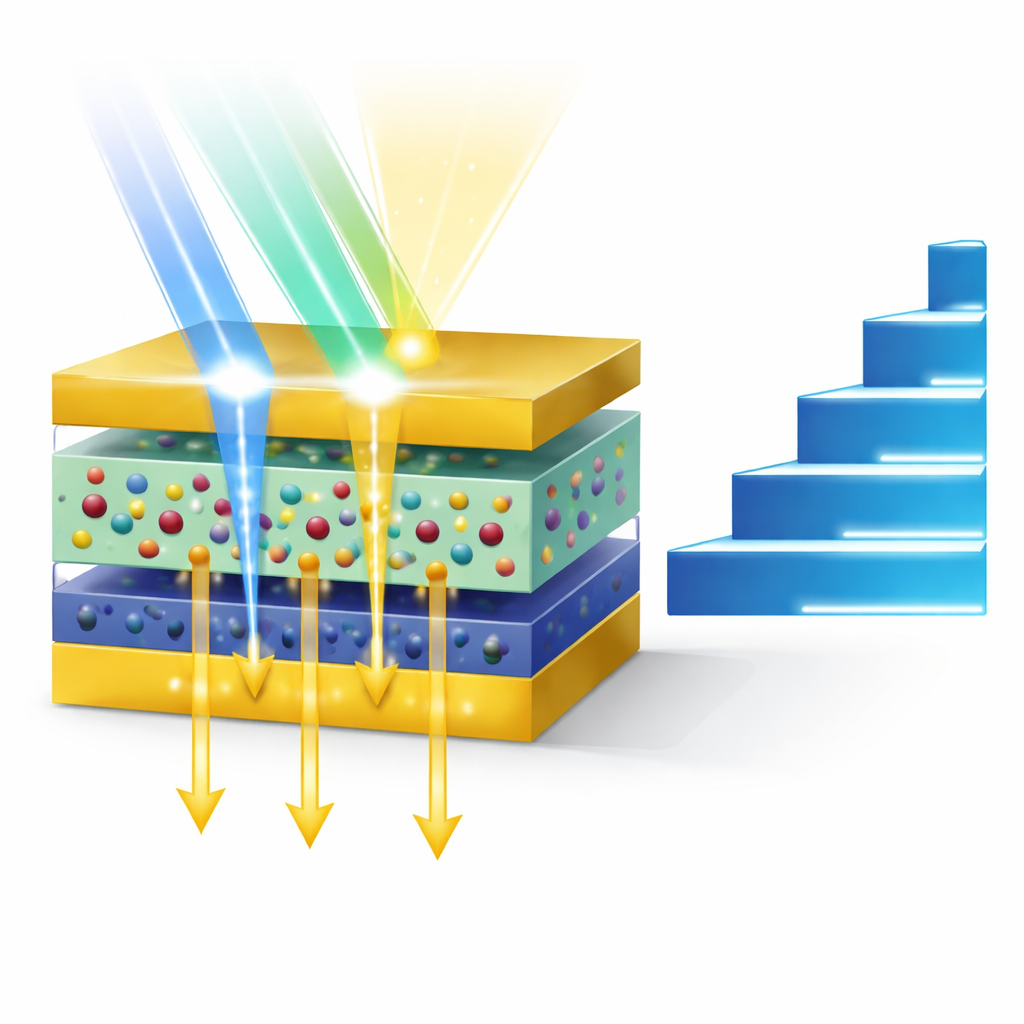

Die Autoren stellen einen Transistor aus ultradünnen, geschichteten Kristallen vor, der dieses Problem auf überraschende Weise löst. Das Bauteil nutzt ein zweidimensionales Material namens CdPS3-Li als spezielle ionenleitende Schicht, gestapelt mit einem weiteren zweidimensionalen Halbleiter, MoS2, der den elektrischen Strom leitet. Die CdPS3-Li-Schicht enthält Lithium-Ionen, die sich in manchen Richtungen leicht bewegen, in anderen jedoch nicht, und sie bietet zudem Leerstellen (Vakanzen), die Ladung einfangen können. Wenn ein elektrischer Puls angelegt wird, wandern Lithium-Ionen zur Grenze zur MoS2-Schicht und verbleiben dort, wodurch sich die Leitfähigkeit des Bauteils stark ändert. Wenn stattdessen Licht auf das Bauteil fällt, werden in der MoS2-Schicht erzeugte Ladungen in diese Vakanzen gezogen, was zu komplexen, zeitabhängigen Reaktionen führt.

Verwandlung von Licht und Elektrizität in gehirnähnliche Signale

Dank dieses Aufbaus kann derselbe Transistor auf natürliche Weise zwei sehr unterschiedliche, aber komplementäre Verhaltensweisen unterstützen. Unter elektrischen Pulsen bietet er viele stabile Widerstandslevel, die sich glatt und vorhersagbar verändern und wie verstellbare Gewichte in einem neuronalen Netz wirken. Diese Zustände sind nichtflüchtig, das heißt, sie bleiben auch nach Ende des Pulses erhalten, und das Bauteil kann verlässlich Dutzende unterscheidbarer Zustände durchlaufen, ohne zu verschleißen. Unter Lichtpulsen hingegen steigt der Strom an und fällt dann gekrümmt ab, ein Verhalten, das sich gut durch in Deep Learning gebräuchliche Aktivierungsfunktionen beschreiben lässt. Durch Abstimmen von Stärke, Dauer und Anzahl der Lichtpulse können die Forschenden steuern, wie schnell die Antwort abklingt, und so verschiedene Aktivierungsprofile direkt in der Hardware „programmieren“.

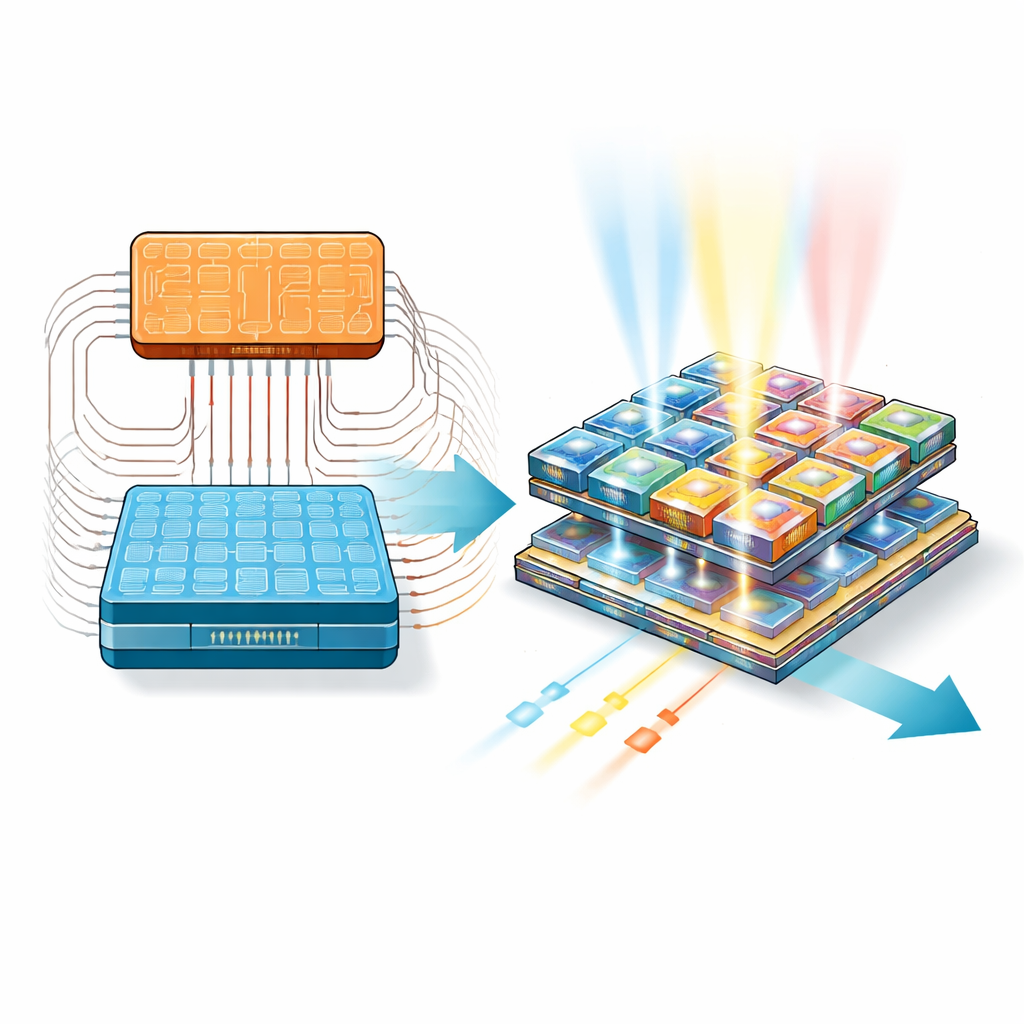

Von Einzelbauteilen zu funktionierenden KI-Arrays

Um zu zeigen, dass es sich nicht nur um eine Laborspielerei handelt, bauten die Forschenden Arrays dieser Transistoren und verbanden sie so, dass Teile eines echten neuronalen Netzes ablaufen konnten. Ein Array übernimmt den Multiply-and-Accumulate-Schritt: Der gespeicherte Widerstand jedes Bauteils repräsentiert ein Gewicht, und das Anlegen von Spannungen über ein Gitter lässt Ströme entsprechend den Gesetzen der Schaltungssphysik natürlich aufsummieren. Ein zweites, kleineres Array wird gezielt mit zeitlich abgestimmten Lichtpulsen beschienen, sodass dessen abklingende Ströme die Aktivierung implementieren. Durch Koordination dieser beiden Module mit konventioneller Steuerelektronik trainierten die Forschenden ein Netzwerk zur Erkennung handgeschriebener Ziffern und erreichten eine Genauigkeit von über 97 Prozent — vergleichbar mit rein digitalen Systemen, jedoch mit Bauteilen, die Speicher und Verarbeitung inhärent vereinen.

Was das für Alltagsgeräte bedeutet

Für Nicht-Spezialisten lautet die zentrale Botschaft: Diese neuartigen, ionenbasierten und lichtempfindlichen Transistoren verhalten sich deutlich stärker wie biologische Synapsen als traditionelle Siliziumschalter. Sie können Verbindungsstärken speichern, unterschiedlich auf elektrische und optische Signale reagieren und das bei extrem geringem Energieaufwand pro Operation. Zwar sind sie nicht bereit, die Chips in Ihrem Smartphone von heute auf morgen zu ersetzen, doch sie weisen in eine Zukunft, in der KI-Hardware dichter, effizienter und gehirnähnlicher ist. Solche Fortschritte könnten schließlich leistungsfähige Lernsysteme ermöglichen, die in kleine, batteriebetriebene Geräte passen und intelligenteres Erfassen und Entscheiden näher an den Ort bringen, an dem Daten erzeugt werden.

Zitation: Tong, B., Du, T., Du, J. et al. Multimodal ion-gated transistor based on 2D superionic conductor for in-memory computing in deep learning. Nat Commun 17, 4127 (2026). https://doi.org/10.1038/s41467-026-70587-w

Schlüsselwörter: neuromorphes Rechnen, In-Memory-Computing, ionengesteuerter Transistor, 2D-Materialien, Deep-Learning-Hardware