Clear Sky Science · pt

Transistor iônico multimodal baseado em condutor superiônico 2D para computação in-memory em deep learning

Chips mais inteligentes inspirados no cérebro

A inteligência artificial moderna realiza feitos impressionantes, mas consome muita energia, em grande parte porque os chips atuais movem dados constantemente entre memória e processadores. Este artigo descreve um novo tipo de dispositivo eletrônico minúsculo que se comporta de maneira mais parecida com uma conexão entre células cerebrais, ou sinapse. Ao realizar tanto cálculos quanto a modelagem de sinais no mesmo local, esses dispositivos podem tornar o hardware de IA futuro mais rápido e muito mais eficiente energeticamente, beneficiando potencialmente desde smartphones até sensores de borda em carros e dispositivos médicos vestíveis.

Por que o hardware de IA atual desperdiça recursos

A maioria dos algoritmos de IA depende de dois passos centrais: multiplicar e somar números para combinar sinais, e então passar o resultado por uma etapa curva de “ativação” que decide quais padrões importam. Chips convencionais realizam esses passos em blocos separados. Os dados precisam ser convertidos entre formas digitais e analógicas e movidos repetidamente pelo chip, o que custa tempo e energia. Engenheiros desejam um único dispositivo físico que possa tanto armazenar a intensidade de uma conexão quanto aplicar a não linearidade semelhante à ativação, mas componentes eletrônicos típicos fazem bem apenas uma dessas funções. Quando forçados a desempenhar ambas, tendem a ficar instáveis ou imprecisos.

Um novo bloco de construção transistor

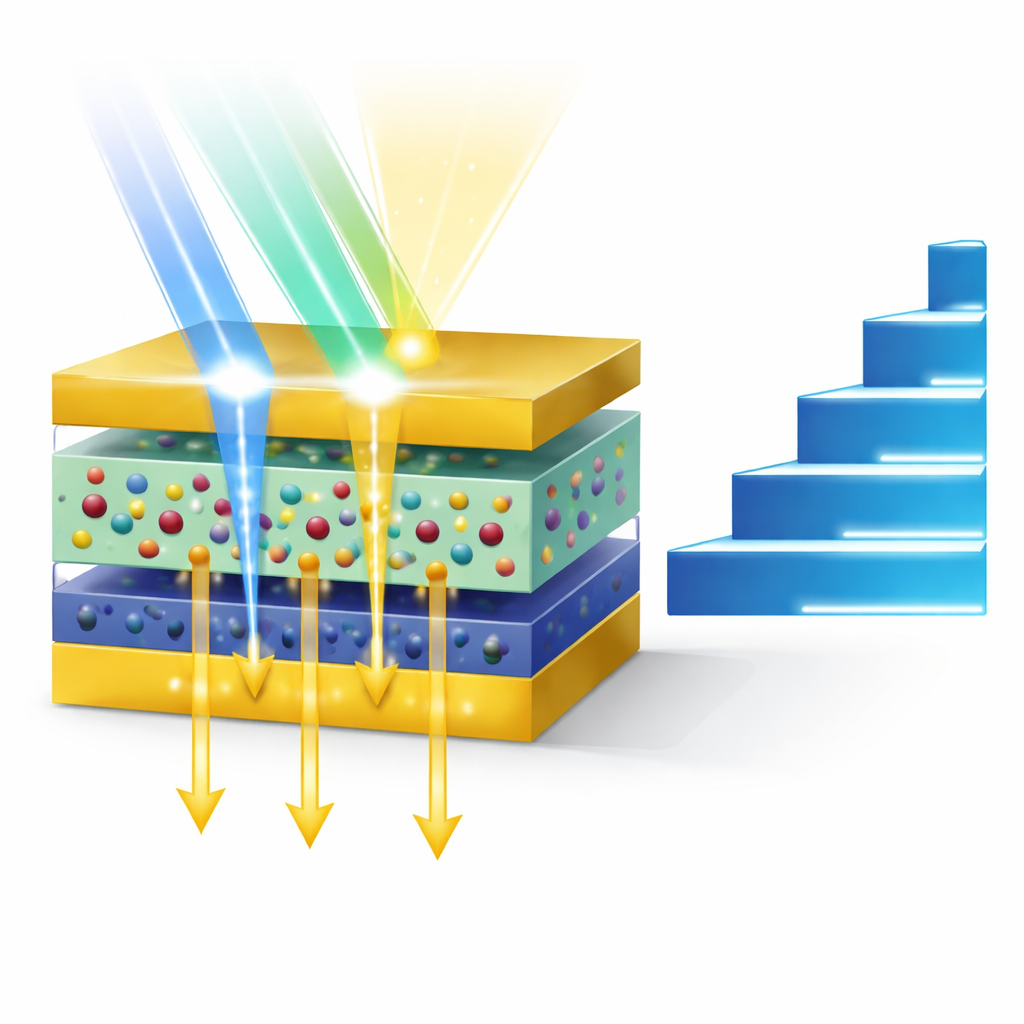

Os autores apresentam um transistor feito de cristais empilhados ultrafinos que resolve esse problema de maneira surpreendente. O dispositivo usa um material bidimensional chamado CdPS3-Li como uma camada especial condutora de íons, empilhada com outro semicondutor bidimensional, MoS2, que conduz corrente elétrica. A camada CdPS3-Li contém íons de lítio que podem se mover facilmente em algumas direções, mas não em outras, e também abriga sítios vazios (vacâncias) que podem capturar carga. Quando um pulso elétrico é aplicado, íons de lítio migram até a interface com a camada de MoS2 e permanecem lá, alterando fortemente a condutividade do dispositivo. Quando luz incide sobre o dispositivo, as cargas geradas na camada de MoS2 são atraídas para essas vacâncias, levando a respostas ricas e dependentes do tempo.

Transformando luz e eletricidade em sinais semelhantes aos do cérebro

Devido a esse projeto, o mesmo transistor pode naturalmente sustentar dois comportamentos muito diferentes, mas complementares. Sob pulsos elétricos, ele oferece muitos níveis de resistência estáveis que mudam de forma suave e previsível, atuando como pesos ajustáveis em uma rede neural. Esses níveis são não voláteis, ou seja, permanecem mesmo após o fim do pulso, e o dispositivo pode percorrer de modo confiável dezenas de estados distintos sem se degradar. Sob pulsos de luz, no entanto, a corrente sobe e depois decai de forma curva que pode ser bem ajustada por funções matemáticas comumente usadas como curvas de ativação em deep learning. Ao ajustar a intensidade, duração e número de pulsos de luz, os pesquisadores podem moldar a rapidez com que a resposta decai, efetivamente “programando” diferentes perfis de ativação no hardware.

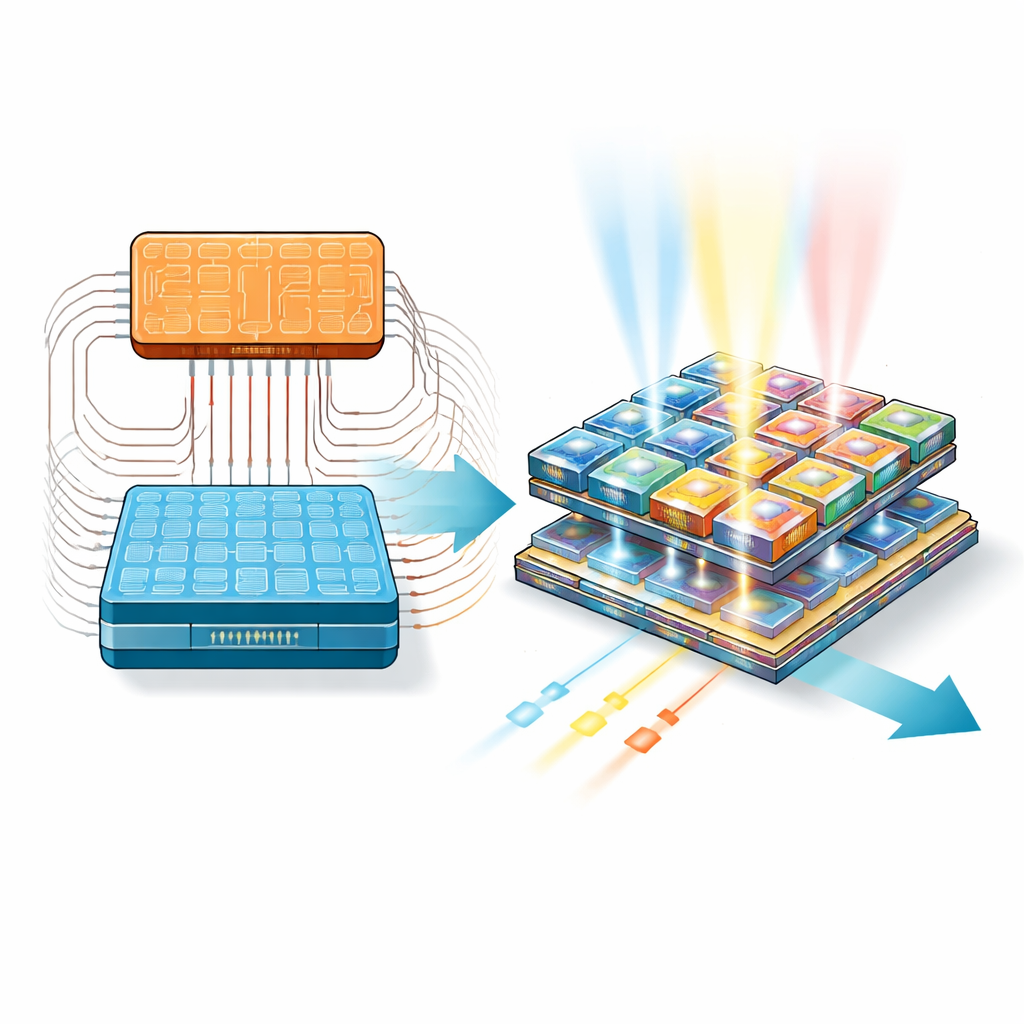

De dispositivos individuais a matrizes de IA funcionais

Para mostrar que isso é mais que uma curiosidade de laboratório, a equipe construiu matrizes desses transistores e as conectou para executar partes de uma rede neural real. Uma matriz realiza a etapa de multiplicação e acumulação: a resistência armazenada de cada dispositivo representa um peso, e aplicar tensões através de uma grade faz com que as correntes se somem naturalmente conforme as leis da física dos circuitos. Uma segunda matriz, menor, é exposta a pulsos de luz cuidadosamente sincronizados para que suas correntes decrescentes implementem a etapa de ativação. Ao coordenar esses dois módulos com eletrônica de controle convencional, os pesquisadores treinaram uma rede para reconhecer dígitos manuscritos, alcançando uma precisão acima de 97% — comparável a sistemas puramente digitais, mas obtido com componentes que combinam intrinsecamente memória e processamento.

O que isso significa para a tecnologia cotidiana

Para um não especialista, a mensagem principal é que esses novos transistores iônicos e sensíveis à luz funcionam muito mais como sinapses biológicas do que como interruptores tradicionais de silício. Eles podem memorizar forças de conexão, responder de forma diferente a sinais elétricos versus ópticos e fazer isso com consumo de energia extremamente baixo por operação. Embora ainda não estejam prontos para substituir os chips dentro do seu celular amanhã, apontam para um futuro em que o hardware de IA será mais denso, eficiente e parecido com o cérebro. Esses avanços poderiam, eventualmente, viabilizar sistemas de aprendizado poderosos que cabem em dispositivos pequenos e alimentados por bateria, aproximando decisões e sensores inteligentes do local onde os dados são gerados.

Citação: Tong, B., Du, T., Du, J. et al. Multimodal ion-gated transistor based on 2D superionic conductor for in-memory computing in deep learning. Nat Commun 17, 4127 (2026). https://doi.org/10.1038/s41467-026-70587-w

Palavras-chave: computação neuromórfica, computação in-memory, transistor controlado por íons, materiais 2D, hardware para deep learning