Clear Sky Science · ru

Алгоритмическая система для обнаружения фейковых новостей на арабском языке с использованием нейронных сетей и трансформерных эмбеддингов с взвешиванием классов

Почему важно выявлять ложные истории в сети

В современном всегда на связи мире драматичный заголовок на арабском может за считанные минуты распространиться с малоизвестной страницы Facebook на миллионы телефонов. Некоторые из таких материалов — тщательно срежиссированные фейки, которые способны разжигать общественное мнение, искажать итоги выборов или посеять недоверие к институтам. При этом большинство автоматических инструментов для поиска фейков создавались для английского языка. Это исследование закрывает такой пробел, разработав и протестировав эффективную систему, способную помечать вводящие в заблуждение арабские новости с точностью, близкой к работе человеческих фактчекеров.

Создание реалистичной картины арабских новостей

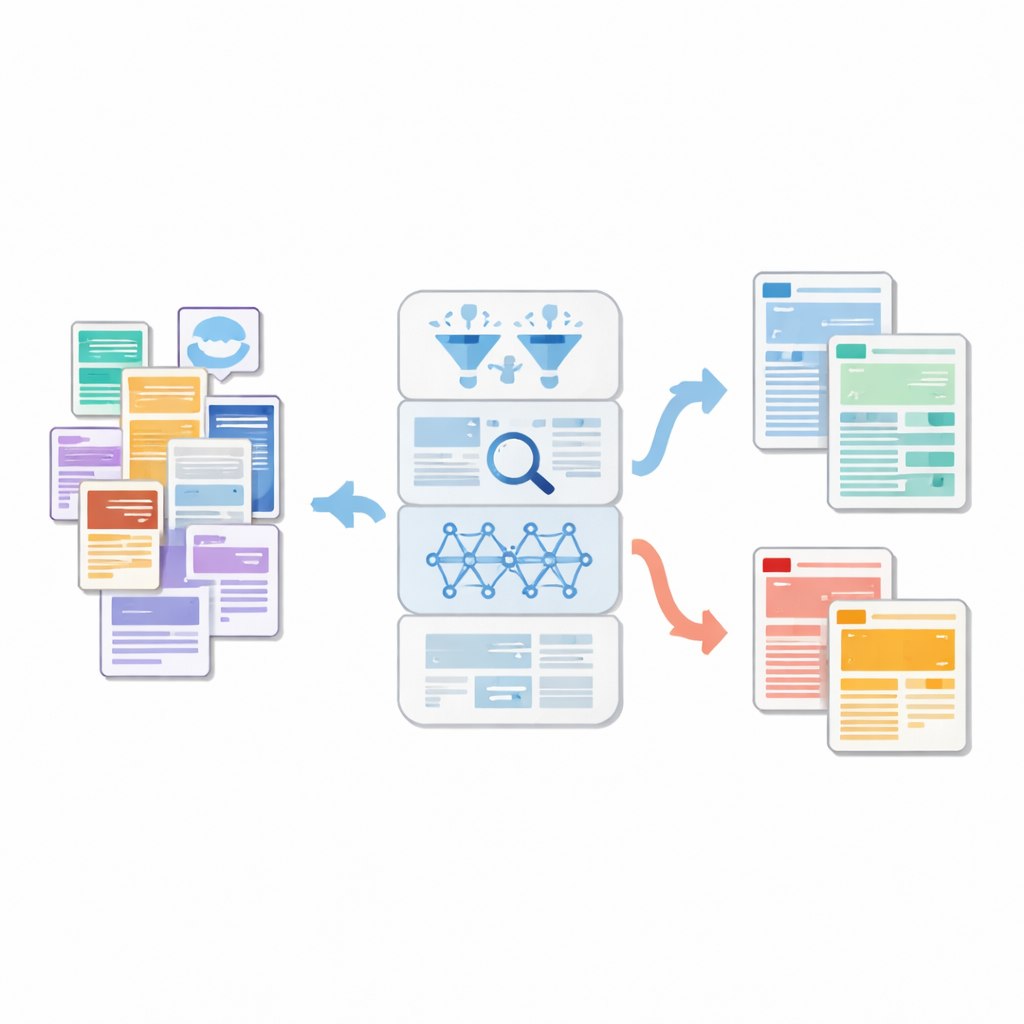

Чтобы отразить хаотичную реальность онлайн‑информации, исследователи сначала собрали большую смешанную коллекцию из 7 474 арабских новостных материалов, опубликованных в период с 2015 по 2025 год. Тексты поступили из надежных редакций, непроверенных блогов и постов в соцсетях, а также включали переведенные образцы из известных англоязычных датасетов фейковых новостей. Каждый элемент был помечен как правдивый или фейковый с помощью тщательной перекрестной проверки официальными источниками и арабскими платформами фактчекинга. Подмножество пометок было перепроверено тремя экспертами, и их сильное сходство придало уверенность в надежности меток. Итоговый датасет отражает реальную ситуацию, где фейковых материалов меньше, чем достоверных, — дисбаланс классов, который часто ставит в затруднение автоматические детекторы.

Обучая машины по‑настоящему «читать» арабский

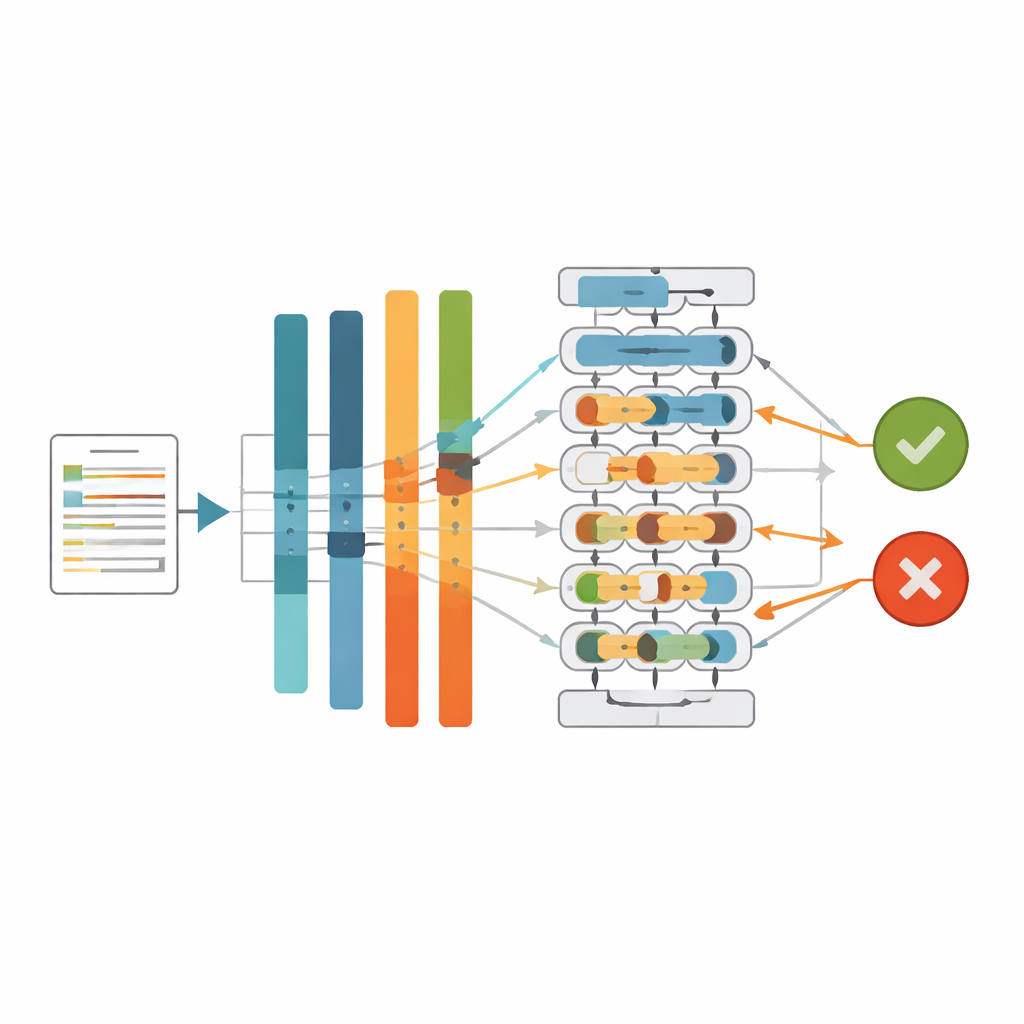

Вместо простого подсчета слов команда обратилась к современной семье языковых моделей — трансформеров, которые умеют улавливать значение из контекста. В качестве «читалки» использовали арабскую модель CAMeLBERT, специально обученную на современном стандартном арабском. Каждый материал проходил через специализированный препроцессинговый конвейер, очищающий текст от эмодзи, ссылок и шумовых символов, при этом сохраняя лингвистические нюансы, важные для арабского. CAMeLBERT затем преобразовывал очищенные тексты в плотные числовые отпечатки, фиксирующие тонкие оттенки смысла, стиля и структуры. Эти отпечатки подавались в компактную глубокую нейронную сеть, которая изучала шаблоны, отличающие правду от лжи.

Исправление дисбаланса между правдой и фейком

Ключевой проблемой было то, что правдивых новостей в датасете больше, чем фейковых, так же как и в реальной жизни. Если это не учитывать, модель будет действовать консервативно и помечать большинство материалов как достоверные, пропуская опасные фейки. Многие предыдущие работы пытались исправить это путем дублирования редких фейковых примеров, синтеза новых или удаления части правдивых статей, но такие приемы могут добавить шум или выбросить полезную информацию. В этой работе сделали упор на алгоритмическое решение — взвешивание классов. Во время обучения ошибки на фейковых статьях делались «дороже» для модели, чем ошибки на правдивых. Не изменяя сами данные, это заставляет нейронную сеть уделять больше внимания миноритарному классу фейков и выстраивать более сбалансированную границу между истинными и ложными историями.

Тестирование системы

Исследователи сравнили несколько подходов: традиционные модели машинного обучения с признаками, основанными на подсчете слов, ту же нейронную сеть, питаемую эмбеддингами от разных арабских трансформеров, а также лучшую модель‑трансформер в сочетании с разными стратегиями балансировки. CAMeLBERT показал себя сильнейшим «бэкендом» среди арабских трансформеров, опередив такие альтернативы, как AraBERT, MARBERTv2 и AraELECTRA. В паре со взвешиванием классов система на базе CAMeLBERT классифицировала арабские новости с точностью примерно 95,5% и F1‑мерой — балансом точности и полноты — около 96,2%. Не менее важно, что настроенная система существенно снизила наиболее тревожную ошибку: когда фейковые материалы ошибочно принимаются за правду. Чтобы частично «раскрыть черный ящик», команда также применяла современные инструменты объяснимости (LIME и SHAP), показывающие, какие лингвистические сигналы и паттерны во внутренних представлениях модели склоняют запись в сторону фейка или правды.

Что это значит для повседневных читателей

С точки зрения неспециалиста, исследование демонстрирует, что машины можно обучить «читать» арабские новости с удивительной тонкостью, замечая стилистические и контекстные подсказки, которые часто отделяют фабрикованные посты от профессиональной журналистики. Сочетая модель, адаптированную под современный стандартный арабский, с стратегией обучения, учитывающей справедливость классов, авторы предлагают детектор, который одновременно точен и относительно легковесен — пригоден для интеграции в платформы фактчекинга, редакции и инструменты мониторинга соцсетей. Хотя он не заменяет человеческое суждение, такая система создает прочную основу для автоматизированного фактчекинга на арабском языке, помогая замедлить распространение вредной дезинформации и поддерживать более здоровое информационное пространство в арабоязычном мире.

Цитирование: Saad, M., Abdelrazek, S. & Abdelmaksoud, I.R. An algorithmic system for arabic fake news detection using neural networks and transformer embeddings with class weighting. Sci Rep 16, 12226 (2026). https://doi.org/10.1038/s41598-026-45653-4

Ключевые слова: Фейковые новости на арабском, модели-трансформеры, нейронные сети, несбалансированность классов, системы фактчекинга