Clear Sky Science · de

Ein algorithmisches System zur Erkennung arabischer Falschmeldungen mithilfe neuronaler Netze und Transformer‑Embeddings mit Klassengewichtung

Warum das Erkennen falscher Geschichten im Netz wichtig ist

In der heutigen stets vernetzten Welt kann eine dramatische Überschrift auf Arabisch in wenigen Minuten von einer wenig bekannten Facebook‑Seite auf Millionen von Telefonen gelangen. Einige dieser Geschichten sind sorgfältig konstruierte Fälschungen, die öffentliche Meinung anheizen, Wahlen verzerren oder Misstrauen gegenüber Institutionen säen können. Die meisten automatisierten Werkzeuge zur Erkennung von Fake News sind jedoch für Englisch entwickelt worden. Diese Studie schließt diese Lücke, indem sie ein effizientes System entwirft und testet, das irreführende arabische Nachrichtenartikel mit einer Genauigkeit kennzeichnen kann, die an die von menschlichen Faktenprüfern heranreicht.

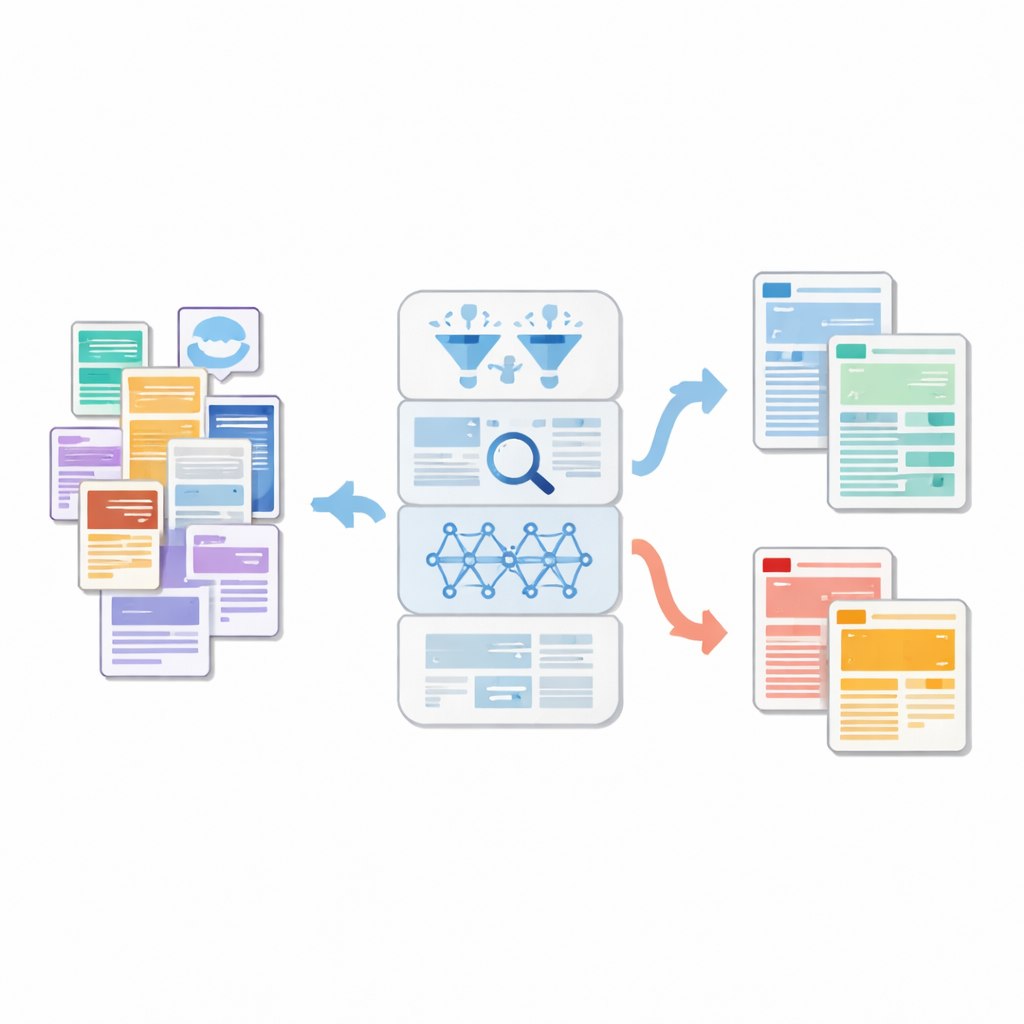

Ein realistisches Abbild arabischer Nachrichten erstellen

Um die chaotische Realität Online zu spiegeln, stellte das Forschungsteam zunächst eine große, gemischte Sammlung von 7.474 arabischen Nachrichtenartikeln zusammen, die zwischen 2015 und 2025 veröffentlicht wurden. Die Texte stammten aus vertrauenswürdigen Redaktionen, unbestätigten Blogs und Social‑Media‑Beiträgen sowie aus übersetzten Beispielen bekannter englischer Fake‑News‑Datensätze. Jedes Element wurde als echt oder falsch gekennzeichnet, wobei sorgfältiges Cross‑Checking gegen offizielle Quellen und arabische Faktenprüfungsplattformen verwendet wurde. Ein Teilbestand wurde von drei Expertinnen und Experten doppelt geprüft; ihre starke Übereinstimmung stärkte das Vertrauen in die Zuverlässigkeit der Labels. Der endgültige Datensatz spiegelt wider, dass gefälschte Geschichten in der Praxis von echten Berichten übertroffen werden — ein Klassenungleichgewicht, das automatisierte Detektoren häufig vor Probleme stellt.

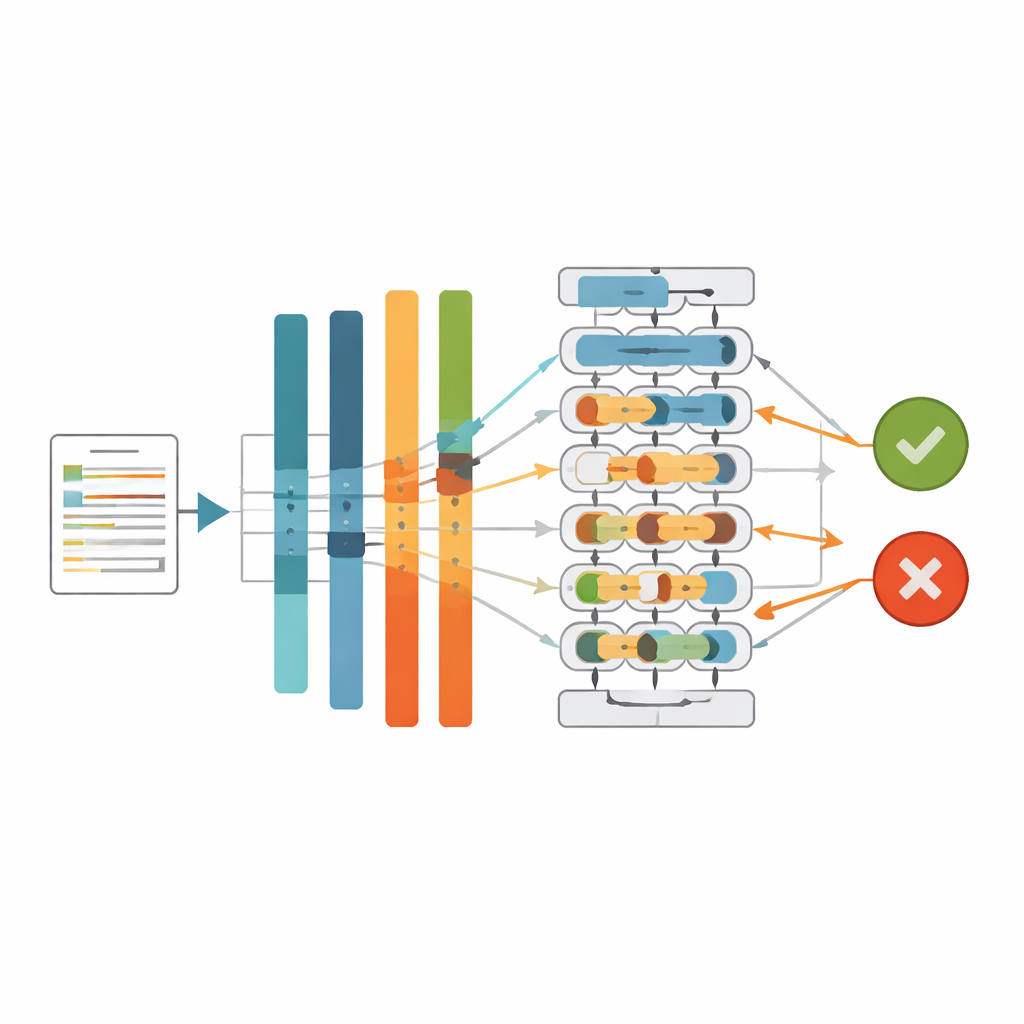

Maschinen beibringen, Arabisch wirklich zu lesen

Anstatt sich auf einfache Wortzählungen zu verlassen, wandte sich das Team einer modernen Familie von Sprachmodellen namens Transformer zu, die Bedeutung aus dem Kontext erfassen können. Sie verwendeten ein arabisches Modell namens CAMeLBERT, das speziell auf Modernes Standardarabisch trainiert wurde, als eine Art anspruchsvollen Leser. Jeder Artikel lief durch eine spezialisierte Vorverarbeitungspipeline, die Emojis, Links und störende Zeichen entfernt und dabei die für Arabisch wichtigen sprachlichen Nuancen bewahrt. CAMeLBERT wandelte dann jeden bereinigten Artikel in einen dichten numerischen Fingerabdruck um, der feine Bedeutungs-, Stil‑ und Strukturunterschiede erfasst. Diese Fingerabdrücke wurden in ein kompaktes tiefes neuronales Netzwerk eingespeist, das Muster lernt, die echte von gefälschten Nachrichten unterscheiden.

Das Ungleichgewicht zwischen echt und falsch beheben

Eine zentrale Herausforderung war, dass echte Nachrichtenartikel im Datensatz häufiger vorkamen als gefälschte — genauso wie im Alltag. Bleibt das unbeachtet, neigt ein Modell dazu, auf Nummer sicher zu gehen und die meisten Geschichten als echt einzustufen, wodurch gefährliche Fälschungen übersehen werden. Viele frühere Studien versuchten das zu beheben, indem seltene falsche Beispiele dupliziert, synthetische erzeugt oder einige echte Artikel verworfen wurden; solche Tricks können jedoch Rauschen hinzufügen oder nützliche Informationen verlieren. Statt die Daten selbst zu verändern, konzentrierte sich diese Arbeit auf eine Algorithmus‑Ebene‑Lösung namens Klassengewichtung. Während des Trainings werden Fehler bei falschen Artikeln für das Modell „teurer“ gemacht als Fehler bei echten. Ohne die Daten zu verändern, zwingt das die neuronalen Netze, der Minderheitsklasse der Fälschungen mehr Aufmerksamkeit zu schenken und eine ausgeglichenere Trennlinie zwischen wahren und falschen Geschichten zu ziehen.

Das System auf die Probe stellen

Die Forschenden verglichen mehrere Ansätze: traditionelle Machine‑Learning‑Modelle mit Wortzählungsmerkmalen, dasselbe neuronale Netz, gespeist von verschiedenen arabischen Transformer‑Modellen, sowie das beste Transformer‑Modell in Kombination mit verschiedenen Ausgleichsstrategien. CAMeLBERT erwies sich als stärkste Basis unter den arabischen Transformern und übertraf Alternativen wie AraBERT, MARBERTv2 und AraELECTRA. In Kombination mit Klassengewichtung klassifizierte das auf CAMeLBERT basierende System arabische Nachrichten mit einer Genauigkeit von etwa 95,5 % und einem F1‑Score — dem Ausgleich von Präzision und Recall — von etwa 96,2 %. Ebenso wichtig ist, dass das feinabgestimmte System den besorgniserregendsten Fehler deutlich reduzierte: gefälschte Geschichten, die fälschlich als echt behandelt werden. Um die „Black Box“ zu öffnen, setzte das Team außerdem moderne Erklärungswerkzeuge (LIME und SHAP) ein, die aufzeigen, welche sprachlichen Hinweise und Muster in den internen Repräsentationen des Modells dazu neigen, einen Artikel in Richtung „falsch“ oder „echt“ zu ziehen.

Was das für Alltagsleserinnen und ‑leser bedeutet

Aus Sicht einer nicht‑fachlichen Leserschaft zeigt diese Studie, dass man Maschinen darauf trainieren kann, arabische Nachrichten überraschend nuanciert zu lesen und subtile stilistische und kontextuelle Hinweise zu erkennen, die erfundene Beiträge oft von professionellem Journalismus trennen. Durch die Kombination eines auf Modernes Standardarabisch zugeschnittenen Sprachmodells mit einer trainingsseitig fairness‑bewussten Strategie liefern die Autorinnen und Autoren einen Detektor, der sowohl genau als auch relativ leichtgewichtig ist — geeignet zur Integration in Fact‑Checking‑Plattformen, Redaktionen und Social‑Media‑Monitoring‑Tools. Er ersetzt zwar nicht das menschliche Urteil, bietet aber eine solide Grundlage für automatisiertes arabisches Fact‑Checking, hilft, die Verbreitung schädlicher Desinformation zu verlangsamen, und unterstützt ein gesünderes Informationsumfeld in der arabischsprachigen Welt.

Zitation: Saad, M., Abdelrazek, S. & Abdelmaksoud, I.R. An algorithmic system for arabic fake news detection using neural networks and transformer embeddings with class weighting. Sci Rep 16, 12226 (2026). https://doi.org/10.1038/s41598-026-45653-4

Schlüsselwörter: Arabische Falschmeldungen, Transformer‑Modelle, Neuronale Netze, Klassenungleichgewicht, Fact‑Checking‑Systeme