Clear Sky Science · ru

Sen2GF3Floods: эталонный многоресурсный набор данных о наводнениях с двойной временной и активной аннотацией

Почему более умные карты наводнений важны

Наводнения — одни из самых разрушительных природных бедствий, но когда реки выходят из берегов или города затапливает внезапным ливнем, спасательные службы по‑прежнему часто не могут быстро и точно определить, где именно распространилась вода. В этой статье представлен Sen2GF3Floods — новая крупномасштабная коллекция спутниковых снимков и подготовленных для компьютера карт затопления, созданная, чтобы помочь системам искусственного интеллекта (ИИ) быстро и надёжно отслеживать водные разливы. Сочетая разные типы спутниковых наблюдений до и после бедствия и применяя экономичный метод разметки затопленных зон, авторы стремятся сделать качественные оперативные карты наводнений более доступными.

Новые способы наблюдать воду из космоса

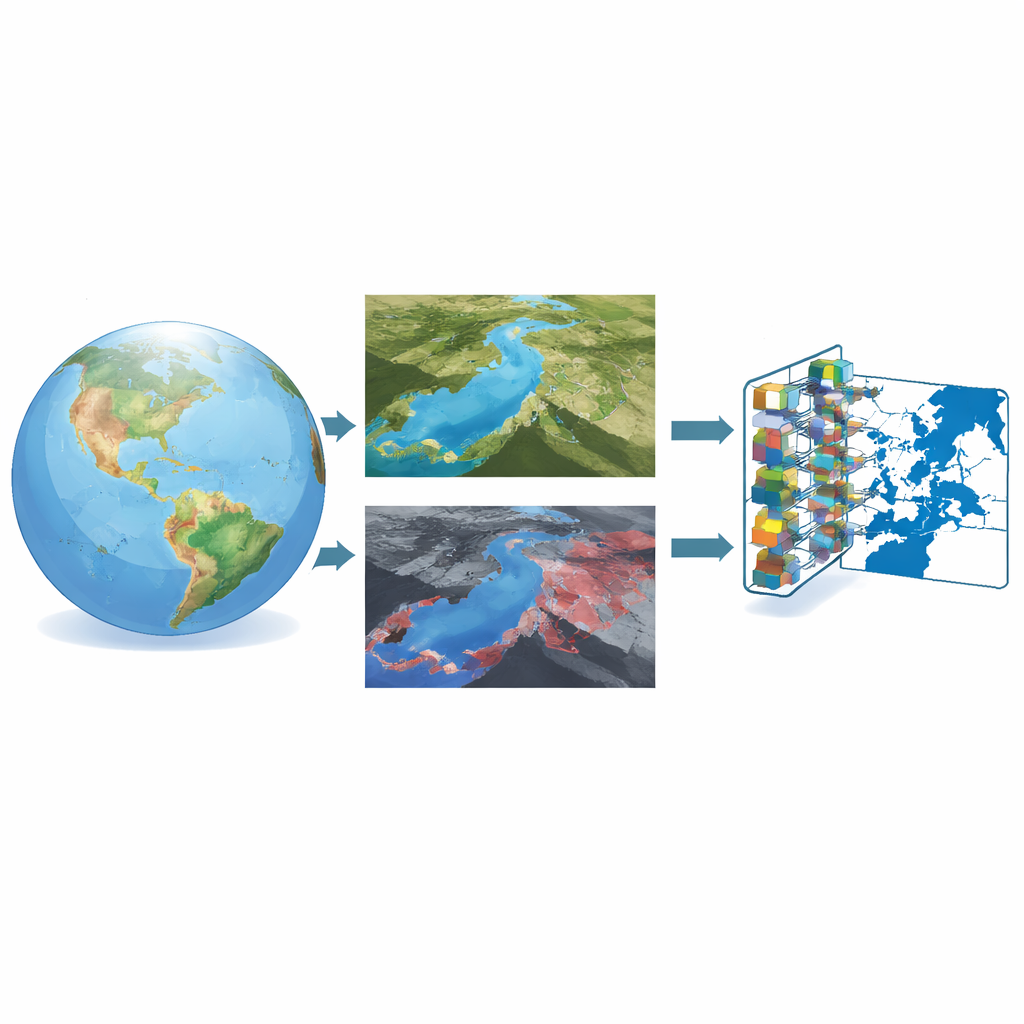

Картирование наводнений из космоса традиционно опирается на два основных типа спутниковых данных. Оптические снимки, похожие на очень детальные фотографии, чётко показывают реки, поля и городские кварталы — но облака и сильный дождь могут закрыть обзор именно в момент наводнения. Радарные изображения, получаемые с помощью микроволнового зондирования поверхности, проходят через облака и работают в любое время суток, но дают более «шумную» картину, которую сложнее интерпретировать вручную. Исследователи, создавшие Sen2GF3Floods, объединяют сильные стороны обоих подходов: отчётливые оптические снимки до наводнения и радарные кадры, сделанные во время события. Оптика даёт подробную картину обычного состояния ландшафта, тогда как радар показывает, где именно вода распространилась при бедствии.

Создание обширной библиотеки событий наводнений

Чтобы быть полезным для современных методов ИИ, набор данных о наводнениях должен быть большим, разнообразным и аккуратно размеченным — именно это и предлагает Sen2GF3Floods. Набор включает спутниковые патчи по девяти крупным наводнениям в Китае, охватывающим реки, сельхозугодья, городские территории и горы. Для каждой локации команда собрала четыре цветовых диапазона со спутников Sentinel‑2 и две радарные полосы с миссии Gaofen‑3 Китая, все с разрешением 10 метров. Эти изображения разрезаны на более чем 21 000 небольших тайлов, пригодных для обработки моделями машинного обучения. Для каждого тайла имеется простая карта, отмечающая, какие пиксели были затоплены, а какие — нет, чтобы алгоритмы могли научиться различать нормальную воду, временные разливы, тени и сухую поверхность.

Пусть компьютер подскажет, что разметить экспертам

Основное узкое место при создании таких наборов — ручная обводка границ затоплений. Чтобы сократить эту работу, авторы разработали трёхэтапный подход с двойной временной аннотацией. Сначала они автоматически сгенерировали грубую карту постоянной воды по преднаводненному оптическому снимку и другую карту по посленаводненному радарному изображению, затем сравнили их, чтобы оценить появление новой воды. Далее эксперты вручную уточняли эти грубые карты, используя высокоразрешающую подложку, корректируя сложные участки, такие как рисовые чеки и узкие русла. Наконец, они обучили сеть сегментации — сложную модель распознавания образов — прогнозировать затопления на немаркированных тайлах и измеряли, где модель наиболее неуверенна. Только «сложные» тайлы, где модель испытывала трудности, возвращались экспертам для тщательной разметки. Этот цикл обучения, оценки неопределённости и целевой корректировки позволил команде расширять набор данных, сохраняя трудоёмкость ручной работы под контролем.

Проверка, насколько хорошо машины учатся на данных

Собрав набор данных, исследователи оценили несколько ведущих моделей сегментации изображений, включая U‑Net, U‑Net++, DeepLabV3+, DANet и SegFormer. В целом модели показали высокие результаты, правильно классифицируя подавляющее большинство пикселей и улавливая как широкие поймы, так и тонкие ответвления рек. U‑Net++ обеспечила наилучший баланс между точностью и полнотой. Эксперименты также затрагивали более глубокие вопросы: сколько размеченных тайлов действительно нужно, прежде чем точность перестанет заметно расти? Какие сочетания оптических и радарных полос работают лучше всего? И можно ли модель, обученную на данных Gaofen‑3, перенести на другой радарный спутник, Sentinel‑1, без докучающей переобучки? Результаты показывают, что сочетание цветных и ближнеинфракрасных оптических полос вместе с двумя радарными каналами даёт самые качественные карты наводнений, что производительность стабилизируется примерно при наличии порядка тысячи размеченных тайлов, и что модели, обученные на Gaofen‑3, действительно можно применять к Sentinel‑1 с многообещающими результатами.

Что это значит для будущего реагирования на наводнения

Проще говоря, проект Sen2GF3Floods предоставляет высококачественную «тренировочную площадку» для ИИ, обнаруживающего наводнения. Сливая ясные представления о ландшафте до наводнения с радарными снимками во время события и используя схему активного обучения, фокусирующую усилия экспертов на наиболее важных участках, авторы создали набор данных, позволяющий компьютерам быстро и надёжно распознавать наводнения в разных ландшафтах. Это должно помочь руководителям по чрезвычайным ситуациям и специалистам получать быстрые карты больших территорий с меньшими трудозатратами, даже когда небо затянуто облаками или данные поступают с разных спутников. Со временем расширение этого подхода на большее число городов и сельхозрегионов может превратить спутниковые потоки в практичные инструменты почти в реальном времени для защиты людей и инфраструктуры от подъёма воды.

Цитирование: Chen, W., Zhu, Y., Han, W. et al. Sen2GF3Floods: A Benchmark Multi-Source Flood Dataset with Dual-Temporal and Active Learning Annotation. Sci Data 13, 540 (2026). https://doi.org/10.1038/s41597-026-06929-6

Ключевые слова: картирование наводнений, дистанционное зондирование, спутниковые изображения, глубокое обучение, реагирование на чрезвычайные ситуации