Clear Sky Science · de

Sen2GF3Floods: Ein Benchmark-Multiquellen-Flutdatensatz mit dual-temporaler und aktivem Lern-Annotation

Warum intelligentere Flutkarten wichtig sind

Fluten gehören zu den zerstörerischsten Naturkatastrophen, dennoch tun sich Einsatzkräfte oft schwer, genau zu erkennen, wo sich das Wasser ausgebreitet hat, wenn Flüsse über die Ufer treten oder Städte plötzlich überschwemmt werden. Dieser Artikel stellt Sen2GF3Floods vor, eine neue, groß angelegte Sammlung von Satellitenbildern und computerlesbaren Flutkarten, die Künstlicher Intelligenz (KI) dabei helfen soll, Flutwasser schnell und zuverlässig zu verfolgen. Indem verschiedene Arten von Satellitenaufnahmen vor und nach Katastrophen kombiniert und eine intelligente, kostensparende Methode zur Kennzeichnung überfluteter Bereiche genutzt werden, zielt die Arbeit darauf ab, hochqualitative Flutkarten in Echtzeit deutlich breiter verfügbar zu machen.

Wasser aus dem All neu sehen

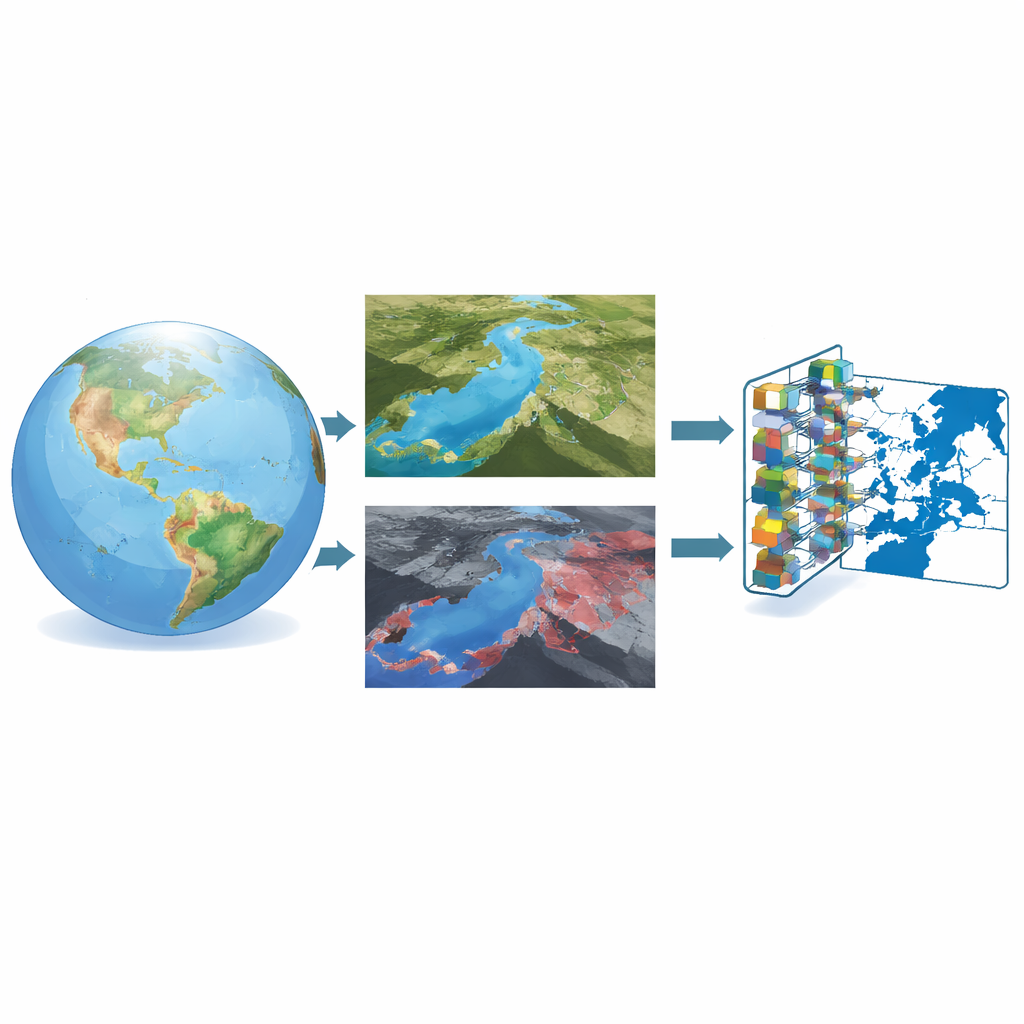

Die Flutkartierung aus dem All beruhte lange Zeit auf zwei Hauptarten von Satellitendaten. Optische Bilder, ähnlich sehr detaillierten Fotografien, zeigen Flüsse, Felder und Stadtblöcke klar — doch Wolken und starker Regen können genau dann die Sicht versperren, wenn Überschwemmungen auftreten. Radarbilder, erzeugt durch das Abstrahlen und Zurückempfangen von Mikrowellensignalen, durchdringen Wolken und funktionieren bei Tag und Nacht, sind aber verrauschter und schwerer für Menschen zu interpretieren. Die Forscher hinter Sen2GF3Floods verbinden die Stärken beider Quellen: klare optische Aufnahmen vor der Flut und Radarbilder, die während der Flut erfasst wurden. Die optischen Bilder liefern eine detaillierte Momentaufnahme der normalen Landschaft, während die Radaraufnahmen zeigen, wo sich Wasser tatsächlich ausbreitet, wenn das Ereignis eintritt.

Aufbau einer umfassenden Bibliothek von Flutereignissen

Damit ein Datensatz für moderne KI-Verfahren nützlich ist, muss er groß, vielfältig und sorgfältig beschriftet sein — und genau das bietet Sen2GF3Floods. Er sammelt Satellitenpatches aus neun großen Flutereignissen in China und deckt dabei Flüsse, Ackerland, Städte und Berge ab. Für jeden Ort sammelte das Team vier Farbkanäle der europäischen Sentinel-2-Optiksatelliten und zwei Radarkanäle der chinesischen Gaofen-3-Mission, alle mit 10-Meter-Auflösung. Diese Bilder wurden in über 21.000 kleine Kacheln zerteilt, die von maschinellen Lernmodellen verarbeitet werden können. Jede Kachel enthält eine einfache Karte, die markiert, welche Pixel überschwemmt sind und welche nicht, sodass Algorithmen die feinen Unterschiede zwischen normalem Wasser, zeitweiliger Überflutung, Schatten und trockenem Land lernen können.

Den Computer entscheiden lassen, was Experten markieren sollten

Ein großer Engpass bei der Erstellung solcher Datensätze ist das manuelle Zeichnen genauer Flutbegrenzungen. Um diesen Aufwand zu reduzieren, entwarfen die Autoren einen dreistufigen, dual-zzeitlichen Annotationsansatz. Zuerst generierten sie automatisch eine grobe Karte des permanenten Wassers aus dem optischen Bild vor der Flut und eine weitere aus dem Radarbild nach der Flut und verglichen die beiden, um abzuschätzen, wo neues Wasser aufgetreten ist. Anschließend verfeinerten menschliche Experten diese groben Karten mithilfe hochauflösender Hintergrundbilder und korrigierten schwierige Bereiche wie Reisterrassen und schmale Wasserläufe. Schließlich trainierten sie ein Segmentierungsnetz — ein ausgefeiltes Mustererkennungsmodell — um Fluten auf den unlabeled Kacheln vorherzusagen und maßen, wo es am unsichersten war. Nur diese „schwierigen“ Kacheln, bei denen das Modell Probleme hatte, wurden zurück an Experten zur sorgfältigen Beschriftung gegeben. Diese Schleife aus Training, Unsicherheitsmessung und gezielter Korrektur ermöglichte es dem Team, den Datensatz zu erweitern und gleichzeitig den manuellen Aufwand zu begrenzen.

Testen, wie gut Maschinen aus den Daten lernen

Mit zusammengetragenem Datensatz bewerteten die Forscher mehrere führende Bild-Segmentierungsmodelle, darunter U-Net, U-Net++, DeepLabV3+, DANet und SegFormer. Insgesamt schnitten die Modelle sehr gut ab, klassifizierten die überwiegende Mehrheit der Pixel korrekt und erfassten sowohl weite Überschwemmungsgebiete als auch feine Flussverzweigungen. U-Net++ bot die beste Gesamtbilanz aus Genauigkeit und Vollständigkeit. Die Experimente gingen auch tiefergehenden Fragen nach: Wie viele beschriftete Kacheln werden tatsächlich benötigt, bevor die Genauigkeit kaum noch steigt? Welche Kombinationen aus optischen und Radar-Kanälen sind am wirkungsvollsten? Und lässt sich ein auf Gaofen-3-Radar trainiertes Modell auf einen anderen Radarsatelliten, Sentinel-1, übertragen, ohne von Grund auf neu zu trainieren? Die Ergebnisse zeigen, dass die Kombination aus Farb- und nahinfraroten optischen Bändern zusammen mit zwei Radar-Kanälen die stärksten Flutkarten liefert, dass die Leistungssteigerung etwa bei tausend beschrifteten Kacheln abflacht, und dass Modelle, die auf Gaofen-3 trainiert wurden, vielversprechend auf Sentinel-1 übertragbar sind.

Was das für künftige Flutabwehr bedeutet

Einfach gesagt liefert das Sen2GF3Floods-Projekt eine hochwertige „Trainingshalle“ für fluterkennende KI. Durch die Verschmelzung klarer Landschaftsansichten vor einer Flut mit Radar-Schnappschüssen während des Ereignisses und durch ein Active-Learning-Schema, das die Expertenarbeit dort konzentriert, wo sie am meisten bewirkt, haben die Autoren einen Datensatz geschaffen, der Computern erlaubt, Fluten schnell und zuverlässig in vielen Geländetypen zu erkennen. Diese Grundlage sollte Einsatzleitern und Wissenschaftlern helfen, rasch großflächige Flutkarten mit weniger manueller Arbeit zu erzeugen — selbst wenn Wolken den Himmel verdecken oder Daten von unterschiedlichen Satelliten stammen müssen. Mittelfristig könnte die Ausweitung dieses Ansatzes auf weitere Städte und Agrarregionen Satellitenströme in brauchbare, nahezu in Echtzeit verfügbare Werkzeuge zum Schutz von Menschen und Infrastruktur vor steigendem Wasser verwandeln.

Zitation: Chen, W., Zhu, Y., Han, W. et al. Sen2GF3Floods: A Benchmark Multi-Source Flood Dataset with Dual-Temporal and Active Learning Annotation. Sci Data 13, 540 (2026). https://doi.org/10.1038/s41597-026-06929-6

Schlüsselwörter: Flutkartierung, Fernerkundung, Satellitenbilder, Tiefes Lernen, Katastrophenhilfe