Clear Sky Science · pt

Potencial dos grandes modelos de linguagem para suporte clínico rápido de informação: evidências a partir de testes de conhecimento sobre lesão renal aguda

Por que isso importa para pacientes e médicos

Quando médicos atendem um paciente grave, especialmente alguém cujos rins podem estar falhando, precisam tomar decisões rápidas e bem informadas. Este estudo faz uma pergunta instigante: as modernas ferramentas de inteligência artificial, conhecidas como grandes modelos de linguagem, conseguem recordar e aplicar fatos médicos sobre lesão renal aguda mais rápida e precisamente do que clínicos reais — e, em caso afirmativo, o que isso significa para o cuidado futuro?

Um problema renal comum, mas perigoso

A lesão renal aguda é uma perda súbita da função renal que frequentemente surge em enfermarias e pronto‑socorros. Pode afetar cerca de uma em cada dez pessoas internadas no hospital, e até metade daqueles em unidades de terapia intensiva. Se for perdida a detecção ou o tratamento for tardio, os pacientes podem sofrer danos permanentes e evoluir para doença renal crônica, uma condição de longo prazo que afeta mais de uma em cada dez pessoas no mundo e está associada a maior risco de morte, doenças cardíacas e redução da qualidade de vida. Por isso, espera‑se que os médicos saibam identificar a lesão renal aguda precocemente e manejá‑la conforme diretrizes estabelecidas.

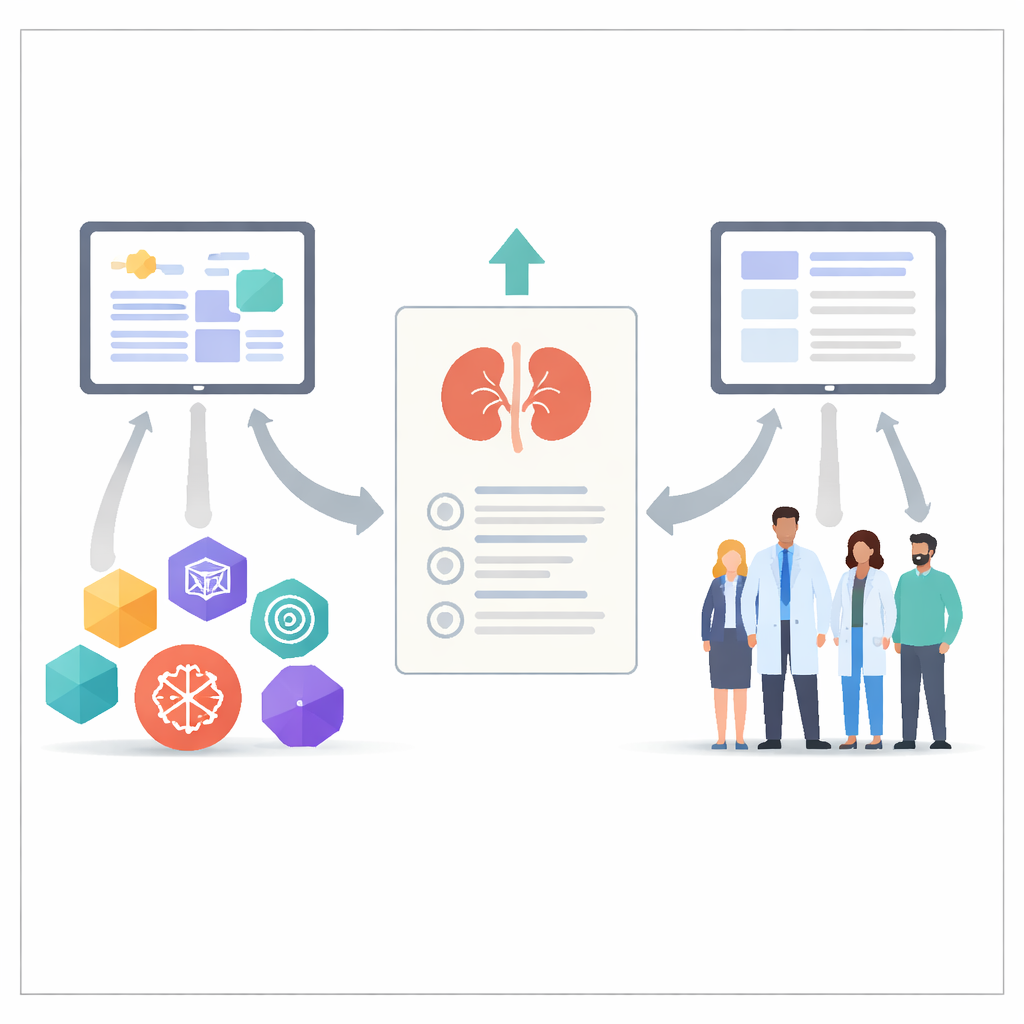

Organizando um desafio homem‑versus‑máquina

Para avaliar como a inteligência artificial lida com o tema, os pesquisadores organizaram um desafio “IA vs. humano” em uma grande conferência de medicina interna na Alemanha em 2025. Em um estande de autoatendimento, 123 voluntários — desde estudantes de medicina até chefes de serviço — fizeram o mesmo questionário online. O teste baseou‑se em duas histórias curtas de pacientes com problemas renais e em 15 questões de múltipla escolha fundamentadas em diretrizes, todas em alemão. Ao mesmo tempo, 13 modelos de linguagem de acesso público de vários provedores conhecidos receberam os mesmos casos e perguntas de uma só vez, usando suas configurações padrão. Esse desenho permitiu à equipe comparar diretamente com que precisão e rapidez clínicos e máquinas lidavam com um recorte focalizado do conhecimento sobre rins.

Como humanos e máquinas se saíram

Os resultados foram contundentes. Em média, os participantes humanos responderam corretamente a menos da metade das questões, marcando cerca de 7 em 15 pontos. As pontuações não variaram muito entre estudantes, residentes e médicos seniores, embora os estudantes tenham mostrado a maior dispersão. Os modelos de linguagem, em contraste, tiveram média de 13,5 em 15 pontos, ou 90% de acerto. Vários modelos alcançaram nota máxima, enquanto o mais fraco ainda igualou ou superou a maioria dos humanos. Apenas cerca de um em cada seis participantes atingiu o desempenho dos modelos com pontuação mais baixa, e muito poucos chegaram perto dos sistemas mais fortes. A diferença de velocidade foi igualmente notável: um modelo completou todo o questionário em aproximadamente 30 segundos, enquanto os humanos demoraram mais de sete minutos em média.

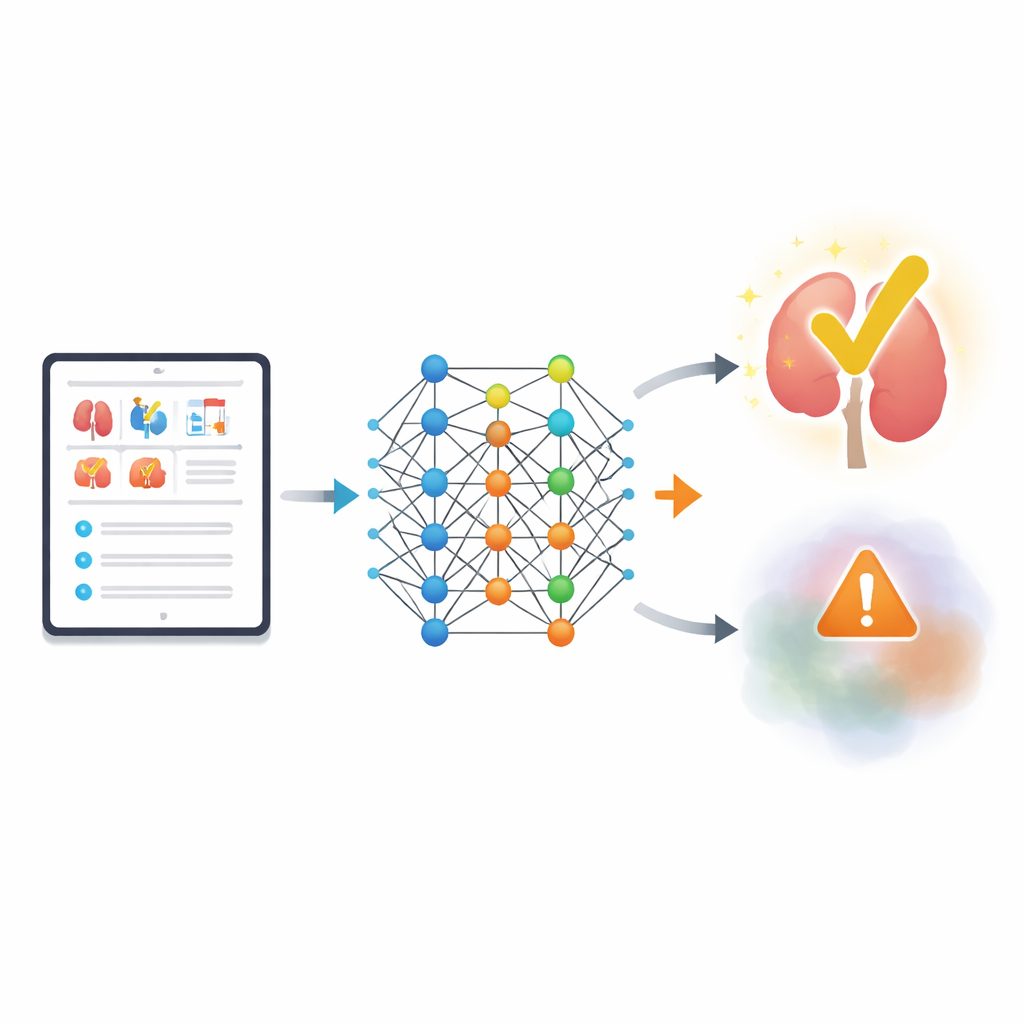

Promessas e riscos de respostas relâmpago

Essas descobertas sugerem que grandes modelos de linguagem podem servir como ferramentas poderosas e de baixo custo para acesso rápido a fatos médicos, especialmente em contextos onde tempo e pessoal são limitados, como pronto‑socorros, turnos noturnos ou clínicas rurais. O estudo também indica que a forma como a pergunta é colocada importa: em um pequeno acompanhamento, um modelo foi ainda melhor quando solicitado a responder como se fosse um médico experiente em uma situação de vida ou morte. Ainda assim, os autores ressaltam que o teste mediu apenas a recordação de fatos baseados em diretrizes em um questionário controlado, não o raciocínio clínico completo, o julgamento à beira do leito ou os desfechos reais dos pacientes.

Por que o julgamento humano continua em primeiro lugar

Os pesquisadores enfatizam que os modelos de linguagem atuais também têm fraquezas sérias. Eles podem “alucinar”, produzindo com confiança afirmações falsas ou enganosas — um risco que pode aumentar em casos raros ou complexos onde as diretrizes não oferecem respostas claras. Não conseguem examinar um paciente, captar pistas físicas sutis ou transmitir empatia e confiança, aspectos centrais para um bom cuidado. Questões éticas e legais também são relevantes: os modelos mudam ao longo do tempo, podem tratar dados de maneiras opacas e não podem assumir responsabilidade por decisões médicas. Por essas razões, os autores defendem que tais sistemas sejam usados apenas como ferramentas de apoio para recuperação de conhecimento e auxílio à decisão, com salvaguardas claras, testes regulares e regras rígidas de privacidade.

Mensagem principal para não‑especialistas

Em resumo, este estudo mostra que os modelos de linguagem modernos podem superar muitos médicos e estudantes em um questionário escrito focado sobre lesão renal aguda — e fazê‑lo em uma fração do tempo. Isso os torna companheiros promissores para consultar fatos médicos rapidamente. Mas, como ainda podem cometer erros confiantes e carecem de compreensão humana, não substituem os clínicos. No futuro previsível, o melhor cuidado virá de um equilíbrio entre ferramentas rápidas e bem projetadas e o julgamento cuidadoso e empático de profissionais treinados.

Citação: Russ, P., Bedenbender, S., Einloft, J. et al. Potential of large language models for rapid clinical information support: evidence from acute kidney injury knowledge testing. Sci Rep 16, 11224 (2026). https://doi.org/10.1038/s41598-026-46846-7

Palavras-chave: lesão renal aguda, grandes modelos de linguagem, suporte à decisão clínica, saúde digital, nefrologia