Clear Sky Science · es

Potencial de los modelos de lenguaje grandes para apoyo clínico rápido: evidencia de pruebas de conocimiento sobre lesión renal aguda

Por qué esto importa para pacientes y médicos

Cuando los médicos atienden a un paciente grave, especialmente alguien cuyos riñones pueden estar fallando, deben tomar decisiones rápidas y bien informadas. Este estudio plantea una pregunta llamativa: ¿pueden las modernas herramientas de inteligencia artificial, conocidas como modelos de lenguaje grandes, recuperar y aplicar hechos médicos sobre la lesión renal aguda más rápido y con mayor precisión que los clínicos reales —y, en caso afirmativo, qué implicaría eso para la atención futura?

Un problema renal frecuente pero peligroso

La lesión renal aguda es una pérdida repentina de la función renal que a menudo aparece en plantas hospitalarias y salas de urgencias. Puede afectar aproximadamente a una de cada diez personas ingresadas en el hospital, y hasta a la mitad de las que están en cuidados intensivos. Si se pasa por alto o se trata demasiado tarde, los pacientes pueden sufrir daño irreversible y desarrollar enfermedad renal crónica, una condición a largo plazo que afecta a más de una de cada diez personas en el mundo y se asocia con mayor riesgo de muerte, enfermedad cardiaca y menor calidad de vida. Por ello, se espera que los médicos sepan detectar la lesión renal aguda tempranamente y manejarla según las guías establecidas.

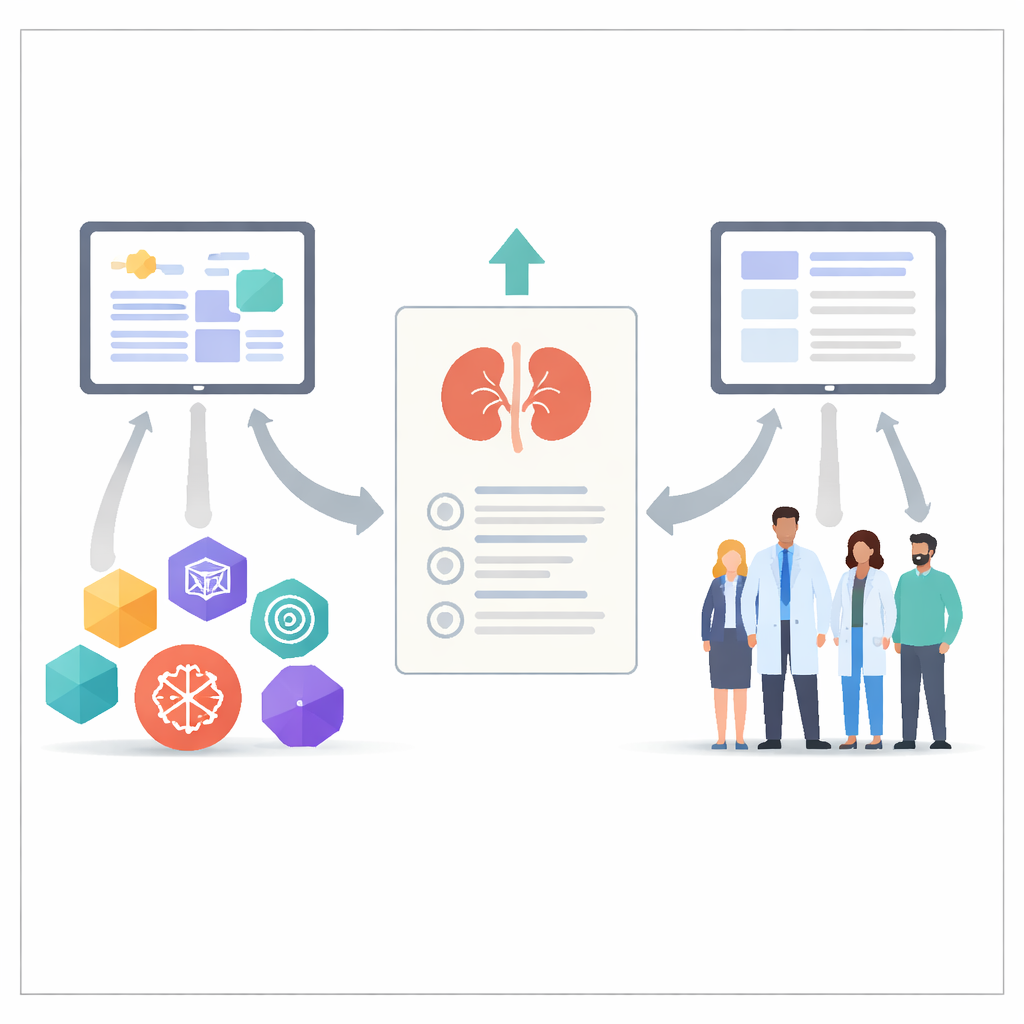

Preparando un reto hombre contra máquina

Para probar qué tan bien maneja este tema la inteligencia artificial, los investigadores organizaron un reto “IA vs. humano” en una gran conferencia de medicina interna en Alemania en 2025. En un stand de autoservicio, 123 voluntarios —desde estudiantes de medicina hasta jefes de departamento— realizaron el mismo cuestionario en línea. La prueba se basó en dos breves historias de pacientes con problemas renales y 15 preguntas de opción múltiple basadas en guías, todas en alemán. Al mismo tiempo, 13 modelos de lenguaje públicamente disponibles de varios proveedores conocidos recibieron los mismos casos y preguntas de una sola vez, utilizando sus ajustes estándar. Este diseño permitió al equipo comparar directamente con qué precisión y rapidez manejaban los clínicos y las máquinas una porción concreta del conocimiento sobre riñón.

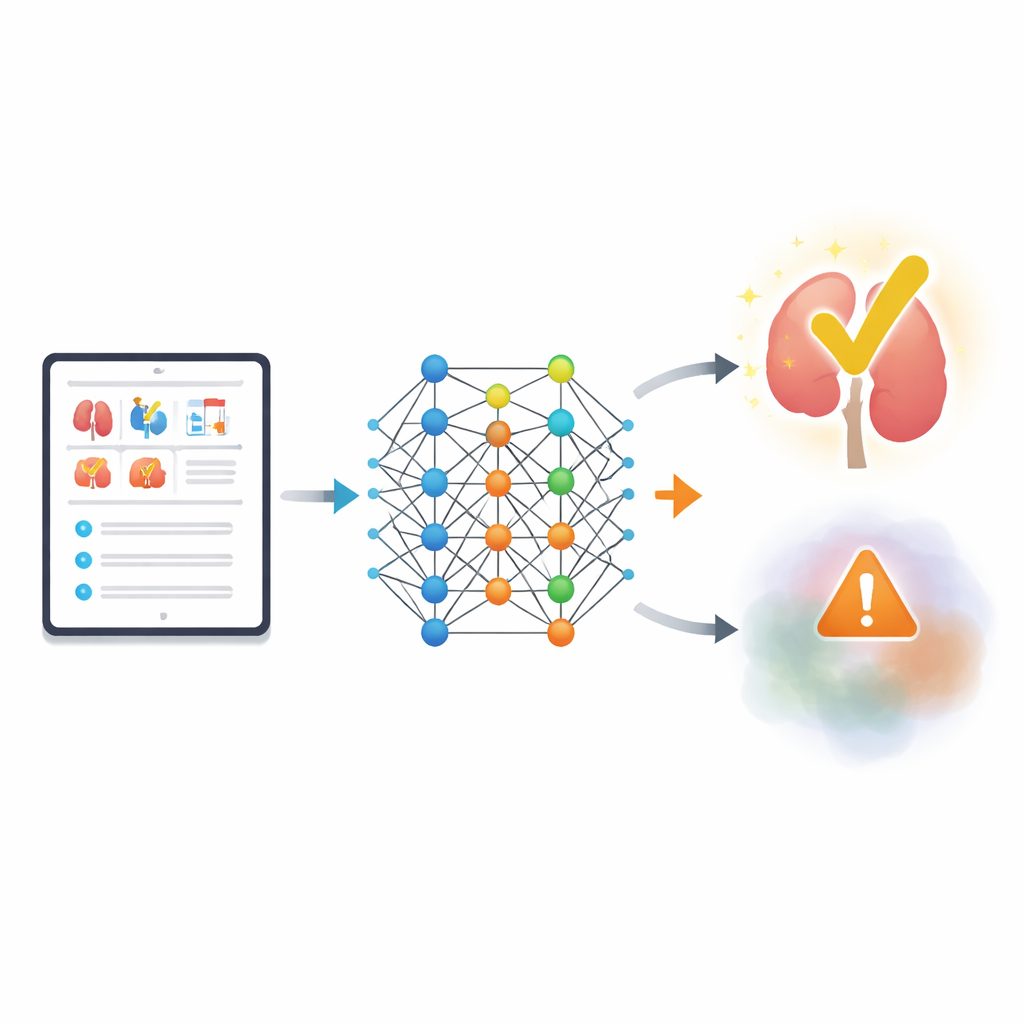

Cómo se desempeñaron humanos y máquinas

Los resultados fueron contundentes. En promedio, los participantes humanos respondieron correctamente a menos de la mitad de las preguntas, obteniendo alrededor de 7 de 15 puntos. Las puntuaciones no variaron mucho entre estudiantes, residentes y médicos sénior, aunque los estudiantes mostraron la mayor dispersión. Los modelos de lenguaje, en contraste, promediaron 13,5 de 15 puntos, es decir, un 90 % de aciertos. Varios modelos alcanzaron la puntuación perfecta, mientras que los más débiles igualaron o superaron a la mayoría de los humanos. Solo alrededor de uno de cada seis participantes igualó el rendimiento de los modelos con menor puntuación, y muy pocos se aproximaron a los sistemas más sólidos. La brecha de velocidad fue igual de notable: un modelo completó todo el cuestionario en aproximadamente 30 segundos, mientras que los humanos necesitaron más de siete minutos de media.

Promesas y riesgos de respuestas ultrarrápidas

Estos hallazgos sugieren que los modelos de lenguaje grandes podrían servir como herramientas potentes y de bajo coste para acceder rápidamente a hechos médicos, sobre todo en entornos donde el tiempo y el personal son limitados, como urgencias, guardias nocturnas o clínicas rurales. El estudio también insinúa que la forma en que se formula una pregunta importa: en un pequeño seguimiento, un modelo rindió aún mejor cuando se le pidió responder como si fuera un médico experimentado en una situación de vida o muerte. Aun así, los autores subrayan que la prueba midió solo la evocación de hechos basados en guías en un cuestionario controlado, no un razonamiento clínico completo, el juicio en la cama del paciente ni resultados reales en personas.

Por qué el juicio humano sigue siendo prioritario

Los investigadores enfatizan que los modelos de lenguaje actuales también presentan debilidades serias. Pueden “alucinar”, produciendo con seguridad afirmaciones falsas o engañosas, un riesgo que puede aumentar en casos raros o complejos donde las guías no ofrecen respuestas claras. No pueden examinar a un paciente, detectar pistas físicas sutiles ni transmitir empatía y confianza, aspectos centrales de una buena atención. También están las cuestiones éticas y legales: los modelos cambian con el tiempo, pueden tratar los datos de maneras opacas y no pueden asumir responsabilidad por decisiones médicas. Por estas razones, los autores sostienen que tales sistemas deberían usarse solo como herramientas de apoyo para la recuperación de conocimientos y ayuda a la decisión, con salvaguardas claras, pruebas periódicas y estrictas normas de privacidad.

Mensaje para no expertos

En resumen, este estudio muestra que los modelos de lenguaje modernos pueden superar a muchos médicos y estudiantes en un cuestionario escrito focalizado sobre lesión renal aguda —y hacerlo en una fracción del tiempo. Esto los convierte en compañeros prometedores para consultar hechos médicos de forma rápida. Pero dado que aún pueden cometer errores con confianza y carecen de comprensión humana, no son sustitutos de los clínicos. En un futuro previsible, la mejor atención vendrá de la combinación de herramientas rápidas y bien diseñadas con el juicio cuidadoso y empático de profesionales formados.

Cita: Russ, P., Bedenbender, S., Einloft, J. et al. Potential of large language models for rapid clinical information support: evidence from acute kidney injury knowledge testing. Sci Rep 16, 11224 (2026). https://doi.org/10.1038/s41598-026-46846-7

Palabras clave: lesión renal aguda, modelos de lenguaje grandes, soporte a la decisión clínica, salud digital, nefrología