Clear Sky Science · pl

Potencjał dużych modeli językowych do szybkiego wsparcia informacji klinicznej: dowody z testów wiedzy o ostrej niewydolności nerek

Dlaczego to ma znaczenie dla pacjentów i lekarzy

Gdy lekarze mają do czynienia z ciężko chorym pacjentem, zwłaszcza kimś, kto może mieć niewydolność nerek, muszą podejmować szybkie, dobrze uargumentowane decyzje. To badanie stawia prowokujące pytanie: czy nowoczesne narzędzia sztucznej inteligencji, znane jako duże modele językowe, potrafią szybciej i dokładniej przypominać oraz stosować fakty medyczne dotyczące ostrej niewydolności nerek niż realni klinicyści — a jeśli tak, co to oznacza dla przyszłej opieki?

Pospolity, ale groźny problem nerek

Ostra niewydolność nerek to nagła utrata czynności nerek, która często pojawia się na oddziałach szpitalnych i w izbach przyjęć. Może dotyczyć około jednej na dziesięć osób przyjmowanych do szpitala, a nawet do połowy pacjentów na oddziałach intensywnej terapii. Jeśli zostanie przeoczona lub leczona zbyt późno, pacjenci mogą doznać trwałego uszkodzenia i rozwinąć przewlekłą chorobę nerek — schorzenie długotrwałe dotykające ponad jedną na dziesięć osób na świecie, związane z wyższym ryzykiem zgonu, chorób serca i obniżonej jakości życia. Z tego powodu od lekarzy oczekuje się umiejętności wczesnego rozpoznania ostrej niewydolności nerek i postępowania zgodnie z obowiązującymi wytycznymi.

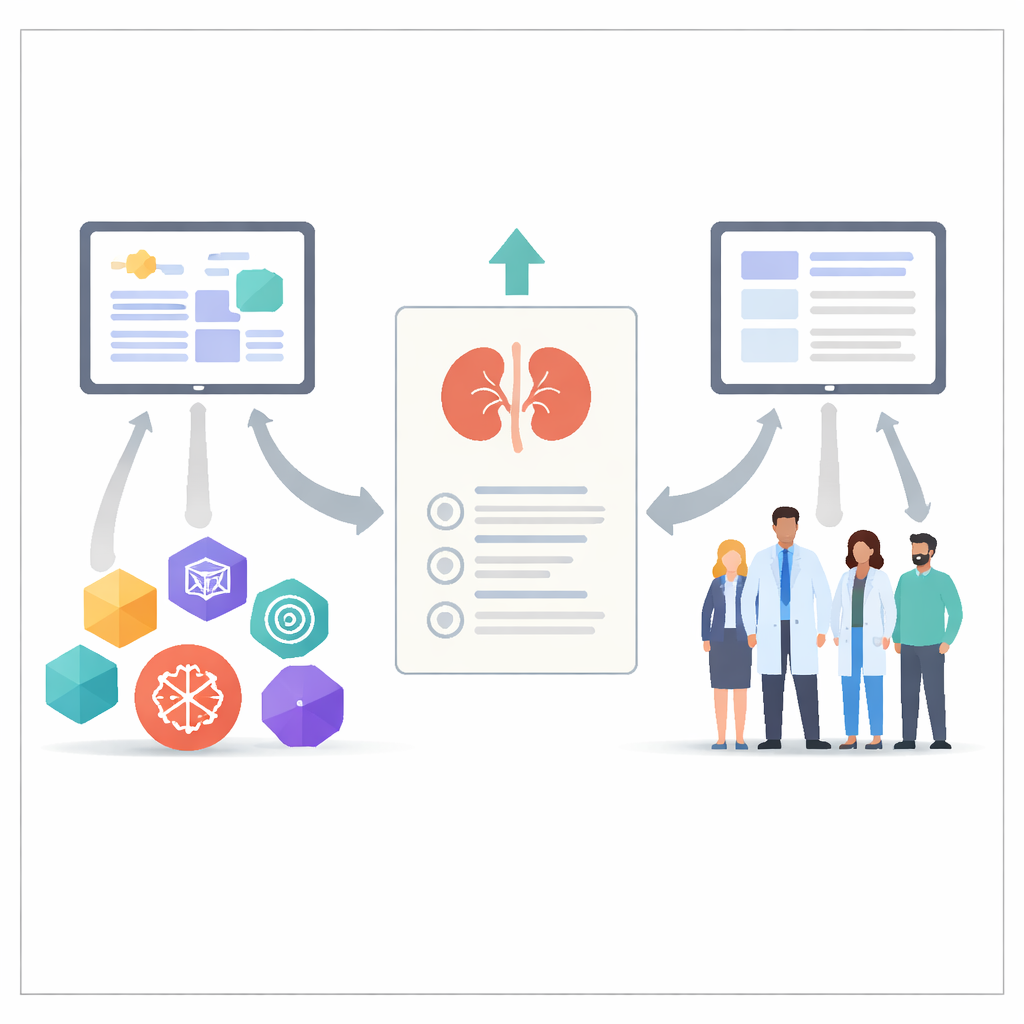

Organizacja wyzwania człowiek kontra maszyna

Aby sprawdzić, jak dobrze sztuczna inteligencja radzi sobie z tym tematem, badacze zorganizowali konkurs „AI kontra człowiek” na dużej konferencji z zakresu medycyny wewnętrznej w Niemczech w 2025 r. Na stoisku samoobsługowym 123 ochotników — od studentów medycyny po ordynatorów — rozwiązywało ten sam quiz online. Test oparto na dwóch krótkich opisach pacjentów z problemami nerkowymi oraz 15 pytaniach wielokrotnego wyboru opartych na wytycznych, wszystkie w języku niemieckim. Jednocześnie 13 publicznie dostępnych modeli językowych od kilku znanych dostawców otrzymało te same przypadki i pytania jednocześnie, przy użyciu standardowych ustawień. Taki układ pozwolił zespołowi bezpośrednio porównać, jak dokładnie i jak szybko klinicyści i maszyny radzą sobie z wycinkiem wiedzy nefrologicznej.

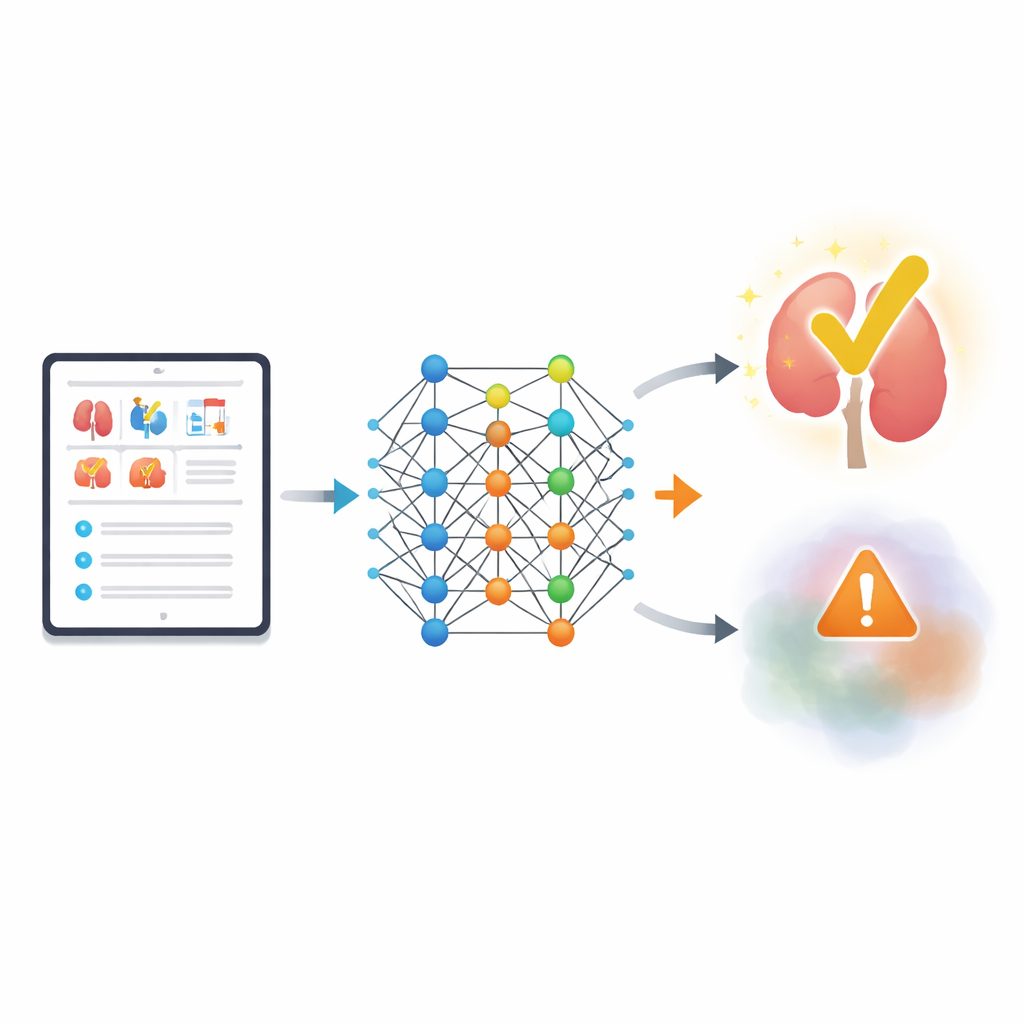

Jak poradzili sobie ludzie i maszyny

Wyniki były wyraźne. Średnio uczestnicy ludzie poprawnie odpowiedzieli na mniej niż połowę pytań, zdobywając około 7 z 15 punktów. Wyniki niewiele różniły się między studentami, rezydentami a starszymi lekarzami, choć studenci wykazywali największe rozrzuty. Modele językowe w przeciwieństwie do tego osiągnęły średnio 13,5 z 15 punktów, czyli 90% poprawności. Kilka modeli otrzymało wynik idealny, podczas gdy najsłabszy wciąż dorównywał lub przewyższał większość ludzi. Tylko około jeden na sześciu uczestników osiągnął wydajność równą najniżej punktowanym modelom, a bardzo niewielu zbliżyło się do najsilniejszych systemów. Różnica w czasie była równie znacząca: jeden model zakończył cały quiz w około 30 sekund, podczas gdy ludzie potrzebowali średnio ponad siedmiu minut.

Obietnica i ryzyka błyskawicznych odpowiedzi

Te ustalenia sugerują, że duże modele językowe mogą służyć jako potężne, niskokosztowe narzędzia do szybkiego dostępu do faktów medycznych, zwłaszcza w warunkach, gdzie czas i personel są ograniczone — na przykład w izbach przyjęć, podczas nocnych dyżurów czy w klinikach wiejskich. Badanie wskazuje też, że sposób sformułowania pytania ma znaczenie: w niewielkim badaniu uzupełniającym jeden model wypadł jeszcze lepiej, gdy poproszono go o odpowiedź, jakby był doświadczonym lekarzem w sytuacji zagrożenia życia. Niemniej autorzy podkreślają, że test mierzył jedynie odtwarzanie faktów opartych na wytycznych w kontrolowanym quizie, a nie pełne rozumowanie kliniczne, ocenę przyłóżkową czy rzeczywiste wyniki leczenia pacjentów.

Dlaczego osąd ludzki wciąż jest najważniejszy

Badacze podkreślają, że dzisiejsze modele językowe mają także poważne słabości. Mogą „halucynować”, czyli pewnie formułować fałszywe lub wprowadzające w błąd stwierdzenia — ryzyko to może wzrastać w rzadkich lub złożonych przypadkach, gdzie wytyczne nie dają jednoznacznych odpowiedzi. Nie potrafią zbadać pacjenta, wychwycić subtelnych oznak fizycznych ani okazywać empatii i budować zaufania, a to wszystko jest kluczowe dla dobrej opieki. Pojawiają się też poważne pytania etyczne i prawne: modele zmieniają się w czasie, mogą przetwarzać dane w nieprzejrzysty sposób i nie mogą ponosić odpowiedzialności za decyzje medyczne. Z tych powodów autorzy argumentują, że takie systemy powinny być używane jedynie jako narzędzia wspomagające wyszukiwanie wiedzy i pomoc w podejmowaniu decyzji, z wyraźnymi zabezpieczeniami, regularnym testowaniem i surowymi zasadami prywatności.

Wnioski dla osób niebędących ekspertami

Krótko mówiąc, badanie pokazuje, że nowoczesne modele językowe potrafią przewyższać wielu lekarzy i studentów w skoncentrowanym pisemnym teście dotyczącym ostrej niewydolności nerek — i robić to w ułamku czasu. Czyni to je obiecującymi towarzyszami do szybkiego wyszukiwania faktów medycznych. Jednak ponieważ wciąż mogą popełniać pewne, przekonujące błędy i brakuje im ludzkiego rozumienia, nie zastępują klinicystów. Przez dającą się przewidzieć przyszłość najlepsza opieka będzie wynikiem połączenia szybkich, dobrze zaprojektowanych narzędzi i uważnego, empatycznego osądu wykwalifikowanych profesjonalistów.

Cytowanie: Russ, P., Bedenbender, S., Einloft, J. et al. Potential of large language models for rapid clinical information support: evidence from acute kidney injury knowledge testing. Sci Rep 16, 11224 (2026). https://doi.org/10.1038/s41598-026-46846-7

Słowa kluczowe: ostra niewydolność nerek, duże modele językowe, wsparcie decyzji klinicznych, zdrowie cyfrowe, nefrologia