Clear Sky Science · de

Potenzial großer Sprachmodelle für schnelle klinische Informationsunterstützung: Evidenz aus Tests zum Wissen über akutes Nierenversagen

Warum das für Patientinnen, Patienten und Ärztinnen, Ärzte wichtig ist

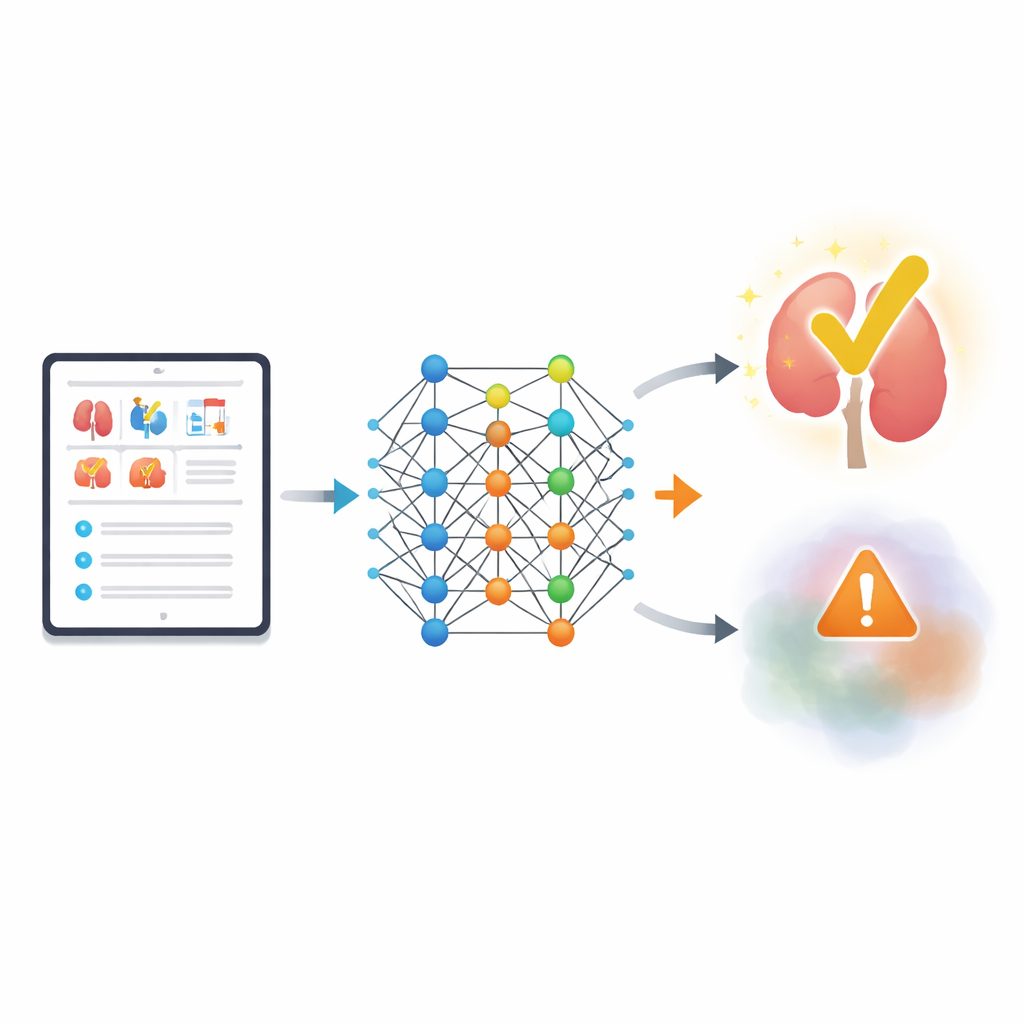

Wenn Ärztinnen und Ärzte mit einem kranken Patienten konfrontiert sind, insbesondere mit jemandem, bei dem die Nieren versagen könnten, müssen sie rasch gut informierte Entscheidungen treffen. Diese Studie stellt eine prägnante Frage: Können moderne Werkzeuge der künstlichen Intelligenz, sogenannte große Sprachmodelle, medizinische Fakten zum akuten Nierenversagen schneller und genauer abrufen und anwenden als reale Klinikerinnen und Kliniker — und wenn ja, welche Konsequenzen hätte das für die künftige Versorgung?

Ein häufiges, aber gefährliches Nierenproblem

Akutes Nierenversagen ist ein plötzlicher Funktionsverlust der Nieren, der häufig auf Stationen und in Notaufnahmen auftritt. Es kann etwa eine von zehn hospitalisierten Personen betreffen und bis zu der Hälfte der Intensivpatienten. Wird es übersehen oder zu spät behandelt, können Patientinnen und Patienten bleibende Schäden erleiden und eine chronische Nierenerkrankung entwickeln — eine langfristige Erkrankung, die mehr als eine von zehn Personen weltweit betrifft und mit höherer Sterblichkeit, Herzkrankheiten und einer verminderten Lebensqualität verbunden ist. Daher wird von Ärztinnen und Ärzten erwartet, akutes Nierenversagen früh zu erkennen und entsprechend etablierter Leitlinien zu behandeln.

Aufsetzen eines Mensch‑gegen‑Maschine‑Vergleichs

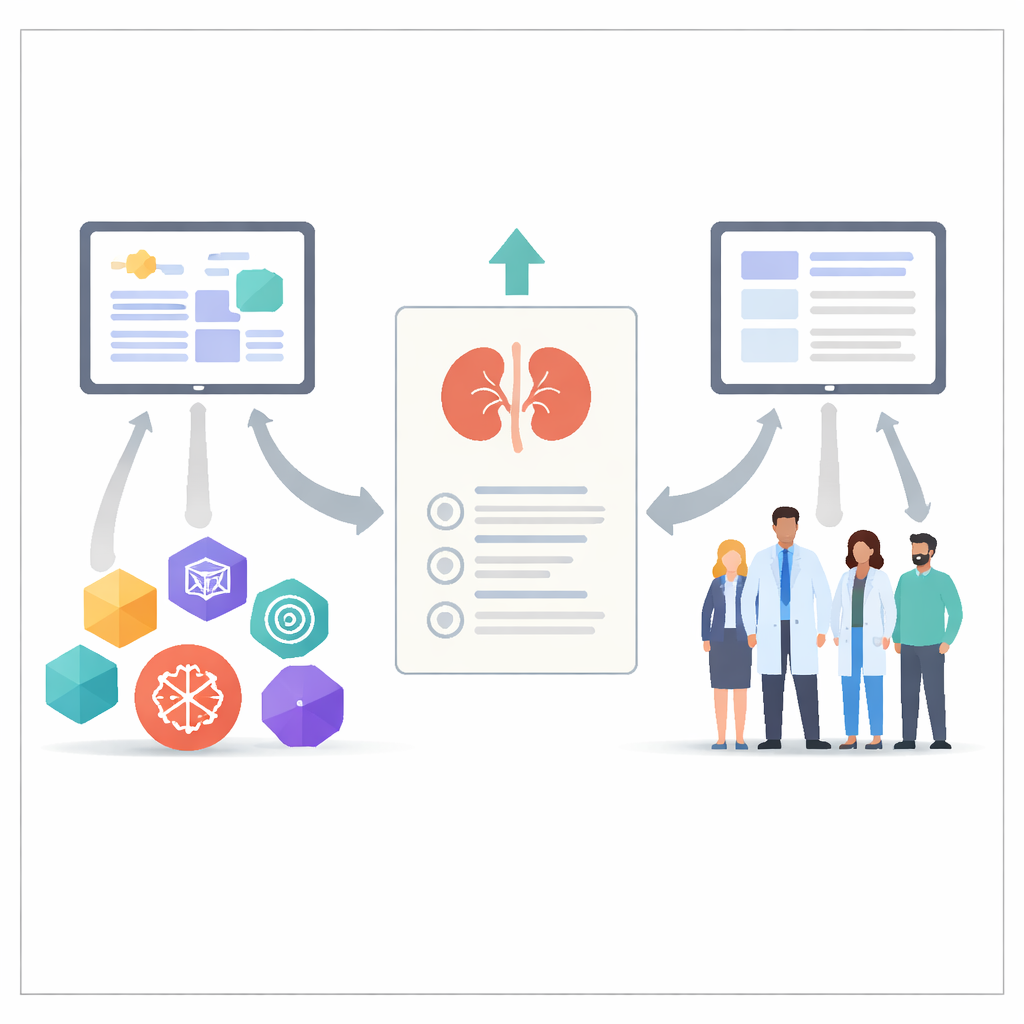

Um zu prüfen, wie gut künstliche Intelligenz dieses Thema beherrscht, organisierten die Forschenden eine „KI gegen Mensch“-Challenge auf einer großen inneren Medizin Konferenz in Deutschland im Jahr 2025. An einem Selbstbedienungsstand nahmen 123 Freiwillige — von Medizinstudierenden bis zu Chefarztpositionen — am gleichen Online‑Quiz teil. Der Test basierte auf zwei kurzen Patientengeschichten zu Nierenproblemen und 15 leitlinienbasierten Multiple‑Choice‑Fragen, alle auf Deutsch. Gleichzeitig wurden 13 öffentlich verfügbare Sprachmodelle mehrerer bekannter Anbieter mit denselben Fällen und Fragen in einem Durchgang gefüttert, in ihren Standardeinstellungen. Dieses Design erlaubte dem Team, direkt zu vergleichen, wie genau und wie schnell Klinikerinnen, Kliniker und Maschinen ein eng umrissenes Wissensgebiet zur Niere bearbeiteten.

Wie Menschen und Maschinen abschnitten

Die Ergebnisse waren deutlich. Im Durchschnitt beantworteten die menschlichen Teilnehmenden weniger als die Hälfte der Fragen korrekt und erreichten etwa 7 von 15 Punkten. Die Punktzahlen unterschieden sich kaum zwischen Studierenden, Assistenzärztinnen und -ärzten sowie Chefärztinnen und -ärzten, wobei Studierende die größte Streuung zeigten. Die Sprachmodelle erzielten im Gegenzug im Schnitt 13,5 von 15 Punkten, also 90 % richtig. Mehrere Modelle erreichten die Höchstpunktzahl, während die schwächsten Modelle dennoch mit den meisten Menschen gleichzogen oder sie übertrafen. Nur etwa einer von sechs Teilnehmenden erreichte die Leistung der niedrigstplatzierenden Modelle, und sehr wenige kamen den stärksten Systemen nahe. Die Geschwindigkeit unterschied sich ebenso markant: Ein Modell löste das gesamte Quiz in etwa 30 Sekunden, während Menschen im Mittel mehr als sieben Minuten benötigten.

Versprechen und Risiken blitzschneller Antworten

Diese Befunde deuten darauf hin, dass große Sprachmodelle als leistungsfähige, kostengünstige Werkzeuge für den schnellen Zugriff auf medizinische Fakten dienen könnten — insbesondere in Situationen mit knapper Zeit und begrenztem Personal, wie Notaufnahmen, Nachtschichten oder ländlichen Kliniken. Die Studie weist außerdem darauf hin, dass die Formulierung einer Frage eine Rolle spielt: In einer kleinen Nachuntersuchung erzielte ein Modell bessere Ergebnisse, wenn es aufgefordert wurde, so zu antworten, als sei es eine erfahrene Ärztin oder ein erfahrener Arzt in einer lebensbedrohlichen Situation. Dennoch betonen die Autorinnen und Autoren, dass der Test nur das Abrufen leitlinienbasierter Fakten in einem kontrollierten Quizmaßstab erfasste, nicht vollständiges klinisches Denken, Entscheidungsfindung am Krankenbett oder reale Patientenergebnisse.

Warum menschliches Urteilsvermögen weiterhin vorrangig ist

Die Forschenden heben hervor, dass heutige Sprachmodelle auch schwerwiegende Schwächen haben. Sie können „halluzinieren“, also selbstbewusst falsche oder irreführende Aussagen erzeugen — ein Risiko, das in seltenen oder komplexen Fällen wächst, in denen Leitlinien keine klaren Antworten liefern. Sie können einen Patienten nicht untersuchen, subtile körperliche Hinweise nicht wahrnehmen und kein Einfühlungsvermögen oder Vertrauen vermitteln, die allesamt zentral für gute Versorgung sind. Ethische und rechtliche Fragen sind ebenfalls zentral: Modelle ändern sich im Laufe der Zeit, können Daten auf undurchsichtige Weise verarbeiten und können nicht die Verantwortung für medizinische Entscheidungen übernehmen. Aus diesen Gründen argumentieren die Autorinnen und Autoren, dass solche Systeme nur als unterstützende Werkzeuge für Wissensabruf und Entscheidungsunterstützung verwendet werden sollten — mit klaren Schutzmaßnahmen, regelmäßigen Tests und strengen Datenschutzregeln.

Kernaussage für Nicht‑Expertinnen und Nicht‑Experten

Kurz gesagt zeigt diese Studie, dass moderne Sprachmodelle viele Ärztinnen und Ärzte sowie Studierende in einem fokussierten schriftlichen Quiz zum akuten Nierenversagen übertreffen können — und das in einem Bruchteil der Zeit. Das macht sie zu vielversprechenden Hilfsmitteln, um medizinische Fakten schnell nachzuschlagen. Weil sie jedoch weiterhin selbstbewusste Fehler machen können und menschliches Verständnis fehlt, sind sie kein Ersatz für Klinikerinnen und Kliniker. Voraussichtlich wird die beste Versorgung auch künftig aus einer Kombination schneller, gut gestalteter Werkzeuge und dem sorgfältigen, einfühlsamen Urteil ausgebildeter Fachkräfte bestehen.

Zitation: Russ, P., Bedenbender, S., Einloft, J. et al. Potential of large language models for rapid clinical information support: evidence from acute kidney injury knowledge testing. Sci Rep 16, 11224 (2026). https://doi.org/10.1038/s41598-026-46846-7

Schlüsselwörter: akutes Nierenversagen, große Sprachmodelle, klinische Entscheidungsunterstützung, digitale Gesundheit, Nephrologie