Clear Sky Science · pt

Um método de detecção de fadiga baseado na análise da postura do motorista e do estado facial

Por que motoristas cansados importam para todos

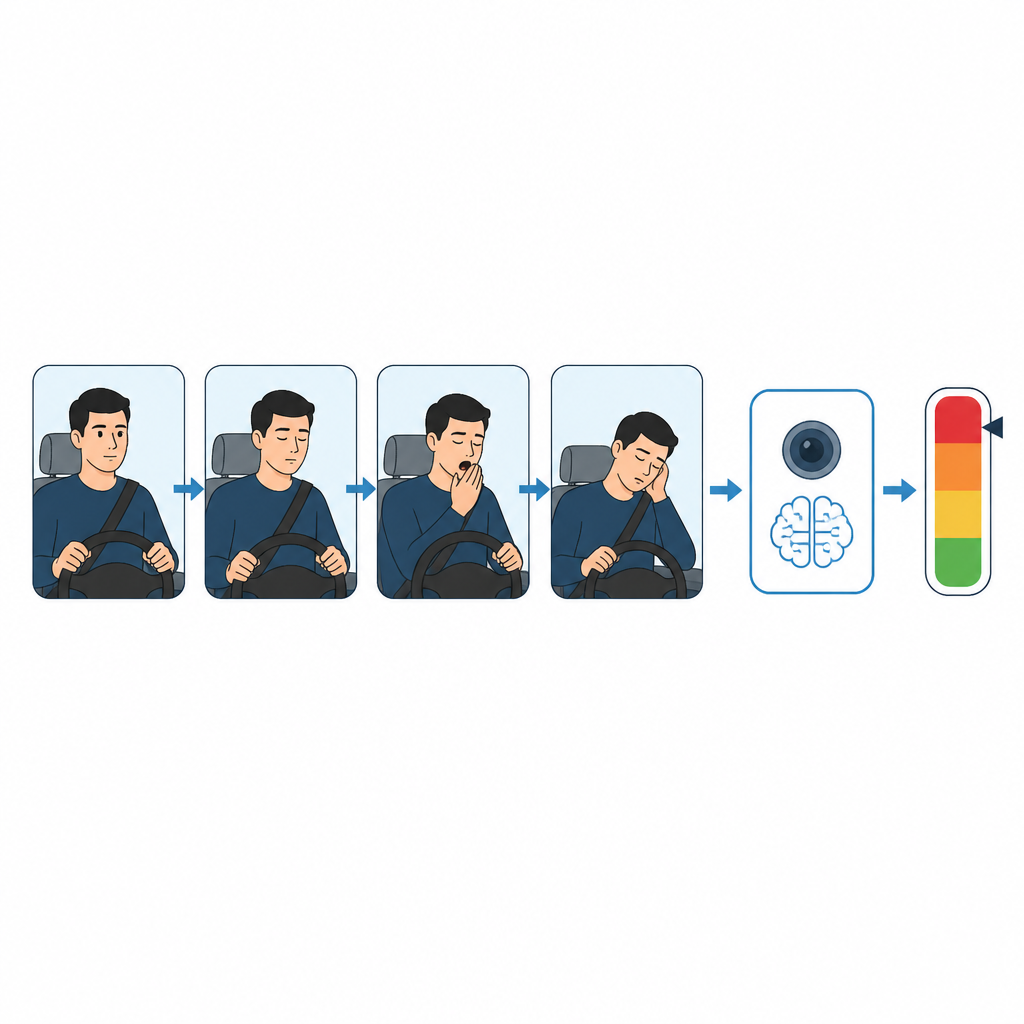

Muitos de nós já sentimos as pálpebras pesarem numa viagem longa, mas poucos percebem com que frequência esse momento de sonolência termina em acidente. Este artigo descreve um sistema baseado em câmera que observa o rosto, a postura e as mãos do motorista para identificar sinais precoces de fadiga e emitir alertas no momento certo, sem precisar prender sensores ao corpo nem alterar a forma de dirigir.

Vendo o motorista, não apenas o carro

Agências de trânsito estimam que a fadiga contribui para uma grande parte dos acidentes graves no mundo. Sistemas de alerta tradicionais têm se concentrado em sinais do próprio veículo, como correções de direção ou saídas de faixa, ou em sensores de tipo médico que monitoram atividade cerebral ou cardíaca. Esses métodos podem ser caros, desconfortáveis ou pouco confiáveis quando motoristas ou condições viárias variam. O estudo, em vez disso, se apoia em vídeo comum de pequenas câmeras dentro do carro para interpretar diretamente o comportamento do motorista, usando inteligência artificial moderna para analisar o que é visto.

Lendo olhos, boca, cabeça e mãos

Os pesquisadores primeiro descrevem em termos cotidianos como é a condução cansada. Sinais de alerta incluem piscadas mais lentas e longas, bocejos repetidos, cabeça caída ou inclinada e mãos escorregando do volante. Usando um método de estimação de pose chamado AlphaPose, o sistema acompanha 119 pontos-chave no corpo do motorista, especialmente ao redor dos olhos, da boca, da cabeça e dos punhos. A partir desses pontos calcula medidas simples, como a largura de abertura dos olhos e da boca e o quanto a cabeça se inclinou ou caiu em relação ao pescoço e aos olhos. Também verifica se cada punho se mantém próximo ao volante ao longo do tempo ou se afasta, sugerindo que o motorista não está mais firmemente no controle.

Vendo de vários ângulos ao longo do tempo

Como uma única foto pode induzir em erro, o sistema analisa pequenos trechos de vídeo em vez de quadros isolados. Por exemplo, um piscar normal poderia se assemelhar a um fechamento de olhos por sonolência, e um olhar rápido ao painel pode parecer um cochilar se visto isoladamente. Para evitar esses equívocos, o método analisa mudanças em pelo menos 20 quadros consecutivos, verificando se as pistas de fadiga persistem. Ele também utiliza três vistas de câmera coletadas no Driving Monitoring Dataset: uma vista frontal do rosto, uma vista lateral da parte superior do corpo e uma vista próxima das mãos. Juntas, essas perspectivas tornam o sistema mais robusto quando o rosto está parcialmente oculto por óculos, luz solar intensa, desfoque por movimento ou viradas da cabeça.

Detecção mais inteligente nos bastidores

Nos bastidores, o sistema tem duas partes principais. Primeiro, um detector de objetos rápido chamado YOLOv11n* localiza o motorista em cada quadro para que o AlphaPose possa marcar os pontos-chave do corpo com precisão. Os autores melhoram esse detector com um bloco híbrido de pooling especial que ajuda a rede a compreender tanto o contexto amplo quanto detalhes finos, como olhos e dedos. Em seguida, as posições e as pontuações de confiança de todos os pontos acompanhados são alimentadas em uma rede LSTM (Long Short-Term Memory), um tipo de modelo adequado para sequências. A LSTM aprende como combinações de mudanças nos olhos, boca, cabeça e mãos se desenrolam ao longo do tempo quando um motorista está alerta, levemente cansado ou gravemente fatigado, e produz a probabilidade de cada nível de fadiga para a janela de tempo atual.

Quão bem o sistema funciona na prática

A equipe testou sua abordagem em um grande conjunto de dados públicos de vídeos dentro do carro, treinando e avaliando os modelos em milhares de imagens e trechos rotulados. Em comparação com vários métodos de aprendizado profundo líderes, incluindo outras combinações de redes convolucionais, transformadores e LSTMs, a estrutura proposta AlphaPose*–LSTM alcançou as maiores acurácia, precisão e F1-score relatadas para classificar níveis de fadiga. Também rodou rápido o suficiente para uso quase em tempo real: uma vez processados os primeiros 20 quadros, novas estimativas de fadiga podem ser atualizadas aproximadamente a cada 48 milissegundos, o que é adequado para monitoramento contínuo em veículos em movimento.

O que isso significa para a condução cotidiana

Em termos simples, o estudo mostra que um carro pode usar câmeras e software inteligente para detectar sinais indicativos de um motorista cansado, combinando pequenas mudanças nos olhos, na boca, na cabeça e nas mãos em um retrato confiável de alerta. Embora o sistema atual esteja ajustado para condições diurnas e precise de adaptação para a noite ou outros ambientes, os resultados sugerem que o monitoramento não intrusivo baseado em visão pode se tornar um recurso de segurança prático. Ao reconhecer a fadiga cedo e incentivar o motorista a fazer uma pausa, essa tecnologia pode ajudar a prevenir muitos acidentes que hoje ocorrem simplesmente porque alguém estava cansado demais para ficar totalmente acordado ao volante.

Citação: Hao, Y., Sun, X., Liu, H. et al. A fatigue driving detection method based on driver posture and facial state analysis. Sci Rep 16, 15159 (2026). https://doi.org/10.1038/s41598-026-44994-4

Palavras-chave: fadiga do motorista, condução sonolenta, monitoramento do motorista, visão computacional, segurança viária