Clear Sky Science · de

Eine Methode zur Erkennung von Müdigkeit beim Fahren basierend auf Analyse von Körperhaltung und Gesichtsstatus

Warum müde Fahrer uns alle betreffen

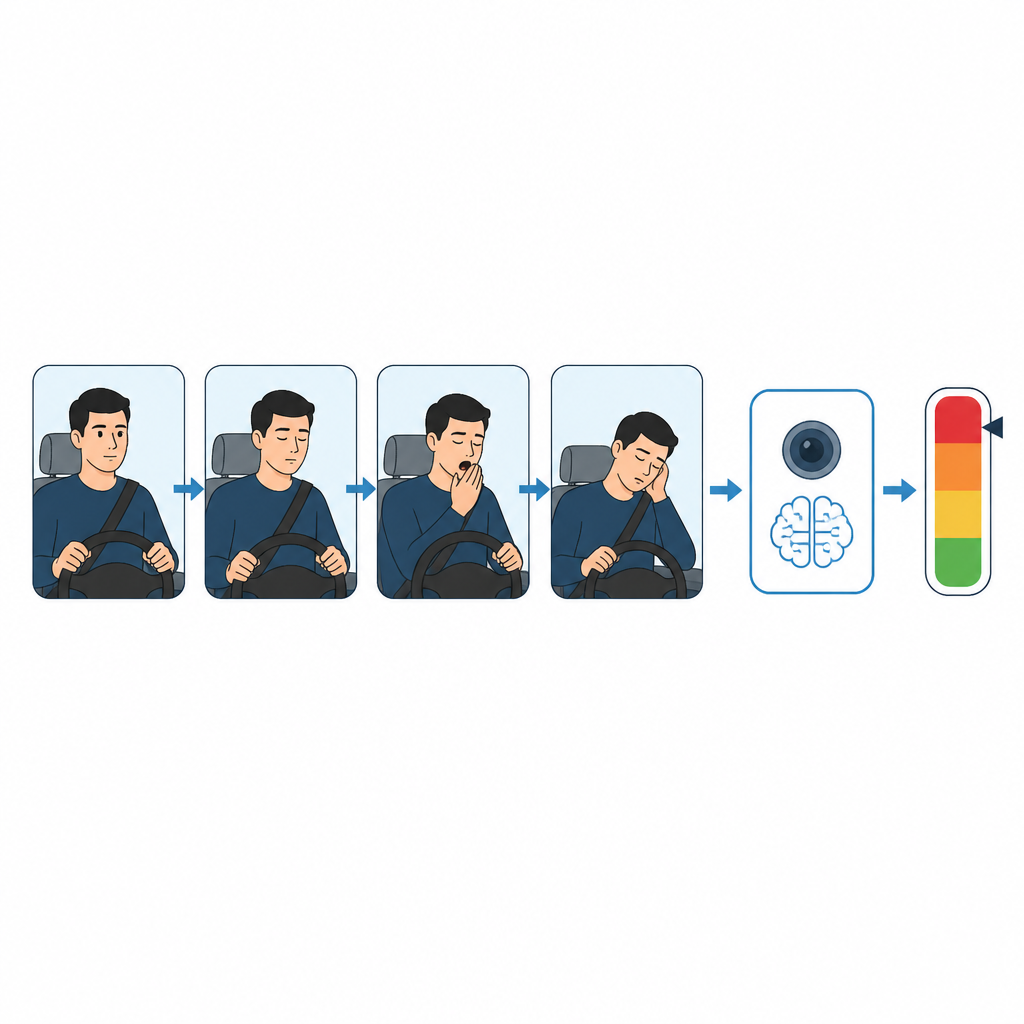

Die meisten von uns haben auf langen Fahrten das schwere Gefühl in den Augenlidern erlebt, doch nur wenige erkennen, wie oft dieser schläfrige Moment in einen Unfall mündet. Dieses Papier beschreibt ein kamerabasiertes System, das Gesicht, Körperhaltung und Hände des Fahrers beobachtet, um frühe Anzeichen von Ermüdung zu erkennen und rechtzeitig Warnungen zu geben, ohne Sensoren am Körper anzubringen oder das Fahrverhalten zu verändern.

Den Fahrer beobachten, nicht nur das Auto

Verkehrsbehörden schätzen, dass Müdigkeit an einem großen Anteil schwerer Verkehrsunfälle weltweit beteiligt ist. Traditionelle Warnsysteme konzentrierten sich auf Signale vom Fahrzeug, wie Lenkkorrekturen oder Spurverlassen, oder auf medizinische Sensoren, die Hirn- oder Herzaktivität verfolgen. Diese Methoden können teuer, unbequem oder unzuverlässig sein, wenn Fahrer oder Straßenbedingungen variieren. Die Studie stützt sich stattdessen auf gewöhnliches Videomaterial aus kleinen Innenraumkameras, um das Verhalten des Fahrers direkt zu lesen und moderne künstliche Intelligenz zu nutzen, um das Gesehene zu interpretieren.

Augen, Mund, Kopf und Hände auslesen

Die Forschenden zerlegen zunächst, wie müdes Fahren im Alltag aussieht. Warnsignale sind unter anderem langsamere, längere Lidschläge, wiederholtes Gähnen, ein gesenkter oder geneigter Kopf und Hände, die vom Lenkrad abrutschen. Mittels einer Pose-Estimation-Methode namens AlphaPose verfolgt das System 119 Schlüsselpunkte am Körper des Fahrers, insbesondere rund um Augen, Mund, Kopf und Handgelenke. Aus diesen Punkten berechnet es einfache Kenngrößen, etwa wie weit Augen und Mund geöffnet sind und wie stark der Kopf gegenüber Hals und Augen geneigt oder gesunken ist. Es prüft außerdem, ob jedes Handgelenk über die Zeit in der Nähe des Lenkrads bleibt oder sich wegbewegt, was darauf hindeutet, dass der Fahrer die Kontrolle nicht mehr fest hält.

Mehrere Blickwinkel über die Zeit betrachten

Weil eine einzelne Momentaufnahme irreführend sein kann, analysiert das System kurze Videoclips statt isolierter Frames. Ein normaler Lidschlag könnte etwa wie ein schläfriges Augen-Schließen aussehen, und ein kurzer Blick zum Armaturenbrett könnte alleinstehend wie ein Einknicken des Kopfes wirken. Um solche Fehler zu vermeiden, analysiert die Methode Veränderungen über mindestens 20 aufeinanderfolgende Frames und überprüft, ob Ermüdungsanzeichen anhalten. Zudem nutzt sie drei Kameraperspektiven aus dem Driving Monitoring Dataset: eine Frontalansicht des Gesichts, eine Seitenansicht des Oberkörpers und eine Nahaufnahme der Hände. Diese Kombination macht das System robuster, wenn das Gesicht teilweise durch Brillen, grelles Sonnenlicht, Bewegungsunschärfe oder Kopfbewegungen verdeckt ist.

Intelligentere Erkennung im Inneren

Im Hintergrund besteht das System aus zwei Hauptkomponenten. Zuerst findet ein schneller Objektdetektor namens YOLOv11n* den Fahrer in jedem Frame, sodass AlphaPose Körper-Schlüsselpunkte genau markieren kann. Die Autoren verbessern diesen Detektor mit einem speziellen Hybrid-Pooling-Block, der dem Netzwerk hilft, sowohl den groben Kontext als auch feine Details wie Augen und Finger zu erfassen. Zweitens werden die Positionen und Vertrauenswerte aller verfolgten Schlüsselpunkte in ein Long Short-Term Memory (LSTM)-Netzwerk eingespeist, eine Modellarchitektur, die sich gut für Sequenzen eignet. Das LSTM lernt, wie sich Kombinationen von Veränderungen an Augen, Mund, Kopf und Händen über die Zeit entfalten, wenn ein Fahrer wach, leicht müde oder stark ermüdet ist, und gibt für das aktuelle Zeitfenster die Wahrscheinlichkeit jeder Ermüdungsstufe aus.

Wie gut das System in der Praxis funktioniert

Das Team testete seinen Ansatz an einem großen öffentlichen Datensatz von Innenraumvideos, trainierte und evaluierte die Modelle an tausenden gelabelter Bilder und Clips. Im Vergleich mit mehreren führenden Deep-Learning-Methoden, einschließlich anderer Kombinationen aus Convolutional Networks, Transformern und LSTMs, erreichte das vorgeschlagene AlphaPose*–LSTM-Framework die höchsten berichteten Werte für Genauigkeit, Präzision und F1-Score bei der Klassifikation von Ermüdungsstufen. Es lief zudem schnell genug für nahezu Echtzeitanwendungen: Nachdem die ersten 20 Frames verarbeitet sind, können neue Ermüdungsschätzungen etwa alle 48 Millisekunden aktualisiert werden, was für kontinuierliche Überwachung in fahrenden Fahrzeugen geeignet ist.

Was das für den Alltag am Steuer bedeutet

Einfach gesagt zeigt die Studie, dass ein Auto Kameras und smarte Software nutzen kann, um charakteristische Zeichen eines müden Fahrers zu erkennen, indem kleine Veränderungen an Augen, Mund, Kopf und Händen zu einem verlässlichen Bild der Aufmerksamkeit kombiniert werden. Während das aktuelle System auf Tagesbedingungen abgestimmt ist und für Nacht- oder andere Umgebungen angepasst werden müsste, deuten die Ergebnisse darauf hin, dass nicht-intrusive, visionbasierte Überwachung zu einer praktischen Sicherheitsfunktion werden könnte. Indem Müdigkeit früh erkannt und Fahrer zum Pausieren aufgefordert werden, könnte solche Technik viele Unfälle verhindern, die heute allein dadurch geschehen, dass jemand zu müde war, um am Steuer vollständig wach zu bleiben.

Zitation: Hao, Y., Sun, X., Liu, H. et al. A fatigue driving detection method based on driver posture and facial state analysis. Sci Rep 16, 15159 (2026). https://doi.org/10.1038/s41598-026-44994-4

Schlüsselwörter: Fahrermüdigkeit, schläfriges Fahren, Fahrerüberwachung, Computer Vision, Verkehrssicherheit