Clear Sky Science · fr

Une méthode de détection de la fatigue basée sur l’analyse de la posture du conducteur et de l’état du visage

Pourquoi les conducteurs fatigués comptent pour tous

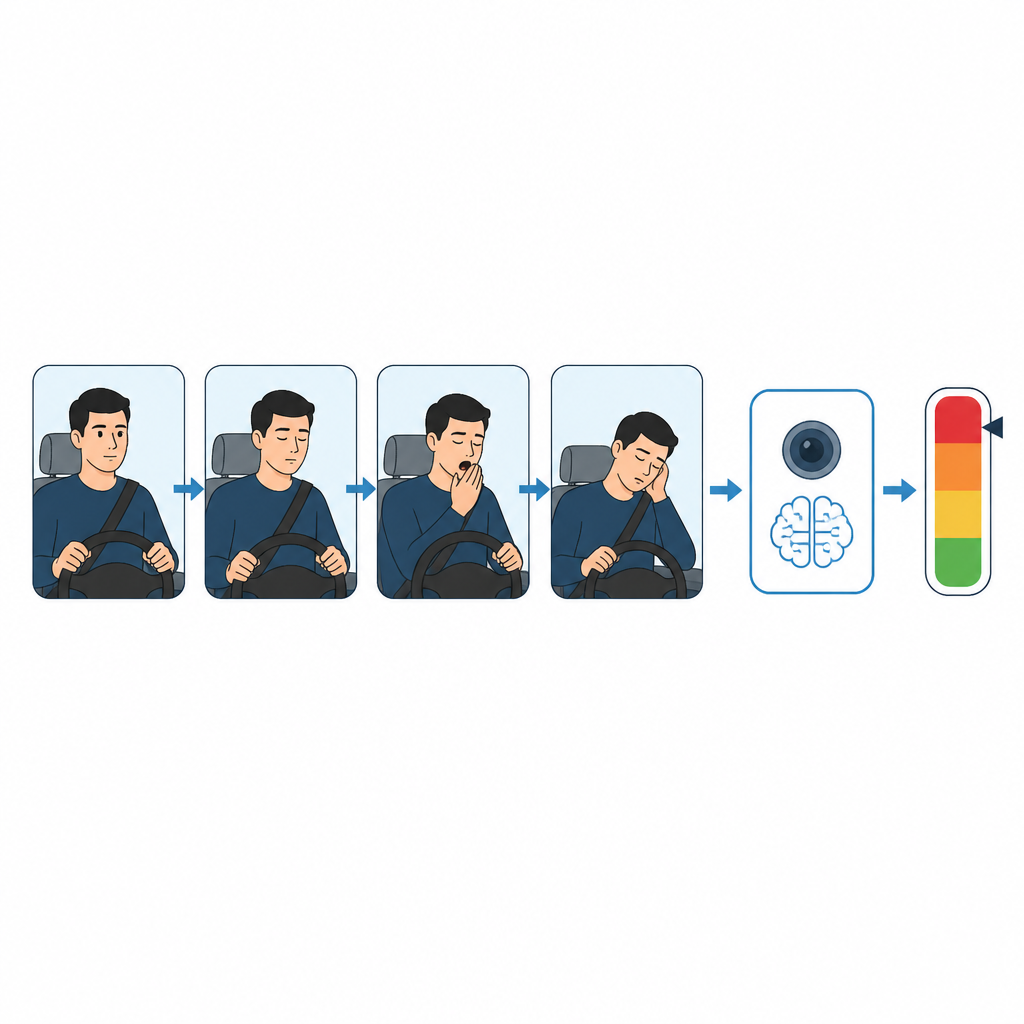

La plupart d’entre nous ont senti leurs paupières s’alourdir lors d’un long trajet, mais peu réalisent à quelle fréquence ce moment de somnolence se transforme en accident. Cet article décrit un système basé sur caméra qui observe le visage, la posture et les mains du conducteur pour repérer les premiers signes de fatigue et émettre des avertissements en temps utile, sans attacher de capteurs au corps ni modifier la manière de conduire.

Observer le conducteur, pas seulement la voiture

Les autorités routières estiment que la fatigue intervient dans une grande part des accidents graves dans le monde. Les systèmes d’alerte traditionnels se sont concentrés sur les signaux provenant de la voiture, comme les corrections de braquage ou les sorties de voie, ou sur des capteurs de type médical qui mesurent l’activité cérébrale ou cardiaque. Ces méthodes peuvent être coûteuses, inconfortables ou peu fiables selon les conducteurs ou les conditions routières. L’étude s’appuie plutôt sur des vidéos ordinaires issues de petites caméras à l’intérieur du véhicule pour lire directement le comportement du conducteur, en utilisant l’intelligence artificielle moderne pour interpréter ce qu’elle voit.

Lire les yeux, la bouche, la tête et les mains

Les chercheurs décomposent d’abord ce à quoi ressemble la conduite fatiguée en termes quotidiens. Les signaux d’alerte comprennent des clignements plus lents et plus longs, des bâillements répétés, une tête affaissée ou inclinée, et des mains qui glissent du volant. En utilisant une méthode d’estimation de pose appelée AlphaPose, le système suit 119 points clés sur le corps du conducteur, en particulier autour des yeux, de la bouche, de la tête et des poignets. À partir de ces points, il calcule des mesures simples, telles que l’ouverture des yeux et de la bouche et l’ampleur de l’inclinaison ou de l’affaissement de la tête par rapport au cou et aux yeux. Il vérifie aussi si chaque poignet reste proche du volant au fil du temps ou s’il s’en éloigne, suggérant que le conducteur n’est plus fermement aux commandes.

Voir sous plusieurs angles et sur la durée

Parce qu’un seul instantané peut induire en erreur, le système analyse de courts extraits vidéo plutôt que des images isolées. Par exemple, un clignement normal pourrait ressembler à une fermeture somnolente des yeux, et un rapide coup d’œil au tableau de bord pourrait paraître comme un assoupissement si on le considère seul. Pour éviter ces erreurs, la méthode examine les changements sur au moins 20 images consécutives, vérifiant si les indices de fatigue persistent. Elle utilise aussi trois vues de caméra rassemblées dans le Driving Monitoring Dataset : une vue frontale du visage, une vue latérale du haut du corps et une vue rapprochée des mains. Ces angles combinés rendent le système plus robuste lorsque le visage est partiellement masqué par des lunettes, un fort ensoleillement, un flou de mouvement ou une rotation de la tête.

Une détection plus intelligente sous le capot

En coulisses, le système comporte deux parties principales. D’abord, un détecteur d’objets rapide appelé YOLOv11n* localise le conducteur dans chaque image afin qu’AlphaPose puisse repérer précisément les points clés du corps. Les auteurs améliorent ce détecteur avec un bloc de pool hybride spécial qui aide le réseau à comprendre à la fois le contexte global et des détails fins comme les yeux et les doigts. Ensuite, les positions et les scores de confiance de tous les points clés suivis sont fournis à un réseau Long Short-Term Memory (LSTM), un type de modèle adapté aux séquences. L’LSTM apprend comment les combinaisons de changements des yeux, de la bouche, de la tête et des mains évoluent dans le temps lorsque le conducteur est alerte, légèrement fatigué ou fortement fatigué, et il renvoie la probabilité de chaque niveau de fatigue pour la fenêtre temporelle en cours.

Quelle est l’efficacité du système en pratique

L’équipe a testé son approche sur un grand jeu de données public de vidéos embarquées, en entraînant et en évaluant les modèles sur des milliers d’images et d’extraits annotés. Comparé à plusieurs méthodes d’apprentissage profond de pointe, incluant d’autres combinaisons de réseaux convolutionnels, de transformeurs et d’LSTM, le cadre AlphaPose*–LSTM proposé a atteint les meilleures valeurs rapportées d’exactitude, de précision et de F1-score pour la classification des niveaux de fatigue. Il fonctionne aussi assez rapidement pour une utilisation quasi temps réel : une fois les 20 premières images traitées, de nouvelles estimations de fatigue peuvent être mises à jour environ toutes les 48 millisecondes, ce qui convient pour une surveillance continue dans des véhicules en mouvement.

Ce que cela change pour la conduite quotidienne

En termes simples, l’étude montre qu’une voiture peut utiliser des caméras et un logiciel intelligent pour repérer les signes révélateurs d’un conducteur fatigué, en combinant de petits changements des yeux, de la bouche, de la tête et des mains pour dresser une image fiable de l’état d’alerte. Bien que le système actuel soit réglé pour des conditions diurnes et doive être adapté pour la nuit ou d’autres environnements, les résultats suggèrent que la surveillance non intrusive basée sur la vision pourrait devenir une fonctionnalité de sécurité pratique. En reconnaissant la fatigue tôt et en invitant le conducteur à faire une pause, cette technologie pourrait aider à prévenir de nombreux accidents qui surviennent aujourd’hui simplement parce que quelqu’un était trop fatigué pour rester pleinement éveillé au volant.

Citation: Hao, Y., Sun, X., Liu, H. et al. A fatigue driving detection method based on driver posture and facial state analysis. Sci Rep 16, 15159 (2026). https://doi.org/10.1038/s41598-026-44994-4

Mots-clés: fatigue du conducteur, conduite somnolente, surveillance du conducteur, vision par ordinateur, sécurité routière