Clear Sky Science · it

Un metodo per rilevare la stanchezza alla guida basato sull’analisi della postura del conducente e dello stato del viso

Perché i conducenti stanchi interessano a tutti

Molti di noi hanno sentito le palpebre farsi pesanti durante un lungo viaggio, ma pochi si rendono conto di quanto spesso quel momento di sonnolenza si trasformi in un incidente. Questo articolo descrive un sistema basato su telecamere che osserva volto, postura e mani del conducente per individuare segni precoci di affaticamento e inviare avvisi tempestivi, senza applicare sensori al corpo o modificare il modo di guidare.

Osservare il conducente, non solo l’auto

Le autorità del traffico stimano che la stanchezza contribuisca a una quota significativa degli incidenti gravi su strada in tutto il mondo. I sistemi di avviso tradizionali si sono concentrati su segnali provenienti dall’auto, come correzioni dello sterzo o deviazioni di corsia, o su sensori di tipo medico che tracciano attività cerebrale o cardiaca. Questi metodi possono essere costosi, scomodi o inaffidabili quando i conducenti o le condizioni stradali variano. Lo studio si basa invece su normali riprese video da piccole telecamere all’interno dell’auto per leggere direttamente il comportamento del conducente, impiegando l’intelligenza artificiale moderna per interpretare ciò che viene osservato.

Interpretare occhi, bocca, testa e mani

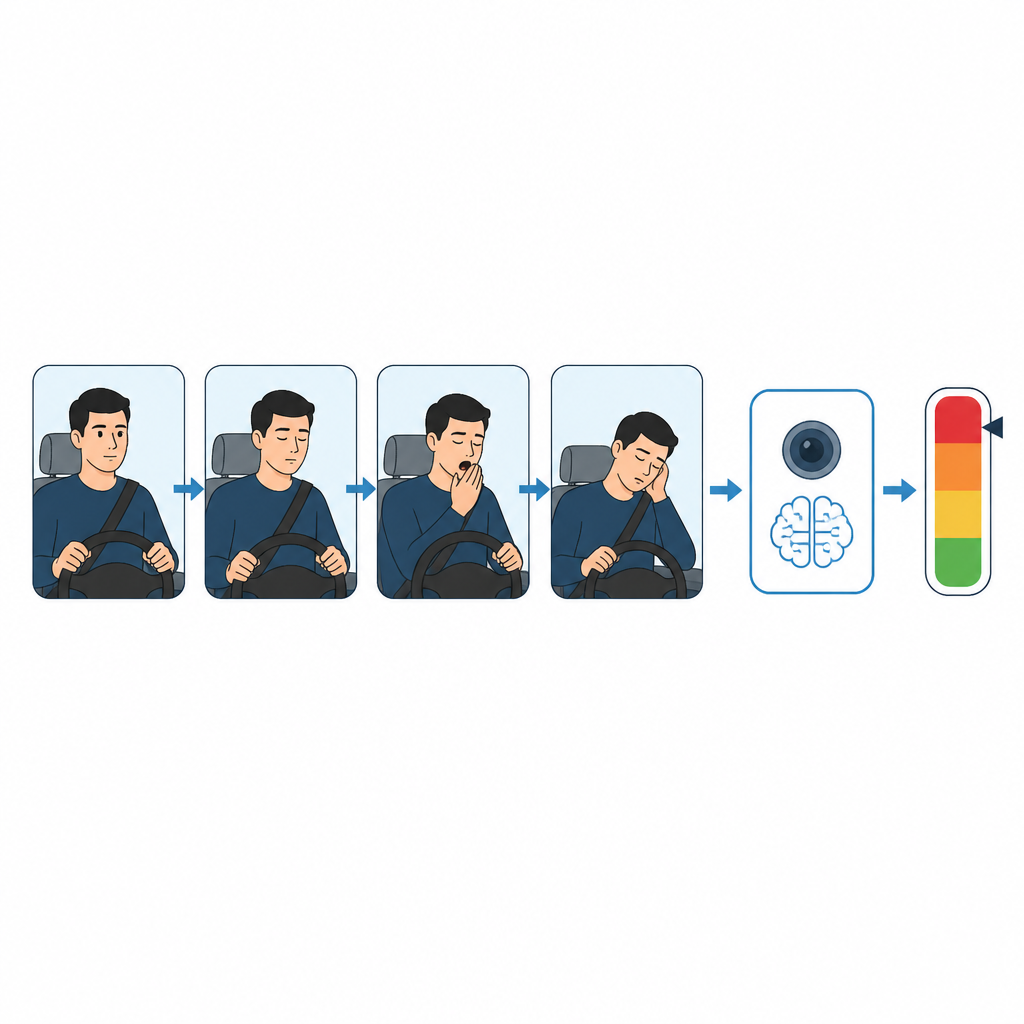

I ricercatori scompongono innanzitutto come si manifesta la guida stanca in termini quotidiani. I segnali di allarme comprendono ammiccamenti più lenti e prolungati, sbadigli ripetuti, una testa che si abbassa o si inclina, e mani che scivolano via dal volante. Utilizzando un metodo di stima della posa chiamato AlphaPose, il sistema traccia 119 punti chiave sul corpo del conducente, in particolare attorno a occhi, bocca, testa e polsi. Da questi punti calcola misure semplici, come quanto sono aperti occhi e bocca e quanto la testa si è inclinata o abbassata rispetto al collo e agli occhi. Controlla anche se ciascun polso rimane vicino al volante nel tempo o si allontana, suggerendo che il conducente non è più saldamente al controllo.

Osservare da più angolazioni nel tempo

Poiché un singolo istante può essere fuorviante, il sistema analizza brevi clip video invece di fotogrammi isolati. Per esempio, un battito di ciglia normale potrebbe assomigliare a una chiusura degli occhi da sonno, e un rapido sguardo al cruscotto potrebbe sembrare un colpo di sonno se visto da solo. Per evitare tali errori, il metodo analizza cambiamenti su almeno 20 fotogrammi consecutivi, verificando se i segnali di affaticamento persistono. Utilizza inoltre tre viste di telecamera raccolte nel Driving Monitoring Dataset: una vista frontale del volto, una vista laterale della parte superiore del corpo e una vista ravvicinata delle mani. Insieme queste angolazioni rendono il sistema più robusto quando il volto è parzialmente nascosto da occhiali, luce intensa, sfocatura di movimento o rotazioni della testa.

Detect più intelligente sotto il cofano

Dietro le quinte, il sistema ha due parti principali. Prima, un rilevatore di oggetti veloce chiamato YOLOv11n* trova il conducente in ogni fotogramma in modo che AlphaPose possa segnare correttamente i punti chiave del corpo. Gli autori migliorano questo rilevatore con un blocco di pooling ibrido speciale che aiuta la rete a comprendere sia il contesto ampio sia i dettagli fini come occhi e dita. Secondo, le posizioni e i punteggi di confidenza di tutti i punti chiave tracciati vengono inviati a una rete LSTM (Long Short-Term Memory), un tipo di modello adatto alle sequenze. L’LSTM apprende come le combinazioni di variazioni di occhi, bocca, testa e mani si sviluppano nel tempo quando un conducente è sveglio, lievemente stanco o fortemente affaticato, e restituisce la probabilità di ciascun livello di affaticamento per la finestra temporale corrente.

Quanto bene funziona il sistema nella pratica

Il team ha testato il proprio approccio su un ampio dataset pubblico di video in auto, addestrando e valutando i modelli su migliaia di immagini e clip etichettati. Rispetto a diversi metodi di deep learning di riferimento, incluse altre combinazioni di reti convoluzionali, transformer e LSTM, il framework proposto AlphaPose*–LSTM ha raggiunto la più alta accuratezza, precisione e F1-score riportate per la classificazione dei livelli di affaticamento. Ha anche funzionato abbastanza velocemente per un uso quasi in tempo reale: una volta processati i primi 20 fotogrammi, le nuove stime di affaticamento possono essere aggiornate approssimativamente ogni 48 millisecondi, valore adatto al monitoraggio continuo nei veicoli in movimento.

Cosa significa per la guida di tutti i giorni

In termini semplici, lo studio dimostra che un’auto può usare telecamere e software intelligente per rilevare i segnali tipici di un conducente stanco, combinando piccole variazioni di occhi, bocca, testa e mani in un quadro affidabile dello stato di attenzione. Pur essendo il sistema attuale tarato per condizioni diurne e richiedendo adattamenti per la notte o altri ambienti, i risultati suggeriscono che il monitoraggio non intrusivo basato sulla visione potrebbe diventare una funzione di sicurezza pratica. Riconoscendo precocemente l’affaticamento e invitando il conducente a fare una pausa, questa tecnologia potrebbe contribuire a prevenire molti incidenti che oggi avvengono semplicemente perché qualcuno era troppo stanco per restare completamente sveglio al volante.

Citazione: Hao, Y., Sun, X., Liu, H. et al. A fatigue driving detection method based on driver posture and facial state analysis. Sci Rep 16, 15159 (2026). https://doi.org/10.1038/s41598-026-44994-4

Parole chiave: affaticamento del conducente, guida assonnata, monitoraggio del conducente, visione artificiale, sicurezza stradale