Clear Sky Science · pt

Uma estrutura de aprendizado profundo de dois ramos para reconhecimento de emoções a partir de sinais EEG

Por que ler ondas cerebrais pode ajudar seu humor

Problemas de saúde mental como estresse, ansiedade e depressão costumam surgir de forma gradual, muitas vezes antes que nós ou as pessoas ao nosso redor os percebam completamente. E se dispositivos do dia a dia pudessem acompanhar discretamente nosso estado emocional e sinalizar quando precisamos de uma pausa ou apoio? Este artigo explora uma nova forma de ler padrões na atividade cerebral, usando um headset que registra sinais elétricos do couro cabeludo, e os combina com inteligência artificial moderna para reconhecer emoções de forma rápida, precisa e com pouca calibragem manual.

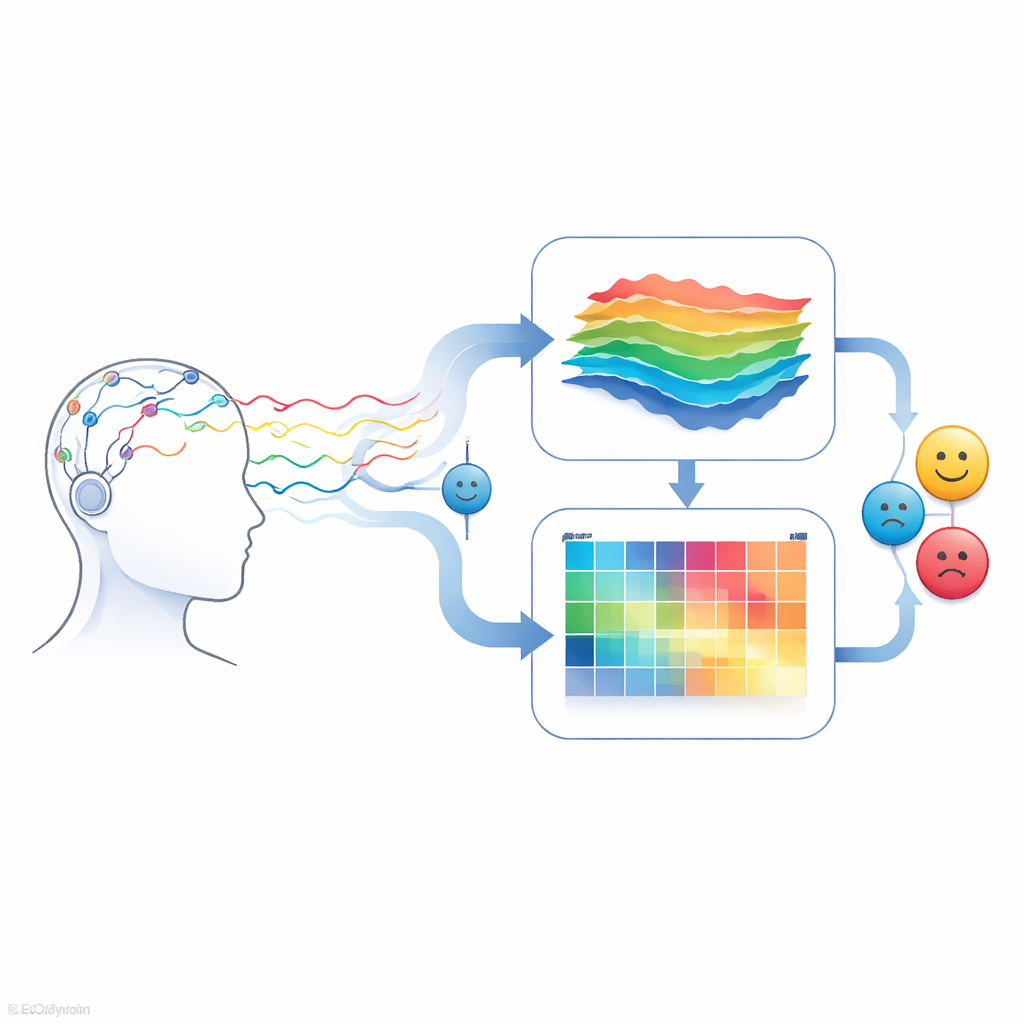

Transformando sinais cerebrais em pistas emocionais

Nossos cérebros produzem constantemente pequenos pulsos elétricos que podem ser medidos por uma tecnologia chamada EEG, sigla para eletroencefalografia. Esses sinais mudam sutilmente quando estamos calmos, estressados ou divertidos. Métodos tradicionais para interpretar dados de EEG dependem fortemente de especialistas que extraem manualmente características matemáticas dos sinais brutos — um processo lento e frequentemente frágil, que não se traduz bem entre estudos diferentes. Os autores procuram substituir esse trabalho manual por um sistema de ponta a ponta que aprende diretamente a partir dos dados, de modo que o reconhecimento emocional seja mais confiável e mais fácil de implantar em monitoramento de saúde mental no mundo real.

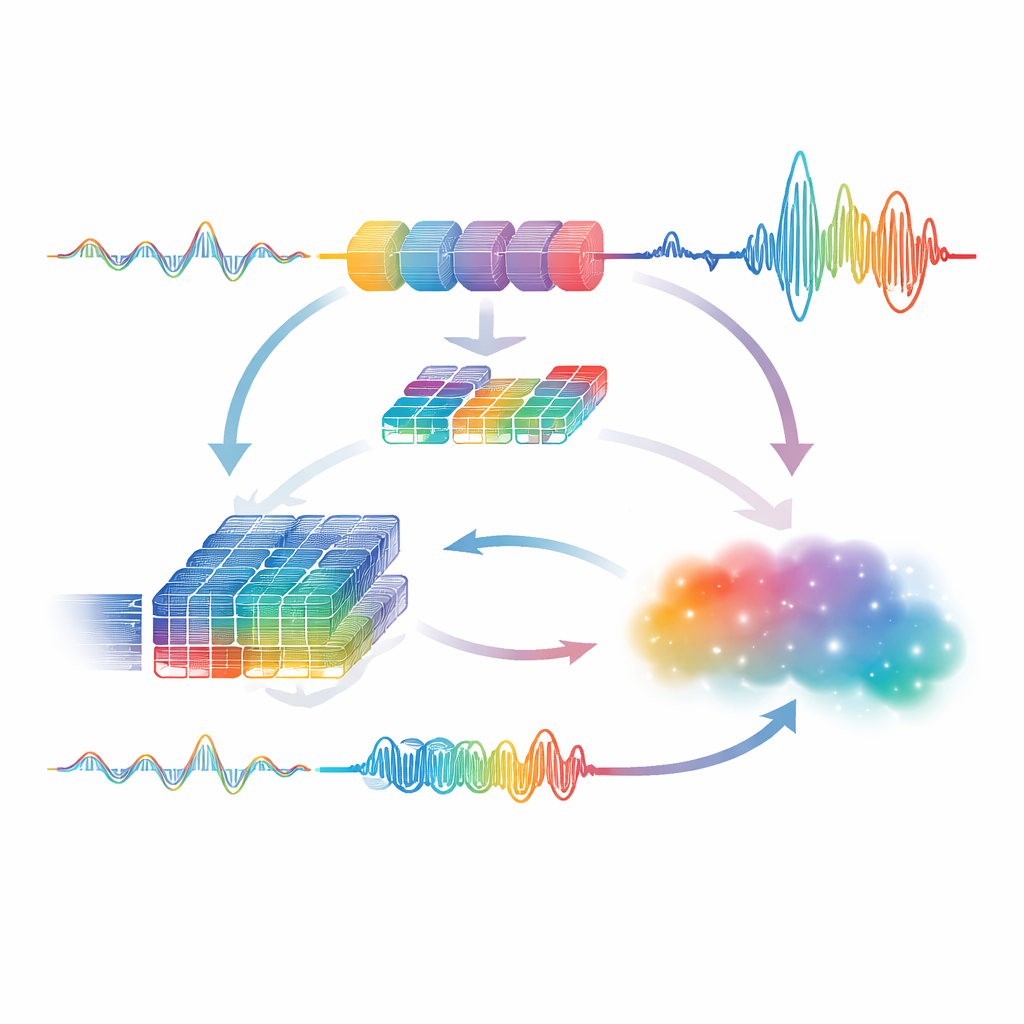

Dois caminhos para entender o mesmo sinal

O cerne do estudo é um modelo de aprendizado profundo de dois ramos que analisa o mesmo sinal de EEG de duas maneiras complementares. Um ramo foca em como o sinal evolui ao longo do tempo, alimentando as sequências brutas de ondas cerebrais em um tipo de rede neural chamada LSTM, que se destaca em acompanhar padrões e ritmos. O outro ramo converte o mesmo sinal em um mapa de frequências, semelhante ao modo como engenheiros de áudio visualizam sons, e passa esse mapa por uma rede convolucional que é boa em identificar padrões locais. Ao permitir que um ramo se especialize em temporalidade e o outro em frequência, o sistema captura informações mais ricas sobre como diferentes emoções se manifestam no cérebro.

Permitindo que as duas visões se ensinem mutuamente

Em vez de tratar esses dois ramos como especialistas separados que só se encontram no final, os autores os projetam para interagir em ambas as direções. As características baseadas em frequência são transformadas de volta em uma forma semelhante a sinal e enviadas por uma rede temporal adicional, incentivando o modelo a verificar se padrões espectrais também fazem sentido ao longo do tempo. Da mesma forma, o resumo produzido pelo ramo temporal é transformado em um sinal sintético, convertido em um mapa de frequência e examinado novamente pelo ramo espectral. Essa troca de ida e volta ajuda o modelo a concordar sobre quais aspectos do sinal realmente importam para distinguir estados emocionais. Por fim, o modelo funde essas perspectivas usando operações matemáticas simples que realçam onde ambos os ramos concordam fortemente antes de entregar o resultado a um classificador compacto que produz uma categoria emocional.

Testando em diferentes cenários do mundo real

Para verificar se a abordagem se mantém além de um único experimento cuidadosamente controlado, os autores a testam em três conjuntos de dados públicos que capturam emoções e estresse em situações bem distintas. Um utiliza uma faixa de cabeça de grau consumidor para registrar sentimentos positivos, neutros e negativos enquanto as pessoas assistem a trechos de filmes. O segundo acompanha voluntários com sensores no peito e no pulso durante entrevistas estressantes, períodos calmos de referência e vídeos divertidos. O terceiro observa trabalhadores de escritório lidando com pressão de tempo e interrupções em sessões longas. Nesses cenários variados, com dispositivos e participantes distintos, o modelo de dois ramos alcança precisão surpreendentemente alta — acima de 96% no conjunto de ondas cerebrais e pontuações essencialmente perfeitas nos outros dois — mantendo o projeto eficiente o suficiente para uso quase em tempo real.

O que isso significa para o cotidiano

Em termos simples, o estudo mostra que combinar duas visões simples, porém complementares, da atividade cerebral e permitir que elas se aprimorem continuamente pode gerar um sistema de reconhecimento emocional que é ao mesmo tempo potente e prático. Em vez de depender de características frágeis construídas manualmente, a estrutura aprende diretamente dos dados e se mantém robusta diante de novas pessoas e condições de gravação. Embora mais trabalho seja necessário para adaptá‑la entre diferentes bases de dados, reduzir seu tamanho para dispositivos vestíveis e incorporar sinais corporais adicionais, essa abordagem de dois ramos aponta para ferramentas futuras que poderiam acompanhar discretamente nosso bem‑estar emocional, oferecendo alertas precoces e suporte personalizado muito antes de uma crise.

Citação: Saha, D., Ali, A., Gulvanskii, V. et al. A dual-branch deep learning framework for emotion recognition from EEG signals. Sci Rep 16, 13076 (2026). https://doi.org/10.1038/s41598-026-42998-8

Palavras-chave: reconhecimento de emoções por EEG, aprendizado profundo, monitoramento da saúde mental, interfaces cérebro‑computador, detecção de estresse