Clear Sky Science · es

Un marco de aprendizaje profundo de doble rama para el reconocimiento de emociones a partir de señales EEG

Por qué leer las ondas cerebrales podría ayudar a tu estado de ánimo

Problemas de salud mental como el estrés, la ansiedad y la depresión suelen desarrollarse antes de que nosotros o quienes nos rodean los detectemos por completo. ¿Y si dispositivos cotidianos pudieran monitorizar discretamente nuestro estado emocional y avisarnos cuando conviene tomarse un descanso o buscar apoyo? Este artículo explora una nueva manera de leer patrones en la actividad cerebral mediante una diadema que registra señales eléctricas del cuero cabelludo, y las combina con inteligencia artificial moderna para reconocer emociones de forma rápida, precisa y con poca intervención manual.

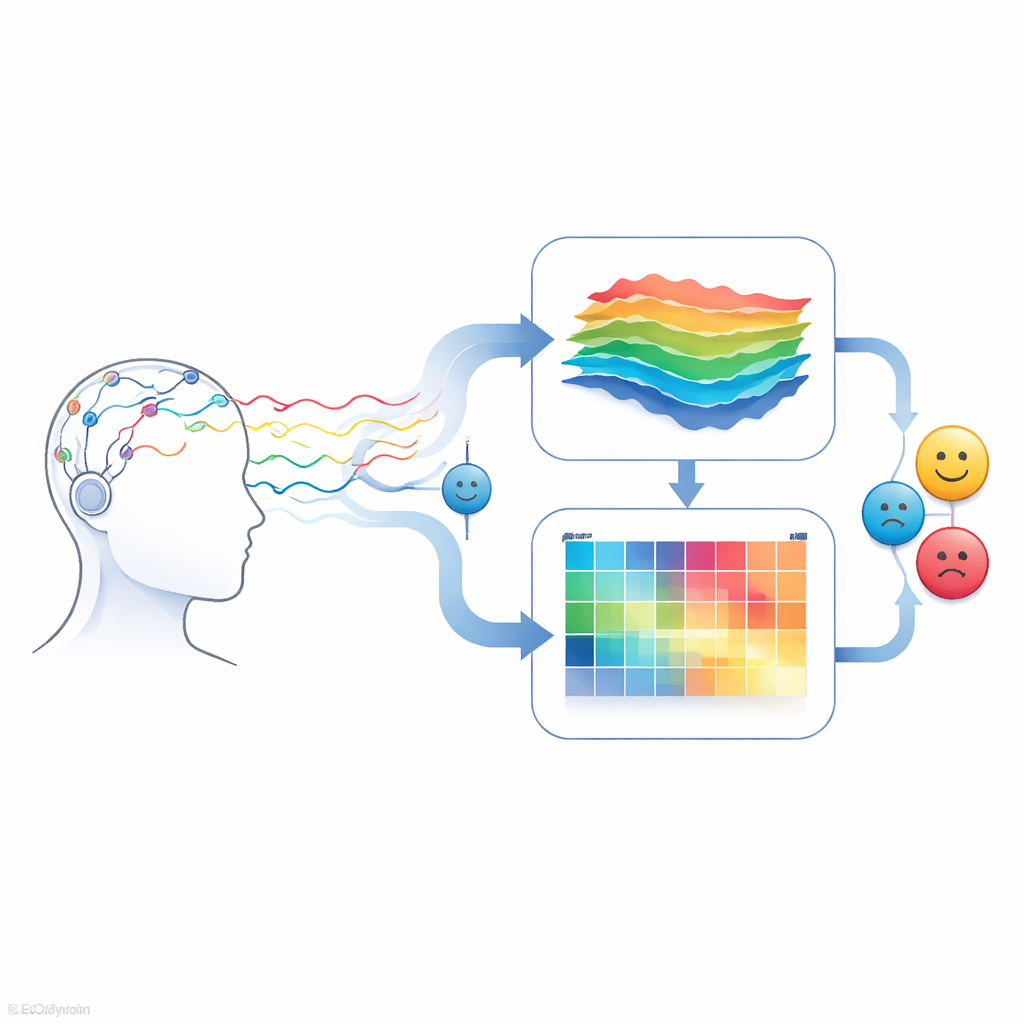

Convertir las señales cerebrales en pistas emocionales

Nuestros cerebros producen constantemente pequeños pulsos eléctricos que pueden medirse con una técnica llamada EEG, abreviatura de electroencefalografía. Estas señales cambian sutilmente cuando nos sentimos tranquilos, estresados o divertidos. Los métodos tradicionales para interpretar datos EEG dependen en gran medida de que expertos diseñen a mano características matemáticas a partir de las señales crudas, un proceso lento y a menudo frágil que no se traslada bien de un estudio a otro. Los autores buscan sustituir este trabajo manual por un sistema de extremo a extremo que aprenda directamente de los datos, de modo que el reconocimiento emocional sea más fiable y más fácil de desplegar en monitorizaciones reales de la salud mental.

Dos vías para entender la misma señal

El núcleo del estudio es un modelo de aprendizaje profundo de doble rama que examina la misma señal EEG desde dos perspectivas complementarias. Una rama se centra en cómo evoluciona la señal en el tiempo, alimentando las secuencias crudas de ondas cerebrales a un tipo de red neuronal llamada LSTM, que sobresale en rastrear patrones y ritmos. La otra rama convierte la misma señal en un mapa de frecuencias, similar en espíritu a cómo los ingenieros de sonido visualizan el audio, y pasa ese mapa por una red convolucional que es buena detectando patrones locales. Al permitir que una rama se especialice en la temporalidad y la otra en la frecuencia, el sistema captura información más rica sobre cómo aparecen las distintas emociones en el cerebro.

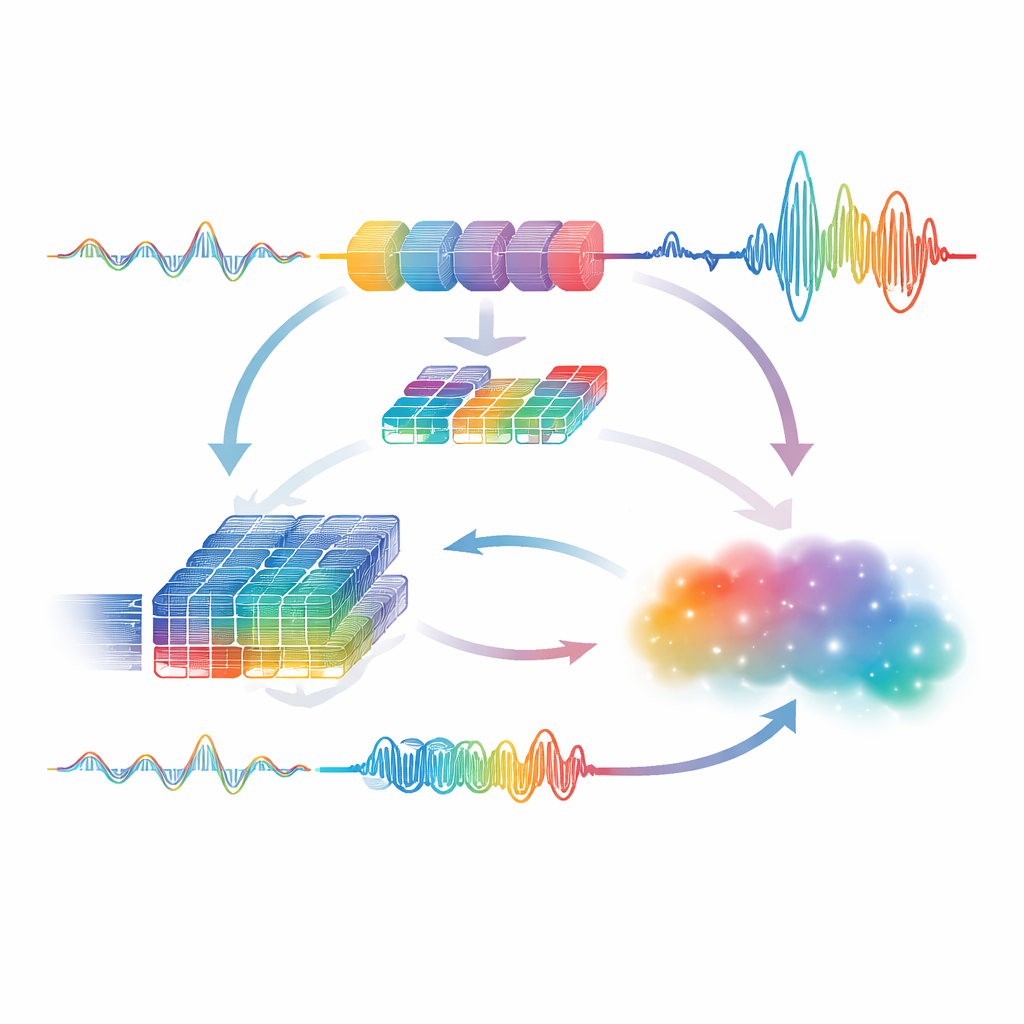

Permitir que las dos perspectivas se enseñen entre sí

En lugar de tratar estas dos ramas como expertos separados que solo se encuentran al final, los autores las diseñan para que interactúen en ambas direcciones. Las características basadas en el espectro se transforman de nuevo en una forma similar a la señal y se envían a través de una red temporal adicional, alentando al modelo a comprobar si los patrones espectrales también tienen sentido a lo largo del tiempo. De igual modo, el resumen producido por la rama temporal se convierte en una señal sintética, transformada en un mapa de frecuencias y examinada de nuevo por la rama espectral. Este intercambio de ida y vuelta ayuda al modelo a ponerse de acuerdo sobre qué aspectos de la señal importan realmente para distinguir estados emocionales. Finalmente, el modelo fusiona estas perspectivas usando operaciones matemáticas sencillas que resaltan dónde ambas ramas coinciden fuertemente antes de entregar el resultado a un clasificador compacto que emite una categoría emocional.

Pruebas en distintos entornos reales

Para comprobar si su enfoque funciona más allá de un experimento controlado, los autores lo evalúan en tres conjuntos de datos públicos que capturan emociones y estrés en situaciones muy diferentes. Uno utiliza una cinta para la cabeza de consumo para registrar sentimientos positivos, neutrales y negativos mientras las personas ven fragmentos de películas. El segundo sigue a voluntarios con sensores en pecho y muñeca durante entrevistas estresantes, líneas base calmadas y vídeos divertidos. El tercero observa a trabajadores de oficina enfrentándose a presión de tiempo e interrupciones durante sesiones prolongadas. A través de estos escenarios variados, dispositivos y participantes, el modelo de doble rama alcanza una precisión sorprendentemente alta—por encima del 96 por ciento en el conjunto de ondas cerebrales y puntuaciones esencialmente perfectas en los otros dos—manteniendo el diseño lo bastante eficiente para un uso casi en tiempo real.

Qué significa esto para la vida cotidiana

En términos sencillos, el estudio muestra que combinar dos visiones simples pero complementarias de la actividad cerebral, y permitir que se refinen continuamente entre sí, puede producir un sistema de reconocimiento emocional tanto potente como práctico. En lugar de depender de características frágiles construidas a mano, el marco aprende directamente de los datos y se mantiene robusto frente a nuevas personas y condiciones de grabación. Aunque hace falta más trabajo para adaptarlo entre conjuntos de datos, reducirlo para dispositivos vestibles e incorporar señales corporales adicionales, este enfoque de doble rama apunta hacia herramientas futuras que podrían monitorizar discretamente nuestro bienestar emocional, ofreciendo alertas tempranas y apoyo personalizado mucho antes de que se produzca una crisis.

Cita: Saha, D., Ali, A., Gulvanskii, V. et al. A dual-branch deep learning framework for emotion recognition from EEG signals. Sci Rep 16, 13076 (2026). https://doi.org/10.1038/s41598-026-42998-8

Palabras clave: reconocimiento de emociones por EEG, aprendizaje profundo, monitorización de la salud mental, interfaces cerebro‑computadora, detección de estrés