Clear Sky Science · it

Un framework di deep learning a doppio ramo per il riconoscimento delle emozioni da segnali EEG

Perché leggere le onde cerebrali potrebbe aiutare il tuo umore

I problemi di salute mentale come stress, ansia e depressione spesso emergono gradualmente, prima che noi o chi ci sta intorno ce ne accorgiamo completamente. E se dispositivi di uso quotidiano potessero monitorare silenziosamente il nostro stato emotivo e segnalare quando potrebbe essere utile una pausa o un supporto? Questo articolo esplora un nuovo modo di leggere i pattern dell’attività cerebrale, usando una cuffia che registra i segnali elettrici dal cuoio capelluto, e li combina con l’intelligenza artificiale moderna per riconoscere le emozioni in modo rapido, accurato e con poca messa a punto manuale.

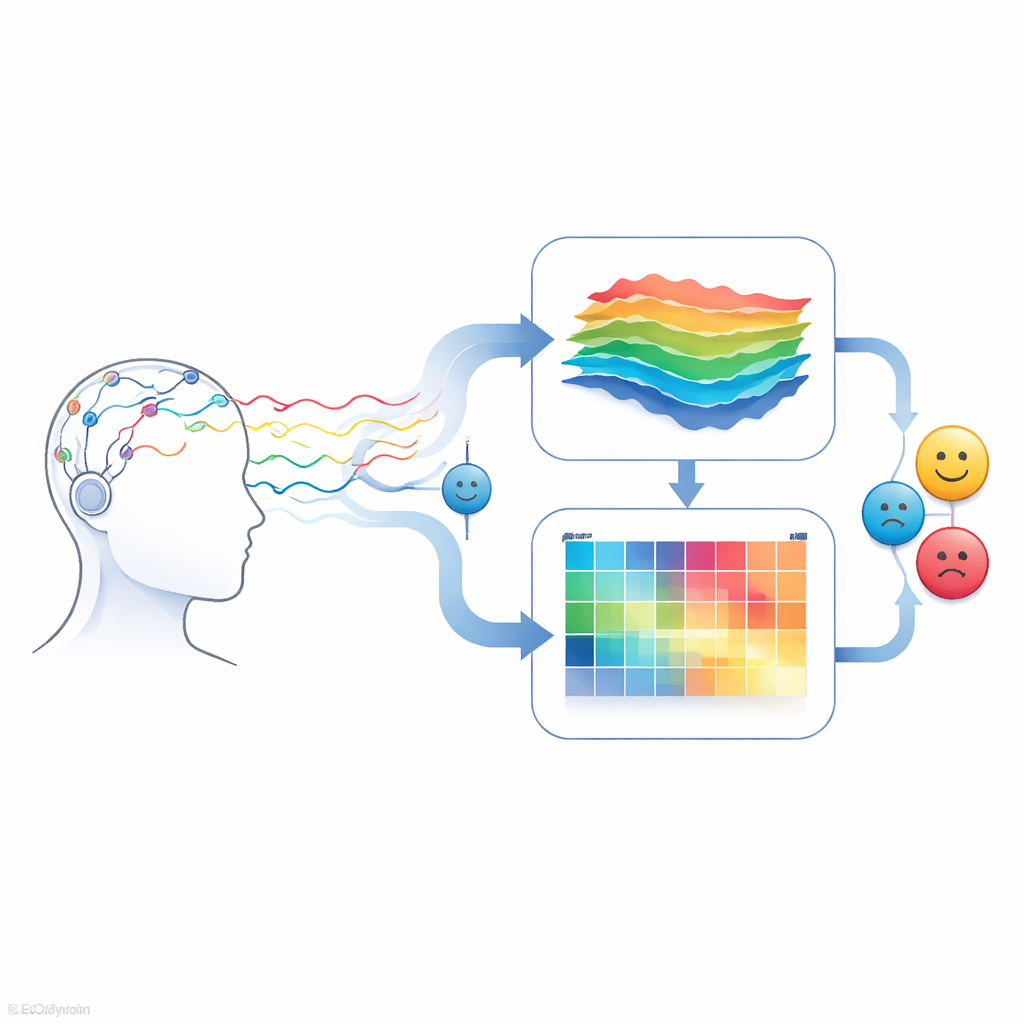

Trasformare i segnali cerebrali in indizi emotivi

I nostri cervelli producono costantemente piccole pulsazioni elettriche che possono essere misurate con una tecnologia chiamata EEG, acronimo di elettroencefalografia. Questi segnali cambiano sottilmente quando ci sentiamo calmi, sotto stress o divertiti. I metodi tradizionali per interpretare i dati EEG dipendono molto dagli esperti che costruiscono manualmente caratteristiche matematiche a partire dai segnali grezzi: un processo lento e spesso fragile che non si trasferisce bene da uno studio all’altro. Gli autori mirano a sostituire questo lavoro manuale con un sistema end-to-end che apprenda direttamente dai dati, affinché il riconoscimento delle emozioni diventi più affidabile e più semplice da impiegare nel monitoraggio della salute mentale nel mondo reale.

Due vie per comprendere lo stesso segnale

Il fulcro dello studio è un modello di deep learning a doppio ramo che considera lo stesso segnale EEG in due modi complementari. Un ramo si concentra su come il segnale evolve nel tempo, alimentando le sequenze di onde cerebrali grezze in un tipo di rete neurale chiamata LSTM, particolarmente capace di seguire pattern e ritmi. L’altro ramo converte lo stesso segnale in una mappa di frequenze, in modo simile a come gli ingegneri del suono visualizzano l’audio, e passa questa mappa attraverso una rete convoluzionale che è brava a individuare pattern locali. Permettendo a un ramo di specializzarsi nel temporale e all’altro nello spettrale, il sistema cattura informazioni più ricche su come le diverse emozioni si manifestano nel cervello.

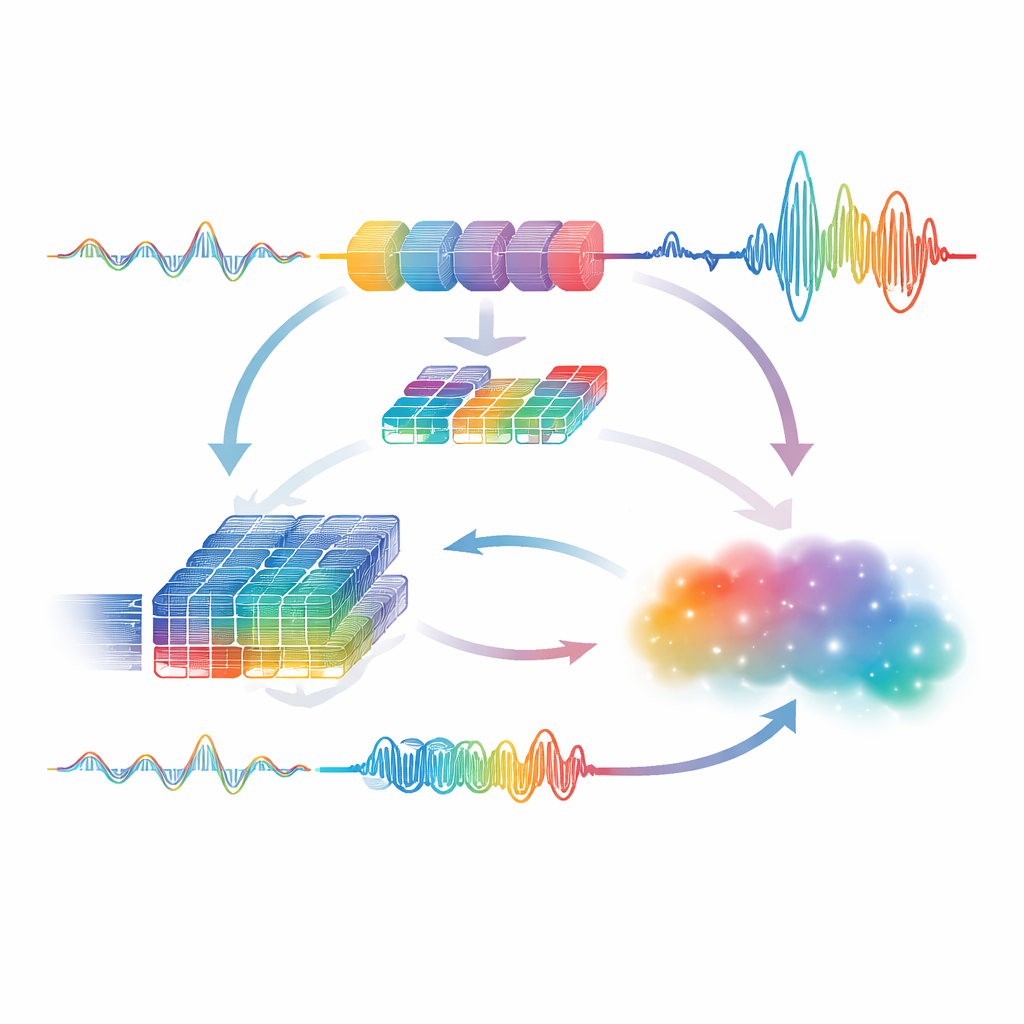

Far apprendere i due punti di vista l’uno dall’altro

Invece di trattare questi due rami come esperti separati che si incontrano solo alla fine, gli autori li progettano per interagire in entrambe le direzioni. Le caratteristiche basate sulla frequenza vengono trasformate nuovamente in una forma simile a un segnale e inviate attraverso una rete temporale aggiuntiva, incoraggiando il modello a verificare se i pattern spettrali hanno senso anche nel tempo. Allo stesso modo, il riassunto prodotto dal ramo temporale viene trasformato in un segnale sintetico, convertito in una mappa di frequenza e riesaminato dal ramo spettrale. Questo scambio continuo aiuta il modello a concordare su quali aspetti del segnale siano davvero rilevanti per distinguere gli stati emotivi. Infine, il modello fonde queste prospettive usando operazioni matematiche semplici che mettono in evidenza dove entrambi i rami sono fortemente concordi prima di passare il risultato a un classificatore compatto che restituisce una categoria emotiva.

Testare in diversi contesti reali

Per verificare se il loro approccio regge oltre un singolo esperimento attentamente controllato, gli autori lo testano su tre dataset pubblici che catturano emozioni e stress in situazioni molto diverse. Il primo usa una fascia per la testa di consumo per registrare emozioni positive, neutre e negative mentre le persone guardano clip cinematografiche. Il secondo segue volontari che indossano sensori al torace e al polso durante interviste stressanti, baseline calme e video divertenti. Il terzo osserva lavoratori d’ufficio alle prese con pressione temporale e interruzioni su sessioni prolungate. In questi scenari, con dispositivi e partecipanti vari, il modello a doppio ramo raggiunge un’accuratezza sorprendentemente alta—oltre il 96 percento sul dataset delle onde cerebrali e punteggi praticamente perfetti sugli altri due—mantenendo al contempo un design sufficientemente efficiente per un uso in tempo quasi reale.

Cosa significa per la vita di tutti i giorni

In termini semplici, lo studio mostra che combinare due viste semplici ma complementari dell’attività cerebrale, e permettere loro di raffinarsi continuamente a vicenda, può produrre un sistema di riconoscimento delle emozioni potente e pratico. Invece di basarsi su caratteristiche fragili costruite a mano, il framework apprende direttamente dai dati e rimane robusto di fronte a nuove persone e condizioni di registrazione. Pur richiedendo ulteriori lavori per adattarlo tra dataset, ridurlo per dispositivi indossabili e integrare segnali corporei aggiuntivi, questo approccio a doppio ramo indica la strada verso strumenti futuri che potrebbero monitorare silenziosamente il nostro benessere emotivo, offrendo allarmi precoci e supporto personalizzato molto prima che si scateni una crisi.

Citazione: Saha, D., Ali, A., Gulvanskii, V. et al. A dual-branch deep learning framework for emotion recognition from EEG signals. Sci Rep 16, 13076 (2026). https://doi.org/10.1038/s41598-026-42998-8

Parole chiave: riconoscimento delle emozioni da EEG, deep learning, monitoraggio della salute mentale, interfacce cervello-computer, rilevamento dello stress