Clear Sky Science · de

Ein zweigleisiges Deep‑Learning‑Framework zur Emotionserkennung aus EEG‑Signalen

Warum das Lesen von Hirnwellen Ihre Stimmung verbessern könnte

Psychische Probleme wie Stress, Angst und Depression schleichen sich oft an, bevor wir oder unser Umfeld sie vollständig bemerken. Was wäre, wenn Alltagsgeräte unseren emotionalen Zustand unauffällig überwachen und signalisieren könnten, wann wir eine Pause oder Unterstützung brauchen? Diese Arbeit untersucht eine neue Methode, Muster in der Gehirnaktivität zu lesen, nutzt ein Headset, das elektrische Signale von der Kopfhaut aufzeichnet, und kombiniert diese Daten mit moderner künstlicher Intelligenz, um Emotionen schnell, genau und mit geringem manuellem Abstimmaufwand zu erkennen.

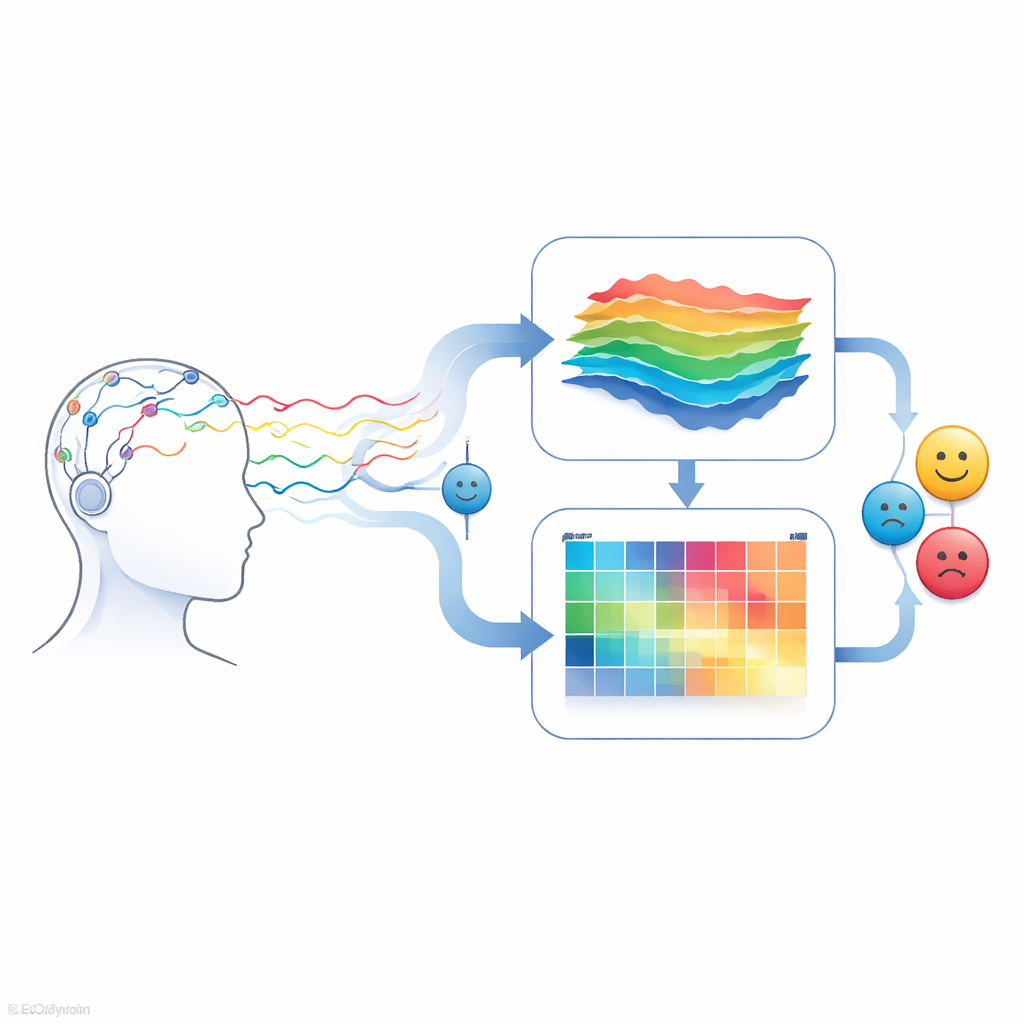

Hirnsignale in emotionale Hinweise verwandeln

Unser Gehirn erzeugt fortlaufend winzige elektrische Impulse, die mit einer Technologie namens EEG (Elektroenzephalografie) messbar sind. Diese Signale verändern sich subtil, wenn wir beruhigt, gestresst oder amüsiert sind. Traditionelle Methoden zur Interpretation von EEG‑Daten beruhen stark darauf, dass Experten manuell mathematische Merkmale aus den Rohsignalen extrahieren — ein langsamer und oft fragiler Prozess, der sich nur schwer von einer Studie zur nächsten übertragen lässt. Die Autoren wollen diese manuelle Arbeit durch ein End‑to‑End‑System ersetzen, das direkt aus den Daten lernt, sodass die Emotionserkennung zuverlässiger und leichter in realen Anwendungen zur Überwachung der psychischen Gesundheit einsetzbar wird.

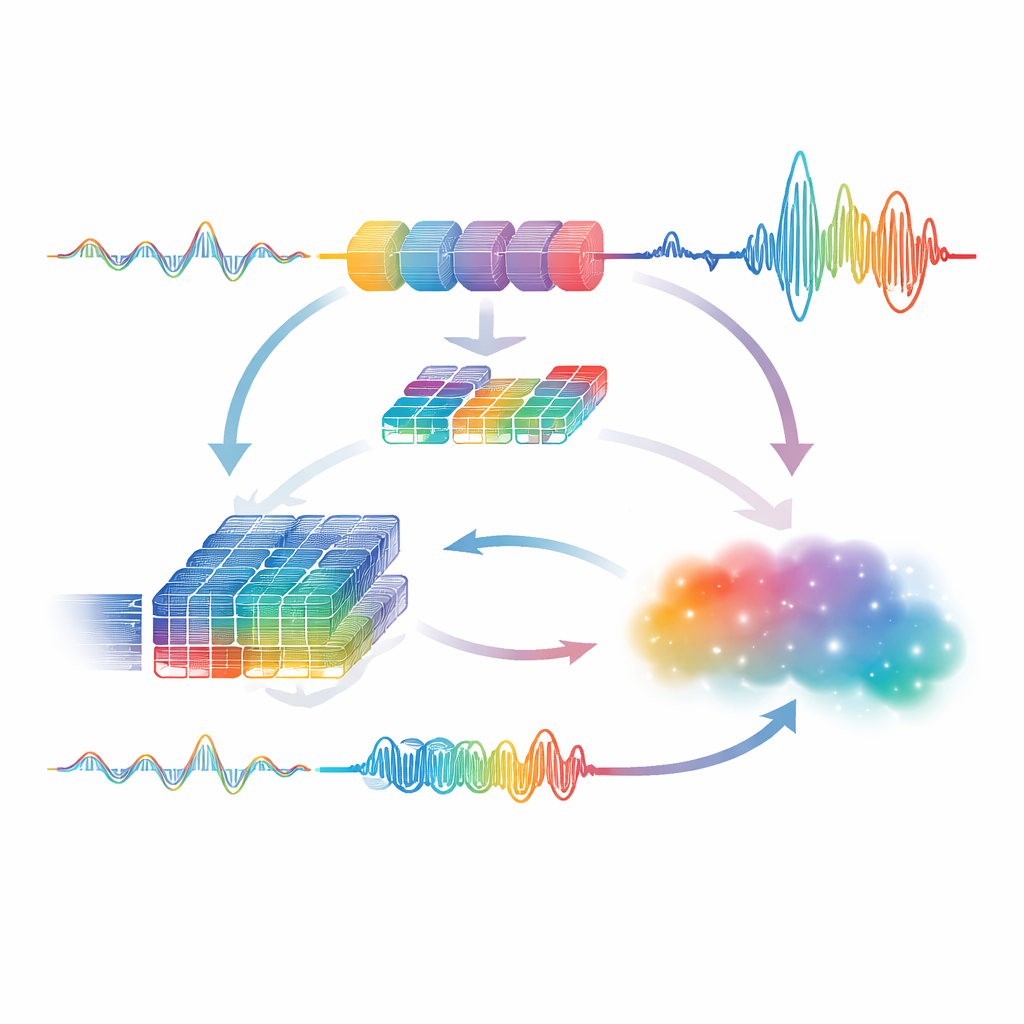

Zwei Wege, dasselbe Signal zu verstehen

Kern der Untersuchung ist ein zweigleisiges Deep‑Learning‑Modell, das dasselbe EEG‑Signal auf zwei sich ergänzende Arten betrachtet. Ein Zweig konzentriert sich auf die zeitliche Entwicklung des Signals und führt die rohen Gehirnwellenfolgen in einen Netzwerktyp namens LSTM ein, der besonders gut darin ist, Muster und Rhythmen nachzuverfolgen. Der andere Zweig wandelt dasselbe Signal in eine Frequenzkarte um, ähnlich der Visualisierung von Audio durch Tontechniker, und leitet diese Karte durch ein Faltungsnetz, das lokale Muster erkennt. Indem ein Zweig auf Zeitverläufe und der andere auf Frequenzen spezialisiert wird, erfasst das System reichhaltigere Informationen darüber, wie sich unterschiedliche Emotionen im Gehirn zeigen.

Die beiden Sichtweisen miteinander lernen lassen

Anstatt die beiden Zweige als getrennte Experten zu behandeln, die sich erst am Ende treffen, entwerfen die Autoren eine bidirektionale Interaktion. Die frequenzbasierten Merkmale werden zurück in eine signalähnliche Form transformiert und durch ein zusätzliches zeitliches Netzwerk geschickt, sodass das Modell prüft, ob spektrale Muster auch zeitlich sinnvoll sind. Umgekehrt wird die Zusammenfassung des zeitlichen Zweigs in ein synthetisches Signal verwandelt, in eine Frequenzkarte konvertiert und erneut vom spektralen Zweig untersucht. Dieser wechselseitige Austausch hilft dem Modell, in Übereinstimmung zu kommen, welche Aspekte des Signals wirklich wichtig sind, um emotionale Zustände zu unterscheiden. Schließlich fusioniert das Modell diese Perspektiven mit einfachen mathematischen Operationen, die hervorheben, wo beide Zweige stark übereinstimmen, bevor das Ergebnis an einen kompakten Klassifikator weitergegeben wird, der eine Emotionskategorie ausgibt.

Tests in unterschiedlichen realen Umgebungen

Um zu prüfen, ob der Ansatz über ein kontrolliertes Experiment hinaus Bestand hat, testen die Autoren ihn an drei öffentlichen Datensätzen, die Emotionen und Stress in sehr unterschiedlichen Situationen erfassen. Der erste nutzt ein consumer‑taugliches Stirnband, um positive, neutrale und negative Gefühle beim Anschauen von Filmclips aufzuzeichnen. Der zweite begleitet Freiwillige mit Brust‑ und Armband‑Sensoren durch stressige Interviews, ruhige Baselines und unterhaltsame Videos. Der dritte beobachtet Büroangestellte, die mit Zeitdruck und Unterbrechungen über längere Sitzungen hinweg zurechtkommen müssen. Über diese unterschiedlichen Szenarien, Geräte und Teilnehmer hinweg erreicht das zweigleisige Modell auffallend hohe Genauigkeiten — über 96 Prozent beim Gehirnwellen‑Datensatz und faktisch perfekte Werte bei den beiden anderen — und bleibt dabei effizient genug für den Einsatz in nahezu Echtzeit.

Was das für den Alltag bedeutet

Einfache Worte: Die Studie zeigt, dass die Kombination zweier einfacher, sich ergänzender Sichtweisen auf Gehirnaktivität und deren kontinuierliche gegenseitige Verfeinerung ein Emotionserkennungssystem hervorbringen kann, das sowohl leistungsfähig als auch praktisch ist. Anstatt sich auf fragile, handgefertigte Merkmale zu stützen, lernt das Framework direkt aus den Daten und bleibt robust gegenüber neuen Personen und Aufnahmebedingungen. Zwar ist weitere Arbeit nötig, um es über Datensätze hinweg anzupassen, für Wearables zu verkleinern und zusätzliche Körpersignale zu integrieren, doch dieser zweigleisige Ansatz weist in Richtung künftiger Werkzeuge, die still und unaufdringlich unser emotionales Wohlbefinden überwachen und frühzeitig Warnungen sowie personalisierte Unterstützung liefern könnten, lange bevor eine Krise eintritt.

Zitation: Saha, D., Ali, A., Gulvanskii, V. et al. A dual-branch deep learning framework for emotion recognition from EEG signals. Sci Rep 16, 13076 (2026). https://doi.org/10.1038/s41598-026-42998-8

Schlüsselwörter: EEG‑Emotionserkennung, Deep Learning, Überwachung der psychischen Gesundheit, Gehirn‑Computer‑Schnittstellen, Stress‑Erkennung