Clear Sky Science · pt

HSICNet: uma nova arquitetura de deep learning para classificação de imagens hiperespectrais em sensoriamento remoto e monitoramento ambiental

Por que imagens de satélite mais inteligentes importam

Do acompanhamento da saúde das culturas à detecção de poluição a partir do espaço, os satélites modernos veem muito mais do que vermelho, verde e azul. Câmeras hiperespectrais dividem a luz em centenas de pequenas bandas de cor, revelando impressões digitais sutis de plantas, solo, água e concreto. O problema é que esses dados são enormes, ruidosos e difíceis de rotular, o que torna seu uso em tempo real complicado. Este artigo apresenta o HSICNet, um novo sistema de deep learning projetado para domar essa complexidade, de modo que imagens hiperespectrais possam alimentar aplicações em agricultura, áreas urbanas e monitoramento ambiental com mais confiabilidade.

Vendo além da cor comum

A classificação de imagens hiperespectrais é a tarefa de decidir, para cada píxel de uma imagem, que tipo de material ele mostra—por exemplo, milho versus soja, asfalto versus grama ou plantas saudáveis versus doentes. Como sensores hiperespectrais medem centenas de comprimentos de onda, eles fornecem tanto informação “espectral” rica (como um material reflete luz ao longo das cores) quanto informação “espacial” (como pixels vizinhos se relacionam). Métodos tradicionais de aprendizado de máquina e redes neurais iniciais têm dificuldade com esse tipo de dado: há bandas demais, muitas redundantes, e relativamente poucos rótulos de referência. Modelos mais recentes baseados em atenção e transformers podem melhorar a precisão, mas tendem a ser pesados, lentos e propensos a overfitting quando os rótulos são escassos.

Uma rede de dois caminhos para cor e contexto

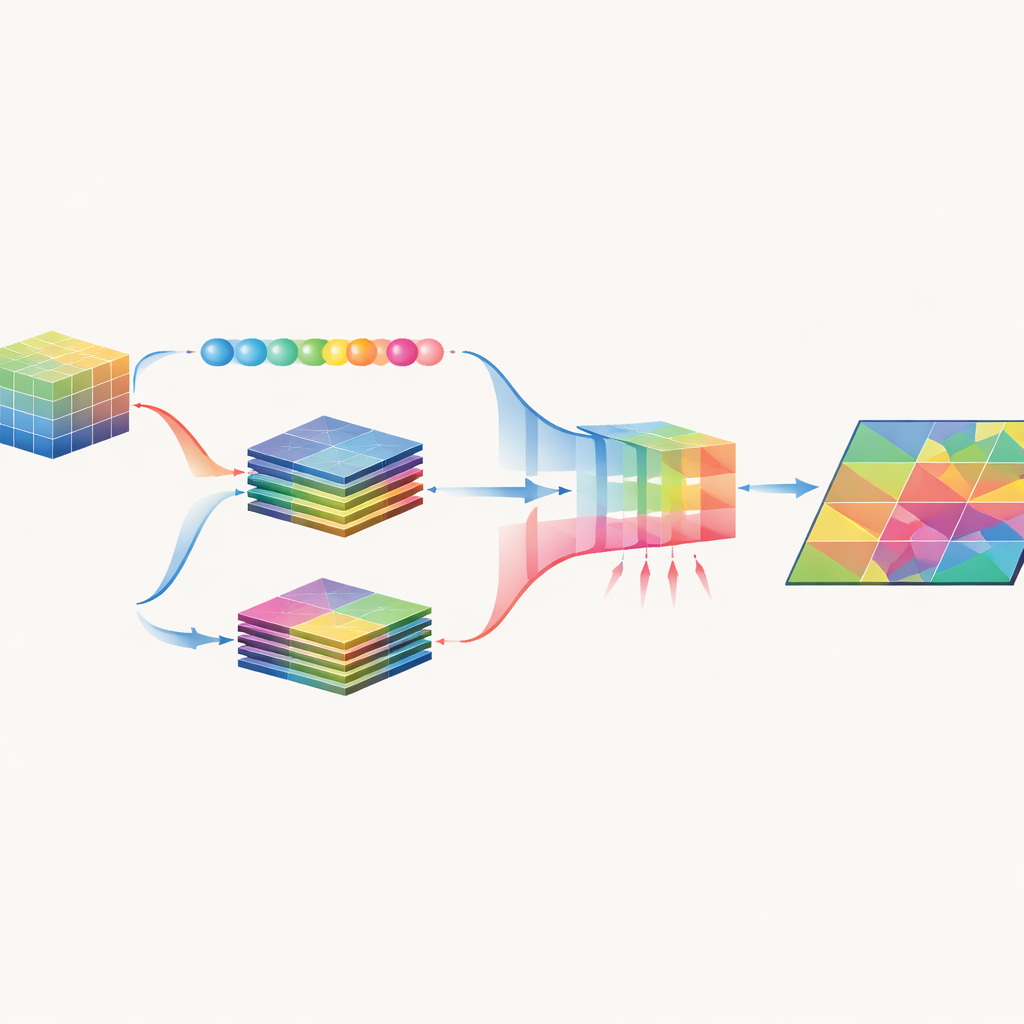

O HSICNet enfrenta esses desafios com uma arquitetura de ramos duplos construída especialmente para dados hiperespectrais. Primeiro, o cubo de imagem bruto é limpo removendo bandas ruidosas e comprimido usando análise de componentes principais, o que mantém quase toda a variação útil enquanto reduz a dimensionalidade. Os dados pré-processados são então alimentados em dois caminhos paralelos. Um caminho usa convoluções unidimensionais ao longo do eixo espectral para aprender assinaturas de cor detalhadas para cada píxel. O outro usa convoluções bidimensionais sobre pequenos blocos da imagem para capturar texturas, formas e padrões—como limites de campos ou malhas viárias—que fornecem contexto espacial. Ao separar essas funções, o modelo reduz o custo computacional enquanto ainda aprende tanto do que cada píxel é composto quanto como ele se encaixa em seu entorno.

Permitindo que a rede foque no que importa

Após a extração das características espectrais e espaciais, o HSICNet não simplesmente as empilha. Em vez disso, aplica um módulo de fusão baseado em atenção inspirado em designs de “squeeze-and-excitation”. Médias globais ao longo dos canais são usadas para estimar quão informativo cada canal de característica é, e a rede aprende um conjunto de pesos que amplificam canais úteis e suprimem os redundantes ou ruidosos. Isso produz uma representação compacta e fundida que enfatiza padrões espectro-espaciais verdadeiramente discriminativos. Por fim, um pequeno classificador totalmente conectado converte essas características fundidas em rótulos de cobertura do solo para cada píxel, e os resultados são avaliados com medidas padrão que acompanham acurácia global, equilíbrio entre classes e concordância com a verdade de campo.

Como isso funciona no mundo real?

Os autores testaram o HSICNet em três conjuntos de dados de referência amplamente usados que simulam tarefas reais de sensoriamento remoto: Indian Pines (culturas mistas e vegetação), Pavia University (superfícies urbanas e vegetação) e Salinas (campos agrícolas de alta resolução). Em todos os três, o HSICNet alcançou cerca de 99% de acurácia geral e concordância quase perfeita com os rótulos de referência, superando linhas de base fortes como máquinas de vetores de suporte, florestas aleatórias, redes convolucionais 3D, redes residuais e híbridos aprimorados por atenção ou baseados em transformers. É importante notar que fez isso com muito menos parâmetros, menor tempo de treinamento e previsões por imagem mais rápidas, tornando-o mais atraente para uso em dispositivos com poder de computação limitado ou para processamento quase em tempo real de dados de satélite e drones.

Por que essa abordagem é promissora

Para um não-especialista, o HSICNet pode ser visto como um pipeline cuidadosamente simplificado que aprende a ler as “impressões digitais” hiperespectrais da superfície terrestre sem se deixar atol ar por detalhes desnecessários. Ao reduzir os dados de forma sensata, dividir cor e contexto em caminhos separados e então recombiná-los com um foco aprendido no que mais importa, o modelo alcança tanto alta precisão quanto velocidade. Essa combinação sugere que futuros sistemas de sensoriamento remoto poderiam classificar culturas, mapear materiais urbanos ou monitorar mudanças ambientais diretamente a partir de fluxos hiperespectrais recebidos, fornecendo informação mais precisa e oportuna a agricultores, planejadores e cientistas ambientais.

Citação: Purnachand, K., Samrin, R., Guttikonda, J.B. et al. HSICNet a novel deep learning architecture for hyperspectral image classification in remote sensing and environmental monitoring. Sci Rep 16, 11166 (2026). https://doi.org/10.1038/s41598-026-40509-3

Palavras-chave: imagem hiperespectral, sensoriamento remoto, deep learning, mapeamento de cobertura do solo, monitoramento ambiental