Clear Sky Science · de

HSICNet: eine neuartige Deep-Learning-Architektur zur Klassifikation hyperspektraler Bilder in Fernerkundung und Umweltüberwachung

Warum intelligentere Satellitenbilder wichtig sind

Von der Überwachung der Pflanzengesundheit bis zum Aufspüren von Verschmutzung aus dem All sehen moderne Satelliten weit mehr als nur Rot, Grün und Blau. Hyperspektralkameras teilen das Licht in Hunderte enger Farbbänder auf und legen so subtile Fingerabdrücke von Pflanzen, Boden, Wasser und Beton offen. Das Problem ist, dass diese Daten riesig, rauschbehaftet und schwer zu kennzeichnen sind, was die Nutzung in Echtzeit erschwert. Diese Arbeit stellt HSICNet vor, ein neues Deep-Learning-System, das darauf ausgelegt ist, diese Komplexität zu bändigen, damit hyperspektrale Bilder verlässlich Anwendungen in Landwirtschaft, Städten und Umweltüberwachung unterstützen können.

Jenseits gewöhnlicher Farben sehen

Die Klassifikation hyperspektraler Bilder besteht darin, für jedes Pixel im Bild zu entscheiden, welcher Materialtyp dargestellt ist – etwa Mais versus Sojabohnen, Asphalt versus Gras oder gesunde versus kranke Pflanzen. Da hyperspektrale Sensoren Hunderte von Wellenlängen messen, liefern sie sowohl reichhaltige „spektrale“ Informationen (wie ein Material Licht über die Farben hinweg reflektiert) als auch „räumliche“ Informationen (wie benachbarte Pixel zueinander in Beziehung stehen). Traditionelle maschinelle Lernverfahren und frühe neuronale Netze tun sich mit solchen Daten schwer: Es gibt zu viele Bänder, viele davon redundant, und vergleichsweise wenige Ground‑Truth‑Labels. Neuere Modelle auf Basis von Attention und Transformern können die Genauigkeit verbessern, sind aber oft groß, langsam und neigen bei wenigen Labels zum Überanpassen.

Ein zweigleisiges Netzwerk für Farbe und Kontext

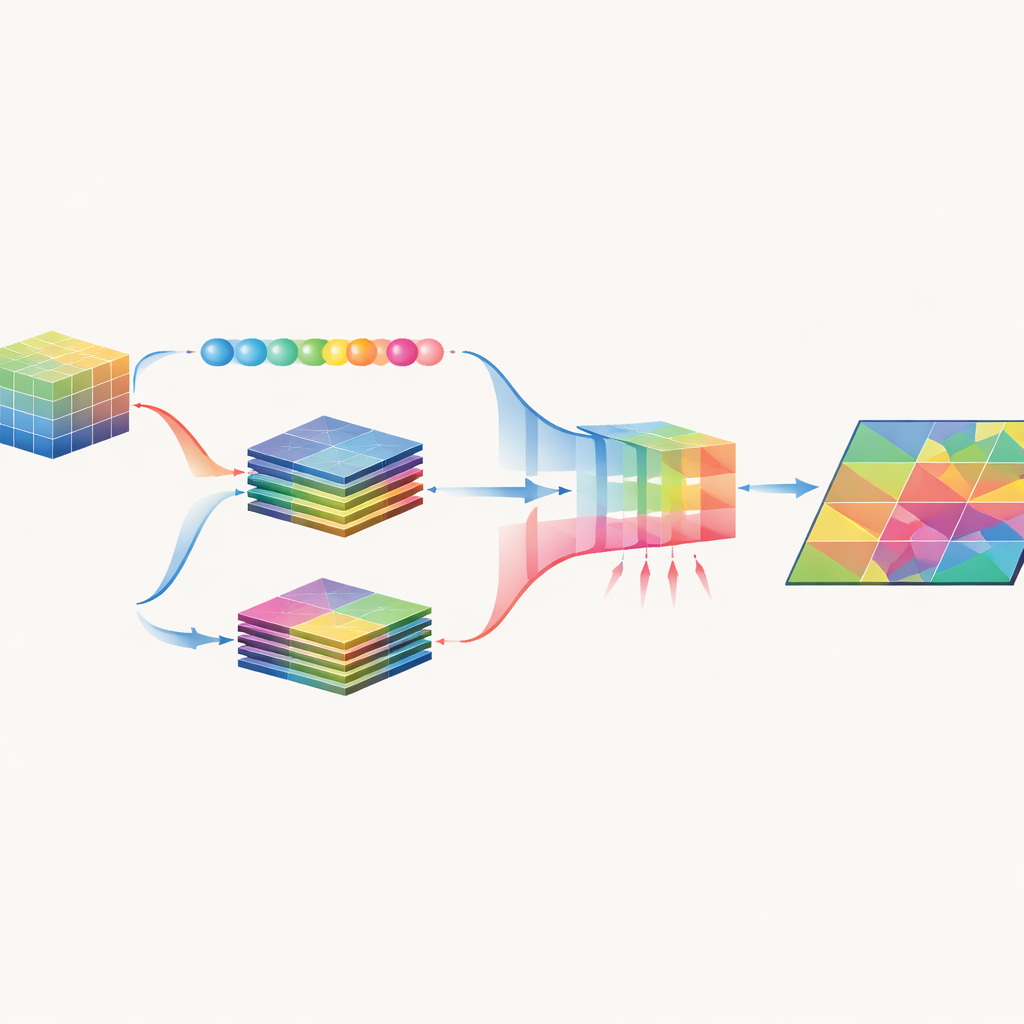

HSICNet begegnet diesen Herausforderungen mit einer Dual‑Branch‑Architektur, die speziell für hyperspektrale Daten entwickelt wurde. Zuerst wird der rohe Bildwürfel bereinigt, indem rauschende Bänder entfernt und mithilfe der Hauptkomponentenanalyse komprimiert werden, sodass nahezu alle nützlichen Variationen erhalten bleiben, während die Dimensionalität reduziert wird. Die vorverarbeiteten Daten werden dann in zwei parallele Pfade gegeben. Ein Pfad nutzt eindimensionale Faltungen entlang der Spektralachse, um feinkörnige Farb‑Signaturen für jedes Pixel zu erlernen. Der andere verwendet zweidimensionale Faltungen über kleine Bildausschnitte, um Texturen, Formen und Muster zu erfassen – etwa Feldgrenzen oder Straßennetze –, die räumlichen Kontext liefern. Durch diese Rollentrennung reduziert das Modell den Rechenaufwand, lernt aber weiterhin sowohl, woraus jedes Pixel besteht, als auch wie es in seine Umgebung passt.

Das Netzwerk auf das Wesentliche fokussieren lassen

Nachdem spektrale und räumliche Merkmale extrahiert wurden, stapelt HSICNet diese nicht einfach zusammen. Stattdessen wendet es ein attention‑basiertes Fusionsmodul an, das von „Squeeze‑and‑Excitation“-Entwürfen inspiriert ist. Globale Mittelwerte über die Kanäle werden verwendet, um abzuschätzen, wie aussagekräftig jeder Feature‑Kanal ist, und das Netzwerk lernt eine Reihe von Gewichten, die nützliche Kanäle verstärken und redundante oder rauschende Kanäle dämpfen. Das ergibt eine kompakte, verschmolzene Repräsentation, die wirklich discriminative spektral‑räumliche Muster betont. Abschließend wandelt ein kleiner vollständig verbundener Klassifikator diese verschmolzenen Merkmale in Landbedeckungs‑Labels für jedes Pixel um, und die Ergebnisse werden mit gängigen Metriken bewertet, die Gesamtgenauigkeit, Klassenbalance und Übereinstimmung mit der Referenz erfassen.

Wie gut funktioniert es in der Praxis?

Die Autoren testeten HSICNet an drei weit verbreiteten Benchmark‑Datensätzen, die reale Fernerkundungsaufgaben nachbilden: Indian Pines (gemischte Kulturen und Vegetation), Pavia University (städtische Oberflächen und Vegetation) und Salinas (hochaufgelöste Agrarfelder). In allen drei Fällen erreichte HSICNet rund 99 % Gesamtgenauigkeit und eine nahezu perfekte Übereinstimmung mit den Referenzlabels und übertraf starke Baselines wie Support Vector Machines, Random Forests, 3D‑Faltungsnetze, Residual Networks sowie attention‑verstärkte oder transformer‑basierte Hybride. Wichtig ist, dass dies mit deutlich weniger Parametern, kürzerer Trainingszeit und schnelleren Vorhersagen pro Bild gelang, was es für den Einsatz auf Geräten mit begrenzter Rechenleistung oder für die nahezu Echtzeitverarbeitung von Satelliten‑ und Drohnendaten attraktiver macht.

Warum dieser Ansatz vielversprechend ist

Für Nicht‑Spezialisten lässt sich HSICNet als sorgfältig gestraffte Pipeline verstehen, die lernt, hyperspektrale „Fingerabdrücke“ der Erdoberfläche zu lesen, ohne sich in unnötigen Details zu verlieren. Indem die Daten sinnvoll reduziert, Farbe und Kontext in separate Pfade aufgeteilt und anschließend mit einem gelernten Fokus wieder zusammengeführt werden, erreicht das Modell sowohl hohe Genauigkeit als auch Geschwindigkeit. Diese Kombination deutet darauf hin, dass künftige Fernerkundungssysteme direkt aus eingehenden hyperspektralen Stromdaten Kulturen klassifizieren, städtische Materialien kartieren oder Umweltveränderungen überwachen könnten und dadurch präzisere und zeitnahere Informationen für Landwirte, Planer und Umweltwissenschaftler liefern.

Zitation: Purnachand, K., Samrin, R., Guttikonda, J.B. et al. HSICNet a novel deep learning architecture for hyperspectral image classification in remote sensing and environmental monitoring. Sci Rep 16, 11166 (2026). https://doi.org/10.1038/s41598-026-40509-3

Schlüsselwörter: hyperspektrale Bildgebung, Fernerkundung, Deep Learning, Kartierung der Landbedeckung, Umweltüberwachung