Clear Sky Science · es

HSICNet: una nueva arquitectura de aprendizaje profundo para la clasificación de imágenes hiperespectrales en teledetección y vigilancia ambiental

Por qué importan imágenes satelitales más inteligentes

Desde el seguimiento de la salud de los cultivos hasta la detección de contaminación desde el espacio, los satélites modernos ven mucho más que rojo, verde y azul. Las cámaras hiperespectrales dividen la luz en cientos de pequeñas bandas de color, revelando huellas sutiles de plantas, suelo, agua y hormigón. El problema es que estos datos son enormes, ruidosos y difíciles de etiquetar, lo que complica su uso en tiempo real. Este artículo presenta HSICNet, un nuevo sistema de aprendizaje profundo diseñado para dominar esa complejidad y permitir que las imágenes hiperespectrales impulsen con mayor fiabilidad aplicaciones en agricultura, entornos urbanos y vigilancia ambiental.

Ver más allá del color ordinario

La clasificación de imágenes hiperespectrales consiste en decidir, para cada píxel de una imagen, qué tipo de material representa —por ejemplo, maíz frente a soja, asfalto frente a césped, o plantas sanas frente a enfermas. Dado que los sensores hiperespectrales miden cientos de longitudes de onda, aportan información «espectral» rica (cómo un material refleja la luz a través de los colores) y también información «espacial» (cómo se relacionan entre sí los píxeles vecinos). Los métodos tradicionales de aprendizaje automático y las primeras redes neuronales tienen dificultades con este tipo de datos: hay demasiadas bandas, muchas redundantes, y relativamente pocas etiquetas de referencia. Modelos más recientes basados en atención y transformadores pueden mejorar la precisión, pero suelen ser pesados, lentos y tendentes al sobreajuste cuando las etiquetas escasean.

Una red de dos vías para color y contexto

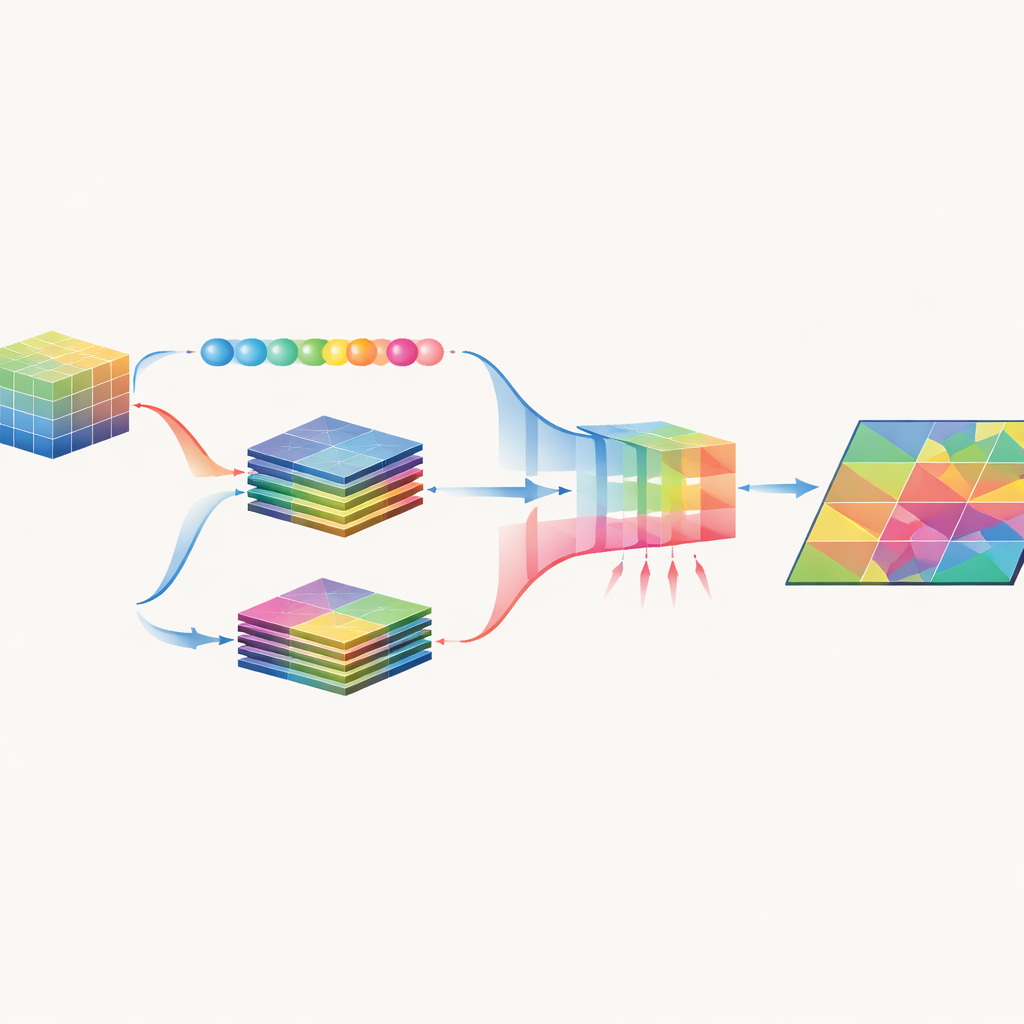

HSICNet aborda estos desafíos con una arquitectura de doble rama diseñada específicamente para datos hiperespectrales. Primero, el cubo de imagen bruto se limpia eliminando bandas ruidosas y se comprime usando análisis de componentes principales, que conserva casi toda la variación útil mientras reduce la dimensionalidad. Los datos preprocesados se alimentan luego en dos vías paralelas. Una vía emplea convoluciones unidimensionales a lo largo del eje espectral para aprender firmas de color finas para cada píxel. La otra utiliza convoluciones bidimensionales sobre pequeños parches de la imagen para capturar texturas, formas y patrones —como límites de parcelas o rejillas de carreteras— que aportan contexto espacial. Al separar estos roles, el modelo reduce el cómputo mientras aprende tanto de qué está hecho cada píxel como cómo encaja en su entorno.

Permitir que la red se centre en lo que importa

Tras extraer características espectrales y espaciales, HSICNet no las concatena simplemente. En su lugar, aplica un módulo de fusión basado en atención inspirado en diseños de «squeeze-and-excitation». Promedios globales a través de los canales se usan para estimar cuánta información aporta cada canal de característica, y la red aprende un conjunto de pesos que realzan canales útiles y suprimen los redundantes o ruidosos. Esto produce una representación fusionada compacta que enfatiza patrones espectro-espaciales realmente discriminativos. Finalmente, un pequeño clasificador totalmente conectado convierte estas características fusionadas en etiquetas de cobertura del suelo para cada píxel, y los resultados se evalúan con medidas estándar que siguen la precisión global, el equilibrio por clase y la concordancia con la verdad de campo.

¿Qué tan bien funciona en el mundo real?

Los autores probaron HSICNet en tres conjuntos de datos de referencia ampliamente usados que imitan tareas reales de teledetección: Indian Pines (cultivos mixtos y vegetación), Pavia University (superficies urbanas y vegetación) y Salinas (campos agrícolas de alta resolución). En los tres casos, HSICNet alcanzó alrededor del 99% de precisión global y una concordancia casi perfecta con las etiquetas de referencia, superando fuertes líneas base como máquinas de vectores de soporte, bosques aleatorios, redes convolucionales 3D, redes residuales y mezclas mejoradas con atención o basadas en transformadores. De forma importante, lo hizo con muchos menos parámetros, menor tiempo de entrenamiento y predicciones por imagen más rápidas, lo que lo hace más atractivo para su uso en dispositivos con capacidad de cálculo limitada o para el procesamiento casi en tiempo real de datos de satélite y dron.

Por qué este enfoque es prometedor

Para un no especialista, HSICNet puede verse como una canalización cuidadosamente depurada que aprende a leer las «huellas dactilares» hiperespectrales de la superficie terrestre sin quedarse atascada en detalles innecesarios. Al reducir los datos de forma sensata, separar color y contexto en rutas distintas y luego recombinarlos con un enfoque aprendido en lo que importa, el modelo logra tanto alta precisión como rapidez. Esta combinación sugiere que futuros sistemas de teledetección podrían clasificar cultivos, mapear materiales urbanos o vigilar cambios ambientales directamente a partir de flujos hiperespectrales entrantes, proporcionando información más precisa y oportuna a agricultores, planificadores y científicos ambientales.

Cita: Purnachand, K., Samrin, R., Guttikonda, J.B. et al. HSICNet a novel deep learning architecture for hyperspectral image classification in remote sensing and environmental monitoring. Sci Rep 16, 11166 (2026). https://doi.org/10.1038/s41598-026-40509-3

Palabras clave: imágenes hiperespectrales, teledetección, aprendizaje profundo, cartografía de la cobertura del suelo, vigilancia ambiental