Clear Sky Science · it

HSICNet: una nuova architettura di deep learning per la classificazione di immagini iperspettrali nel telerilevamento e nel monitoraggio ambientale

Perché le immagini satellitari più intelligenti sono importanti

Dal monitoraggio della salute delle colture all’individuazione dell’inquinamento dallo spazio, i satelliti moderni vedono molto più dei soli rosso, verde e blu. Le camere iperspettrali suddividono la luce in centinaia di bande cromatiche sottili, rivelando impronte sottili di piante, suolo, acqua e cemento. Il problema è che questi dati sono enormi, rumorosi e difficili da etichettare, il che rende complesso il loro impiego in tempo reale. Questo articolo presenta HSICNet, un nuovo sistema di deep learning progettato per domare tale complessità in modo che le immagini iperspettrali possano alimentare con maggiore affidabilità applicazioni in agricoltura, contesti urbani e monitoraggio ambientale.

Vedere oltre il colore ordinario

La classificazione di immagini iperspettrali è il compito di decidere, per ogni pixel di un’immagine, quale tipo di materiale rappresenti — per esempio mais rispetto alla soia, asfalto rispetto all’erba, o piante sane rispetto a quelle malate. Poiché i sensori iperspettrali misurano centinaia di lunghezze d’onda, forniscono sia ricche informazioni “spettrali” (come un materiale riflette la luce attraverso i colori) sia informazioni “spaziali” (come i pixel vicini si relazionano tra loro). I metodi tradizionali di machine learning e le prime reti neurali faticano con questo tipo di dati: ci sono troppe bande, molte ridondanti, e relativamente poche etichette di verità a terra. I modelli più recenti basati su attenzione e transformer possono migliorare l’accuratezza, ma tendono a essere pesanti, lenti e soggetti a overfitting quando le etichette sono scarse.

Una rete a due vie per colore e contesto

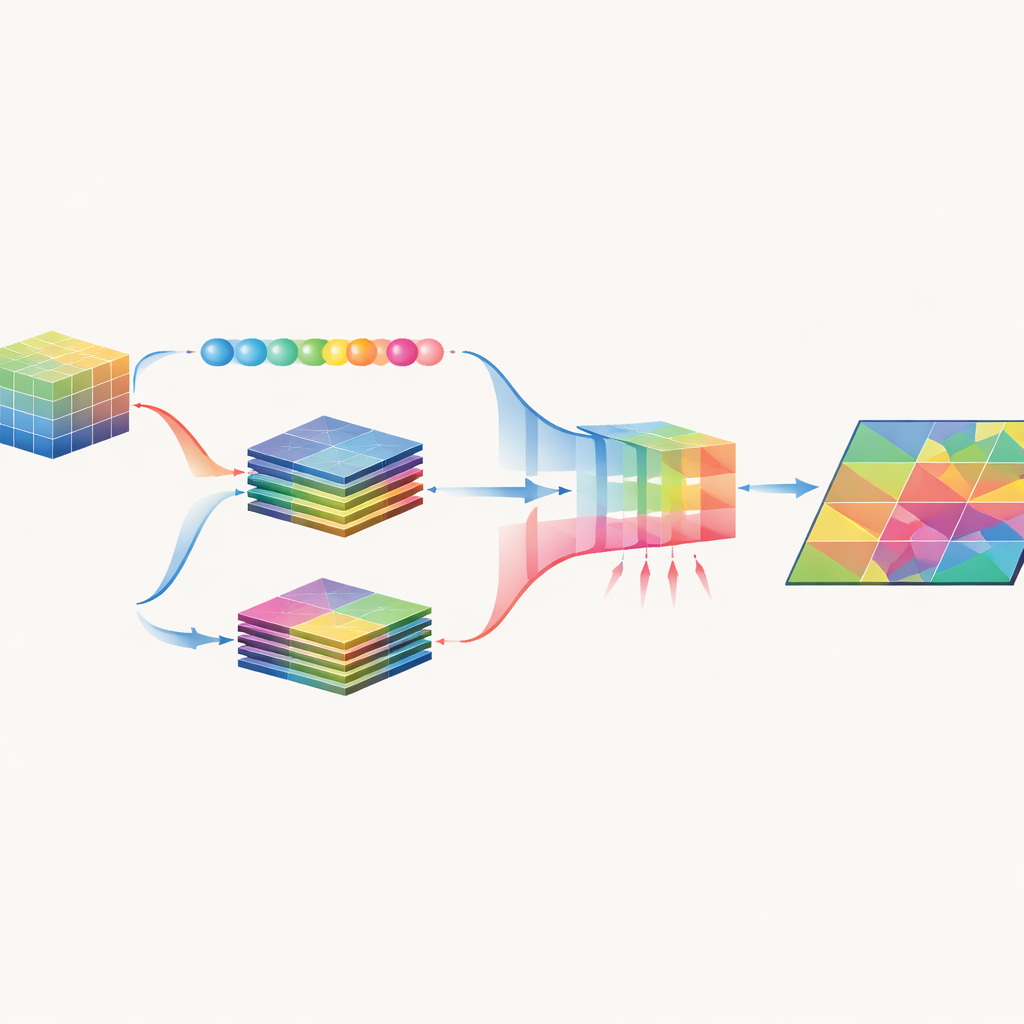

HSICNet affronta queste sfide con un’architettura a doppio ramo pensata appositamente per i dati iperspettrali. Innanzitutto il cubo d’immagine grezzo viene pulito rimuovendo le bande rumorose e compresso utilizzando l’analisi delle componenti principali, che conserva quasi tutta la variazione utile abbassando la dimensionalità. I dati preprocessati vengono quindi inviati in due percorsi paralleli. Un percorso usa convoluzioni unidimensionali lungo l’asse spettrale per apprendere firme cromatiche fini per ogni pixel. L’altro usa convoluzioni bidimensionali su piccole patch d’immagine per catturare texture, forme e pattern — come confini di campo o reticoli stradali — che forniscono contesto spaziale. Separando questi ruoli, il modello riduce il carico computazionale pur imparando sia di cosa è fatto ciascun pixel sia come si inserisce nel suo intorno.

Lasciare che la rete si concentri su ciò che conta

Dopo l’estrazione delle feature spettrali e spaziali, HSICNet non si limita a impilarle. Applica invece un modulo di fusione basato sull’attenzione ispirato ai design “squeeze-and-excitation”. Medie globali attraverso i canali vengono utilizzate per stimare quanto ogni canale di feature sia informativo, e la rete impara un insieme di pesi che potenziano i canali utili e sopprimono quelli ridondanti o rumorosi. Questo produce una rappresentazione fusa e compatta che enfatizza i pattern spettrali–spaziali davvero discriminativi. Infine, un piccolo classificatore fully connected converte queste feature fuse in etichette di copertura del suolo per ogni pixel, e i risultati vengono valutati con misure standard che monitorano accuratezza complessiva, bilanciamento delle classi e concordanza con la verità a terra.

Quanto funziona nel mondo reale?

Gli autori hanno testato HSICNet su tre dataset di riferimento ampiamente usati che riproducono compiti reali di telerilevamento: Indian Pines (colture miste e vegetazione), Pavia University (superfici urbane e vegetazione) e Salinas (campi agricoli ad alta risoluzione). Su tutti e tre i dataset, HSICNet ha raggiunto circa il 99% di accuratezza complessiva e una quasi perfetta concordanza con le etichette di riferimento, superando forti baseline come macchine a vettori di supporto, foreste casuali, reti convoluzionali 3D, reti residuali e ibridi potenziati con attenzione o basati su transformer. È importante notare che lo ha fatto con molti meno parametri, tempi di addestramento ridotti e predizioni per immagine più rapide, rendendolo più interessante per l’uso su dispositivi con potenza di calcolo limitata o per l’elaborazione quasi in tempo reale di dati da satellite e drone.

Perché questo approccio è promettente

Per un non specialista, HSICNet può essere visto come una pipeline accuratamente snella che impara a leggere le “impronte” iperspettrali della superficie terrestre senza farsi appesantire da dettagli inutili. Riducendo i dati in modo sensato, separando colore e contesto in percorsi distinti e poi ricombinandoli con un focus appreso su ciò che conta di più, il modello raggiunge sia alta accuratezza sia velocità. Questa combinazione suggerisce che i futuri sistemi di telerilevamento potrebbero classificare le colture, mappare i materiali urbani o monitorare i cambiamenti ambientali direttamente dai flussi iperspettrali in arrivo, fornendo informazioni più precise e tempestive ad agricoltori, pianificatori e scienziati ambientali.

Citazione: Purnachand, K., Samrin, R., Guttikonda, J.B. et al. HSICNet a novel deep learning architecture for hyperspectral image classification in remote sensing and environmental monitoring. Sci Rep 16, 11166 (2026). https://doi.org/10.1038/s41598-026-40509-3

Parole chiave: imaging iperspettrale, telerilevamento, deep learning, mappatura della copertura del suolo, monitoraggio ambientale