Clear Sky Science · pl

Uczenie głębokie do poprawy wysokorozdzielczych tekstur materiałów w środowiskach 3D

Dlaczego ostrzejsze powierzchnie mają znaczenie

Niezależnie od tego, czy eksplorujesz fantastyczny świat w grze wideo, czy spacerujesz po wirtualnym muzeum w VR, wiele z tego, co wydaje się „realne”, sprowadza się do drobnych detali na powierzchniach: usłojenia drewna, zagłębień w kamieniu czy połysku metalu. Tworzenie tych detali w bardzo wysokiej rozdzielczości jest kosztowne i technicznie trudne, dlatego wiele wirtualnych światów opiera się na rozmytych lub powtarzających się teksturach, które psują iluzję. Niniejszy artykuł przedstawia metodę opartą na uczeniu głębokim, która automatycznie wyostrza i wzbogaca tekstury materiałów, sprawiając, że sceny cyfrowe wyglądają bardziej realistycznie bez konieczności odtwarzania wszystkiego od podstaw przez artystów.

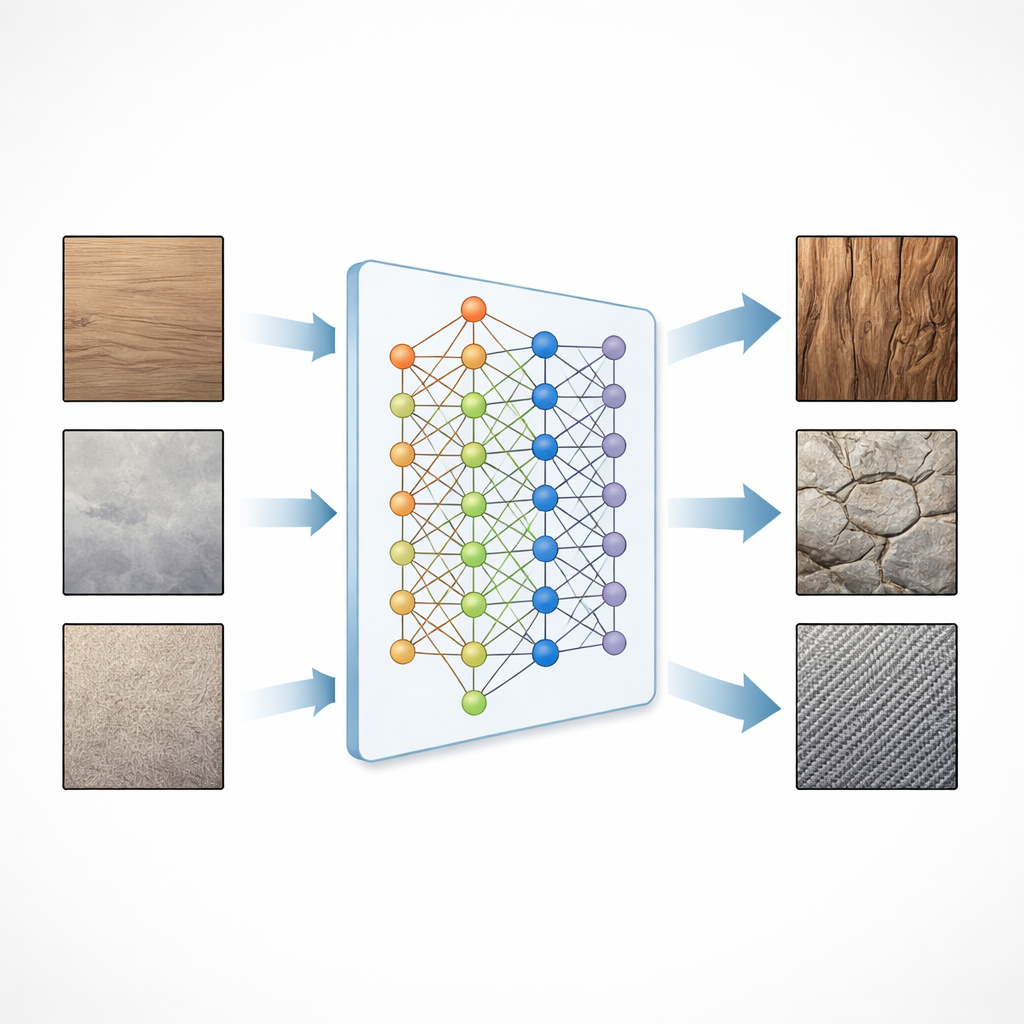

Z rozmytych kafli do realistycznych materiałów

W nowoczesnej grafice 3D wygląd obiektu kontrolowany jest przez kilka warstw przypominających obrazy, zwanych mapami tekstur. Jedna mapa określa kolor, inne kontrolują, jak chropowata, połyskująca lub metaliczna wydaje się powierzchnia. Istniejące narzędzia do skalowania skupiają się głównie na kolorze i często mają trudności z bardzo dużymi obrazami, co prowadzi do widocznych szwów, powtarzających się wzorów lub utraty detali. Autorzy proponują system, który poprawia wszystkie kluczowe warstwy materiału naraz — kolor, wysokość (przemieszczenie), metaliczność, kierunek powierzchni (normale) oraz chropowatość — dzięki czemu końcowy rezultat nie tylko wygląda ostrzej, ale też zachowuje się bardziej realistycznie przy zmieniającym się oświetleniu i kątach kamery.

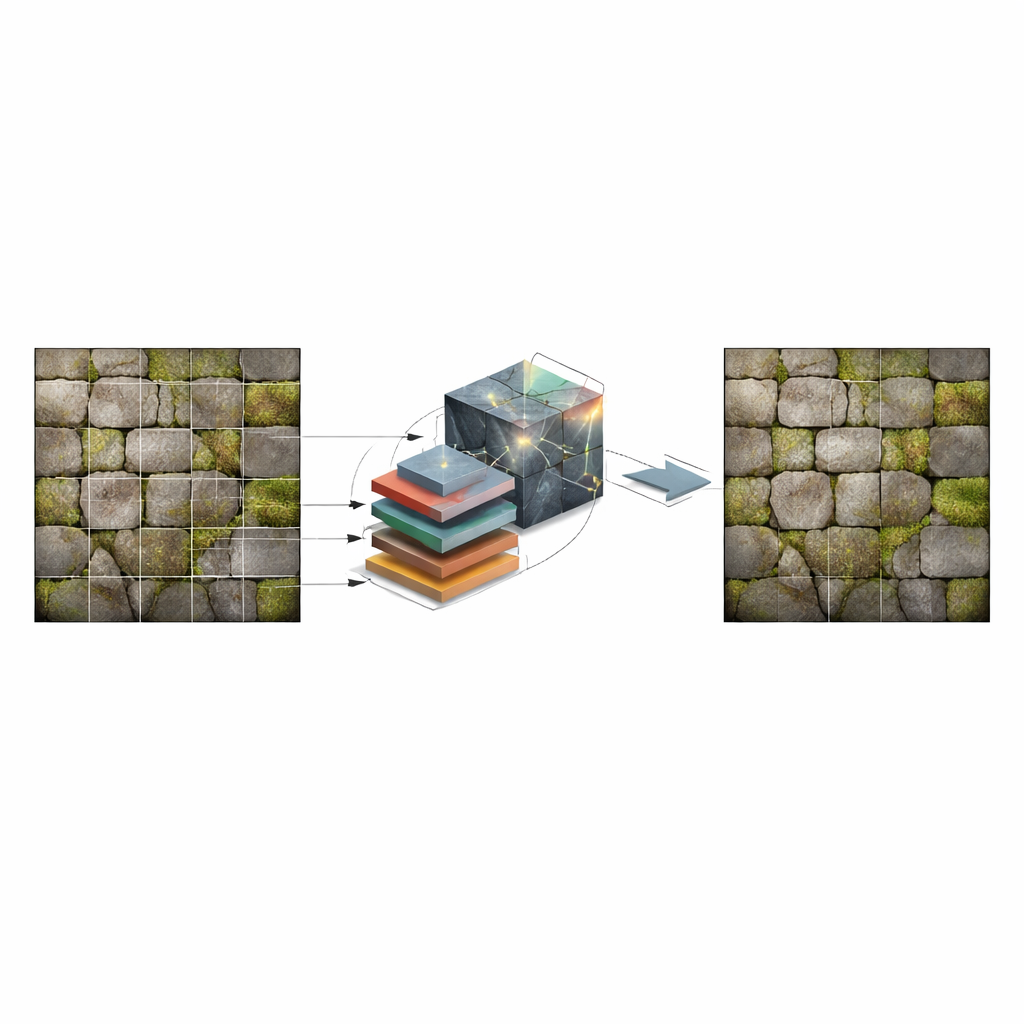

Rozbijanie problemu na części

Głównym wyzwaniem jest to, że tekstury o jakości filmowej i do gier mogą być ogromne, łatwo przeciążając pamięć typowego sprzętu graficznego. Nowe rozwiązanie radzi sobie z tym, dzieląc każdą dużą teksturę na mniejsze kafelki, które można przetwarzać niezależnie, a następnie sklejać z powrotem bez widocznych granic. Przed uczeniem tekstury są dekompresowane, dzielone na kafelki i przekazywane przez wydajną sieć głęboką zaadaptowaną z modelu znanego jako ESRGAN, który jest szczególnie dobry w wymyślaniu wiarygodnych drobnych detali. Po poprawie kafelki są ponownie łączone i rekompresowane, dając wysokorozdzielcze tekstury, które płynnie wpisują się w istniejące procesy produkcyjne.

Nauczanie sieci, jak wyglądają prawdziwe powierzchnie

Aby wytrenować system, autorzy stworzyli wyspecjalizowaną bazę danych złożoną ze 300 zestawów materiałów open-source często używanych w grach: drewna, kamienia, płytek, metalu, tkanin, wody, lawy, asfaltu, elektroniki i innych. Każdy zestaw zawiera wiele skoordynowanych map, dając sieci bogaty obraz tego, jak kolor, wysokość, połysk i chropowatość współdziałają na prawdziwych powierzchniach. Proces uczenia jest kierowany kilkoma komplementarnymi celami: dopasowaniem oryginalnych pikseli, zachowaniem struktur rozpoznawanych przez oddzielną sieć „percepcyjną” oraz rywalizacją z siecią dyskryminatora, która uczy się odróżniać prawdziwe tekstury od generowanych. Razem te mechanizmy popychają model do tworzenia wyników, które zarówno odpowiadają pomiarom, jak i wydają się przekonujące dla ludzkiego oka.

Jak to działa w praktyce

Badacze ocenili swoją metodę w porównaniu z klasycznym skalowaniem obrazów i popularnymi narzędziami do skalowania z użyciem uczenia głębokiego, w tym ESRGAN i Real-ESRGAN, korzystając ze standardowych testowych tekstur, które nie były widziane podczas treningu. Mierzono drobne różnice kolorystyczne między wynikami a teksturami referencyjnymi oraz użyto metryki FLIP firmy NVIDIA, która szacuje, jak zauważalne byłyby różnice dla oglądającego. W szerokim zakresie materiałów i map ich system konsekwentnie generował niższe błędy i wyższą postrzeganą jakość, z wyraźniejszymi wzorami i mniejszą liczbą artefaktów niż konkurencyjne podejścia. Choć metoda jest nieco wolniejsza od prostszych technik, pozostaje praktyczna zarówno do renderingu offline, jak i wielu przepływów pracy w czasie rzeczywistym.

Ograniczenia dzisiaj i kierunki rozwoju

Autorzy zauważają, że ich model działa najlepiej na materiałach podobnych do tych z zestawu treningowego; bardzo nietypowe tekstury mogą nadal wykazywać drobne błędy, a ekstremalne skalowanie wykraczające poza docelowy współczynnik przynosi malejące korzyści. Strategia oparta na kafelkach może także w rzadkich przypadkach wprowadzać słabo widoczne szwy, co sugeruje, że dalsze dopracowanie lub post-processing mogą pomóc. Przyszłe prace mogłyby dodać specjalne dostrajanie dla nowych klas materiałów, inteligentniejsze obchodzenie się ze szwami oraz dodatkowe etapy wykańczania ukierunkowane na przywracanie ultra-drobnej struktury przy ekstremalnych powiększeniach.

Bardziej ostre światy dla graczy i twórców

Mówiąc potocznie, badania te oferują sprytne „szkło powiększające” dla materiałów cyfrowych. Mając istniejące tekstury do gier lub filmów, system może automatycznie zwiększyć rozdzielczość i szczegóły we wszystkich warstwach, które rządzą wyglądem i odczuciem powierzchni, prowadząc do bogatszych, bardziej immersyjnych scen bez lawinowego wzrostu wymagań dotyczących przechowywania czy pracy ręcznej. W miarę jak takie techniki dojrzewają i się rozpowszechniają, gracze i widzowie mogą oczekiwać wirtualnych światów, których ściany, podłogi, tkaniny i krajobrazy wyglądają coraz bliżej rzeczywistości — niezależnie od tego, jak blisko ekranu się znajdą.

Cytowanie: Alonso, K., Patow, G. Deep learning for high-resolution material texture enhancement in 3D environments. Sci Rep 16, 12532 (2026). https://doi.org/10.1038/s41598-026-42313-5

Słowa kluczowe: skalowanie tekstur, grafika 3D, uczenie głębokie, sztuka do gier, rzeczywistość wirtualna