Clear Sky Science · de

Deep Learning zur hochauflösenden Verbesserung von Materialtexturen in 3D-Umgebungen

Warum schärfere Oberflächen wichtig sind

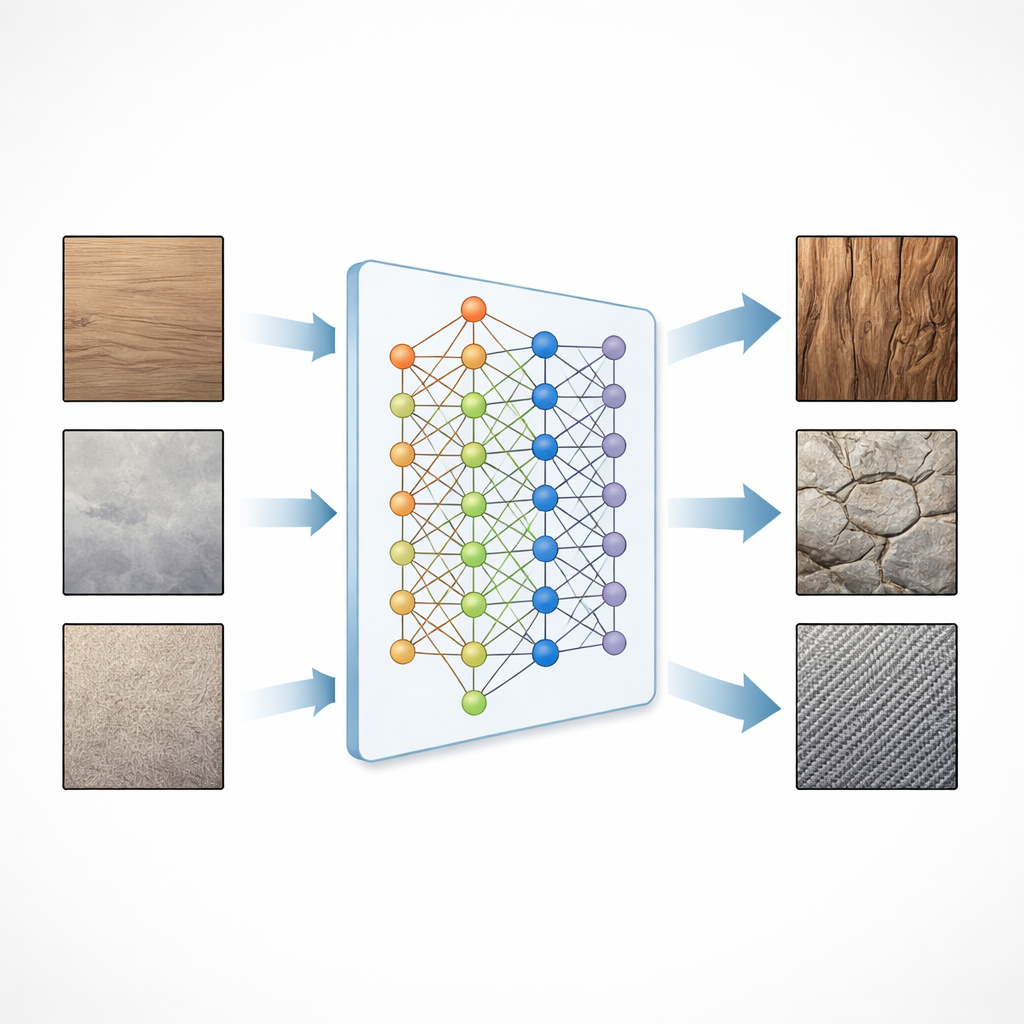

Ob Sie eine Fantasiewelt in einem Videospiel erkunden oder ein virtuelles Museum in der VR durchschreiten: Vieles von dem, was „real“ wirkt, hängt von den kleinen Details auf Oberflächen ab – die Maserung von Holz, Poren im Stein oder der Glanz von Metall. Diese Details in sehr hoher Auflösung zu erzeugen ist teuer und technisch anspruchsvoll, weshalb viele virtuelle Welten auf verschwommene oder sich wiederholende Texturen zurückgreifen, die die Illusion zerstören. Diese Arbeit stellt eine Deep‑Learning‑Methode vor, die Materialtexturen automatisch schärft und anreichert, sodass digitale Szenen lebensechter wirken, ohne dass Künstler alles von Grund auf neu erstellen müssen.

Von verschwommenen Kacheln zu lebensechten Materialien

In modernen 3D‑Grafiken wird das Aussehen eines Objekts durch mehrere bildähnliche Schichten gesteuert, sogenannte Texture Maps. Eine Map definiert die Farbe, andere steuern, wie uneben, glänzend oder metallisch eine Oberfläche erscheint. Bestehende Upscaling‑Werkzeuge konzentrieren sich meist nur auf die Farbe und haben oft Schwierigkeiten mit sehr großen Bildern, was zu sichtbaren Nähten, wiederholten Mustern oder verloren gegangenen Details führt. Die Autoren schlagen ein System vor, das alle wichtigen Materialschichten gleichzeitig verbessert – Farbe, Höhe (Displacement), Metalness, Flächenausrichtung (Normals) und Rauheit – sodass das Endresultat nicht nur schärfer aussieht, sondern sich unter wechselnden Licht‑ und Kamerabedingungen auch realistischer verhält.

Das Problem in Stücke zerlegen

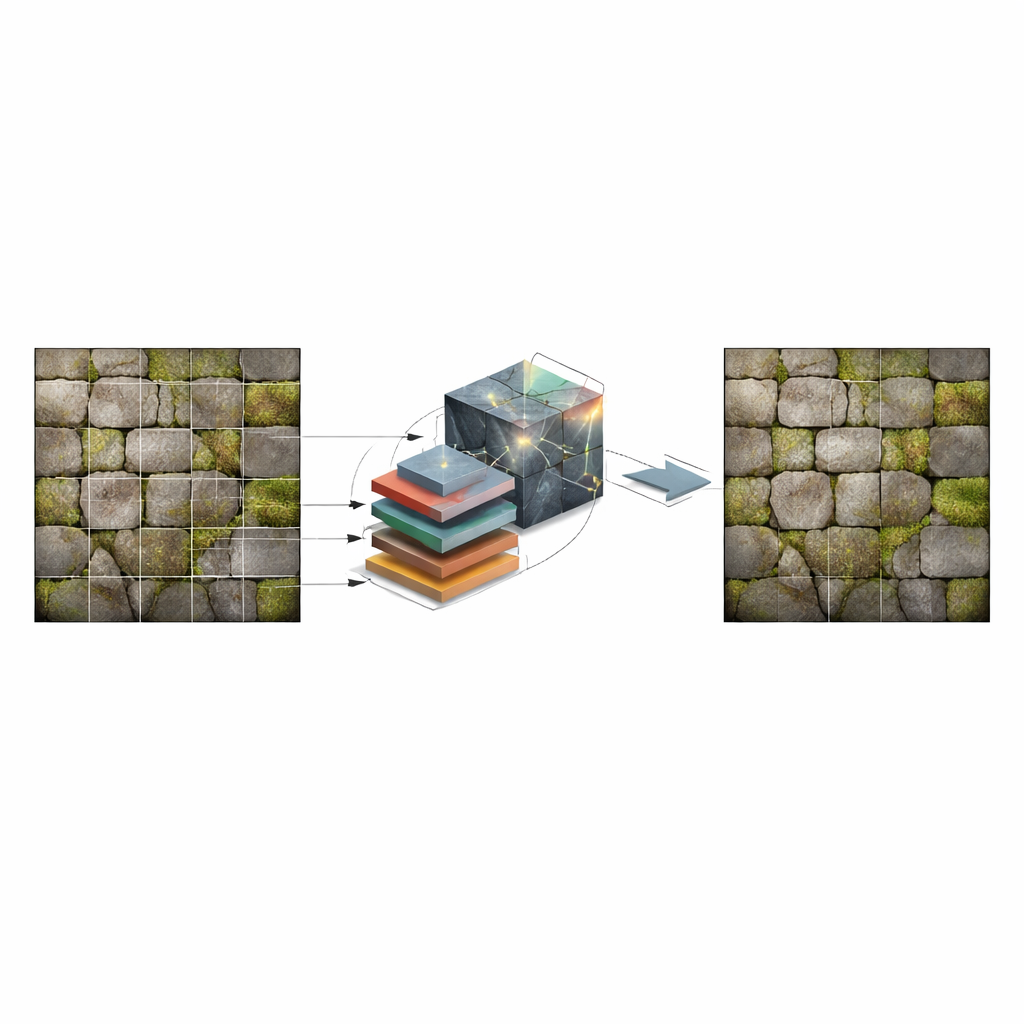

Eine zentrale Herausforderung ist, dass Film‑ und Spielqualitätstexturen sehr groß sein können und leicht den Speicher typischer Grafikhardware überfordern. Das neue Framework begegnet dem, indem jede große Textur in kleinere Kacheln aufgeteilt wird, die unabhängig verarbeitet und anschließend ohne sichtbare Ränder wieder zusammengesetzt werden. Vor dem Lernen werden Texturen dekomprimiert, in Kacheln gesplittet und durch ein leistungsfähiges Deep‑Net geführt, das von einem Modell namens ESRGAN abgeleitet ist und besonders gut darin ist, plausible feine Details zu erzeugen. Nach der Verbesserung werden die Kacheln rekombiniert und wieder komprimiert, sodass hochauflösende Texturen entstehen, die sich nahtlos in bestehende Produktionspipelines einfügen.

Dem Netzwerk beibringen, wie echte Oberflächen aussehen

Zur Schulung des Systems kuratierten die Autoren eine spezialisierte Datenbank mit 300 Open‑Source‑Materialsets, die häufig in Spielen verwendet werden: Holz, Stein, Fliesen, Metall, Stoff, Wasser, Lava, Asphalt, Elektronik und mehr. Jedes Set enthält mehrere koordinierte Maps, die dem Netzwerk ein reichhaltiges Bild davon vermitteln, wie Farbe, Höhe, Glanz und Rauheit auf echten Oberflächen zusammenwirken. Das Lernen wird von mehreren komplementären Zielen geleitet: das Abgleichen der Originalpixel, das Bewahren von Strukturen, die ein separates „Perception“-Netzwerk erkennt, und das Antreten gegen ein Diskriminatornetzwerk, das lernt, echte Texturen von generierten zu unterscheiden. Zusammengenommen treiben diese Kräfte das Modell dazu, Ergebnisse zu erzeugen, die sowohl messbar übereinstimmen als auch für das menschliche Auge überzeugend wirken.

Wie gut es in der Praxis funktioniert

Die Forschenden evaluierten ihre Methode gegenüber klassischen Bildskalierungsverfahren und beliebten Deep‑Learning‑Upscalern, darunter ESRGAN und Real‑ESRGAN, wobei sie standardisierte Testtexturen verwendeten, die nicht im Training gesehen wurden. Sie maßen winzige Farbdifferenzen zwischen den Ergebnissen und den Referenztexturen und nutzten außerdem NVIDIAs FLIP‑Metrik, die abschätzt, wie auffällig Unterschiede für einen Betrachter wären. Über eine Vielzahl von Materialien und Maps hinweg lieferte ihr System konstant geringere Fehler und eine höhere wahrgenommene Qualität, mit klareren Mustern und weniger Artefakten als konkurrierende Ansätze. Zwar ist die Methode etwas langsamer als einfachere Techniken, bleibt jedoch praktisch für sowohl Offline‑Rendering als auch viele Echtzeit‑Workflows.

Heutige Grenzen und mögliche Weiterentwicklungen

Die Autoren weisen darauf hin, dass ihr Modell am besten bei Materialien funktioniert, die denen im Trainingssatz ähneln; sehr ungewöhnliche Texturen können weiterhin kleinere Störungen zeigen, und extremes Upscaling über den Ziel‑Faktor hinaus bringt abnehmende Verbesserungen. Die kachelbasierte Strategie kann in seltenen Randfällen auch schwache Nähte erzeugen, sodass weitere Verfeinerungen oder Nachbearbeitung hilfreich wären. Zukünftige Arbeiten könnten spezialisiertes Fine‑Tuning für neue Materialklassen, intelligentere Nahtbehandlung und zusätzliche Verfeinerungsstufen zur Wiederherstellung ultrafeiner Strukturen bei extremen Zoomstufen ergänzen.

Schärfere Welten für Spieler und Gestalter

Anschaulich bietet diese Forschung eine intelligente „Lupe“ für digitale Materialien. Aus vorhandenen Spiel‑ oder Filmtexturen kann das System automatisch Auflösung und Detaillichkeit über alle Schichten erhöhen, die bestimmen, wie eine Oberfläche aussieht und sich anfühlt, und so reichhaltigere, immersivere Szenen schaffen, ohne Speicherbedarf oder manuellen Aufwand stark ansteigen zu lassen. Mit der Reifung und Verbreitung solcher Techniken können Spieler und Zuschauer virtuelle Welten erwarten, deren Wände, Böden, Stoffe und Landschaften immer näher an die Realität heranrücken – ganz gleich, wie nah sie an den Bildschirm herangehen.

Zitation: Alonso, K., Patow, G. Deep learning for high-resolution material texture enhancement in 3D environments. Sci Rep 16, 12532 (2026). https://doi.org/10.1038/s41598-026-42313-5

Schlüsselwörter: Textur-Upscaling, 3D-Grafik, Deep Learning, Game Art, Virtuelle Realität