Clear Sky Science · it

Apprendimento profondo per il miglioramento delle texture materiali ad alta risoluzione in ambienti 3D

Perché superfici più nitide sono importanti

Sia che tu stia esplorando un mondo fantasy in un videogioco sia che tu stia visitando un museo virtuale in VR, gran parte di ciò che risulta “reale” deriva dai minimi dettagli sulle superfici: la venatura del legno, le increspature della pietra e la lucentezza del metallo. Creare questi dettagli a risoluzione molto alta è costoso e tecnicamente complesso, quindi molti mondi virtuali si affidano a texture sfocate o ripetute che rompono l’illusione. Questo articolo presenta un metodo di deep learning che affina e arricchisce automaticamente queste texture materiali, rendendo le scene digitali più verosimili senza richiedere agli artisti di ricostruire tutto da zero.

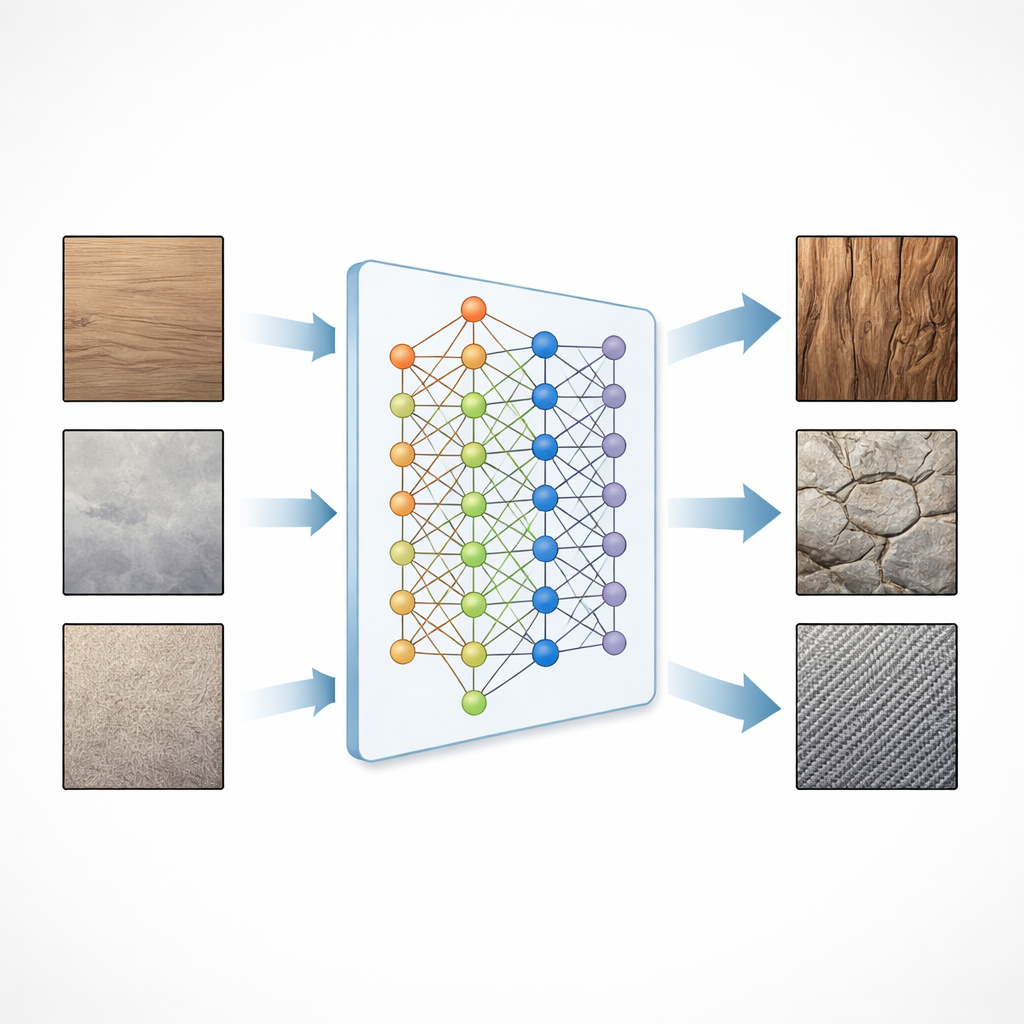

Dalle piastrelle sfocate a materiali realistici

Nella grafica 3D moderna, l’aspetto di un oggetto è controllato da diversi strati simili a immagini chiamati texture map. Una mappa definisce il colore, ma altre regolano quanto una superficie sia irregolare, lucida o metallica. Gli strumenti di upscaling esistenti si concentrano per lo più sul solo colore e spesso faticano con immagini molto grandi, causando giunzioni visibili, pattern ripetuti o perdita di dettaglio. Gli autori propongono un sistema che migliora contemporaneamente tutti gli strati materiali chiave—colore, altezza (displacement), metallicità, direzione della superficie (normali) e rugosità—così il risultato finale non solo appare più nitido ma si comporta anche in modo più realistico con cambiamenti di illuminazione e angoli di visuale.

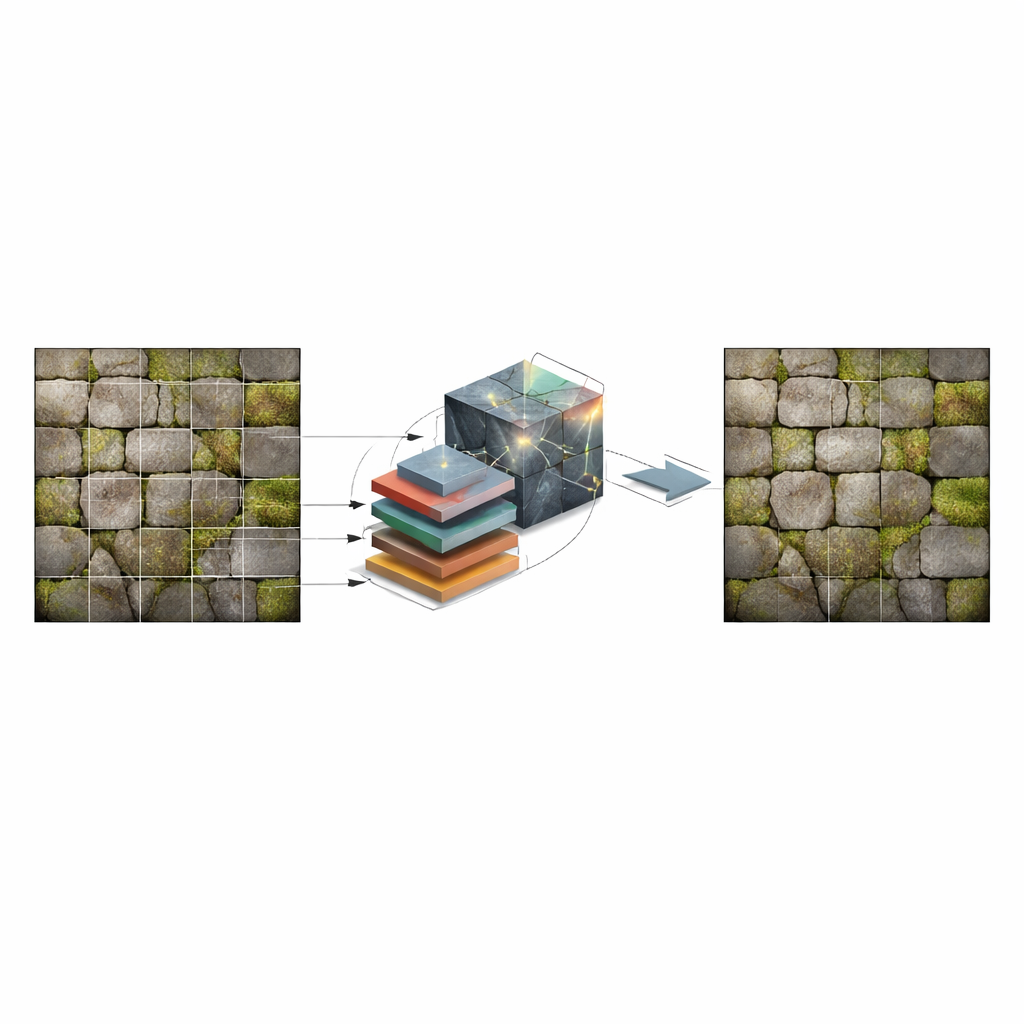

Suddividere il problema in parti

Una sfida centrale è che le texture di qualità cinematografica o di gioco possono essere enormi, facilmente superiori alla memoria dell’hardware grafico tipico. Il nuovo framework affronta questo problema suddividendo ogni grande texture in piastrelle più piccole che possono essere processate indipendentemente e poi ricomposte senza bordi visibili. Prima dell’apprendimento, le texture vengono decompressi, divise in tile e passate attraverso una rete profonda potente adattata da un modello noto come ESRGAN, particolarmente capace di inventare dettagli fini plausibili. Dopo l’arricchimento, le tile vengono ricombinate e ricompresse, producendo texture ad alta risoluzione che si integrano agevolmente nei flussi di produzione esistenti.

Insegnare alla rete come sono le superfici reali

Per addestrare il sistema, gli autori hanno curato un database specializzato di 300 set di materiali open-source comunemente usati nei giochi: legno, pietra, piastrelle, metallo, tessuto, acqua, lava, asfalto, componenti elettronici e altro. Ogni set include diverse map coordinate, offrendo alla rete una rappresentazione ricca di come colore, altezza, lucentezza e rugosità interagiscano sulle superfici reali. L’apprendimento è guidato da diversi obiettivi complementari: corrispondenza dei pixel originali, preservazione di strutture riconosciute da una rete di “percezione” separata e competizione contro una rete discriminatrice che impara a distinguere texture reali da quelle generate. Insieme, queste forze spingono il modello a creare risultati che corrispondono alle misure e risultano convincenti all’occhio umano.

Quanto funziona in pratica

I ricercatori hanno valutato il loro metodo rispetto al ridimensionamento classico delle immagini e ad upscaler deep-learning popolari, inclusi ESRGAN e Real-ESRGAN, usando texture di test standard non viste durante l’addestramento. Hanno misurato piccole differenze di colore tra le uscite e le texture di riferimento e hanno usato anche la metrica FLIP di NVIDIA, che stima quanto sarebbero percepibili le differenze per un osservatore. Su una gamma di materiali e mappe, il loro sistema ha costantemente prodotto errori inferiori e qualità percepita maggiore, con pattern più nitidi e meno artefatti rispetto agli approcci concorrenti. Sebbene il metodo sia un po’ più lento rispetto a tecniche più semplici, rimane pratico sia per rendering offline sia per molti flussi di lavoro in tempo reale.

Limiti attuali e possibili sviluppi

Gli autori osservano che il loro modello funziona meglio su materiali simili a quelli del set di addestramento; texture molto insolite possono ancora mostrare piccoli difetti e l’upscaling estremo oltre il fattore previsto dà rendimenti decrescenti. La strategia basata su tile può anche introdurre lievi giunzioni in rari casi limite, suggerendo che ulteriori affinamenti o post-elaborazioni potrebbero aiutare. Lavori futuri potrebbero aggiungere messa a punto specializzata per nuove classi di materiali, una gestione più intelligente delle giunzioni e fasi di raffinamento aggiuntive volte a ripristinare strutture ultra-fini per livelli di zoom estremi.

Worlds più nitidi per giocatori e creatori

In termini pratici, questa ricerca offre una sorta di “lente d’ingrandimento” intelligente per i materiali digitali. Date texture esistenti per giochi o film, il sistema può aumentare automaticamente risoluzione e dettaglio su tutti gli strati che determinano l’aspetto e la percezione di una superficie, portando a scene più ricche e immersive senza aumentare drasticamente lo spazio di archiviazione o il lavoro manuale. Con il perfezionarsi e la diffusione di queste tecniche, giocatori e spettatori possono aspettarsi mondi virtuali i cui muri, pavimenti, tessuti e paesaggi assomigliano sempre di più alla realtà—indipendentemente da quanto si avvicinino allo schermo.

Citazione: Alonso, K., Patow, G. Deep learning for high-resolution material texture enhancement in 3D environments. Sci Rep 16, 12532 (2026). https://doi.org/10.1038/s41598-026-42313-5

Parole chiave: upscaling delle texture, grafica 3D, apprendimento profondo, arte per videogiochi, realtà virtuale