Clear Sky Science · nl

Diep leren voor het verbeteren van materiaaltexturen met hoge resolutie in 3D-omgevingen

Waarom scherpere oppervlakken ertoe doen

Of je nu een fantasiewereld in een videogame verkent of door een virtueel museum in VR loopt, veel van wat ‘‘echt’’ aanvoelt hangt af van de kleine details op oppervlakken: de nerf in hout, de putjes in steen en de glans van metaal. Het creëren van die details in zeer hoge resolutie is duur en technisch ingewikkeld, dus veel virtuele werelden gebruiken wazige of repeterende texturen die de illusie doorbreken. Dit artikel presenteert een methode met deep learning die deze materiaaltexturen automatisch verscherpt en verrijkt, waardoor digitale scènes realistischer ogen zonder dat artiesten alles vanaf nul hoeven op te bouwen.

Van vage tegels naar levensechte materialen

In moderne 3D-graphics wordt het uiterlijk van een object geregeld door verschillende afbeeldingsachtige lagen, zogenaamde texture maps. Eén map bepaalt kleur, maar andere regelen hoe bobbelig, glanzend of metallic een oppervlak lijkt. Bestaande opschaaltools richten zich meestal alleen op kleur en hebben vaak moeite met zeer grote afbeeldingen, wat leidt tot zichtbare naden, herhaalde patronen of verloren details. De auteurs stellen een systeem voor dat alle belangrijke materiaal-lagen tegelijk verbetert—kleur, hoogte (displacement), metalness, oppervlaktrichting (normals) en ruwheid—zodat het eindresultaat niet alleen scherper oogt maar zich ook realistischer gedraagt onder wisselend licht en camerahoeken.

Het probleem in stukken hakken

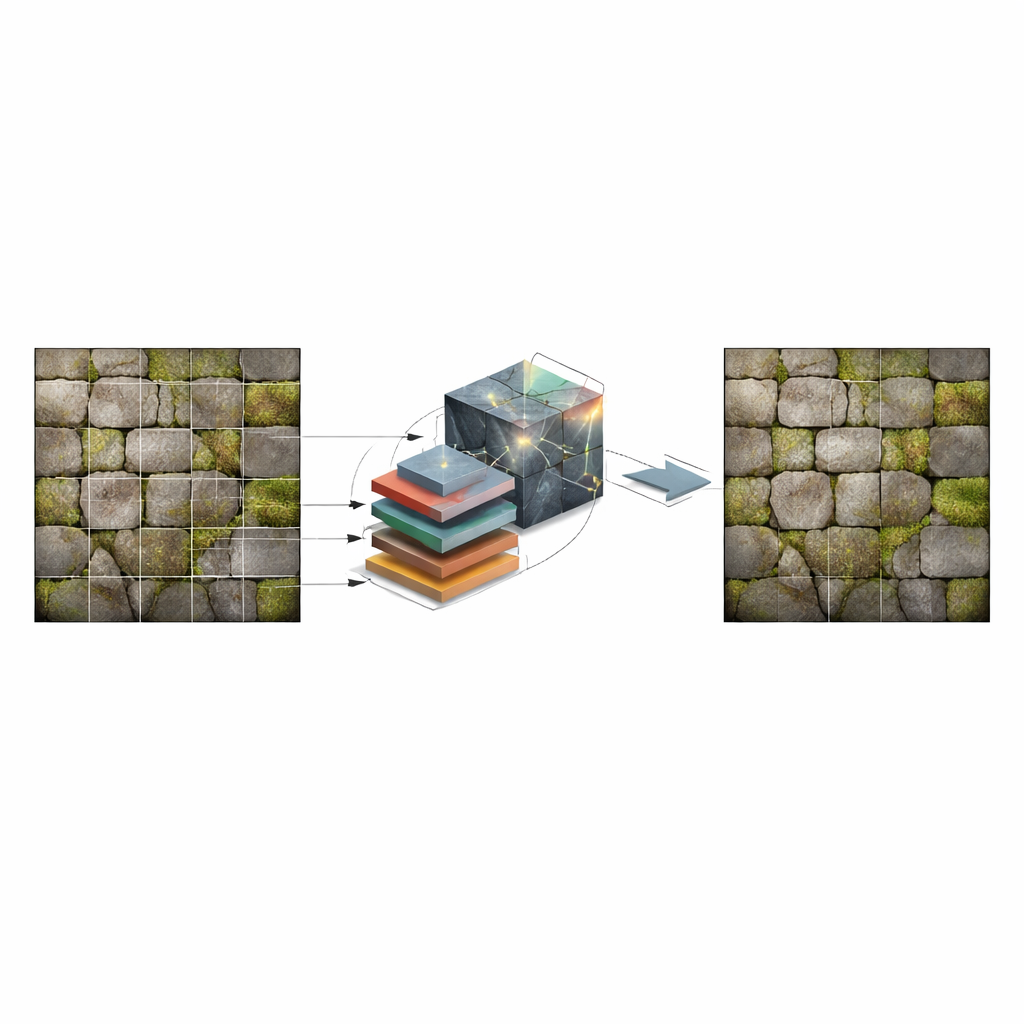

Een centrale uitdaging is dat film- en game-kwaliteit texturen enorm kunnen zijn en makkelijk het geheugen van typische graphics-hardware kunnen overbelasten. Het nieuwe kader pakt dit aan door elke grote textuur in kleinere tegels te verdelen die onafhankelijk verwerkt kunnen worden en daarna zonder zichtbare randen weer aan elkaar worden gezet. Voor het leren worden texturen gedecomprimeerd, in tegels opgedeeld en door een krachtig deep-netwerk gevoerd dat is afgeleid van een model bekend als ESRGAN, dat bijzonder goed is in het verzinnen van plausibele fijne details. Na verbetering worden de tegels opnieuw gecombineerd en gecomprimeerd, wat resulteert in hoge-resolutie texturen die soepel in bestaande productiepijplijnen passen.

Het netwerk leren wat echte oppervlakken zijn

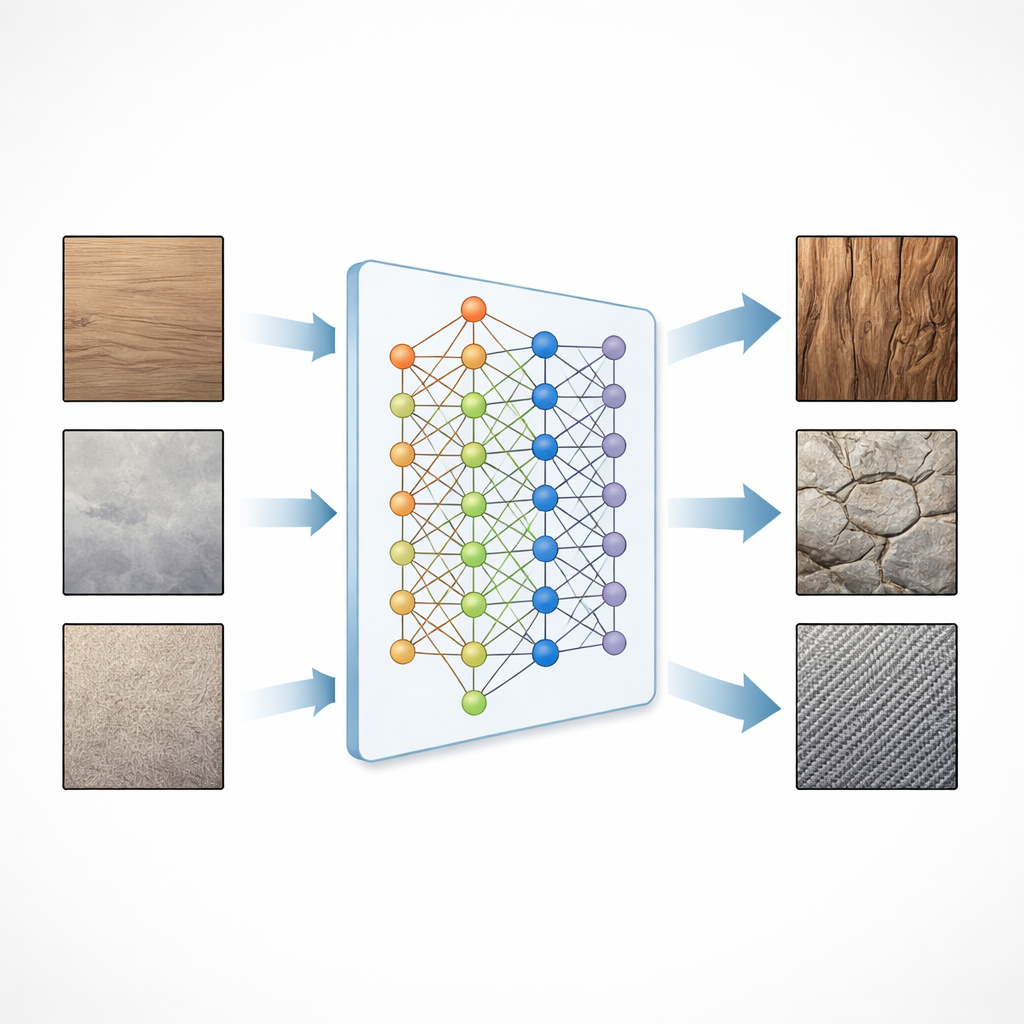

Om het systeem te trainen hebben de auteurs een gespecialiseerde database samengesteld van 300 open-source materiaalsets die vaak in games worden gebruikt: hout, steen, tegels, metaal, textiel, water, lava, asfalt, elektronica en meer. Elke set bevat meerdere gecoördineerde maps, waardoor het netwerk een rijk beeld krijgt van hoe kleur, hoogte, glans en ruwheid op echte oppervlakken samenwerken. Het leren wordt gestuurd door meerdere aanvullende doelen: het matchen van de originele pixels, het behouden van structuren die door een apart ‘‘perceptie’’-netwerk worden herkend, en het concurreren tegen een discriminator-netwerk dat leert echte texturen van gegenereerde te onderscheiden. Gezamenlijk duwen deze krachten het model naar resultaten die zowel aan meetwaarden voldoen als overtuigend ogen voor het menselijke oog.

Hoe goed het in de praktijk werkt

De onderzoekers evalueerden hun methode tegenover klassieke afbeeldingsresizing en populaire deep-learning upscalers, waaronder ESRGAN en Real-ESRGAN, met gebruik van standaard testtexturen die niet tijdens de training waren gezien. Ze maten kleine kleursverschillen tussen outputs en grondwaarheid-texturen en gebruikten ook NVIDIA’s FLIP-metric, die inschat hoe merkbaar verschillen voor een kijker zouden zijn. Over een reeks materialen en maps produceerde hun systeem consequent lagere fouten en hogere waargenomen kwaliteit, met duidelijkere patronen en minder artefacten dan concurrerende benaderingen. Hoewel de methode iets trager is dan eenvoudigere technieken, blijft ze praktisch voor zowel offline rendering als veel realtime workflows.

Beperkingen vandaag en wegen vooruit

De auteurs merken op dat hun model het beste werkt bij materialen die lijken op die in de trainingsset; zeer ongebruikelijke texturen kunnen nog steeds kleine glitches vertonen, en extreem opschalen voorbij de doelfactor levert afnemende baten op. De tegelgebaseerde strategie kan ook in zeldzame randgevallen vage naden introduceren, wat suggereert dat verdere verfijning of nabewerking nuttig kan zijn. Toekomstig werk zou gespecialiseerde fine-tuning voor nieuwe materiaaltypes kunnen toevoegen, slimmere naadverwerking en extra verfijningsfases gericht op het herstellen van ultra-fijne structuren voor extreme zoomniveaus.

Scherpere werelden voor spelers en makers

In gewone bewoordingen biedt dit onderzoek een slimme ‘‘vergrootglans’’ voor digitale materialen. Met bestaande game- of filmtexturen kan het systeem automatisch resolutie en detail verhogen over alle lagen die bepalen hoe een oppervlak eruitziet en aanvoelt, wat leidt tot rijkere, meer meeslepende scènes zonder dat opslag of handwerk de pan uits rijst. Naarmate zulke technieken rijpen en zich verspreiden, kunnen spelers en kijkers virtuele werelden verwachten waarvan muren, vloeren, stoffen en landschappen er steeds dichter bij de werkelijkheid uitzien—ongeacht hoe dicht ze bij het scherm komen.

Bronvermelding: Alonso, K., Patow, G. Deep learning for high-resolution material texture enhancement in 3D environments. Sci Rep 16, 12532 (2026). https://doi.org/10.1038/s41598-026-42313-5

Trefwoorden: texture upscaling, 3D graphics, deep learning, game art, virtual reality