Clear Sky Science · pl

Ramowy model odwrotnego projektowania oparty na zastępczym modelu dla celowanej kontroli średnicy w elektroprzędzeniu nanowłókien

Dlaczego drobne włókna mają znaczenie

Wiele codziennych technologii, od filtrów powietrza i opatrunków medycznych po czujniki i baterie, opiera się na matach z niezwykle cienkich nitek zwanych nanowłóknami. Grubość tych włókien — często zaledwie kilkaset miliardowych części metra — silnie wpływa na ich zdolność do filtrowania cząstek, kierowania wzrostem komórek czy magazynowania energii. Jednak precyzyjne ustalenie pożądanej średnicy włókien zwykle oznacza żmudne eksperymenty metodą prób i błędów w laboratorium. W artykule przedstawiono inteligentniejszą, sterowaną komputerowo metodę projektowania nanowłókien o zadanych średnicach szybko i niezawodnie, co może przyspieszyć innowacje w wielu produktach wykorzystujących te delikatne struktury.

Od wirujących strug do inteligentnego projektowania

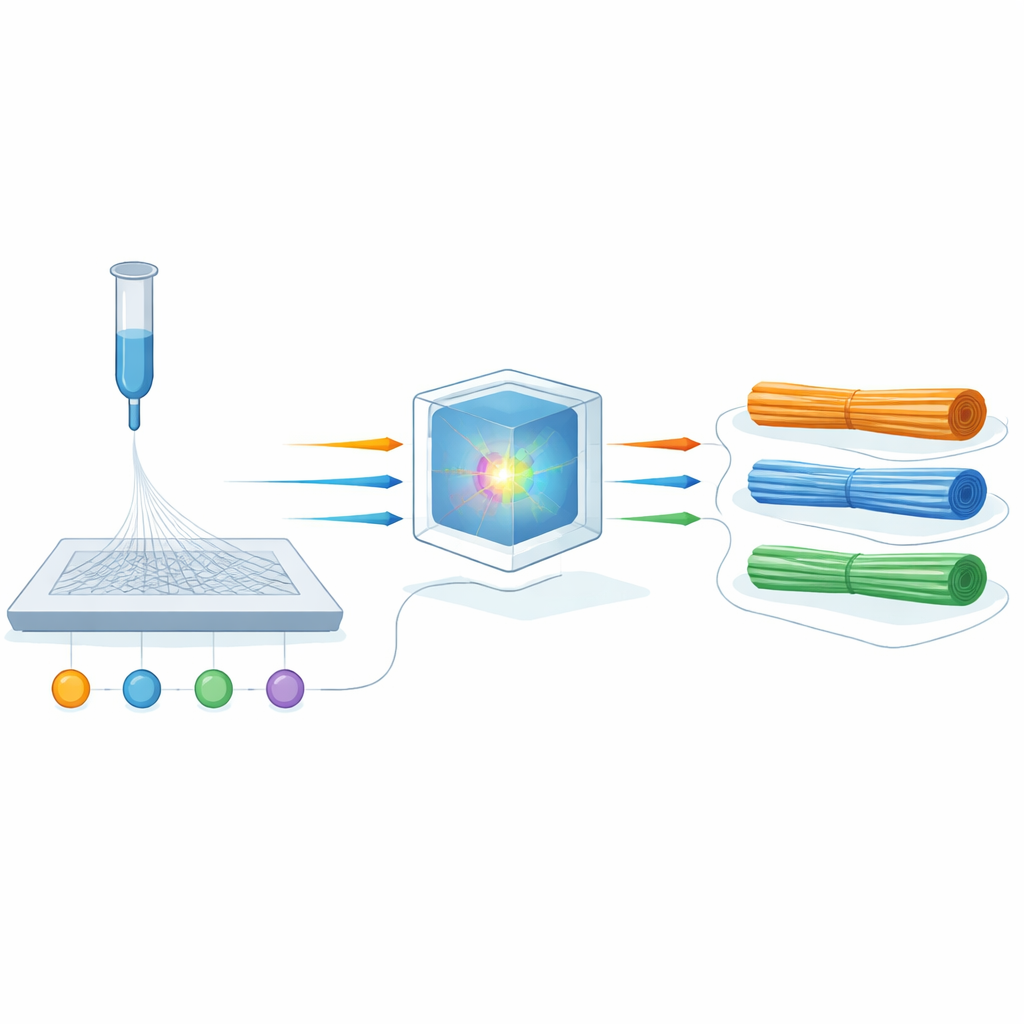

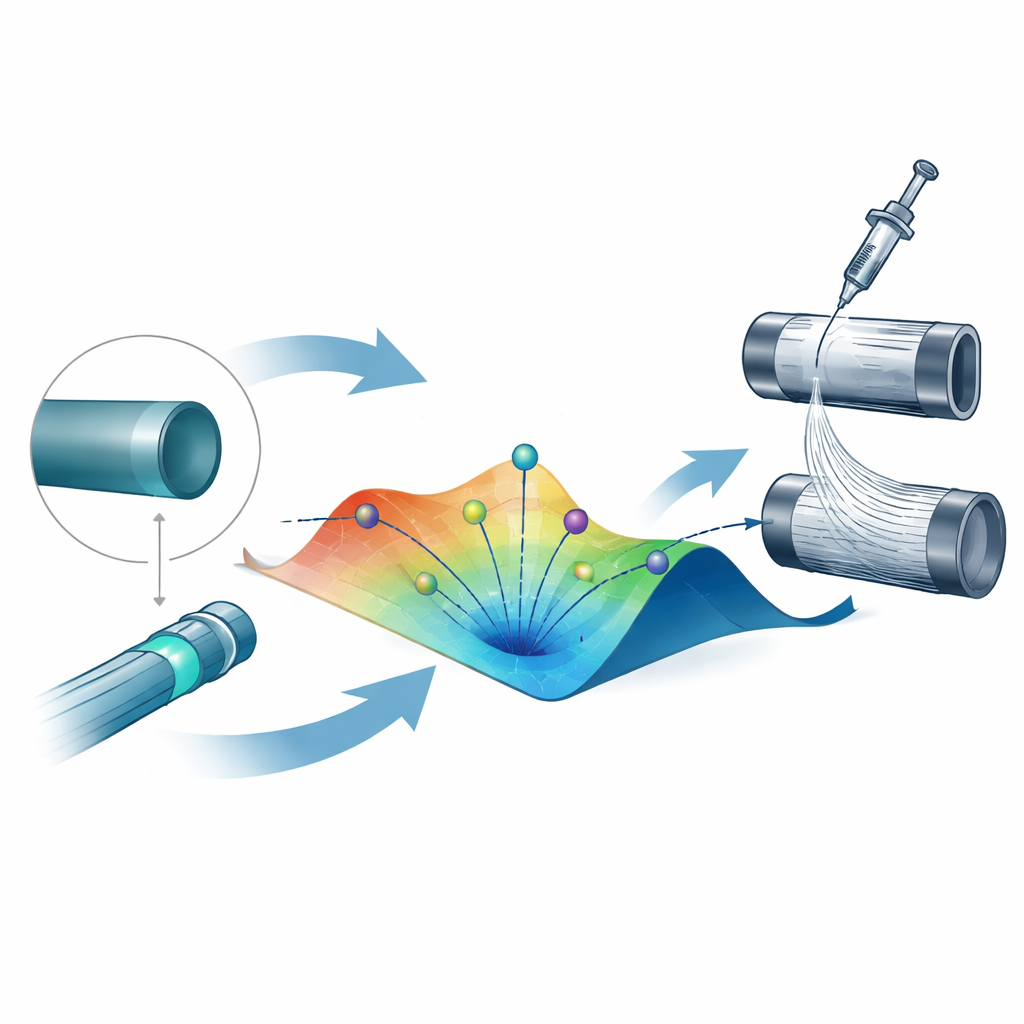

Badanie skupia się na elektroprzędzeniu, powszechnie stosowanej metodzie wytwarzania ciągłych nanowłókien. W typowym układzie wysokie napięcie wyciąga cienką strugę roztworu polimerowego z igły w stronę kolektora, rozciągając ją w drobne włókna w miarę odparowywania rozpuszczalnika. Modyfikacja receptury roztworu, przyłożonego napięcia, szybkości przepływu i odległości do kolektora może dać włókna grubsze lub cieńsze, gładsze lub bardziej porowate. Jednak te parametry oddziałują ze sobą w złożony, nieliniowy sposób, więc niewielkie zmiany mogą prowadzić do nieprzewidywalnych efektów. Zamiast polegać na regułach praktycznych, autorzy proponują zbudowanie „cyfrowego bliźniaka” procesu, który potrafi przewidzieć średnicę włókna na podstawie ograniczonego zestawu starannie dobranych eksperymentów, a następnie wykorzystać ten model odwrotnie, by znaleźć ustawienia dające pożądaną grubość.

Budowa cyfrowego bliźniaka procesu włókna

Aby skonstruować ten cyfrowy bliźniak, zespół wykorzystał istniejący, starannie zaprojektowany zestaw danych z 96 eksperymentów elektroprzędzenia na poli(alkoholu winylowego) (PVA), powszechnie stosowanym polimerze rozpuszczalnym w wodzie. Każdy eksperyment zmieniał cztery kluczowe parametry procesu: stężenie roztworu, przyłożone napięcie, szybkość przepływu i odległość między końcówką a kolektorem, oraz rejestrował uzyskaną średnią średnicę włókien, która mieściła się w przedziale około 200–350 nanometrów. Badacze przetestowali jedenaście różnych metod uczenia maszynowego, aby sprawdzić, która najlepiej potrafi nauczyć się zależności między tymi czterema wejściami a średnicą włókien. Modele te obejmowały proste dopasowania liniowe oraz bardziej elastyczne modele „zespołowe”, łączące wiele małych drzew decyzyjnych.

Co naprawdę kontroluje rozmiar włókna

Spośród wszystkich modeli najlepiej wypadł algorytm zwany Extreme Gradient Boosting (XGBoost), tłumacząc około 89 procent zmienności średnicy włókien na wcześniej niewidzianych danych. Aby upewnić się, że model jest nie tylko dokładny, ale też fizycznie sensowny, autorzy zastosowali narzędzie interpretowalności znane jako analiza SHAP. Podejście to oszacowuje, jak bardzo każdy z wejściowych parametrów przyczynia się do predykcji. Wykazało ono, że kluczową rolę odgrywają przyłożone napięcie i stężenie roztworu: wyższe napięcie zazwyczaj silniej rozciąga strugę, dając cieńsze włókna, podczas gdy wyższe stężenie (a więc gęstszy, bardziej lepki roztwór) przeciwdziała rozciąganiu i daje grubsze włókna. Szybkość przepływu i odległość miały mniejsze znaczenie, lecz nadal wpływały na średnicę, zgodnie z obserwacjami eksperymentalistów.

Pozwolenie algorytmom na poszukiwanie właściwej receptury

Po zbudowaniu modelu zastępczego zespół zmierzył się z problemem „projektowania odwrotnego”: mając docelową średnicę, jakie ustawienia procesu należy zastosować? Sformułowali to jako minimalizację różnicy między średnicą przewidywaną przez model a wartością docelową, przy jednoczesnym utrzymaniu wszystkich parametrów w realistycznych zakresach. Porównano siedem strategii optymalizacji, od brutalnego przeszukiwania siatki i prostego losowego poszukiwania po zaawansowane metody populacyjne, które iteracyjnie udoskonalają wiele kandydatów. Technika zwana Particle Swarm Optimization (PSO), naśladująca grupę cząstek eksplorujących krajobraz i dzielących się informacją, okazała się zdecydowanym zwycięzcą. Osiągała docelowe średnice z bardzo małymi błędami — średnio w granicach około 2 nanometrów — i robiła to konsekwentnie w powtarzanych uruchomieniach, przy umiarkowanych czasach obliczeń.

Ograniczenia i możliwości rozwoju

Ramowy model jest obecnie dostrojony do jednego polimeru w kontrolowanych warunkach laboratoryjnych, więc jeszcze nie potrafi przewidywać zachowania dla zupełnie innych materiałów ani zmieniających się warunków otoczenia, takich jak wilgotność. Zestaw danych, choć starannie zaplanowany, jest stosunkowo niewielki i nie zawiera powtarzalnych pomiarów w identycznych warunkach, co pomogłoby oszacować naturalną zmienność. Autorzy argumentują, że dodanie większej liczby eksperymentów, w tym różnych polimerów i warunków otoczenia, oraz wprowadzanie nowych wyników z powrotem do modelu uczyni cyfrowego bliźniaka bardziej uniwersalnym i niezawodnym. Sugerują także rozszerzenie metody tak, aby kontrolowała nie tylko średnicę, lecz także inne cechy, takie jak wytrzymałość włókien czy faktura powierzchni, oraz włączenie praktycznych ograniczeń produkcyjnych bezpośrednio do procesu optymalizacji.

Co to oznacza dla przyszłych materiałów

Łącząc napędzany danymi cyfrowy bliźniak z wydajnym algorytmem poszukiwań, praca ta przekształca elektroprzędzenie z rzemiosła opartego na doświadczeniu w bardziej przewidywalne zadanie projektowe. Zamiast wykonywać dziesiątki prób, by uzyskać właściwy rozmiar włókna, badacze i inżynierowie mogliby określić cel, a komputer zaproponowałby wykonalne ustawienia procesu w kilka sekund, po czym zweryfikowaliby eksperymentalnie tylko kilka propozycji. Chociaż demonstracja dotyczy nanowłókien, ta sama strategia — uczenie się z kompaktowego zestawu eksperymentów, a następnie wykorzystanie tej wiedzy w kierunku odwrotnym — mogłaby przyspieszyć projektowanie wielu innych materiałów i procesów, pomagając szybciej przekształcać koncepcje nowych filtrów, rusztowań, baterii i powłok w gotowe rozwiązania.

Cytowanie: Mahdian, M., Ender, F. & Pardy, T. A surrogate-based inverse design framework for targeted diameter control of electrospun nanofibers. Sci Rep 16, 11034 (2026). https://doi.org/10.1038/s41598-026-40692-3

Słowa kluczowe: elektroprzędzenie, nanowłókna, projektowanie odwrotne, uczenie maszynowe, optymalizacja procesu