Clear Sky Science · es

Un marco de diseño inverso basado en modelos sustitutos para el control dirigido del diámetro de nanofibras electrohiladas

Por qué importan las fibras diminutas

Muchas tecnologías cotidianas, desde filtros de aire y vendas médicas hasta sensores y baterías, dependen de esteras de hilos extremadamente finos llamadas nanofibras. El grosor de estas fibras —a menudo apenas unos cientos de miles de millones de metro— afecta de forma decisiva su capacidad para filtrar partículas, orientar el crecimiento celular o almacenar energía. Sin embargo, afinar con precisión el espesor de las fibras suele requerir tediosos ensayos por prueba y error en el laboratorio. Este artículo presenta una forma más inteligente y guiada por ordenador para diseñar nanofibras con diámetros elegidos de manera rápida y fiable, lo que podría acelerar la innovación en muchos productos que dependen de estas estructuras delicadas.

De chorros que giran a un diseño inteligente

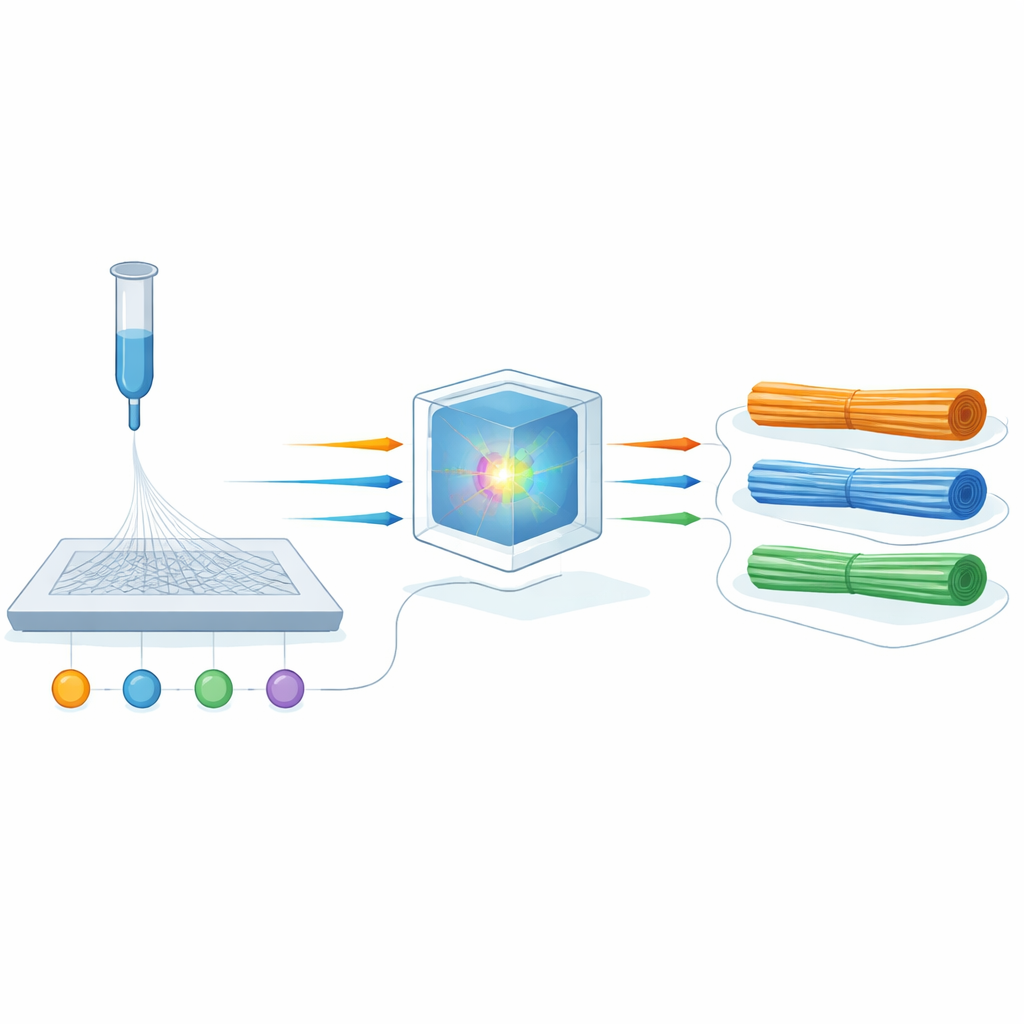

El estudio se centra en la electrohilatura, un método de uso generalizado para fabricar nanofibras continuas. En un montaje típico, un alto voltaje atrae un fino chorro de una solución polimérica desde una aguja hacia un colector, estirándolo hasta convertirlo en fibras finas a medida que se evapora el disolvente. Ajustar la formulación de la solución, el voltaje aplicado, la velocidad de flujo y la distancia al colector puede producir fibras más gruesas o más finas, más lisas o más porosas. Pero estas perillas interactúan de formas complejas y no lineales, de modo que pequeños cambios pueden dar resultados impredecibles. En lugar de confiar en reglas empíricas, los autores proponen construir un “gemelo digital” del proceso que pueda predecir el diámetro de la fibra a partir de un conjunto limitado de experimentos bien escogidos, y luego usar ese gemelo a la inversa para encontrar las condiciones que producen el grosor deseado.

Construyendo un gemelo digital del proceso de fibras

Para construir este gemelo digital, el equipo utilizó un conjunto de datos existente y cuidadosamente diseñado de 96 experimentos de electrohilatura sobre poli(acetato de vinilo) (poly(vinyl alcohol)), un polímero común soluble en agua. Cada experimento varió cuatro parámetros clave del proceso: concentración de la solución, voltaje aplicado, caudal y distancia punta-colector, y registró el diámetro medio de las fibras resultantes, que oscilaron entre aproximadamente 200 y 350 nanómetros. Los investigadores probaron once métodos diferentes de aprendizaje automático para ver cuál aprendía mejor la relación entre las cuatro entradas y el diámetro de la fibra. Estos iban desde ajustes lineales simples hasta modelos de “conjunto” más flexibles que combinan muchos pequeños árboles de decisión.

Descubriendo qué controla realmente el tamaño de la fibra

Entre todos los modelos, un algoritmo llamado Extreme Gradient Boosting (XGBoost) fue el que mejor rendimiento obtuvo, explicando alrededor del 89 por ciento de la variación en el diámetro de las fibras sobre datos no vistos previamente. Para asegurarse de que este modelo no solo fuera preciso sino también físicamente coherente, los autores emplearon una herramienta de interpretabilidad conocida como análisis SHAP. Este enfoque estima cuánto contribuye cada entrada a la predicción. Reveló que el voltaje aplicado y la concentración de la solución dominan el espesor de la fibra: un voltaje mayor tiende a estirar más el chorro, produciendo fibras más finas, mientras que una mayor concentración (y por tanto una solución más viscosa y densa) se opone al estiramiento y genera fibras más gruesas. El caudal y la distancia importaron menos, pero aun así influyeron en el diámetro, en consonancia con lo que los experimentalistas han observado durante mucho tiempo.

Dejar que los algoritmos busquen la receta adecuada

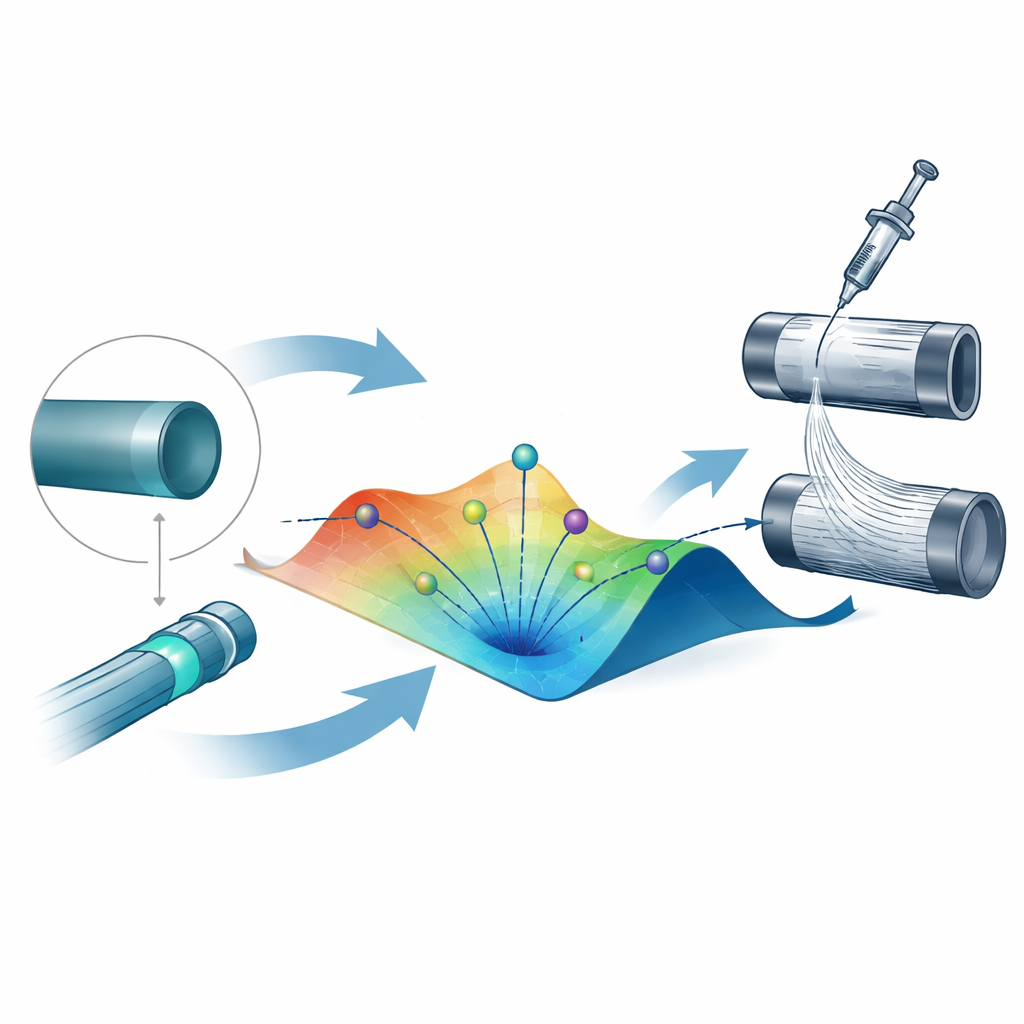

Con el modelo sustituto en marcha, el equipo abordó el problema de “diseño inverso”: dado un diámetro objetivo, ¿qué ajustes del proceso deben usarse? Lo plantearon como minimizar la diferencia entre el diámetro predicho por el modelo y el valor deseado, manteniendo todos los parámetros dentro de rangos realistas. Se compararon siete estrategias de optimización, desde el barrido de malla bruto y la búsqueda aleatoria simple hasta métodos avanzados basados en poblaciones que refinan de forma iterativa muchas soluciones candidatas. Una técnica llamada Optimización por Enjambre de Partículas (Particle Swarm Optimization, PSO), que imita a un grupo de partículas explorando un paisaje y compartiendo información, resultó ser la ganadora clara. Alcanzó diámetros objetivo con errores extremadamente pequeños —de media en torno a 2 nanómetros— y lo hizo de forma consistente en ejecuciones repetidas, manteniendo además tiempos de cálculo modestos.

Limitaciones y margen de mejora

El marco está actualmente afinado para un polímero en un entorno de laboratorio controlado, por lo que todavía no puede predecir el comportamiento para materiales completamente distintos o condiciones ambientales variables como la humedad. El conjunto de datos, a pesar de estar cuidadosamente planificado, es relativamente pequeño y carece de mediciones repetidas bajo condiciones idénticas, lo que ayudaría a cuantificar la variabilidad natural. Los autores sostienen que añadir más experimentos, incluidos distintos polímeros y condiciones ambientales, y retroalimentar los nuevos resultados al modelo hará que el gemelo digital sea más general y fiable. También sugieren ampliar el método para controlar no solo el diámetro sino otras características, como la resistencia de la fibra o la textura superficial, e incorporar directamente restricciones prácticas de fabricación en la optimización.

Qué significa esto para los materiales del futuro

Al combinar un gemelo digital basado en datos con un potente algoritmo de búsqueda, este trabajo convierte la electrohilatura de un arte guiado por la experiencia en una tarea de diseño más predecible. En lugar de realizar decenas de ensayos para alcanzar el tamaño de fibra correcto, los investigadores o ingenieros podrían especificar un objetivo y dejar que el ordenador proponga ajustes de proceso viables en segundos, para luego validar solo unas pocas sugerencias experimentalmente. Aunque se demuestra en nanofibras, la misma estrategia —aprender a partir de un conjunto compacto de experimentos y luego utilizar ese conocimiento a la inversa— podría acelerar el diseño de muchos otros materiales y procesos, ayudando a que nuevos filtros, andamiajes, baterías y recubrimientos pasen del concepto a la realidad más rápidamente.

Cita: Mahdian, M., Ender, F. & Pardy, T. A surrogate-based inverse design framework for targeted diameter control of electrospun nanofibers. Sci Rep 16, 11034 (2026). https://doi.org/10.1038/s41598-026-40692-3

Palabras clave: electrospinning, nanofibers, inverse design, machine learning, process optimization