Clear Sky Science · fr

Un cadre de conception inverse basé sur un substitut pour le contrôle ciblé du diamètre des nanofibres électrodéposées

Pourquoi de minuscules fibres comptent

De nombreuses technologies quotidiennes, des filtres à air et pansements médicaux aux capteurs et batteries, reposent sur des nappes de fils extrêmement fins appelés nanofibres. L’épaisseur de ces fibres — souvent de l’ordre de quelques centaines de milliardièmes de mètre — influence fortement leur capacité à filtrer des particules, à orienter la croissance cellulaire ou à stocker de l’énergie. Pourtant, obtenir une épaisseur précise nécessite généralement des essais laborieux en laboratoire. Cet article présente une méthode plus intelligente, guidée par ordinateur, pour concevoir rapidement et de façon fiable des nanofibres de diamètres choisis, ce qui pourrait accélérer l’innovation pour de nombreux produits dépendant de ces structures délicates.

Des jets d’étirage à la conception intelligente

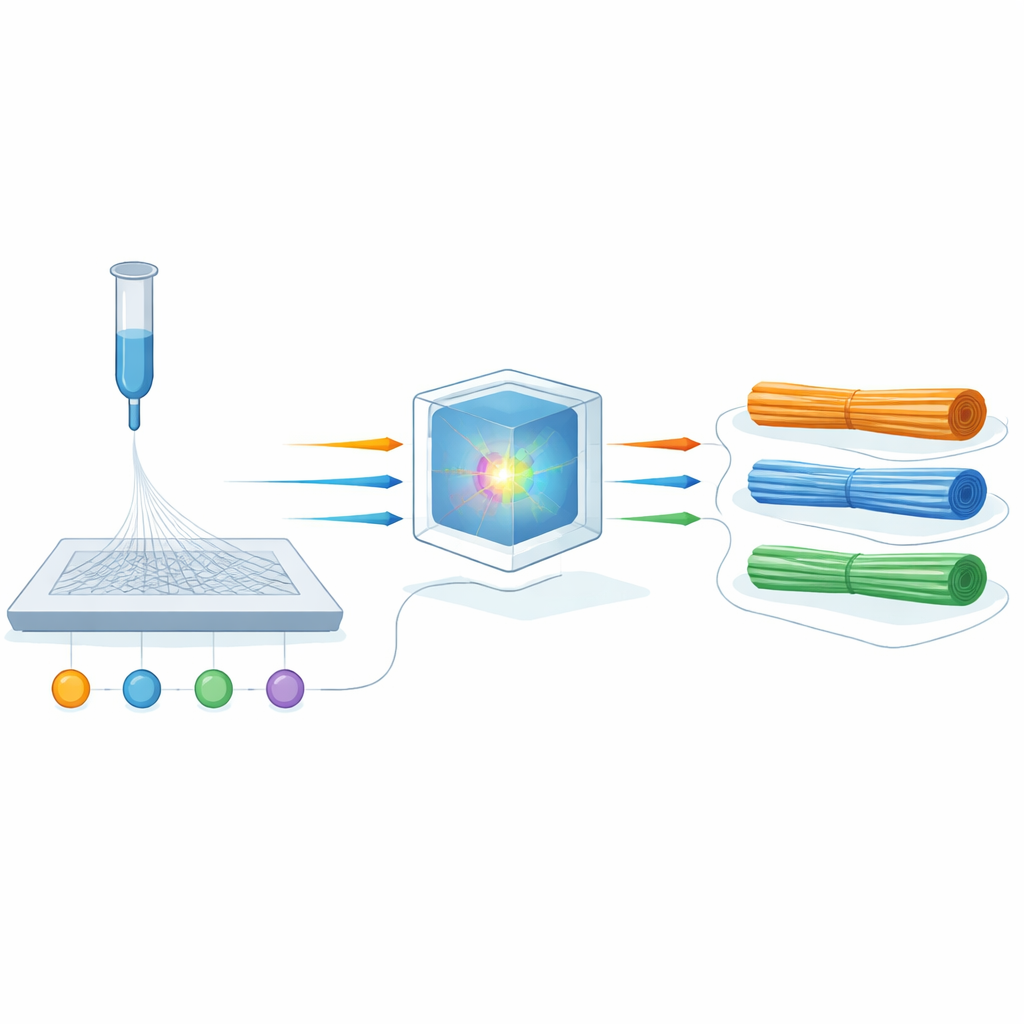

L’étude se concentre sur l’électrofilage, une méthode largement utilisée pour produire des nanofibres continues. Dans une configuration typique, une haute tension attire un fin jet de solution polymère hors d’une aiguille vers un collecteur, l’étirant en fibres fines pendant que le solvant s’évapore. Ajuster la recette de la solution, la tension appliquée, le débit et la distance au collecteur peut rendre les fibres plus épaisses ou plus fines, plus lisses ou plus poreuses. Mais ces paramètres interagissent de façon complexe et non linéaire, de sorte que de petits changements peuvent donner des résultats imprévisibles. Au lieu de s’en remettre à des règles empiriques, les auteurs proposent de construire un « jumeau numérique » du procédé capable de prédire le diamètre des fibres à partir d’un ensemble limité d’expériences bien choisies, puis d’utiliser ce jumeau à l’inverse pour trouver les réglages qui produisent l’épaisseur souhaitée.

Construire un jumeau numérique du procédé de fibres

Pour construire ce jumeau numérique, l’équipe a utilisé un jeu de données existant, soigneusement conçu, comprenant 96 expériences d’électrofilage sur du poly(alcool vinylique), un polymère hydrosoluble courant. Chaque expérience faisait varier quatre paramètres de procédé clés : la concentration de la solution, la tension appliquée, le débit et la distance aiguille-collecteur, et enregistrait le diamètre moyen des fibres obtenu, qui s’étendait d’environ 200 à 350 nanomètres. Les chercheurs ont testé onze méthodes d’apprentissage automatique différentes pour déterminer lesquelles pouvaient le mieux apprendre la relation entre ces quatre entrées et le diamètre des fibres. Cela allait de simples ajustements linéaires à des modèles « ensemblistes » plus flexibles combinant de nombreux petits arbres de décision.

Déterminer ce qui contrôle réellement la taille des fibres

Parmi tous les modèles testés, un algorithme appelé Extreme Gradient Boosting (XGBoost) s’est avéré le plus performant, expliquant environ 89 % de la variation du diamètre des fibres sur des données jamais vues auparavant. Pour s’assurer que ce modèle était non seulement précis mais aussi physiquement cohérent, les auteurs ont utilisé un outil d’interprétabilité connu sous le nom d’analyse SHAP. Cette approche estime la contribution de chaque entrée à la prédiction. Elle a révélé que la tension appliquée et la concentration de la solution dominent l’épaisseur des fibres : une tension plus élevée tend à étirer davantage le jet, produisant des fibres plus fines, tandis qu’une concentration plus élevée (et donc une solution plus épaisse et visqueuse) résiste à l’étirement et donne des fibres plus épaisses. Le débit et la distance avaient une influence moindre mais modulaient tout de même le diamètre, en accord avec les observations expérimentales établies.

Laisser les algorithmes chercher la bonne recette

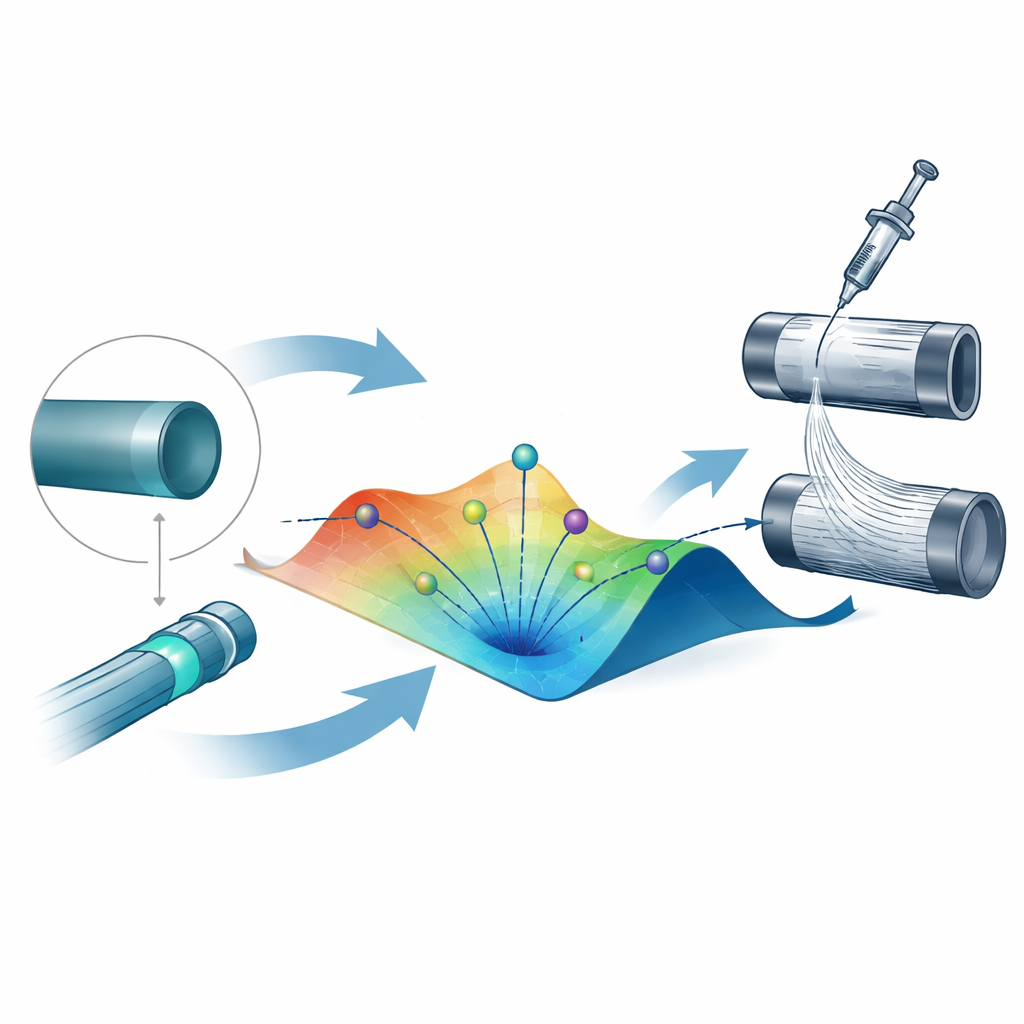

Avec le modèle de substitution en place, l’équipe a abordé le problème de « conception inverse » : pour un diamètre cible donné, quels réglages du procédé faut-il utiliser ? Ils l’ont formulé comme la minimisation de l’écart entre le diamètre prédit par le modèle et la valeur désirée, tout en maintenant tous les paramètres dans des plages réalistes. Sept stratégies d’optimisation ont été comparées, allant du balayage exhaustif sur grille et de la recherche aléatoire simple à des méthodes évolutives basées sur des populations qui affinent itérativement de nombreux candidats. Une technique appelée Particle Swarm Optimization (PSO), qui imite un groupe de particules explorant un paysage et partageant l’information, s’est imposée comme la gagnante. Elle atteignait les diamètres cibles avec des erreurs extrêmement faibles — en moyenne de l’ordre de 2 nanomètres — et le faisait de manière cohérente sur des exécutions répétées, tout en conservant des temps de calcul modestes.

Limitations et marges d’amélioration

Le cadre est actuellement réglé pour un polymère dans un environnement de laboratoire contrôlé, il ne peut donc pas encore prédire le comportement pour des matériaux entièrement différents ou des conditions ambiantes changeantes comme l’humidité. Le jeu de données, bien que soigneusement planifié, est également relativement petit et manque de mesures répétées aux mêmes conditions, ce qui aiderait à quantifier la variabilité naturelle. Les auteurs soutiennent que l’ajout de nouvelles expériences, incluant différents polymères et conditions ambiantes, et l’alimentation de ces nouveaux résultats dans le modèle rendraient le jumeau numérique plus général et fiable. Ils suggèrent également d’étendre la méthode pour contrôler non seulement le diamètre mais d’autres caractéristiques, telles que la résistance des fibres ou la texture de surface, et d’intégrer directement des contraintes pratiques de fabrication dans l’optimisation.

Ce que cela signifie pour les matériaux de demain

En combinant un jumeau numérique fondé sur les données avec un puissant algorithme de recherche, ce travail transforme l’électrofilage d’un art guidé par l’expérience en une tâche de conception plus prévisible. Plutôt que d’effectuer des dizaines d’essais pour atteindre la bonne taille de fibre, des chercheurs ou ingénieurs pourraient spécifier une cible et laisser l’ordinateur proposer des réglages viables en quelques secondes, puis ne valider expérimentalement que quelques suggestions. Bien que démontrée sur des nanofibres, la même stratégie — apprendre à partir d’un ensemble compact d’expériences, puis utiliser ce savoir en sens inverse — pourrait accélérer la conception de nombreux autres matériaux et procédés, aidant de nouveaux filtres, échafaudages, batteries et revêtements à passer plus rapidement du concept à la réalité.

Citation: Mahdian, M., Ender, F. & Pardy, T. A surrogate-based inverse design framework for targeted diameter control of electrospun nanofibers. Sci Rep 16, 11034 (2026). https://doi.org/10.1038/s41598-026-40692-3

Mots-clés: électrofilage, nanofibres, conception inverse, apprentissage automatique, optimisation des procédés