Clear Sky Science · de

Ein surrogatgestützter Inverse-Design-Rahmen für gezielte Durchmessersteuerung elektrogesponnener Nanofasern

Warum winzige Fasern wichtig sind

Viele alltägliche Technologien — von Luftfiltern und medizinischen Verbänden bis zu Sensoren und Batterien — beruhen auf Matten aus extrem feinen Fäden, sogenannten Nanofasern. Wie dick diese Fasern sind — oft nur wenige hundert Milliardstel Meter — beeinflusst stark, wie gut sie Partikel filtern, Zellen beim Wachsen führen oder Energie speichern. Die gezielte Einstellung der Faserdicke bedeutet jedoch meist mühseliges Trial-and-Error im Labor. Dieser Beitrag stellt eine intelligentere, computergeführte Methode vor, mit der sich Nanofasern schnell und zuverlässig auf gewünschte Durchmesser hin entwerfen lassen, was die Innovation in vielen Produkten beschleunigen könnte, die auf diesen filigranen Strukturen beruhen.

Von spreizenden Jets zum smarten Design

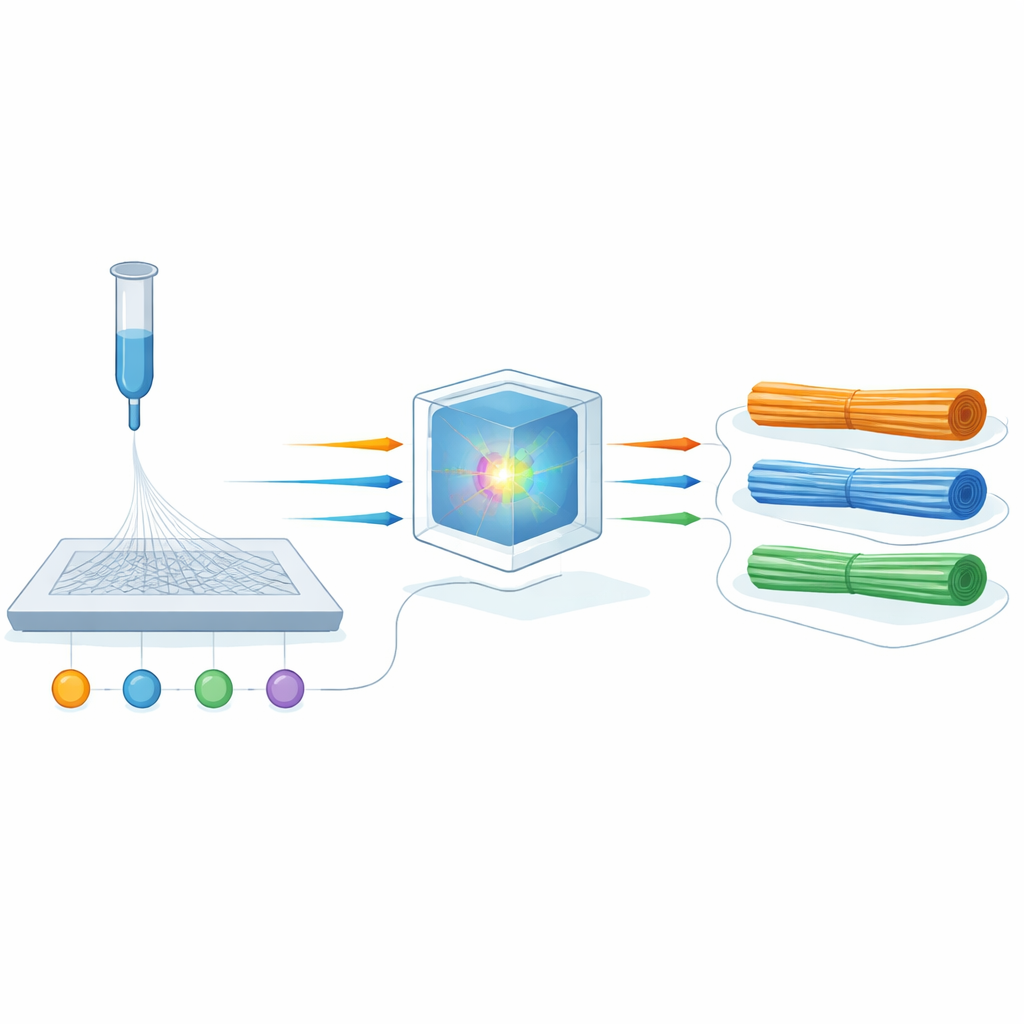

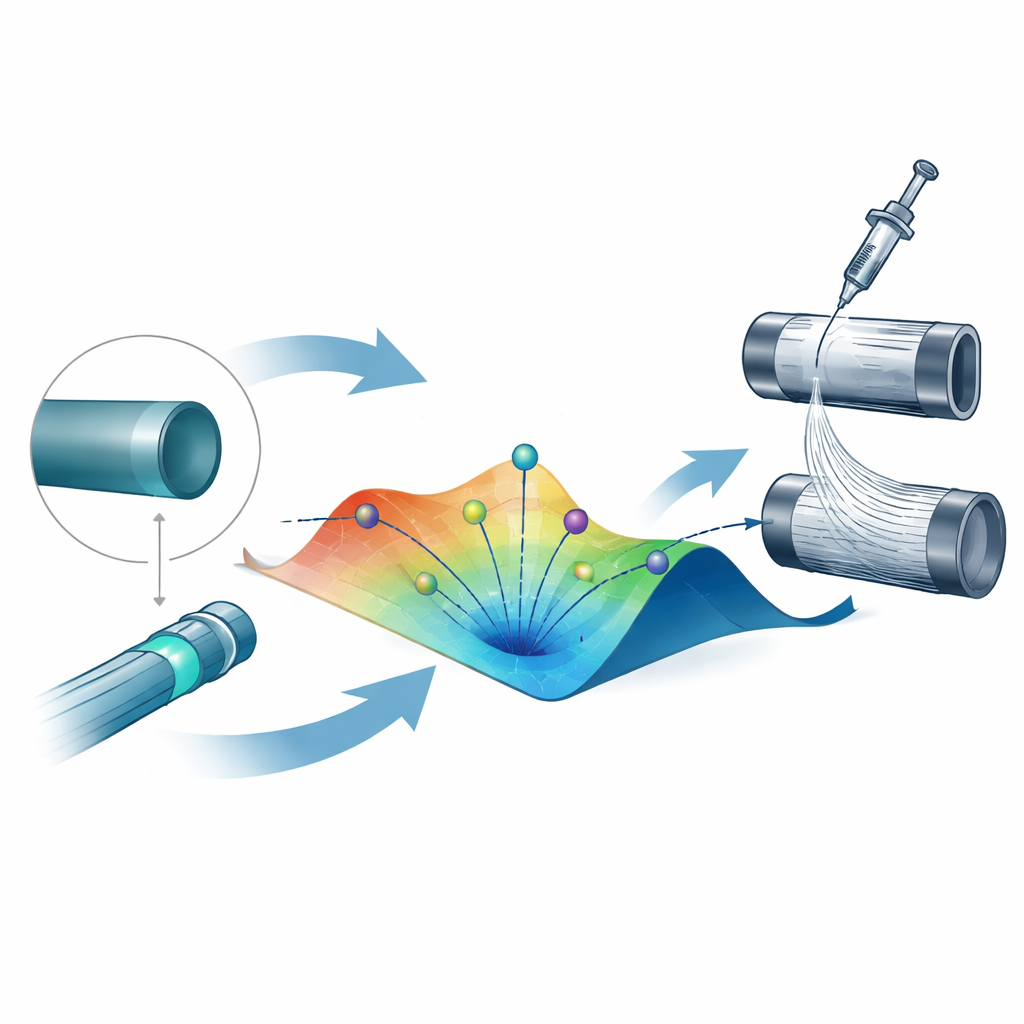

Die Studie konzentriert sich auf das Elektrospinnen, ein weit verbreitetes Verfahren zur Herstellung kontinuierlicher Nanofasern. In einer typischen Anordnung zieht eine hohe Spannung einen dünnen Jet einer Polymersuspension aus einer Nadel in Richtung Sammelplatte und streckt ihn zu feinen Fasern, während das Lösungsmittel verdunstet. Die Rezeptur der Lösung, die angelegte Spannung, die Durchflussrate und der Abstand zur Sammelplatte lassen sich so einstellen, dass Fasern dicker oder dünner, glatter oder poröser werden. Diese Stellgrößen wirken jedoch auf komplexe, nichtlineare Weise zusammen, sodass kleine Änderungen unvorhersehbare Effekte haben können. Statt sich auf Faustregeln zu verlassen, schlagen die Autoren vor, einen „digitalen Zwilling“ des Prozesses zu erstellen, der aus einer begrenzten Anzahl wohlgewählter Experimente den Faserdurchmesser vorhersagen kann, und diesen Zwilling dann umgekehrt zu nutzen, um die Einstellungen zu finden, die einen gewünschten Durchmesser erzeugen.

Einen digitalen Zwilling des Faserprozesses aufbauen

Zum Aufbau dieses digitalen Zwillings nutzte das Team einen bereits vorhandenen, sorgfältig gestalteten Datensatz von 96 Elektrospinn-Experimenten mit Poly(vinylalkohol), einem häufig verwendeten, wasserlöslichen Polymer. Jedes Experiment variierte vier zentrale Prozessparameter: Lösungskonzentration, angelegte Spannung, Durchflussrate und Abstand von Spitze zu Sammelplatte, und zeichnete den resultierenden durchschnittlichen Faserdurchmesser auf, der etwa von 200 bis 350 Nanometern reichte. Die Forscher testeten elf verschiedene Methoden des maschinellen Lernens, um zu ermitteln, welche am besten die Beziehung zwischen den vier Eingangsgrößen und dem Faserdurchmesser erlernen kann. Diese reichten von einfachen linearen Anpassungen bis zu flexibleren Ensemble-Modellen, die viele kleine Entscheidungsbäume kombinieren.

Herausfinden, was den Faserdurchmesser wirklich steuert

Unter allen Modellen schnitt ein Algorithmus namens Extreme Gradient Boosting (XGBoost) am besten ab und erklärte etwa 89 Prozent der Variation des Faserdurchmessers bei zuvor ungesehenen Daten. Um sicherzustellen, dass dieses Modell nicht nur genau, sondern auch physikalisch sinnvoll ist, verwendeten die Autoren ein Interpretationswerkzeug, das als SHAP-Analyse bekannt ist. Dieser Ansatz schätzt, wie stark jeder Eingang zur Vorhersage beiträgt. Er zeigte, dass angelegte Spannung und Lösungskonzentration den Faserdurchmesser dominieren: Höhere Spannung dehnt den Jet stärker und führt zu dünneren Fasern, während höhere Konzentration (und damit dickere, viskösere Lösung) dem Dehnen stärker widersteht und dickere Fasern produziert. Durchflussrate und Abstand hatten einen geringeren Einfluss, beeinflussten den Durchmesser aber dennoch leicht, im Einklang mit langjährigen Beobachtungen aus Experimenten.

Algorithmen die richtige Rezeptur suchen lassen

Mit dem Surrogatmodell gingen die Autoren das Problem des „inversen Designs“ an: Gegeben ein Ziel-Durchmesser, welche Prozesseinstellungen sollte man wählen? Sie formulierten dies als Minimierung der Abweichung zwischen dem vom Modell vorhergesagten Durchmesser und dem gewünschten Wert, unter Einhaltung realistischer Parameterbereiche. Sie verglichen sieben Optimierungsstrategien, von grober Gitterauswertung und einfachem Zufallssuchen bis zu fortgeschrittenen populationsbasierten Methoden, die viele Kandidaten iterativ verfeinern. Eine Technik namens Particle Swarm Optimization (PSO), die das Verhalten einer Gruppe von Partikeln beim Erkunden einer Landschaft und beim Austausch von Informationen nachahmt, erwies sich als klare Gewinnerin. Sie erreichte Ziel-Durchmesser mit extrem kleinen Fehlern — im Mittel innerhalb von etwa 2 Nanometern — und das konsistent über wiederholte Läufe, während die Rechenzeiten moderat blieben.

Beschränkungen und Entwicklungsspielraum

Der Rahmen ist derzeit auf ein Polymer in einer kontrollierten Laborumgebung abgestimmt und kann noch nicht das Verhalten ganz anderer Materialien oder veränderlicher Umgebungsbedingungen wie Luftfeuchtigkeit vorhersagen. Der Datensatz ist zwar sorgfältig geplant, aber relativ klein und enthält keine wiederholten Messungen unter identischen Bedingungen, die helfen würden, die natürliche Variabilität zu quantifizieren. Die Autoren argumentieren, dass zusätzliche Experimente — einschließlich verschiedener Polymere und Umgebungsbedingungen — und das Rückspeisen neuer Ergebnisse in das Modell den digitalen Zwilling allgemeiner und zuverlässiger machen würden. Sie schlagen außerdem vor, die Methode zu erweitern, um nicht nur den Durchmesser, sondern auch andere Eigenschaften wie Faserfestigkeit oder Oberflächenstruktur zu steuern und praktische Fertigungsbeschränkungen direkt in die Optimierung zu integrieren.

Was das für zukünftige Materialien bedeutet

Durch die Kombination eines datengetriebenen digitalen Zwillings mit einem leistungsfähigen Suchalgorithmus verwandelt diese Arbeit das Elektrospinnen von einer erfahrungsgeleiteten Kunst in eine besser vorhersagbare Designaufgabe. Anstatt Dutzende von Testläufen durchzuführen, um die richtige Faserdicke zu treffen, könnten Forscher oder Ingenieure ein Ziel vorgeben und den Computer innerhalb von Sekunden geeignete Prozesseinstellungen vorschlagen lassen und dann nur wenige Vorschläge experimentell validieren. Obwohl an Nanofasern demonstriert, könnte dieselbe Strategie — Lernen aus einem kompakten Satz von Experimenten und anschließende Nutzung dieses Wissens im inversen Sinne — die Entwicklung vieler anderer Materialien und Prozesse beschleunigen und so neue Filter, Gerüste, Batterien und Beschichtungen schneller vom Konzept zur Realität bringen.

Zitation: Mahdian, M., Ender, F. & Pardy, T. A surrogate-based inverse design framework for targeted diameter control of electrospun nanofibers. Sci Rep 16, 11034 (2026). https://doi.org/10.1038/s41598-026-40692-3

Schlüsselwörter: Elektrospinnen, Nanofasern, Inverse Gestaltung, Maschinelles Lernen, Prozessoptimierung