Clear Sky Science · nl

Geavanceerd hybride transformer-CNN-kader voor verbeterde classificatie en segmentatie van huidlaesies

Waarom het vroegtijdig opsporen van huidkanker belangrijk is

Huidkanker is een van de meest voorkomende vormen van kanker wereldwijd, maar ook een van de best behandelbare wanneer het vroeg wordt ontdekt. Artsen vertrouwen steeds vaker op close-upfoto’s van moedervlekken en vlekken om te bepalen welke verdachte zijn. Toch kunnen zelfs deskundigen moeite hebben als beelden weinig contrast hebben, slecht belicht zijn of door haar bedekt worden. Deze studie introduceert een nieuw systeem op basis van kunstmatige intelligentie (AI) dat daarbij helpt: het bepaalt niet alleen welk type huidlaesie aanwezig is, maar markeert ook het exacte gebied van zorg met hoge precisie, zelfs in lastige beelden.

Een hulpsysteem in twee stappen voor artsen

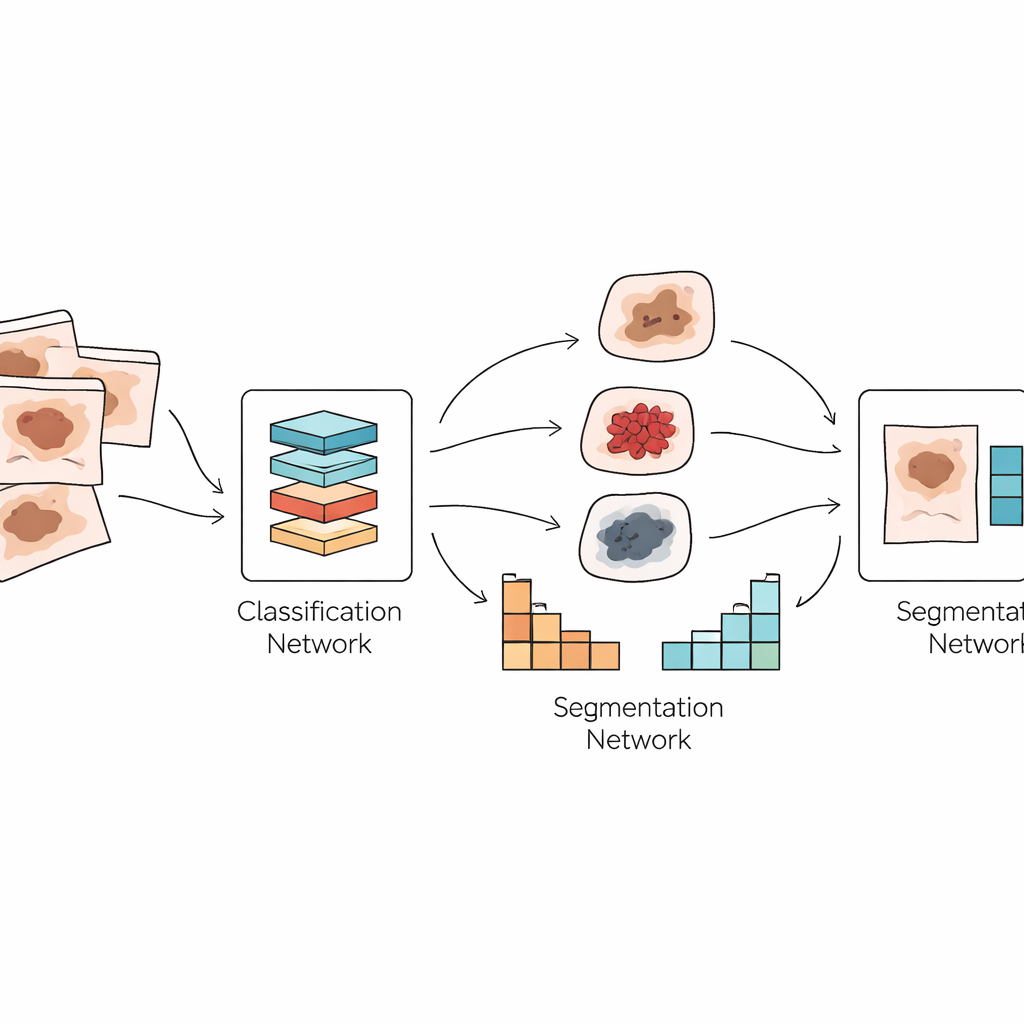

De auteurs stellen een dubbel systeem voor dat het werk van een dermatoloog nabootst. Eerst bekijkt hun model, GlobalSkinNet genoemd, een vergroot huidbeeld en besluit welk type laesie het meest waarschijnlijk is, waarbij goedaardige gezwellen worden onderscheiden van gevaarlijke kankers zoals melanoom. Vervolgens produceert een begeleidend model, SkinFormNet, op hetzelfde beeld een gedetailleerd masker dat de grens van de laesie pixel voor pixel volgt. Samen geven deze twee stappen zowel het antwoord “wat is het?” als een duidelijke “waar is het?”-kaart die diagnose, behandelplanning en vergelijking bij vervolgcontroles kan ondersteunen.

Nieuwe manieren om patronen in huidbeelden te zien

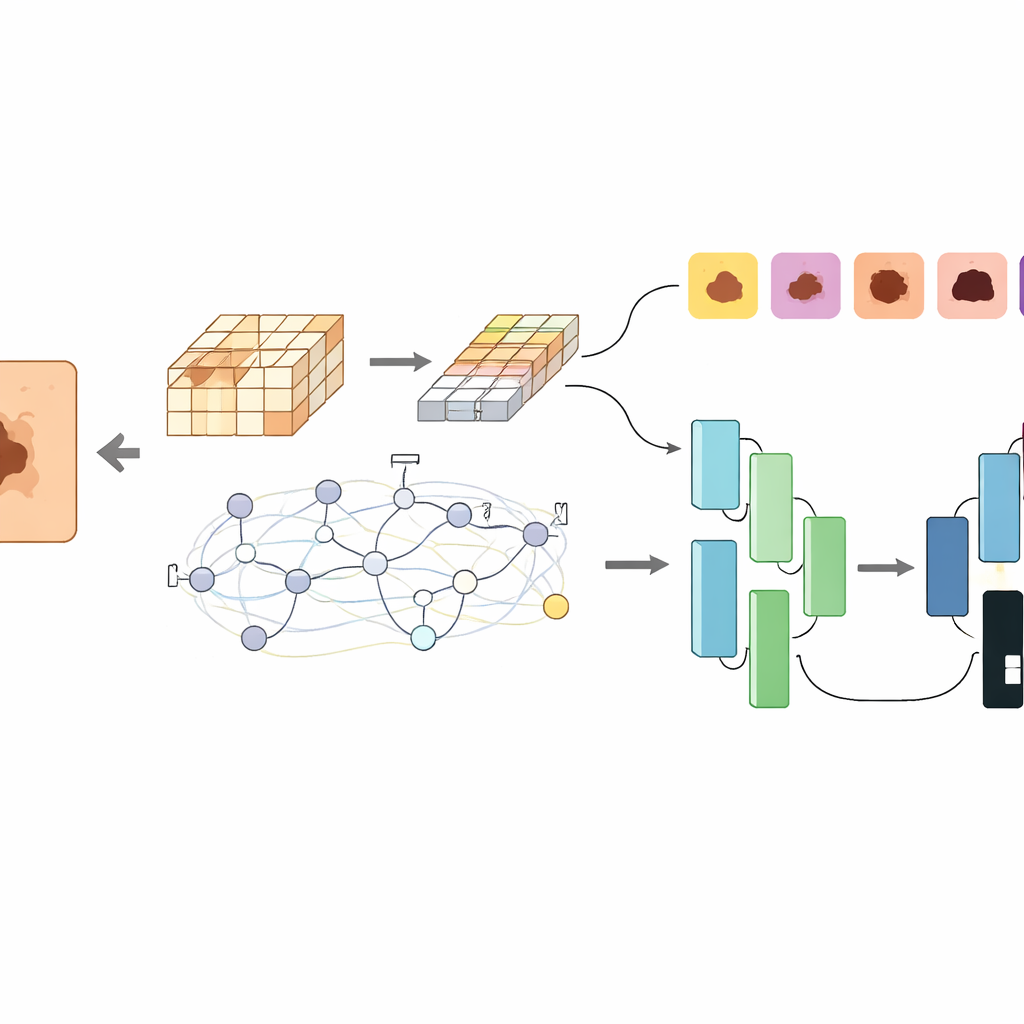

In de kern combineren beide modellen twee krachtige maar verschillende AI-technieken. Convolutionele neurale netwerken zijn goed in het herkennen van fijne texturen en randen, zoals onregelmatige grenzen of subtiele kleurverschillen in een moedervlek. Transformer-netwerken, oorspronkelijk ontwikkeld voor taal, blinken uit in het begrijpen van globale context, bijvoorbeeld hoe verschillende regio’s van het beeld zich tot elkaar verhouden. GlobalSkinNet gebruikt een “globale contextuele” transformer die het beeld in overlappende patches verdeelt en zowel lokale als wijdere attentie toepast, waardoor het kleine visuele aanwijzingen kan vangen terwijl het de algemene vorm van de laesie en de omgeving bewaakt. SkinFormNet gebruikt een transformer-gebaseerde feature-extractor samen met een U-vormige decoder die geleidelijk een scherp, schoon omtrek van de laesie reconstructeert.

Getest op rommelige data uit de praktijk

Een belangrijke kracht van dit werk is de breedte van de tests. Veel eerdere AI-studies vertrouwen op slechts een of twee nette datasets, maar dit systeem is geëvalueerd op bijna alle belangrijke openbare verzamelingen van dermoscopische beelden, waaronder PH2, HAM10000 en de ISIC-uitdagingen van 2016 tot 2020. Deze datasets verschillen in cameratype, verlichting, beeldkwaliteit en patiëntpopulaties en bevatten zowel goedaardige als kwaadaardige laesies. Ondanks deze variatie behaalt GlobalSkinNet op verschillende datasets ongeveer 97–100% nauwkeurigheid en behoudt het een sterke gevoeligheid voor melanoom, de dodelijkste vorm van huidkanker. SkinFormNet bereikt eveneens zeer grote overlap tussen zijn voorspelde maskers en door deskundigen getekende omtrekken, en presteert vaak beter dan eerder toonaangevende methoden.

Binnenkijken bij de beslissingen van het model

Aangezien medische AI betrouwbaar moet zijn, onderzoeken de onderzoekers ook waar hun systeem feitelijk “naar kijkt.” Met een visualisatietechniek die de meest invloedrijke beeldregio’s voor een beslissing benadrukt, tonen ze aan dat het model zich meestal richt op klinisch relevante gebieden: onregelmatige grenzen, kleurvariaties en asymmetrie in de laesie, terwijl het grotendeels achtergrondhuid, haren en linialen negeert. Wanneer het systeem faalt, lijken de fouten op gevallen die ook voor mensen lastig zijn, zoals zeer vage grenzen of laesies die geleidelijk in normale huid vervagen. Deze analyses suggereren dat het gedrag van het model in lijn is met hoe dermatologen over risico redeneren, in plaats van afhankelijk te zijn van toevallige aanwijzingen.

Wat dit betekent voor toekomstige huidcontroles

Kort gezegd presenteert deze studie een AI-assistent die zowel een verdachte moedervlek kan labelen als netjes de vorm ervan kan inkleuren, zelfs wanneer de foto ruisig of ongelijkmatig belicht is. Door twee elkaar aanvullende families van neurale netwerken te combineren, biedt het kader betrouwbaardere prestaties dan veel eerdere hulpmiddelen met één doel. Hoewel het nog echte klinische tests en lichtere versies voor alledaagse apparaten nodig heeft, wijst het werk op een toekomst waarin dermatologen zulke systemen als een tweede paar ogen kunnen gebruiken—helpend om gevaarlijke kankers eerder op te sporen, onnodige biopsieën te verminderen en uiteindelijk de uitkomsten voor patiënten te verbeteren.

Bronvermelding: Yousaf, N., Amin, J., Butt, W.H. et al. Advanced hybrid transformer CNN framework for improved skin lesion classification and segmentation. Sci Rep 16, 13592 (2026). https://doi.org/10.1038/s41598-026-43376-0

Trefwoorden: huidkanker, dermoscopie, deep learning, medische beeldvorming, laesiesegmentatie