Clear Sky Science · fr

Cadre hybride avancé transformeur-CNN pour une meilleure classification et segmentation des lésions cutanées

Pourquoi il est important de détecter le cancer de la peau précocement

Le cancer de la peau est l’un des cancers les plus fréquents dans le monde, mais il fait aussi partie des plus traitables lorsqu’il est détecté tôt. Les médecins s’appuient de plus en plus sur des photographies rapprochées de grains de beauté et de taches pour décider lesquels sont dangereux. Pourtant, même les spécialistes peuvent avoir des difficultés lorsque les images présentent un faible contraste, un mauvais éclairage ou sont masquées par des poils. Cette étude introduit un nouveau système d’intelligence artificielle (IA) conçu pour aider : il ne se contente pas de déterminer le type de lésion cutanée présent, il en trace aussi la zone exacte avec une grande précision, même sur des images difficiles.

Une aide en deux étapes pour les médecins

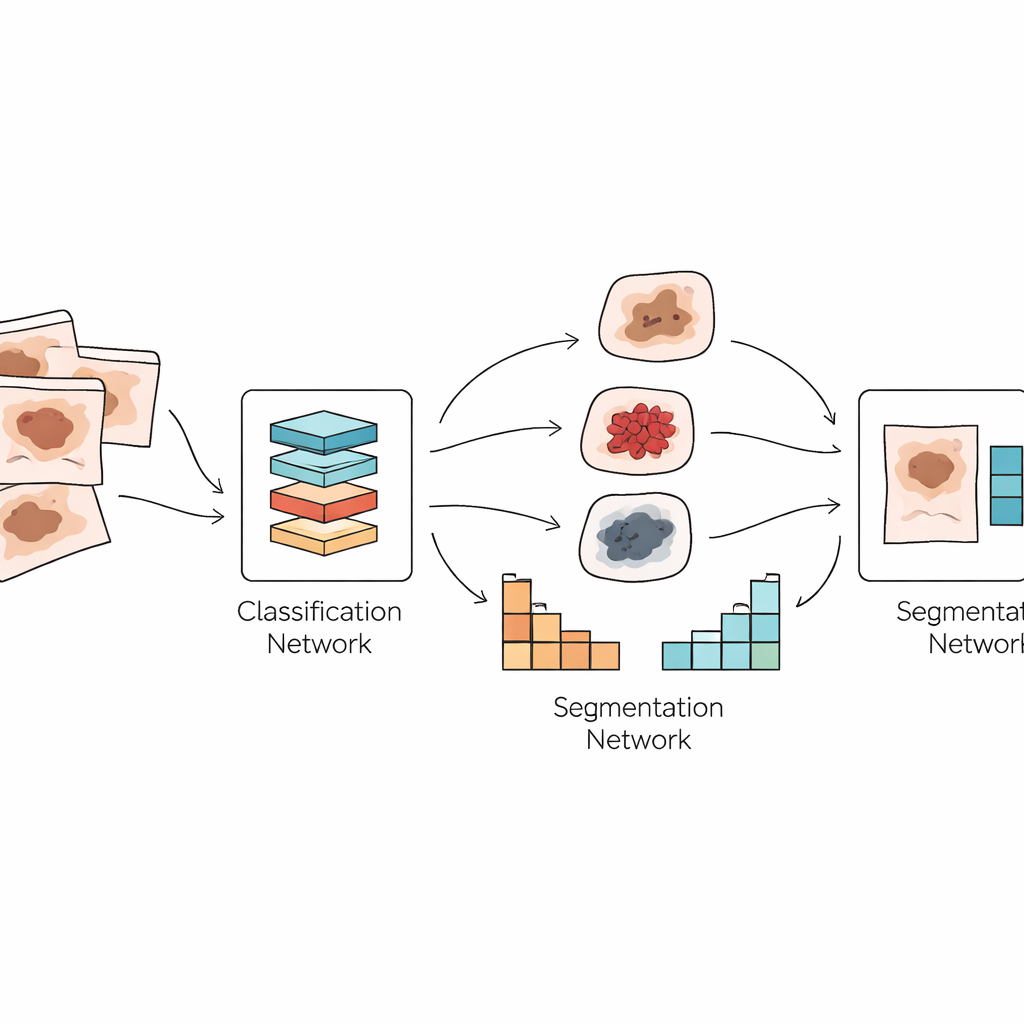

Les auteurs proposent un système double qui reflète la manière dont travaille un dermatologue. D’abord, leur modèle, appelé GlobalSkinNet, examine une image de peau agrandie et décide du type de lésion le plus probable, distinguant les excroissances bénignes des cancers dangereux tels que le mélanome. Ensuite, un modèle compagnon nommé SkinFormNet prend la même image et produit un masque détaillé qui trace la frontière de la lésion pixel par pixel. Ensemble, ces deux étapes fournissent à la fois une réponse « qu’est-ce que c’est ? » et une carte claire « où est-ce ? » pouvant soutenir le diagnostic, la planification du traitement et les comparaisons de suivi dans le temps.

Nouvelles façons de repérer les motifs dans les images cutanées

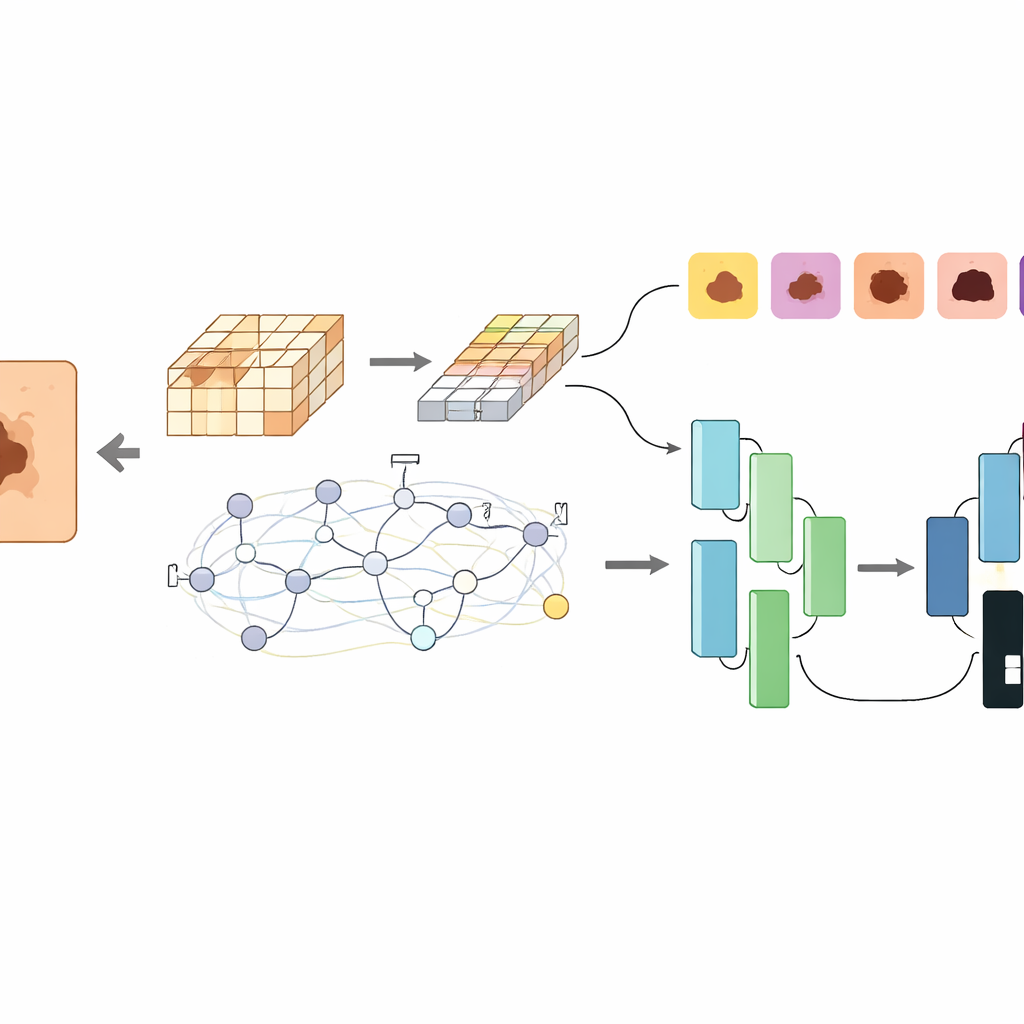

Sous le capot, les deux modèles combinent deux techniques d’IA puissantes mais différentes. Les réseaux de neurones convolutionnels sont efficaces pour repérer de fines textures et des contours, comme des bords irréguliers ou de subtiles variations de couleur dans un grain de beauté. Les transformeurs, initialement développés pour le langage, excellent à comprendre le contexte global, par exemple comment différentes régions de l’image se rapportent les unes aux autres. GlobalSkinNet utilise un transformeur « contextuel global » qui découpe l’image en patchs chevauchants et applique à la fois une attention locale et à large portée, ce qui lui permet de capturer de minuscules indices visuels tout en gardant la forme globale de la lésion et son environnement. SkinFormNet utilise un extracteur de caractéristiques basé sur transformeur associé à un décodeur en forme de U qui reconstruit progressivement un contour net et précis de la lésion.

Testé sur des données réelles et bruitées

Un point fort de ce travail est l’ampleur des tests réalisés. De nombreuses études précédentes en IA s’appuient sur un ou deux ensembles de données soignés, mais ce système est évalué sur presque toutes les grandes collections publiques d’images dermoscopiques, y compris PH2, HAM10000 et les défis ISIC de 2016 à 2020. Ces jeux de données diffèrent par le type d’appareil photo, l’éclairage, la qualité des images et les populations de patients, et comprennent à la fois des lésions bénignes et malignes. Malgré cette variété, GlobalSkinNet atteint environ 97–100 % de précision sur plusieurs ensembles et conserve une forte sensibilité au mélanome, la forme la plus mortelle du cancer de la peau. SkinFormNet obtient de même un recouvrement très élevé entre ses masques prédits et les contours tracés par des experts, surpassant souvent les méthodes de pointe antérieures.

Regarder à l’intérieur des décisions du modèle

Parce que l’IA médicale doit être digne de confiance, les chercheurs explorent aussi ce que leur système « regarde » réellement. En utilisant une technique de visualisation qui met en évidence les régions de l’image les plus influentes pour une décision, ils montrent que le modèle a tendance à se concentrer sur des zones cliniquement pertinentes : bords irréguliers, variations de couleur et asymétrie de la lésion, tout en ignorant pour l’essentiel la peau de fond, les poils et les règles de mesure. Lorsque le système échoue, ses erreurs ressemblent à des cas difficiles pour les humains, comme des frontières très floues ou des lésions qui s’estompent progressivement dans la peau normale. Ces analyses suggèrent que le comportement du modèle est aligné sur la manière dont les dermatologues évaluent le risque, plutôt que de s’appuyer sur des indices non pertinents.

Ce que cela signifie pour les futurs examens cutanés

En termes simples, cette étude présente un assistant IA capable à la fois d’étiqueter un grain de beauté suspect et d’en colorer proprement la forme, même lorsque l’image est bruitée ou inégalement éclairée. En fusionnant deux familles complémentaires de réseaux neuronaux, le cadre offre des performances plus fiables que de nombreux outils antérieurs à usage unique. S’il nécessite encore des tests cliniques en conditions réelles et des versions allégées pour les appareils du quotidien, ce travail ouvre la voie vers un futur où les dermatologues pourraient utiliser de tels systèmes comme une seconde paire d’yeux — aidant à détecter plus tôt des cancers dangereux, à réduire les biopsies inutiles et, au final, à améliorer les résultats pour les patients.

Citation: Yousaf, N., Amin, J., Butt, W.H. et al. Advanced hybrid transformer CNN framework for improved skin lesion classification and segmentation. Sci Rep 16, 13592 (2026). https://doi.org/10.1038/s41598-026-43376-0

Mots-clés: cancer de la peau, dermoscopie, apprentissage profond, imagerie médicale, segmentation de lésions