Clear Sky Science · de

Fortschrittliches hybrides Transformer-CNN-Framework zur verbesserten Klassifikation und Segmentierung von Hautläsionen

Warum eine frühe Erkennung von Hautkrebs wichtig ist

Hautkrebs zählt zu den weltweit häufigsten Krebsarten, ist aber bei rechtzeitiger Erkennung gut behandelbar. Ärztinnen und Ärzte stützen sich zunehmend auf Nahaufnahmen von Muttermalen und Flecken, um zu beurteilen, welche davon gefährlich sein könnten. Selbst Expertinnen und Experten tun sich jedoch schwer, wenn Bilder einen geringen Kontrast, schlechte Beleuchtung oder Haarüberlagerungen aufweisen. Diese Studie stellt ein neues System der künstlichen Intelligenz (KI) vor, das hier helfen soll: Es entscheidet nicht nur, um welche Art von Hautläsion es sich handelt, sondern zeichnet auch das genaue betroffene Areal mit hoher Präzision nach, selbst bei schwierigen Bildern.

Ein zweistufiges Hilfsmittel für Ärztinnen und Ärzte

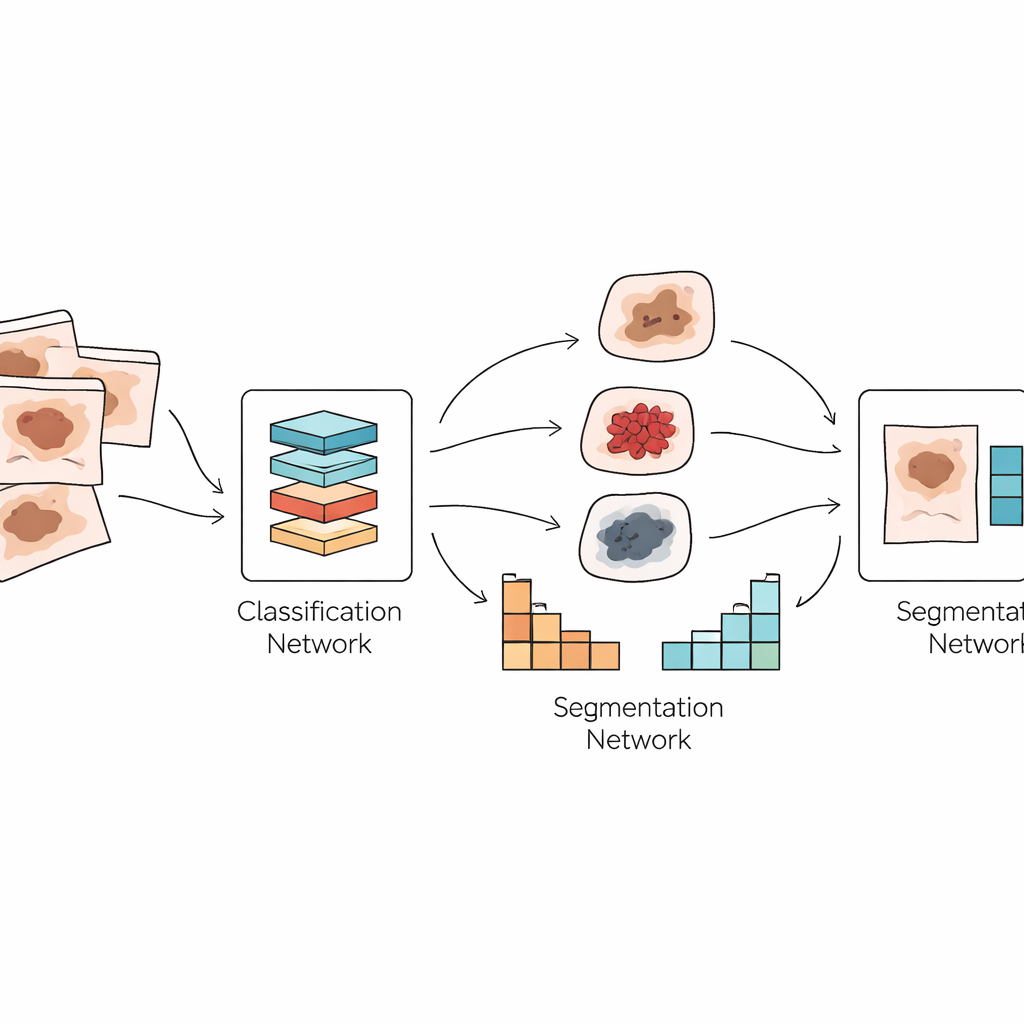

Die Autorinnen und Autoren schlagen ein zweigleisiges System vor, das dem Vorgehen einer Dermatologin ähnelt. Zuerst betrachtet ihr Modell GlobalSkinNet ein vergrößertes Hautbild und entscheidet, welcher Läsionstyp am wahrscheinlichsten ist, wobei gutartige Wucherungen von gefährlichen Krebsarten wie dem Melanom getrennt werden. Anschließend erzeugt ein Begleitmodell namens SkinFormNet aus demselben Bild eine detaillierte Maske, die die Begrenzung der Läsion Pixel für Pixel nachzeichnet. Zusammen liefern diese beiden Schritte sowohl eine Antwort auf „Was ist das?“ als auch eine klare Karte „Wo ist es?“, die Diagnose, Therapieplanung und Verlaufsvergleiche unterstützen könnte.

Neue Wege, Muster in Hautbildern zu erkennen

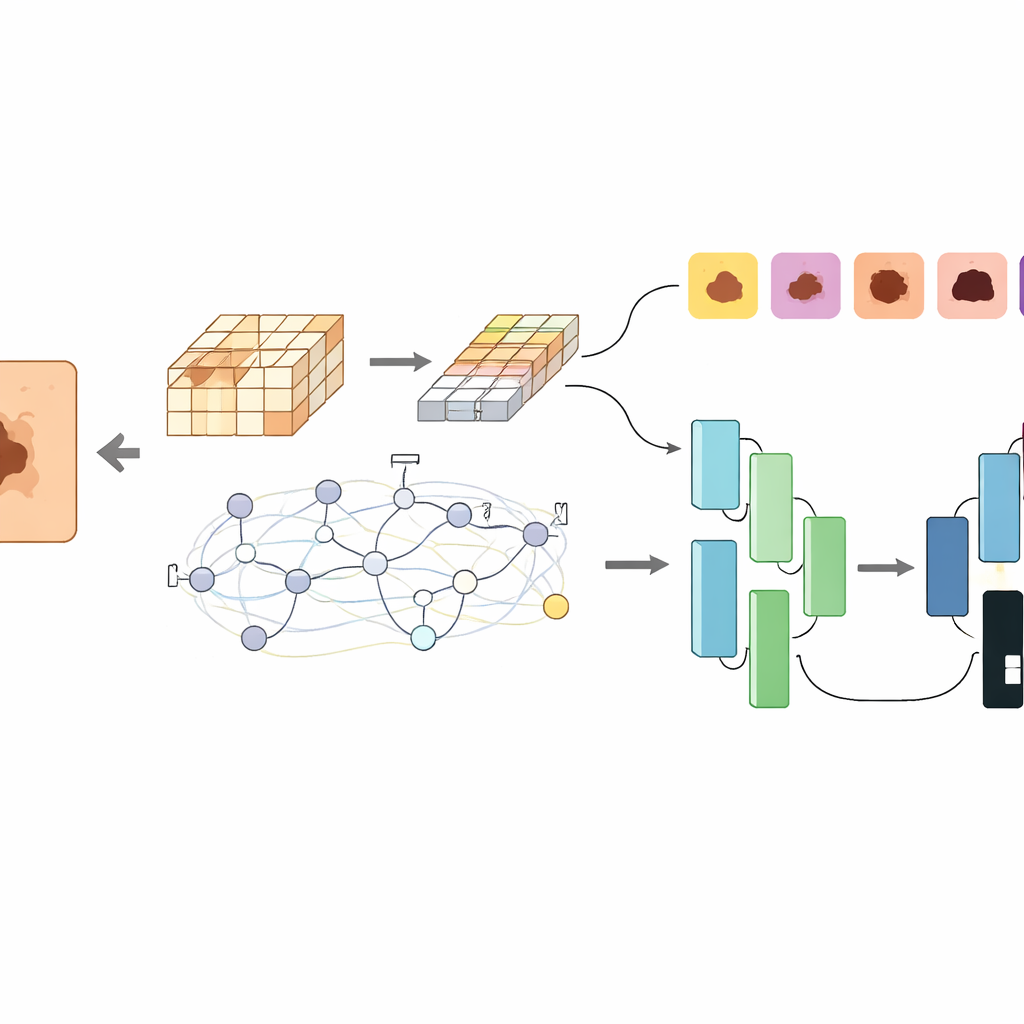

Im Inneren kombinieren beide Modelle zwei leistungsfähige, aber unterschiedliche KI-Techniken. Convolutional Neural Networks (Faltungsnetze) sind gut darin, feine Texturen und Kanten zu erkennen, etwa unregelmäßige Ränder oder subtile Farbverläufe in einem Muttermal. Transformer-Netzwerke, ursprünglich für Sprache entwickelt, sind hervorragend darin, den globalen Kontext zu erfassen, also wie verschiedene Bildregionen zueinander in Beziehung stehen. GlobalSkinNet verwendet einen „globalen kontextuellen“ Transformer, der das Bild in überlappende Patches aufteilt und sowohl lokale als auch weitreichende Attention-Mechanismen anwendet, wodurch kleine visuelle Hinweise ebenso erfasst werden wie die Gesamtform der Läsion und ihre Umgebung. SkinFormNet nutzt einen transformerbasierten Merkmalsextraktor zusammen mit einem U-förmigen Decoder, der schrittweise eine scharfe, saubere Kontur der Läsion rekonstruiert.

Getestet an realen, unordentlichen Daten

Eine wesentliche Stärke dieser Arbeit ist die breite Prüfung. Viele frühere KI-Studien stützen sich nur auf ein oder zwei aufgeräumte Datensätze, dieses System jedoch wurde an nahezu allen wichtigen öffentlichen Sammlungen dermoskopischer Bilder evaluiert, darunter PH2, HAM10000 und die ISIC-Challenges von 2016 bis 2020. Diese Datensätze unterscheiden sich in Kameratyp, Beleuchtung, Bildqualität und Patientinnen- bzw. Patientengruppen und enthalten sowohl gutartige als auch bösartige Läsionen. Trotz dieser Vielfalt erreicht GlobalSkinNet auf mehreren Datensätzen rund 97–100 % Genauigkeit und behält eine hohe Sensitivität gegenüber Melanomen, der tödlichsten Form von Hautkrebs. Auch SkinFormNet erzielt eine sehr hohe Überlappung zwischen seinen vorhergesagten Masken und von Expertinnen und Experten gezeichneten Konturen und übertrifft dabei häufig frühere führende Methoden.

Ein Blick in die Entscheidungsfindung des Modells

Da medizinische KI vertrauenswürdig sein muss, untersuchen die Forschenden auch, worauf ihr System tatsächlich „schaut“. Mithilfe einer Visualisierungstechnik, die die einflussreichsten Bildregionen für eine Entscheidung hervorhebt, zeigen sie, dass das Modell tendenziell klinisch relevante Bereiche fokussiert: unregelmäßige Ränder, Farbvariationen und Asymmetrie in der Läsion, während Hintergrundhaut, Haare und Messlineale weitgehend ignoriert werden. Wenn das System Fehler macht, ähneln diese Fällen, mit denen Menschen Schwierigkeiten haben, etwa sehr verschwommene Begrenzungen oder Läsionen, die allmählich in normale Haut übergehen. Diese Analysen deuten darauf hin, dass sich das Verhalten des Modells an der diagnostischen Argumentation von Dermatologinnen und Dermatologen orientiert und nicht auf zufälligen Merkmalen beruht.

Was das für zukünftige Hautuntersuchungen bedeutet

Einfach gesagt stellt diese Studie einen KI-Assistenten vor, der sowohl ein verdächtiges Muttermal klassifizieren als auch dessen Form präzise einfärben kann, selbst wenn das Bild verrauscht oder ungleich beleuchtet ist. Durch die Verschmelzung zweier sich ergänzender Familien neuronaler Netze bietet das Framework zuverlässigere Leistungen als viele frühere Einzelwerkzeuge. Zwar sind noch klinische Tests in der Praxis und leichtere Versionen für Alltagsgeräte nötig, doch weist die Arbeit in eine Zukunft, in der Dermatologinnen und Dermatologen solche Systeme als zweite Augenpaar nutzen können — um gefährliche Krebserkrankungen früher zu entdecken, unnötige Biopsien zu reduzieren und letztlich die Behandlungsergebnisse für Patientinnen und Patienten zu verbessern.

Zitation: Yousaf, N., Amin, J., Butt, W.H. et al. Advanced hybrid transformer CNN framework for improved skin lesion classification and segmentation. Sci Rep 16, 13592 (2026). https://doi.org/10.1038/s41598-026-43376-0

Schlüsselwörter: Hautkrebs, Dermoskopie, Tiefes Lernen, Medizinische Bildgebung, Läsionssegmentierung