Clear Sky Science · es

Marco híbrido avanzado de transformador y CNN para mejorar la clasificación y segmentación de lesiones cutáneas

Por qué importa detectar el cáncer de piel a tiempo

El cáncer de piel es uno de los cánceres más comunes en el mundo, pero también es de los más tratables cuando se detecta de forma temprana. Cada vez más, los médicos recurren a fotografías en primer plano de lunares y manchas para decidir cuáles son peligrosos. Sin embargo, incluso los expertos pueden tener dificultades cuando las imágenes presentan bajo contraste, mala iluminación o están ocultas por pelo. Este estudio presenta un nuevo sistema de inteligencia artificial (IA) diseñado para ayudar: no solo determina qué tipo de lesión cutánea está presente, sino que además delimita con alta precisión la zona de interés, incluso en imágenes difíciles.

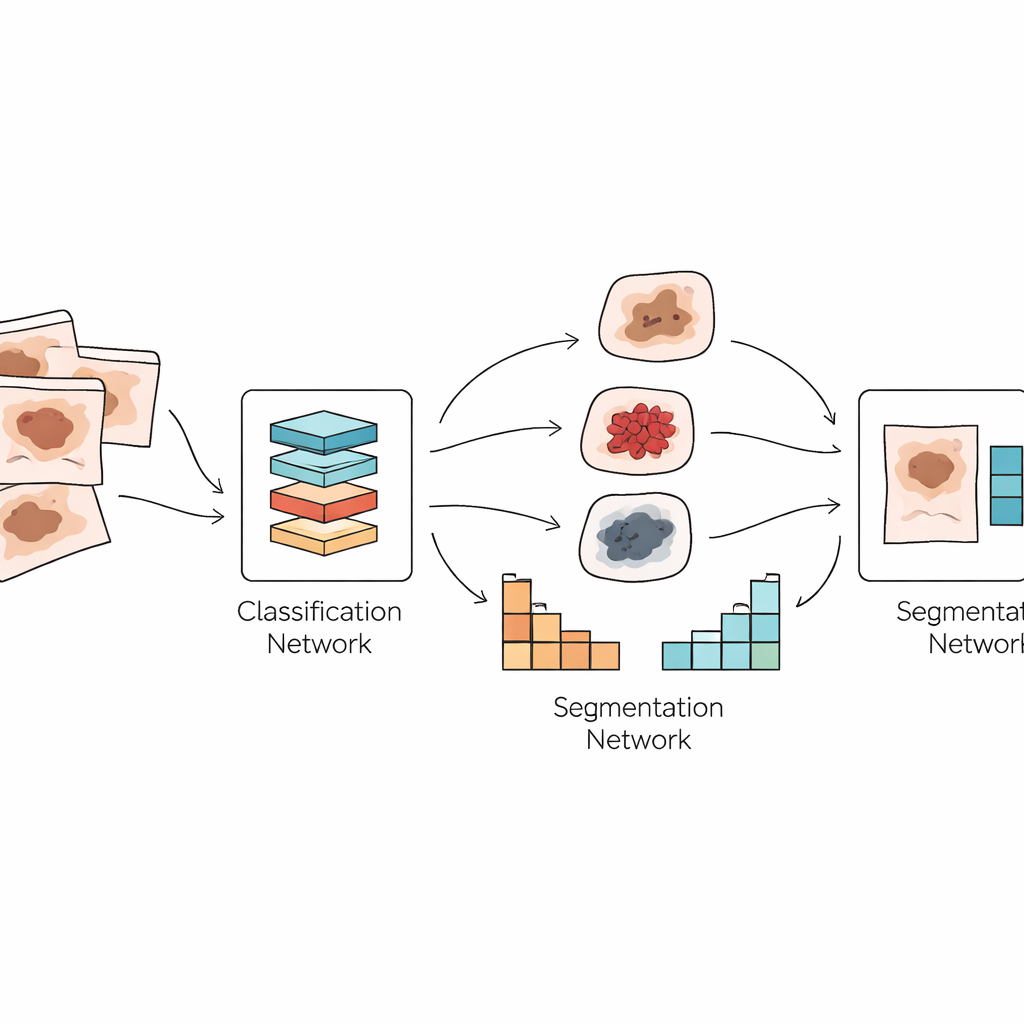

Un asistente en dos pasos para los médicos

Los autores proponen un sistema dual que refleja cómo trabaja un dermatólogo. Primero, su modelo, llamado GlobalSkinNet, analiza una imagen ampliada de la piel y decide qué tipo de lesión es más probable, separando crecimientos benignos de cánceres peligrosos como el melanoma. En segundo lugar, un modelo complementario llamado SkinFormNet toma la misma imagen y genera una máscara detallada que traza el contorno de la lesión píxel a píxel. Juntos, estos dos pasos proporcionan tanto una respuesta de “qué es” como un mapa claro de “dónde está”, que podría apoyar el diagnóstico, la planificación del tratamiento y las comparaciones de seguimiento a lo largo del tiempo.

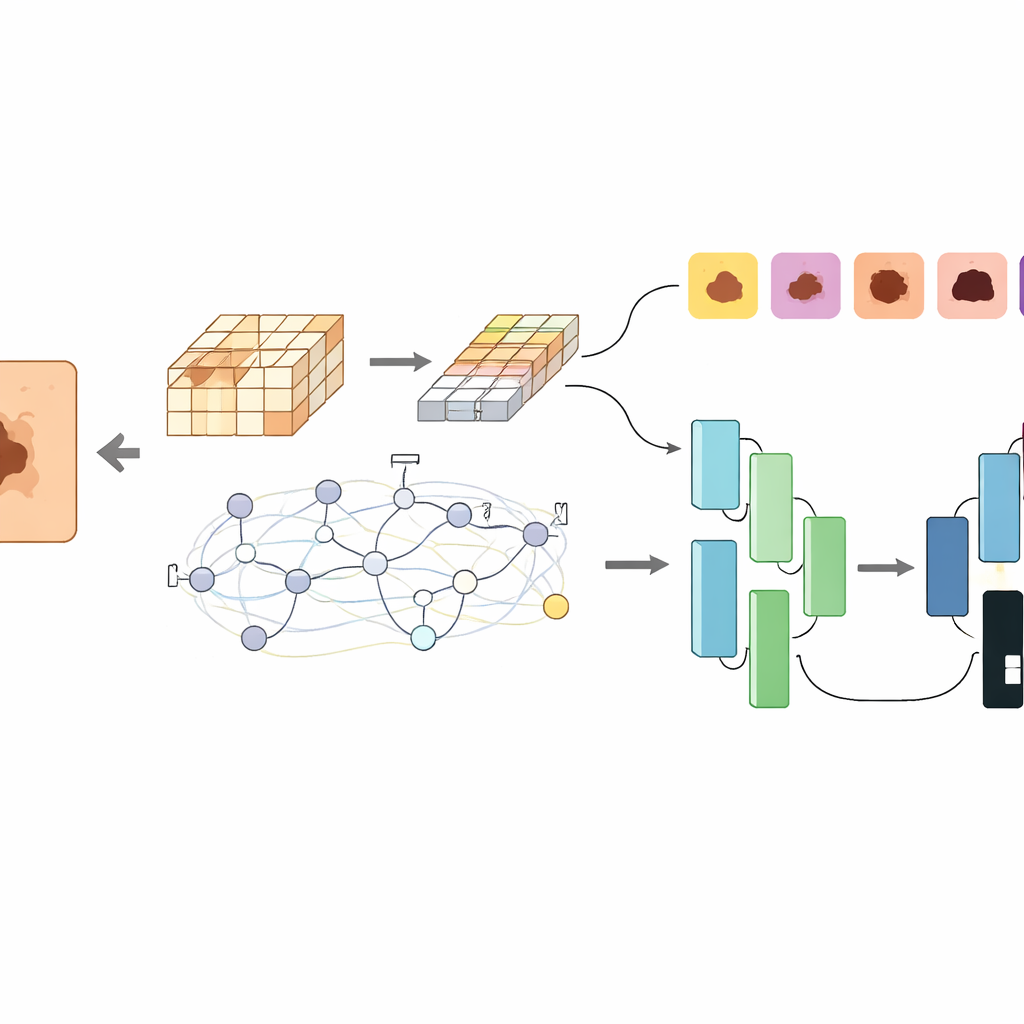

Nuevas maneras de ver patrones en imágenes de piel

En el núcleo, ambos modelos combinan dos técnicas de IA poderosas pero diferentes. Las redes neuronales convolucionales son buenas detectando texturas finas y bordes, como contornos irregulares o cambios sutiles de color en un lunar. Las redes transformer, desarrolladas originalmente para lenguaje, sobresalen en comprender el contexto global, por ejemplo, cómo se relacionan distintas regiones de la imagen entre sí. GlobalSkinNet utiliza un transformer “de contexto global” que divide la imagen en parches superpuestos y aplica atención tanto local como de amplio alcance, lo que le permite capturar pequeñas pistas visuales mientras mantiene el seguimiento de la forma general de la lesión y su entorno. SkinFormNet emplea un extractor de características basado en transformer junto con un decodificador en forma de U que reconstruye gradualmente un contorno nítido y definido de la lesión.

Evaluado con datos reales y desordenados

Una fortaleza clave de este trabajo es lo ampliamente que se prueba. Muchos estudios previos de IA se apoyan en solo uno o dos conjuntos de datos ordenados, pero este sistema se evalúa en casi todas las colecciones públicas principales de imágenes dermoscópicas, incluyendo PH2, HAM10000 y los desafíos ISIC de 2016 a 2020. Estos conjuntos difieren en tipo de cámara, iluminación, calidad de imagen y poblaciones de pacientes, e incluyen tanto lesiones benignas como malignas. A pesar de esta variedad, GlobalSkinNet alcanza aproximadamente entre un 97 y 100 % de precisión en varios conjuntos y mantiene una sensibilidad fuerte al melanoma, la forma de cáncer de piel más letal. SkinFormNet logra asimismo una superposición muy alta entre sus máscaras predichas y los contornos trazados por expertos, a menudo superando a los métodos líderes anteriores.

Mirando dentro de las decisiones del modelo

Dado que la IA médica debe ser confiable, los investigadores también exploran qué está “mirando” realmente su sistema. Usando una técnica de visualización que destaca las regiones de la imagen más influyentes para una decisión, muestran que el modelo tiende a centrarse en áreas clínicamente significativas: bordes irregulares, variaciones de color y asimetría en la lesión, mientras que en gran medida ignora la piel de fondo, los pelos y las reglas. Cuando el sistema falla, sus errores se parecen a los casos difíciles para humanos, como contornos muy borrosos o lesiones que se difuminan gradualmente con la piel normal. Estos análisis sugieren que el comportamiento del modelo está alineado con el razonamiento de los dermatólogos sobre el riesgo, en vez de depender de indicios espurios.

Qué significa esto para las revisiones de piel futuras

En términos simples, este estudio presenta un asistente de IA que puede tanto etiquetar un lunar sospechoso como colorear limpiamente su forma, incluso cuando la imagen es ruidosa o tiene iluminación desigual. Al fusionar dos familias complementarias de redes neuronales, el marco ofrece un rendimiento más fiable que muchas herramientas anteriores de propósito único. Aunque todavía requiere pruebas clínicas en entornos reales y versiones más ligeras para dispositivos cotidianos, el trabajo apunta hacia un futuro en el que los dermatólogos puedan usar estos sistemas como un segundo par de ojos: ayudando a detectar cánceres peligrosos antes, reducir biopsias innecesarias y, en última instancia, mejorar los resultados para los pacientes.

Cita: Yousaf, N., Amin, J., Butt, W.H. et al. Advanced hybrid transformer CNN framework for improved skin lesion classification and segmentation. Sci Rep 16, 13592 (2026). https://doi.org/10.1038/s41598-026-43376-0

Palabras clave: cáncer de piel, dermoscopia, aprendizaje profundo, imagen médica, segmentación de lesiones