Clear Sky Science · it

Quadro di allerta precoce a più livelli potenziato dall’intelligenza artificiale per affrontare l’elevato tasso di falsi allarmi nella previsione della mortalità ospedaliera

Perché contano allerte ospedaliere più intelligenti

Chiunque sia stato in un pronto soccorso sa che può sembrare caotico: allarmi che suonano, personale di corsa e pazienti molto gravi che arrivano a tutte le ore. Eppure i pazienti più pericolosi sono talvolta i più difficili da individuare precocemente, e i sistemi informatici pensati per avvisare i medici spesso urlano al lupo, generando molti più falsi allarmi che vere emergenze. Questo studio presenta un nuovo quadro di intelligenza artificiale, chiamato AI-TEW, progettato per rendere i sistemi di allerta ospedalieri sia più precisi sia meno rumorosi — così che quando suona un allarme i clinici siano molto più propensi a prestarvi attenzione.

Il problema di troppe segnalazioni

Gli ospedali utilizzano sempre più modelli informatici per prevedere quali pazienti appena ricoverati rischiano di morire durante il soggiorno. Questi modelli appaiono impressionanti sulla carta, classificando correttamente nella maggior parte dei casi pazienti ad alto e basso rischio. Ma nei veri pronto soccorso le morti in ospedale sono rare — tipicamente meno di 5 ogni 100 ammissioni. Questo sbilanciamento significa che anche un modello accurato può generare molti più falsi allarmi che reali. I sistemi precedenti hanno mostrato situazioni in cui circa 9 avvisi su 10 etichettati come “ad alto rischio” si sono rivelati sbagliati. Questa valanga di allarmi dubbi porta a una “fatica da allerta”, in cui infermieri e medici diventano desensibilizzati, rischiando di perdere i pochi casi davvero critici nascosti nel rumore.

Una nuova rete di sicurezza in due fasi

Per affrontare il problema, i ricercatori hanno analizzato 174.292 accessi al pronto soccorso in tre ospedali in Cina e negli Stati Uniti. Hanno prima costruito diversi modelli di machine learning a partire dai dati standard delle cartelle cliniche elettroniche: età, modalità di arrivo, livello di triage, segni vitali come pressione arteriosa e saturazione, e esami di laboratorio di routine come creatinina o lattato. Tra sette approcci testati, un metodo chiamato LightGBM ha dato le migliori prestazioni, separando in modo affidabile i sopravvissuti dai non sopravvissuti attraverso ospedali e periodi temporali. Tuttavia, anche questo modello solido continuava a produrre troppi falsi positivi quando usato in modo semplice con una soglia unica “alto rischio vs non alto rischio”.

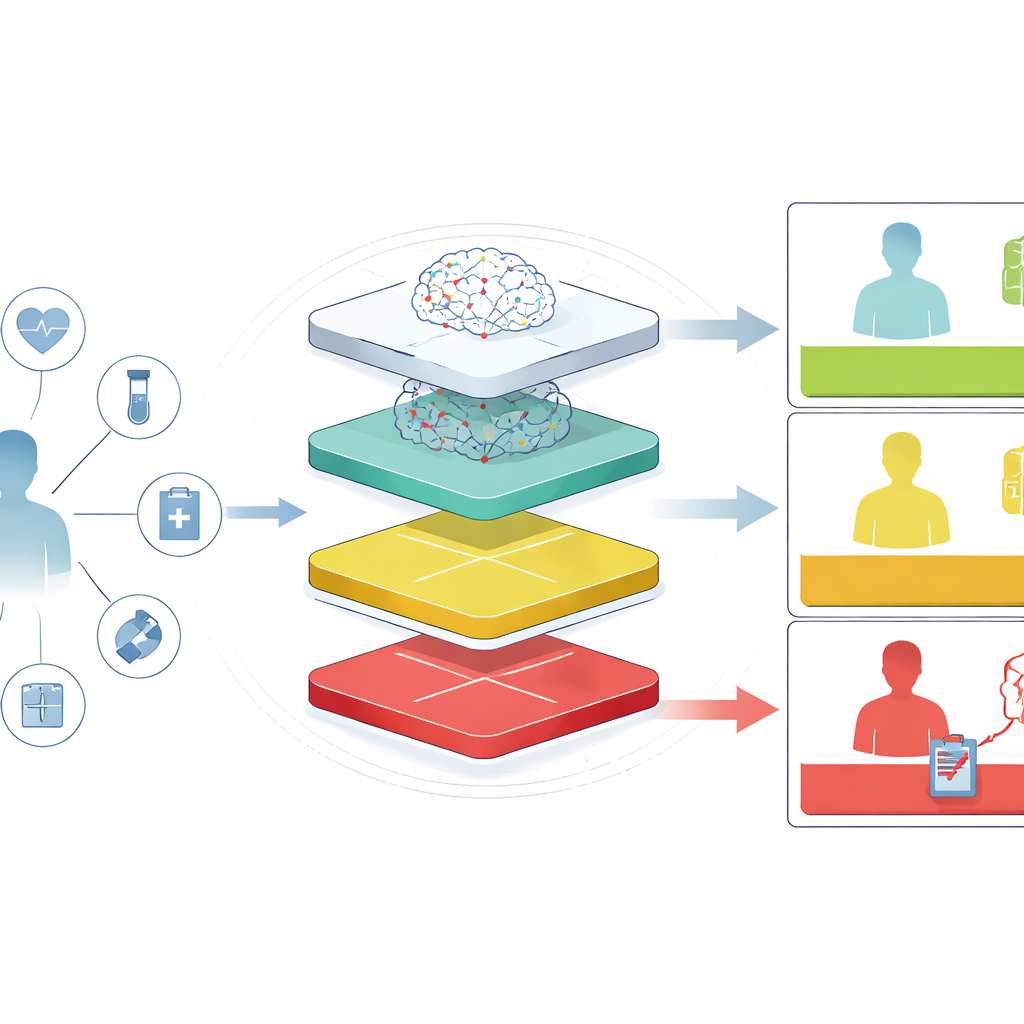

Da un grande allarme a livelli di preoccupazione

L’innovazione centrale di AI-TEW è ripensare il modo in cui le predizioni vengono usate, non solo come vengono calcolate. Invece di un singolo cut-off che etichetta i pazienti come “alto” o “non alto” rischio, il sistema crea livelli. Nella Fase 1, a ogni paziente viene assegnato un punteggio di rischio. Nella Fase 2, due soglie dividono questi punteggi in fasce a basso, medio e alto rischio. La fascia a basso rischio è tarata per essere molto sicura — oltre il 98–99 percento dei pazienti in questo gruppo sopravvive — il che aiuta i clinici a de‑escalare con fiducia le cure. La fascia ad alto rischio è intenzionalmente stretta: copre solo una piccola porzione di pazienti ma contiene una quota molto più alta di decessi veri. In un grande ospedale, questa strategia ha aumentato la quota di veri casi ad alto rischio tra quelli segnalati (il valore predittivo positivo) da circa l’11 percento a circa il 40 percento, mantenendo nel contempo la fascia a basso rischio estremamente rassicurante. Il gruppo a rischio medio è quindi suddiviso in sottogruppi, permettendo agli ospedali di adeguare l’intensità di monitoraggio a quanto preoccupante appare realmente il caso.

Aggiungere il “buon senso” medico con i large language model

Anche con fasce più intelligenti, alcune allerte restano discutibili, soprattutto per pazienti con dati incompleti o contraddittori. Per affinare ulteriormente il sistema, il team ha aggiunto un terzo livello che utilizza large language model — lo stesso tipo di IA usata nei chatbot avanzati, ma messa a punto per il ragionamento medico. Per ogni allerta ad alto rischio, questi modelli esaminano i principali reperti del paziente e rispondono in uno dei tre modi: sostanzialmente “sì, questo sembra genuinamente ad alto rischio”, “no, sembra improbabile che sia così pericoloso come segnalato”, o “incerto, serve una revisione umana”. Nei test interni ed esterni, tutti i modelli linguistici hanno mantenuto alta la sensibilità, cioè raramente hanno mancato decessi veri, ma diversi hanno ridotto in modo evidente i falsi allarmi. Un modello, MedGemma, ha portato l’accuratezza delle allerte ad alto rischio a quasi una su due corretta, un miglioramento importante rispetto agli approcci tradizionali.

Rendere i punteggi di rischio comprensibili al letto del paziente

Oltre ai numeri grezzi, il quadro dà importanza a spiegazioni che i clinici possano afferrare rapidamente. Gli autori usano una tecnica che scompone il rischio di ogni paziente nei fattori contributivi, evidenziando, ad esempio, che una combinazione di lattato molto alto, albumina bassa e scarsa funzione renale spinge la previsione verso il pericolo. Questi pattern corrispondono a conoscenze mediche consolidate, rassicurando gli utenti sul fatto che il sistema non si basi su segnali misteriosi o implausibili. I modelli linguistici convertono poi questi fattori in brevi narrazioni in linguaggio semplice, descrivendo perché un dato paziente è stato collocato in una determinata fascia e quali tipi di insufficienza d’organo o infezione potrebbero essere in corso.

Cosa significa per pazienti e personale

In termini semplici, questo studio mostra che nelle cure d’emergenza rendere utili gli strumenti predittivi non significa solo costruire un modello intelligente — significa fornire il tipo giusto di allerta, al clinico giusto, nel momento giusto. Combinando predizioni solide di machine learning, una struttura a livelli che focalizza l’attenzione dove serve di più, e uno strato finale di “ragionamento” che elimina le allerte deboli, AI-TEW trasforma un sistema di allerta rumoroso e spesso ignorato in una guida più affidabile. Se adottati e testati in pratica clinica reale, quadri di questo tipo potrebbero aiutare i clinici a intervenire prima su pazienti davvero fragili, ridurre il panico inutile per quelli stabili e alleggerire il carico cognitivo sui team di emergenza già sotto pressione.

Citazione: Wu, L., Mai, L., Wang, H. et al. Artificial Intelligence-powered tiered early warning framework addressing high false alarm rates for in-hospital mortality prediction. npj Digit. Med. 9, 346 (2026). https://doi.org/10.1038/s41746-026-02522-8

Parole chiave: alerts del pronto soccorso, predizione del rischio clinico, intelligenza artificiale medica, large language model, mortalità in ospedale