Clear Sky Science · de

KI-gestützter gestufter Frühwarnrahmen zur Reduzierung hoher Falschalarmraten bei der Vorhersage von Mortalität im Krankenhaus

Warum schlauere Krankenhausalarme wichtig sind

Wer schon einmal eine Notaufnahme besucht hat, kennt das Gefühl von Chaos: piepende Alarme, eilendes Personal und sehr kranke Patienten zu jeder Tages- und Nachtzeit. Doch die gefährlichsten Patienten sind manchmal am schwersten früh zu erkennen, und Computersysteme, die Ärzte warnen sollen, schreien oft „Wolf“ — sie erzeugen weit mehr Falschalarmierungen als echte Notfälle. Diese Studie stellt einen neuen künstlichen Intelligenzrahmen namens AI-TEW vor, der Krankenhaus-Warnsysteme sowohl schärfer als auch leiser machen soll — sodass ein Alarm eher die Aufmerksamkeit der Kliniker verdient.

Das Problem mit zu vielen Warnungen

Krankenhäuser nutzen zunehmend Computermodelle, um vorherzusagen, welche frisch aufgenommenen Patienten während des Aufenthalts zu sterben drohen. Auf dem Papier sehen diese Modelle beeindruckend aus: sie ordnen meist richtig ein, welche Patienten höheres oder niedrigeres Risiko haben. In realen Notaufnahmen sind Todesfälle im Krankenhaus jedoch selten — typischerweise weniger als 5 von 100 Aufnahmen. Dieses Ungleichgewicht bedeutet, dass selbst ein genaues Modell viel mehr Falschalarmierungen als echte Fälle erzeugen kann. Frühere Systeme zeigten Situationen, in denen etwa 9 von 10 als „hochrisikoreg“ markierten Alarmen sich als falsch herausstellten. Dieser Sturm an zweifelhaften Warnungen führt zur „Alarmmüdigkeit“, bei der Pflegekräfte und Ärzte abstumpfen und die wenigen wirklich kritischen Fälle, die im Lärm stecken, übersehen könnten.

Ein neues zweistufiges Sicherheitsnetz

Um dem zu begegnen, analysierten die Forschenden 174.292 Notaufnahmen über drei Krankenhäuser in China und den USA. Zuerst erstellten sie mehrere Machine-Learning-Modelle aus standardmäßigen Daten der elektronischen Gesundheitsakte: Alter, Ankunftsmodus, Triage-Stufe, Vitalwerte wie Blutdruck und Sauerstoffsättigung sowie Routine-Labortests wie Kreatinin oder Laktat. Von sieben getesteten Ansätzen lieferte eine Methode namens LightGBM die besten Ergebnisse und trennte zuverlässig Überlebende von Nicht-Überlebenden über Krankenhäuser und Zeiträume hinweg. Selbst dieses starke Modell erzeugte jedoch bei einer einfachen „hochrisiko versus nicht hochrisiko“-Anwendung immer noch zu viele falsch positive Meldungen.

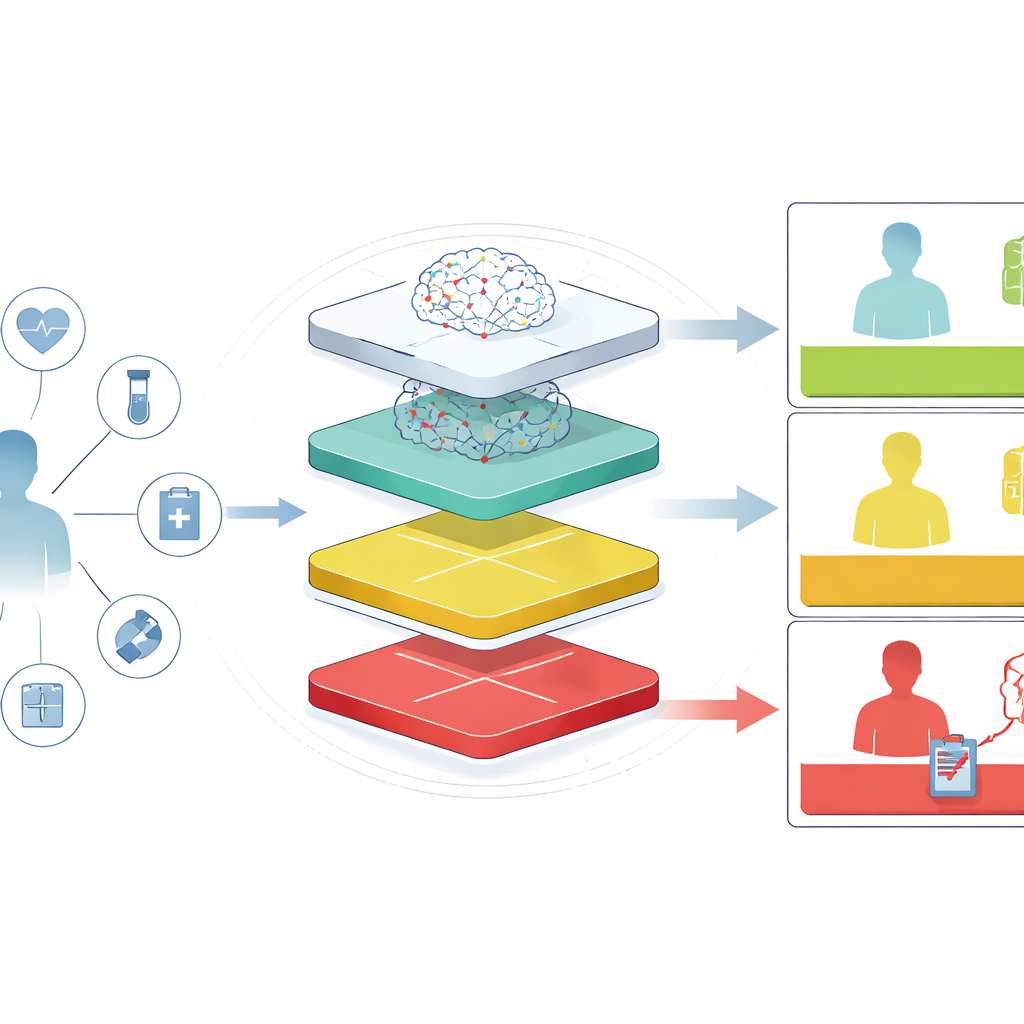

Von einem großen Alarm zu Besorgnisstufen

Die Kerninnovation von AI-TEW besteht darin, die Nutzung von Vorhersagen neu zu denken, nicht nur ihre Berechnung. Statt eines einzelnen Schwellenwerts, der Patienten als „hoch“ oder „nicht hoch“ einstuft, schafft das System Stufen. In Stufe 1 erhält jeder Patient eine Risikobewertung. In Stufe 2 teilen zwei Schwellen diese Bewertungen in Niedrig-, Mittel- und Hoch-Risiko-Bereiche. Die Niedrigrisikogruppe ist sehr konservativ eingestellt — über 98–99 Prozent der Patienten in dieser Gruppe überleben — was Klinikerinnen und Klinikern ermöglicht, die Versorgung mit Vertrauen zu reduzieren. Die Hochrisikogruppe ist absichtlich eng: sie umfasst nur einen kleinen Anteil der Patienten, enthält aber einen deutlich höheren Anteil an tatsächlichen Todesfällen. In einem großen Krankenhaus erhöhte diese Strategie den Anteil echter Hochrisikofälle unter den Markierten (den positiven Vorhersagewert) von etwa 11 Prozent auf rund 40 Prozent, während die Niedrigrisikogruppe äußerst beruhigend blieb. Die Mittelrisikogruppe wird weiter in Untergruppen aufgeteilt, sodass Krankenhäuser die Überwachungsintensität an die tatsächliche Besorgnis anpassen können.

Medizinischer „gesunder Menschenverstand“ durch große Sprachmodelle

Selbst mit schlaueren Stufen bleiben einige Warnungen fragwürdig, insbesondere bei Patientinnen und Patienten mit unvollständigen oder widersprüchlichen Daten. Um weiter zu verfeinern, fügte das Team eine dritte Schicht mit großen Sprachmodellen hinzu — derselbe KI-Typ, der in fortgeschrittenen Chatbots verwendet wird, aber für medizinisches Denken angepasst. Für jeden Hochrisikoalarm prüfen diese Modelle die wichtigsten Befunde eines Patienten und antworten in einer von drei Arten: effektiv „ja, das sieht wirklich hochriskant aus“, „nein, das scheint weniger gefährlich zu sein als angezeigt“ oder „unsicher, menschliche Überprüfung erforderlich“. In internen und externen Tests hielten alle Sprachmodelle die Sensitivität hoch, das heißt, sie verpassten selten echte Todesfälle, reduzierten aber bemerkenswert die Falschalarmrate. Ein Modell, MedGemma, erhöhte die Genauigkeit der Hochrisikoalarme so, dass fast jeder zweite Alarm korrekt war — eine erhebliche Verbesserung gegenüber herkömmlichen Ansätzen.

Risikowerte an der Bettkante verständlich machen

Über rohe Zahlen hinaus legt der Rahmen Wert auf Erklärungen, die Klinikerinnen und Kliniker schnell erfassen können. Die Autoren verwenden eine Technik, die das Risiko jedes Patienten in beitragende Faktoren zerlegt und hervorhebt, dass beispielsweise die Kombination aus sehr hohem Laktat, niedrigem Albumin und schlechter Nierenfunktion eine Prognose stark in Richtung Gefahr verschiebt. Diese Muster entsprechen etabliertem medizinischem Wissen und geben Vertrauen, dass das System sich nicht auf mysteriöse oder unwahrscheinliche Signale stützt. Die Sprachmodelle formulieren diese Faktoren dann in kurzen, allgemeinverständlichen Texten, die beschreiben, warum ein Patient einer bestimmten Stufe zugeordnet wurde und welche Organschwäche oder Infektion sich entwickeln könnte.

Was das für Patienten und Personal bedeutet

Einfach gesagt zeigt diese Studie: In der Notfallversorgung geht es bei nützlichen Vorhersagetools nicht nur darum, ein cleveres Modell zu bauen — es geht darum, die richtige Art von Alarm zur richtigen Person zur richtigen Zeit zu bringen. Durch die Kombination starker Machine-Learning-Vorhersagen, einer gestuften Struktur, die die Aufmerksamkeit dort bündelt, wo sie am meisten gebraucht wird, und einer abschließenden „Reasoning“-Schicht, die schwache Alarme aussiebt, macht AI-TEW aus einem lauten, oft ignorierten Warnsystem einen vertrauenswürdigeren Leitfaden. Wird ein solcher Rahmen eingeführt und in der Praxis getestet, könnte er helfen, bei wirklich gefährdeten Patienten früher zu intervenieren, unnötige Panik bei stabilen Patienten zu reduzieren und die kognitive Belastung bereits stark beanspruchter Notfallteams zu verringern.

Zitation: Wu, L., Mai, L., Wang, H. et al. Artificial Intelligence-powered tiered early warning framework addressing high false alarm rates for in-hospital mortality prediction. npj Digit. Med. 9, 346 (2026). https://doi.org/10.1038/s41746-026-02522-8

Schlüsselwörter: Alarmmeldungen in der Notaufnahme, klinische Risikovorhersage, medizinische künstliche Intelligenz, große Sprachmodelle, Mortalität im Krankenhaus