Clear Sky Science · es

Marco de alerta temprana por niveles impulsado por inteligencia artificial que aborda las altas tasas de falsas alarmas en la predicción de mortalidad intrahospitalaria

Por qué importan unas alertas hospitalarias más inteligentes

Cualquiera que haya visitado un servicio de urgencias sabe que puede sentirse caótico: alarmas sonando, personal corriendo y pacientes muy graves llegando a cualquier hora. Sin embargo, los pacientes más peligrosos a veces son los que más cuesta detectar pronto, y los sistemas informáticos diseñados para avisar a los médicos suelen dar la voz de alarma en exceso, generando muchas más falsas alarmas que emergencias reales. Este estudio presenta un nuevo marco de inteligencia artificial, llamado AI-TEW, diseñado para hacer que los sistemas de alerta hospitalaria sean a la vez más precisos y menos ruidosos —de modo que cuando suene una alarma, los clínicos tengan muchas más probabilidades de prestarle atención.

El problema de demasiadas advertencias

Los hospitales usan cada vez más modelos informáticos para predecir qué pacientes recién ingresados corren riesgo de morir durante su estancia. Estos modelos lucen bien en papel, clasificando correctamente a pacientes de alto y bajo riesgo la mayor parte del tiempo. Pero en los servicios de urgencias reales, las muertes intrahospitalarias son infrecuentes —normalmente menos de 5 por cada 100 ingresos. Ese desequilibrio implica que incluso un modelo preciso puede generar muchas más falsas alarmas que verdaderas. En sistemas anteriores se han dado casos donde aproximadamente 9 de cada 10 alertas etiquetadas como “alto riesgo” resultaron ser incorrectas. Esta avalancha de advertencias dudosas conduce a la “fatiga por alertas”, donde enfermeras y médicos se insensibilizan y pueden pasar por alto los pocos casos realmente críticos ocultos entre el ruido.

Una nueva red de seguridad en dos etapas

Para abordar esto, los investigadores analizaron 174,292 visitas a urgencias en tres hospitales de China y Estados Unidos. Primero construyeron varios modelos de aprendizaje automático a partir de datos estándar de la historia clínica electrónica: edad, modo de llegada, nivel de triaje, signos vitales como presión arterial y saturación de oxígeno, y pruebas de laboratorio rutinarias como creatinina o lactato. Entre siete enfoques probados, un método llamado LightGBM fue el mejor, separando de forma confiable a supervivientes de no supervivientes a través de hospitales y periodos temporales. Sin embargo, incluso este modelo sólido seguía produciendo demasiados falsos positivos cuando se usaba de forma simple con un umbral único de “alto riesgo versus no alto riesgo”.

De una gran alarma a niveles de preocupación

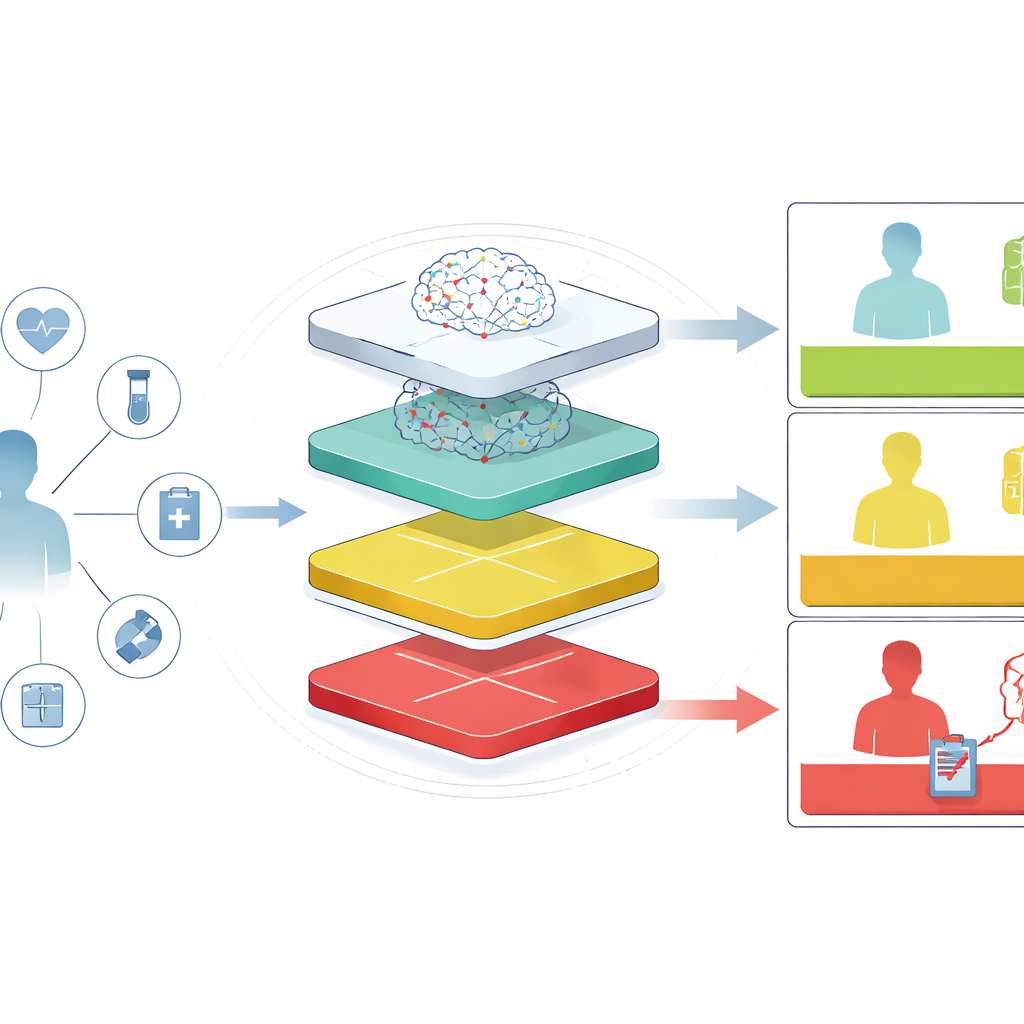

La innovación central de AI-TEW es replantear cómo se usan las predicciones, no solo cómo se calculan. En vez de un único corte que etiqueta a los pacientes como “alto” o “no alto” riesgo, el sistema crea niveles. En la Etapa 1, cada paciente recibe una puntuación de riesgo. En la Etapa 2, dos umbrales dividen esas puntuaciones en bandas de bajo, medio y alto riesgo. La franja de bajo riesgo está calibrada para ser muy segura —más del 98–99 por ciento de los pacientes en este grupo sobreviven—lo que ayuda a los clínicos a desescalar la atención con confianza. La franja de alto riesgo es intencionadamente estrecha: cubre solo una pequeña porción de pacientes pero contiene una proporción mucho mayor de muertes reales. En un hospital importante, esta estrategia aumentó la proporción de verdaderos casos de alto riesgo entre los señalados (el valor predictivo positivo) de aproximadamente un 11 por ciento a alrededor del 40 por ciento, manteniendo al mismo tiempo la franja de bajo riesgo extremadamente tranquilizadora. El grupo de riesgo medio se divide además en subgrupos, lo que permite a los hospitales ajustar la intensidad del monitoreo según lo preocupante que parezca realmente un caso.

Agregar “sentido común” médico con modelos de lenguaje grande

Incluso con niveles más inteligentes, algunas alertas siguen siendo cuestionables, especialmente para pacientes cuyos datos están incompletos o son contradictorios. Para refinarlo aún más, el equipo añadió una tercera capa usando modelos de lenguaje grande —el mismo tipo de IA usado en chatbots avanzados, pero afinado para razonamiento médico. Para cada alerta de alto riesgo, estos modelos revisan los hallazgos clave del paciente y responden de una de tres maneras: efectivamente “sí, esto parece genuinamente de alto riesgo”, “no, esto parece menos peligroso de lo indicado” o “incierto, se necesita revisión humana adicional”. En pruebas internas y externas, todos los modelos de lenguaje mantuvieron alta la sensibilidad, lo que significa que rara vez pasaban por alto muertes reales, pero varios redujeron notablemente las falsas alarmas. Un modelo, MedGemma, elevó la precisión de las alertas de alto riesgo hasta casi una de cada dos siendo correcta, una mejora considerable frente a los enfoques tradicionales.

Hacer comprensibles las puntuaciones de riesgo junto a la cama

Más allá de los números en bruto, el marco enfatiza explicaciones que los clínicos puedan entender rápidamente. Los autores usan una técnica que descompone el riesgo de cada paciente en factores contribuyentes, destacando, por ejemplo, que una combinación de lactato muy alto, albúmina baja y mala función renal impulsa fuertemente una predicción hacia el peligro. Estos patrones coinciden con el conocimiento médico establecido, lo que tranquiliza a los usuarios sobre que el sistema no se basa en señales misteriosas o inverosímiles. Los modelos de lenguaje luego convierten estos factores en narrativas breves y en lenguaje llano, describiendo por qué un paciente ha sido colocado en una franja particular y qué tipos de fallo orgánico o infección podrían estar desarrollándose.

Qué significa esto para pacientes y personal

En términos sencillos, este estudio muestra que en la atención de urgencias, hacer útiles las herramientas de predicción no es solo construir un modelo ingenioso: se trata de entregar el tipo correcto de alerta, al clínico adecuado, en el momento adecuado. Al combinar predicciones robustas de aprendizaje automático, una estructura por niveles que centra la atención donde más se necesita y una capa final de “razonamiento” que filtra las alertas débiles, AI-TEW convierte un sistema de advertencias ruidoso y a menudo ignorado en una guía más fiable. Si se adopta y evalúa en práctica real, este tipo de marcos podría ayudar a los clínicos a intervenir antes en pacientes verdaderamente frágiles, reducir la alarma innecesaria en pacientes estables y aliviar la carga cognitiva de equipos de urgencias ya sobrecargados.

Cita: Wu, L., Mai, L., Wang, H. et al. Artificial Intelligence-powered tiered early warning framework addressing high false alarm rates for in-hospital mortality prediction. npj Digit. Med. 9, 346 (2026). https://doi.org/10.1038/s41746-026-02522-8

Palabras clave: alertas en urgencias, predicción de riesgo clínico, inteligencia artificial médica, modelos de lenguaje grande, mortalidad intrahospitalaria